support vector regression(SVR)支持向量回归

Posted 小葵花幼儿园园长

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了support vector regression(SVR)支持向量回归相关的知识,希望对你有一定的参考价值。

支持向量机、回归、机器学习

SVR---“宽容的回归模型”

引出:请你说说回归问题可以设置支持向量机吗

支持向量分类方法可以推广到解决回归问题。

这种方法称为支持向量回归,即support vector regression(SVR)

线性回归

线性回归:在向量空间里用线性函数去拟合样本。该模型以所有样本实际位置到该线性函数的综合距离为损失,通过最小化损失来求取线性函数的参数。

严格点在于: 对于线性回归而言,一个样本只要不算正好落在作为模型的线性函数上,就要被计算损失。

SVR—“宽容的回归模型”

支持向量回归(Support Vector Regression,SVR)

模型函数

支持向量回归模型的模型函数也是一个线性函数: y = w x + b y = w x + b y=wx+b ,但是和线性回归是两个不同的回归模型!

不同点在于:

- 计算损失的原则不同,

- 目标函数和最优化算法也不同。

原理

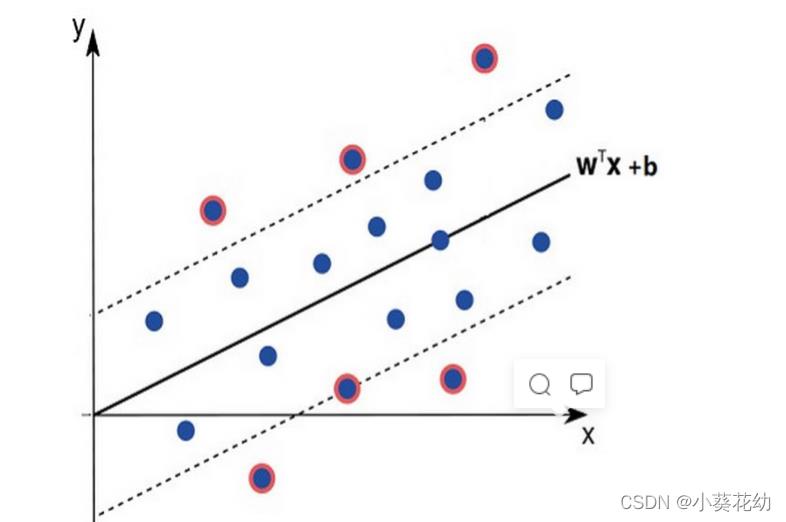

SVR在线性函数两侧制造了一个“间隔带”,对于所有落入到间隔带内的样本,都不计算损失;只有间隔带之外的,才计入损失函数。

之后再通过最小化间隔带的宽度与总损失来最优化模型。

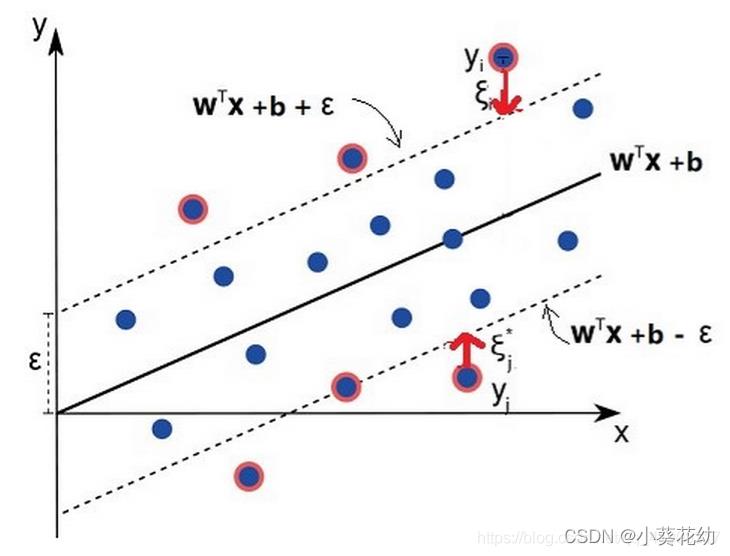

SVR的两个松弛变量

有一点和SVM是正好相反的:SVR希望样本点都落在“隔离带”内,而SVM希望样本点都在“隔离带”外。

SVR要同时引入两个松弛变量:

ξ

和

ξ

∗

ξ 和ξ^∗

ξ和ξ∗

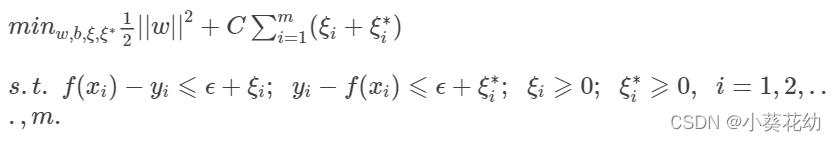

主问题

数学描述

以上是关于support vector regression(SVR)支持向量回归的主要内容,如果未能解决你的问题,请参考以下文章