AI简报20220311期汽车AI芯片竞赛加速苹果最强芯M1 Ultra登场

Posted RT-Thread物联网操作系统

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了AI简报20220311期汽车AI芯片竞赛加速苹果最强芯M1 Ultra登场相关的知识,希望对你有一定的参考价值。

AI芯片

1. 汽车AI芯片竞赛加速 瑞萨推R-Car V4H SoC

原文:

https://xw.qq.com/amphtml/20220309A06L9100

3月8日,瑞萨宣布推出R-Car V4H片上系统(SoC),用于高级驾驶辅助(ADAS)和自动驾驶(AD)解决方案的中央处理。

公开资料显示,R-Car V4H的深度学习性能高达34 TOPS(每秒万亿次运算),能够通过汽车摄像头、雷达和激光雷达(LiDAR)对周围物体进行高速图像识别与处理,且具有业界领先的性能功耗比,适用于自动驾驶应用大规模量产区间——L2+和L3等。

得益于高度的集成性,R-Car V4H允许客户开发具有成本竞争力的单芯片ADAS电子控制单元(ECU)。这些控制单元可支持适合Level 2+和Level 3等级的自动驾驶系统,包括完整的NCAP 2025功能。R-Car V4H还支持环视和自动泊车功能。

据悉,R-Car V4H SoC样片即日起发售,并计划于2024年二季度开始量产。

2. 1140亿个晶体管,苹果最强芯M1 Ultra登场!iPhone SE3:A15、5G都齐了

原文:

https://mp.weixin.qq.com/s/dZpyKGbeX67vnyO1qSchQg

电子发烧友网报道(文/梁浩斌)2022苹果春季发布会在今天(3月9日)凌晨以录播的形式进行,这次发布会的主角绝对是Apple Silicon,几乎每款新品首先提到的都是芯片以及性能。按照惯例,我们先简单总结下这次发布会的亮点:

Mac Studio:相当于Mac Mini的性能版,搭载最新的M1 Ultra,多核性能是M1 Max的两倍,电源、散热有巨大提升。M1 Max版起售价为14999元,M1 Ultra版起售价为29999元。

Studio Display:内置了A13仿生芯片的27英寸5K视网膜显示屏,摄像头、音频系统有惊喜,售价11499 元起。

iPhone SE 3:与iPhone8外观相同,搭载A15芯片,支持5G网络,国行售价3499 元起,有64GB、128GB、256GB 三种存储版本。

iPad Air 5:外观与上代相同,搭载满血M1芯片,升级前置摄像头至1200万像素,蜂窝板支持5G,售价4399元起,有64GB、256GB 二种存储版本。

iPhone 13系列新配色:绿色

AI热点

3. PapersWithCode官宣突破6k+基准,TensorFlow影响力第一

原文:

https://mp.weixin.qq.com/s/HulhjMMQEnu42tFtcm7bqg

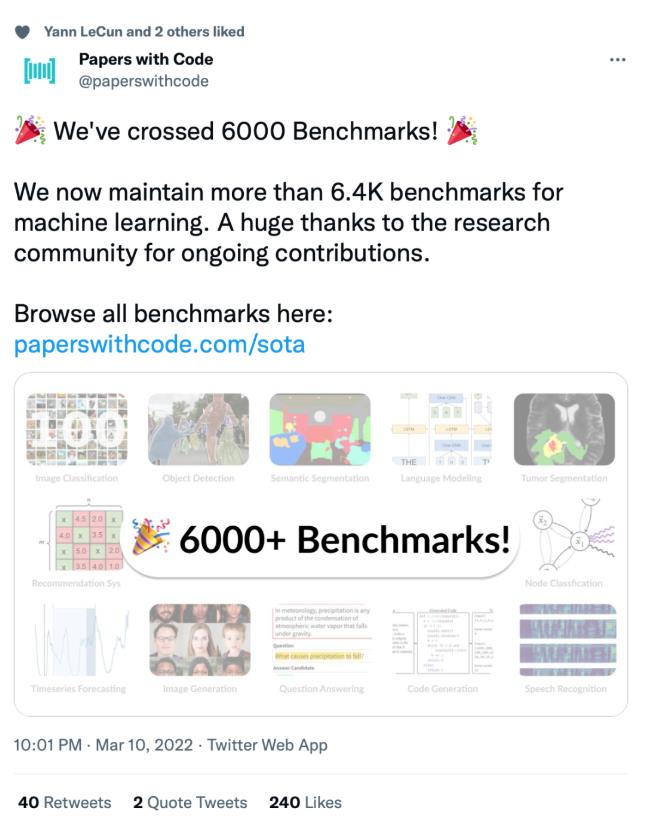

刚刚,知名机器学习论文网站 Papers With Code 在推特上官宣:「我们突破了 6000 个基准!我们现在囊括了超过6.4k个机器学习的基准。非常感谢领域成员的持续贡献!」

Papers with Code 中收集了各种机器学习的内容(论文、代码、结果),为研究者们提供了迅速搜索论文与掌握行业领先研究的途径,一向受到「MLer」的欢迎。

自2018年7月成立以来,该网站便经历了几个重要的发展阶段:

2019年12月,加入Facebook人工智能研究院(FAIR),彼时已累积18000 篇论文、1000 项任务和 1500 个排行榜;

2020年10月,与arXiv合作,在arXiv上引入代码;

2021年5月又与arXiv进一步合作,在arXiv上引入数据集;

2021年6月,官宣上线论文复现报告。

如今,距离 Papers with Code 成立不过三年多,该网站就集合了6.4k+个基准,妥妥的「机器学习网站一哥」。

根据 Papers with Code 的最新统计,它还分「Top」(上升趋势)、「Social」(社交推荐)、「New」(时间新旧)与「Greatest」(影响力大小)四个板块对其所集合的 SOTA 模型做了划分,其中,在「Greatest」行列,TensorFlow排名第一,Transformer第三,PyTorch第五。

4. AI 与人文共舞!DeepMind 用神经网络修复古希腊铭文,登顶Nature最新封面

原文:

https://mp.weixin.qq.com/s/DKNgfFxw8vtItkuVsvglrA

今天,人工智能领军团 DeepMind 又爆出了一项重要成果:用深度神经网络修复古希腊受损的石碑铭文,号称「Predicting the Past」(预测过去),在以Nature为首的科学媒介上掀起了一番热烈关注。

他们以古希腊的岛屿名为该模型命名——「Ithaca」(伊萨卡岛),以表对古希腊文明的神往。在荷马史诗《奥德赛》中,伊萨卡岛是英雄奥德修斯(Odysseus)的故乡。传闻,公元前1183年,国王奥德修斯在特洛伊战役中取得胜利后,历经十七年的艰险斗争,战胜无数困难,最终回到伊萨卡岛,与妻儿幸福团聚。

「伊萨卡」也从此成为古希腊文明中「家」的象征。这可能也是 DeepMind 迄今为止被赋予了最浪漫名义的 AI 模型。

科学与人文从来便是人类文明的两大黄金分支。历史的前进,从来离不开这两个车轮。往后回看,Ithaca 的出现,或许正是 AI 进军人文社科的起点。

AI前沿

5. 上海交大等提出:从因果不变性视角探讨图神经网络的分布外泛化鲁棒性

原文:

https://mp.weixin.qq.com/s/Hx-f640Bf71Tcs8UJHDW6Q

如何提高在新数据上的泛化性能是机器学习的一个核心问题。然而,近年来很多研究表明神经网络对数据的分布异常敏感,当测试数据的分布与训练数据呈现明显不同时,模型的泛化性能将受到很大的影响。这也为深度学习的实际应用与落地带来了隐忧与困难,特别是针对一些高风险的领域,如自动驾驶、金融投资、医疗诊断、刑事司法等。

如何提高在新数据上的泛化性能是机器学习的一个核心问题。然而,近年来很多研究表明神经网络对数据的分布异常敏感,当测试数据的分布与训练数据呈现明显不同时,模型的泛化性能将受到很大的影响。这也为深度学习的实际应用与落地带来了隐忧与困难,特别是针对一些高风险的领域,如自动驾驶、金融投资、医疗诊断、刑事司法等。

目前大部分关于分布外泛化问题的研究集中在欧式数据(如图像、文本等),而对于图结构数据的相关研究还较少。与普通欧式数据不同的是,图结构数据上的分布偏移问题需要解决不同的技术挑战。首先,由于节点的互连特性,数据样本通常是非独立同分布的,这就为数据生成分布的建模带来了困难。其次,除了节点特征外,图的结构也蕴含了重要的信息,会影响到表示学习和预测任务。

本文介绍被International Conference on Learning Representations(ICLR‘22)会议接收的一项新工作,关注图结构数据的分布偏移问题,主要贡献如下:

对图上的分布外泛化问题给出了形式化定义,并提供了基于因果不变性假设的分析视角。

从理论上证明了传统学习方法无法实现有效的分布外泛化,并提出了一种新的目标函数(探索-外推风险最小化),用于实现从有限的观测数据向测试分布的外推。

通过理论分析表明新的目标函数可以有效解决分布外泛化问题,并且训练过程可以有效降低测试数据上的泛化误差。

为了验证提出的方法,考虑了三个不同的场景(处理人造混淆噪声、跨图迁移、动态图时序外推),并在多个不同的GNN主干模型上展示了方法的有效性和稳健性。

6. Michael Brostein 最新几何深度学习综述:超越 WL 和原始消息传递的 GNN

原文:

https://mp.weixin.qq.com/s/qDHeHA-4cMTUeHbkkHx1ww

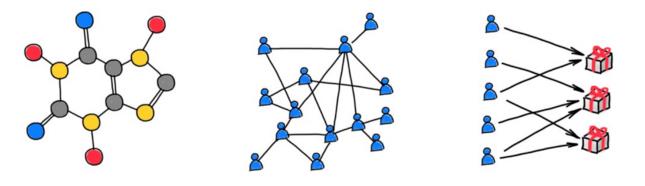

图可以方便地抽象关系和交互的复杂系统。社交网络、高能物理、化学等研究领域都涉及相互作用的对象(无论是人、粒子还是原子)。在这些场景下,图结构数据的重要性日渐凸显,相关方法取得了一系列初步成功,而一系列工业应用使得图深度学习成为机器学习方向的热门研究话题之一。

图注:通过图对复杂系统的关系、交互进行抽象。例如,「分子图」中构成分子的原子至今的化学键,「社交网络」中用户之间的关系和交互,「推荐系统」中用户和商品之间的联系。

受物理启发的图上的持续学习模型可以克服传统 GNN 的局限性。多年来,消息传递一直是图深度学习领域的主流范式,使图神经网络(GNN)在粒子物理到蛋白质设计的广泛应用中取得了巨大成功。

从理论角度来看,它建立了与 Weisfeiler-Lehman(WL)层次结构的联系,我们可以以此分析 GNN 的表达能力。但是在 Michael Brostein 看来,当前图深度学习方案「以节点和边为中心」的思维方式带来了无法克服的局限性,阻碍了该领域未来的发展。

另一方面,在关于几何深度学习的最新综述中,Brostein 提出了受物理启发的持续学习模型,从微分几何、代数拓扑和微分方程等领域出发开启了一系列新工具的研究。到目前为止,图机器学习领域中还鲜有此类研究。

7. 字节跳动技术团队提出「AI渲染」方案,手机端也能实现影视级渲染效果

原文:

https://mp.weixin.qq.com/s/IO6awwctpsYBE5KWbqq3Gg

随着3D技术的高速发展,影视渲染效果的复杂度、精细度都在逐步提升,但高质量的渲染效果和时间成本往往难以兼顾。针对这一行业痛点,字节跳动智能创作团队基于AI技术的优势提出了「AI渲染」方案。这一方案现已在抖音落地实现,可以基于AI和离线渲染技术,加速渲染过程,提升渲染质量,降低影视级渲染的享用成本,甚至在手机端实现影视级渲染效果。

未来, 这项技术能力也将通过火山引擎对外输出,让企业以更低成本享有更快、更好的AI渲染能力。

一起来看看「AI渲染」方案在抖音上的实现效果:

一直以来,抖音特效都因为其逼真的质感和实时的交互性体验而受到用户喜爱。这与其背后的实时渲染能力密不可分。

在过去,实时渲染受限于性能,难以渲染复杂的模型和材质,例如:折射、散射的材质,烟雾、泡沫等带有体积感的材质,以及带有自阴影的精细纹路等。因此,像视频中这样精细的渲染效果往往来自于离线渲染。离线渲染通过光线追踪的方式能够渲染出十分逼真的复杂效果,但是代价就是大量的耗时增加。

整体而言,利用AI加速渲染是基于数据和神经网络训练方法形成的自动化的材质生产链路,具有高度还原离线材质、速度快、且能够快速迭代的优势。目前,这一技术趋势已经初步显现,Nvidia、Adobe等各大公司都在研究AI渲染相关技术。

字节跳动的「AI渲染」方案在渲染流程中,对所涉及的合成数据、神经网络渲染和整体方案等方面都进行了优化,体现出较好的性能表现。

AI干货

8. 16个社区热议工作及10篇国际AI顶会Best Papers一文回顾

原文:

https://mp.weixin.qq.com/s/t1xK5YNlt-L-IJcegznl5w

为老伙计们汇总并逐一盘点2022年开春以来机器之心编辑部报道发现的社区热议的技术工作,并回顾近期举办的国际AI顶会的最佳论文。

本卷资料收录

2022春季热议工作:16项

2022春季国际顶会最佳论文:10篇

2022 春季 · 机器之心报道社区热议工作

热议工作1:阿里达摩院语音实验室提出了一种具有线性复杂度 (O(N)) 的计算模型 PoNet

本文的出发点基于 Transformer 模型中 Self-attention 机制相对于句子长度的复杂度是二次的(O(N^2)),因此在计算速度和显存空间方面都制约了它在长序列中的应用。PoNet ,使用 Pooling 网络替代 Self-attention 机制对句子词汇进行混合,从而捕捉上下文信息。

根据实验表明,PoNet 在长文本测试 Long Range Arena (LRA) 榜上在准确率上比 Transformer 高 2.28 个点,在GPU上运行速度是 Transformer 的 9 倍,显存占用只有 1/10。此外,实验也展示了 PoNet 的迁移学习能力,PoNet-Base 在 GLUE 基准上达到了 BERT-Base 的 95.7% 的准确性。

论文地址:https://arxiv.org/abs/2110.02442

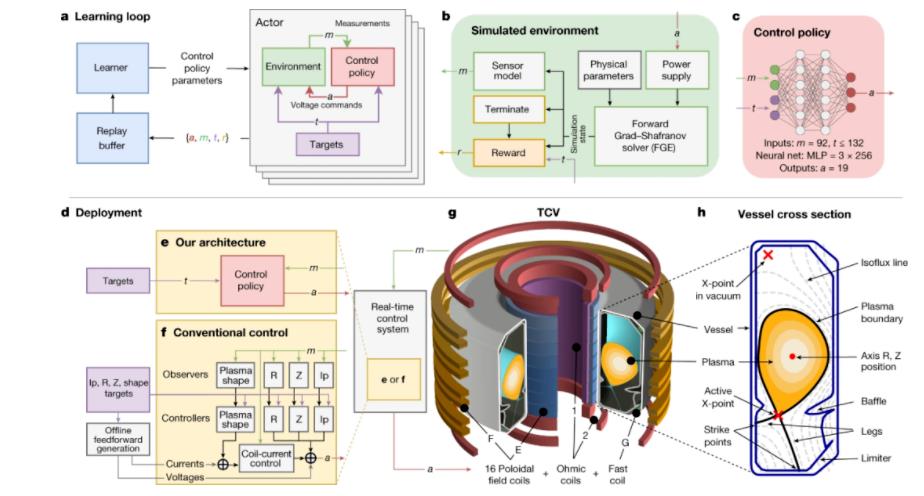

热议工作2:史上首次,强化学习算法控制核聚变登上 Nature:DeepMind 让人造太阳向前一大步

今年 2 月份,EPFL 和 DeepMind 使用深度强化学习控制托卡马克装置等离子体的研究登上了《自然》杂志。DeepMind 控制团队负责人 Martin Riedmiller 表示:「人工智能,特别是强化学习,特别适合解决托卡马克中控制等离子体的复杂问题。」

DeepMind 提出的模型架构如下图所示,该方法具有三个阶段:

第一阶段:设计者为实验指定目标,可能伴随着随时间变化的控制目标;

第二阶段:深度 RL 算法与托卡马克模拟器交互,以找到接近最优的控制策略来满足指定目标;

第三阶段:以神经网络表示的控制策略直接在托卡马克硬件上实时运行(零样本)。

论文地址:https://www.nature.com/articles/s41586-021-04301-9

关注我们

↓点击阅读原文

爱我就请给我在看

以上是关于AI简报20220311期汽车AI芯片竞赛加速苹果最强芯M1 Ultra登场的主要内容,如果未能解决你的问题,请参考以下文章