基于深度多模型融合的单图像去雾(Deep Multi-Model Fusion for Single-Image Dehazing)阅读报告-iccv2019

Posted 啦啦啦啦啦啦.

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了基于深度多模型融合的单图像去雾(Deep Multi-Model Fusion for Single-Image Dehazing)阅读报告-iccv2019相关的知识,希望对你有一定的参考价值。

概述

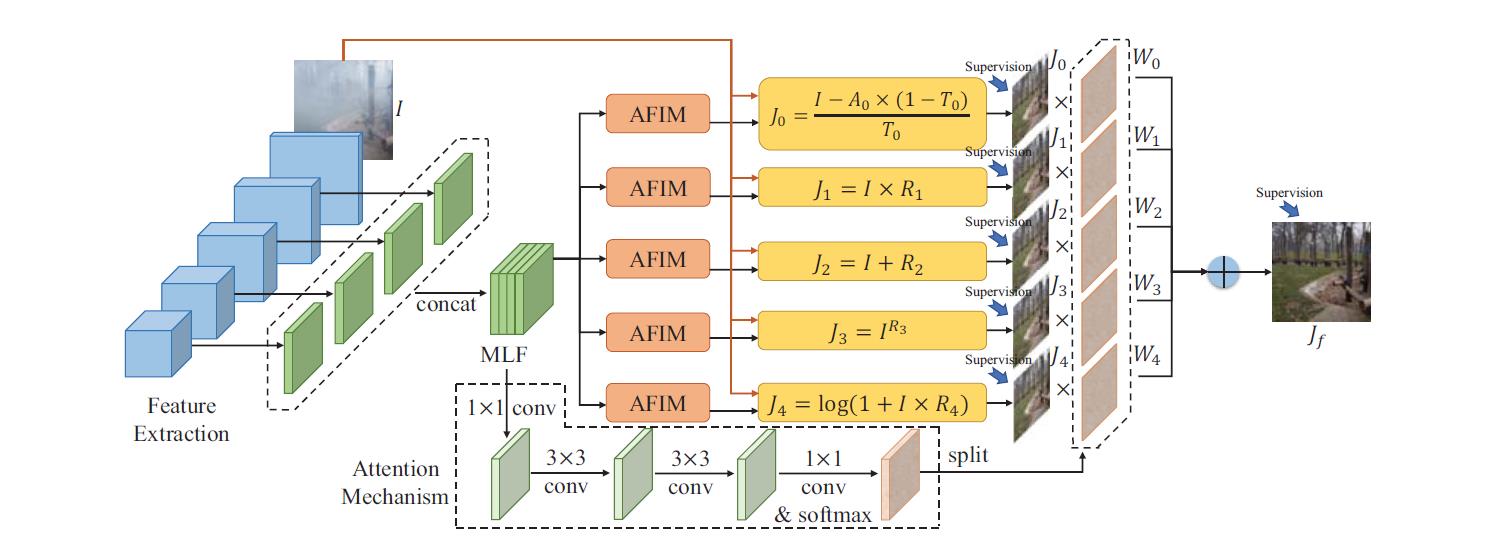

本文提出了一种深度多模型融合网络,将多模型融合到分层中,提高了单图像去雾的性能,首先构建了注意特征集成模块,最大限度地整合卷积神经网络(CNN)不同层次的特征,生成注意多层次集成特征(AMLIF)。然后进一步预测一个大气散射模型和四个雾层分离模型的无雾结果,然后将结果融合在一起,生成最终的无雾图像。

在这项工作中,开发了一个端到端的深度多模式融合网络,将从大气散射模型和雾层分离模型中恢复的去雾结果集成到一个单一的网络架构中,以提高去雾性能。

主要贡献

1、通过融合大气散射模型和雾霾层分离模型,我们开发了一个端到端的深度神经网络来提高去雾性能

2、开发了基于注意力机制的模块来整合CNN不同卷积层的特征,然后从整合的特征中预测去雾结果,基于大气散射模型和几种特定的层分离公式,充分利用了不同雾霾模型之间的互补信息

3、在两种广泛使用的去雾基准数据集和各种真实世界的雾霾图像上,通过与最先进的去雾方法进行比较,来评估所提出的方法

去雾模型

(i)首先从不同CNN层生成多层特征(MLF);

(2)开发了一个注意特征集成模块(AFIM)(见图3)来细化MLF,然后通过开发一个基于散射模型的模块来预测细化后的特征的去雾结果;

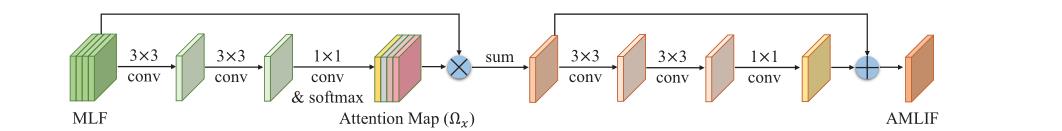

(3)构建四种具体的雾层分解,预测其去雾结果(记为J1、J2、J3、J4);

(4)通过学习加权映射(W0, W1, W2, W3, W4)来融合这些去雾结果生成我们最终的结果。同时注意,这5个的卷积参数不是共享的

注意力特征集成模块(Attentional Feature Integration Module)AFIM

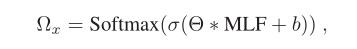

首先是将来自不同CNN层的串联特征(记为MLF)作为输入,AFIM首先利用三个卷积层和一个softmax函数来产生注意力权重Ωx

Θ和b为三个卷积层在MLF上的权重和偏差;三种卷积核大小分别为3 × 3,3 × 3和1 × 1;σ为ReLU激活函数。然后,将注意力图Ωx逐层乘到串接特征(MLF)上,再跨通道方向将这些串接特征相加。

然后使用一个残差块来产生我们的AFIM的输出注意级联多级特征(AMLIF)。在残差块中,我们使用两个3 × 3和一个1 × 1卷积层生成残差分量.

大气散射模型的预测

为了预测大气散射(AS)模型的去雾结果,开发了一个AFIM生成AMLIF,然后通过将AS模型嵌入到网络中,联合估计传输图、大气光和AMLIF的去雾结果。具体来说,在AMLIF上采用了两个3 × 3卷积层和一个sigmoid函数来计算传输映射。然后在AMLIF上使用一个全体平均汇聚,然后使用两个完全连接的层和一个sigmoid函数来估计大气光。然后,将式中的大气散射模型重新表述为,计算去雾结果(记为J0)

其中p为像素位置;I为输入朦胧图像;A0是计算的大气光;T0为估计的传输图。

基于分层模型的预测

除大气散射模型外,还将层分离模型的去雾结果整合在一起来提高去雾性能,因为这些模型可以学习到散射模型的互补去雾信息。并利用注意机制将这4个基分别线性组合得到去雾结果

作者的意思是用这几种方法隐式的模拟一个去雾的模型。

下面是四种猜测:层乘法机制,加法运算,幂运算,以及对数运算

最终结果

在获得不同的去雾模型的结果后,我们利用注意机制将这些预测整合为我们网络的最终结果。为此,我们通过执行一个1× 1卷积层、两个3× 3卷积层、一个1× 1卷积层和一个softmax层,从多层集成特征(AMIF)中学习不同预测的5个注意图;。然后,计算最终结果(记为Jf)为

实验结果

以上是关于基于深度多模型融合的单图像去雾(Deep Multi-Model Fusion for Single-Image Dehazing)阅读报告-iccv2019的主要内容,如果未能解决你的问题,请参考以下文章

图像融合基于matlab多尺度奇异值分解图像融合含Matlab源码 2040期

图像融合基于matlab多尺度奇异值分解图像融合含Matlab源码 2040期

图像增强基于matlab人工多重曝光融合AMEF图像去雾含Matlab源码 1916期