什么是spark?

Posted warmsky

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了什么是spark?相关的知识,希望对你有一定的参考价值。

-

什么是Spark?

- Spark官网:http://spark.apache.org

Spark是一种快速、通用、可扩展的大数据分析引擎,2009年诞生于加州大学伯克利分校AMPLab,2010年开源,2013年6月成为Apache孵化项目,2014年2月成为Apache顶级项目。目前,Spark生态系统已经发展成为一个包含多个子项目的集合,其中包含SparkSQL、Spark Streaming、GraphX、MLlib等子项目,Spark是基于内存计算的大数据并行计算框架。Spark基于内存计算,提高了在大数据环境下数据处理的实时性,同时保证了高容错性和高可伸缩性,允许用户将Spark部署在大量廉价硬件之上,形成集群。

Spark得到了众多大数据公司的支持,这些公司包括Hortonworks、IBM、Intel、Cloudera、MapR、Pivotal、百度、阿里、腾讯、京东、携程、优酷土豆。当前百度的Spark已应用于凤巢、大搜索、直达号、百度大数据等业务;阿里利用GraphX构建了大规模的图计算和图挖掘系统,实现了很多生产系统的推荐算法;腾讯Spark集群达到8000台的规模,是当前已知的世界上最大的Spark集群。

- 概念:Spark是统一的分布式大数据分析引擎

- 关键词:

-

-

-

大数据分析引擎:Spark能够分析数据,但是没有存储。一般线上的spark数据来源 (HDFS, Hive、Kafka、Flume、日志文件、关系型数据库、NoSQL数据库)。Spark数据出口(HDFS、Hive、Kafka、Redise、关系型数据库、NoSQL数据库)

-

分布式:Spark一般情况是以集群模式存在。架构 :Master/Slaver(主从结构)

-

-

-

精准广告推荐系统(Spark机器学习,一般在广告或者电商公司应用)

-

金融风险管控系统 (对实时性要求比较,起码毫秒级)

-

精细化运行系统 (CMS系统 、BI系统,重点:多维分析)

-

用户画像 (用户数据画像)

-

-

spark的好处

Spark是MapReduce的替代方案,而且兼容HDFS、Hive,可融入Hadoop的生态系统,以弥补MapReduce的不足。

-

Spark特点

- 速度快

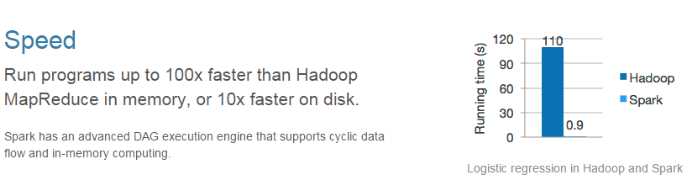

- 典型数据处理流程:Spark在使用过程中,会读取HDFS上数据,并且会将HDFS中数据驻留在内存当中,将数据进行缓存、在后续数据迭代操作过程能够重用内存中的数。在逻辑回归处理(算法)中,Spark的速度要比Hadoop 理论上快100倍

- 与Hadoop的MapReduce相比,Spark基于内存的运算要快100倍以上,基于硬盘的运算也要快10倍以上。Spark实现了高效的DAG执行引擎,可以通过基于内存来高效处理数据流。

- Spark对程序员非常友好

- spark支持多种语言(Java、Scala、Python、R、SQL)

- Spark支持Java、Python和Scala的API,还支持超过80种高级算法,使用户可以快速构建不同的应用。而且Spark支持交互式的Python和Scala的shell,可以非常方便地在这些shell中使用Spark集群来验证解决问题的方法。

- spark支持多种语言(Java、Scala、Python、R、SQL)

- Spark一站式解决方案

- 五大模块

- SparkCore (处理离线数据)

- SparkSQL (主要用来做多维数据分析、以及交互式查询)

- SparkStreaming (实时数据处理程序)

- Spark MLlib (机器学习 包含非常多算法,相当于Spark提供的一个算法)

- Spark Graphx (图计算处理模块)

- SparkCore (处理离线数据)

- 五大模块

- 速度快

- 兼容性

- Spark能够兼容 (hadoop、hive、hbase、yarn、kafka、flume、redise、关系型数据等)

- Spark可以非常方便地与其他的开源产品进行融合。比如,Spark可以使用Hadoop的YARN和Apache Mesos作为它的资源管理和调度器,器,并且可以处理所有Hadoop支持的数据,包括HDFS、HBase和Cassandra等。这对于已经部署Hadoop集群的用户特别重要,因为不需要做任何数据迁移就可以使用Spark的强大处理能力。Spark也可以不依赖于第三方的资源管理和调度器,它实现了Standalone作为其内置的资源管理和调度框架,这样进一步降低了Spark的使用门槛,使得所有人都可以非常容易地部署和使用Spark。此外,Spark还提供了在EC2上部署Standalone的Spark集群的工具。

以上是关于什么是spark?的主要内容,如果未能解决你的问题,请参考以下文章