Deeplift 论文阅读

Posted shensobaolibin

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Deeplift 论文阅读相关的知识,希望对你有一定的参考价值。

DeepLift是基于反向传播的特征打分算法

目前已有的反向传播算法或基于扰动的打分算法会遇到一个问题

就是在经过Relu激活函数的时候梯度会变为0,但是此特征不一定是无用特征。

情况如下:

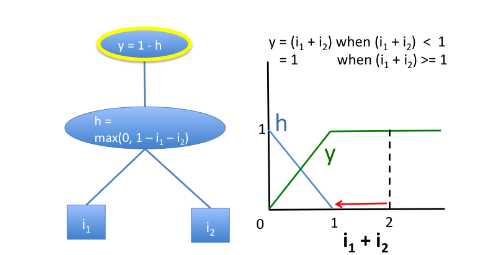

可以看见i1,i2都是有效特征,但是在i1+i2大于0的时候,他们的导数会变为0从而导致打分出错。

论文中提出了一个非常有意思的解决方案。

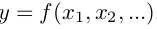

t表示此网络中我们关心的某个神经元,t0表示神经元t被激活的阈值,x1,x2,,,,xn表示要得到t必须要经过的下一层神经元。

那么detal_t = t - t0

detla_x 表示在神经元x处的激活量

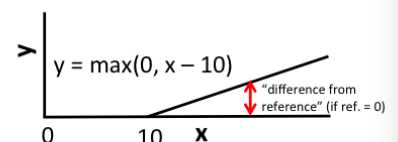

difference-from-reference =

得分表示为Cxi detla_t 此得分满足以下条件

这样的话,即使 = 0,我们的

= 0,我们的  也不为0.

也不为0.

这个也是很容易理解的。

因为偏导数就是 y的变化量/ x的变化量, 同理我的变化量也应该是c的变化量/x 的变化量

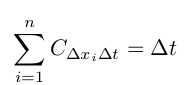

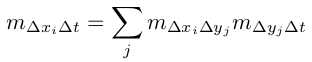

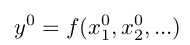

链式法则:

假设输入为xi, 隐藏层为yi, 输出为t 那么链式法则为:

也是做乘法,没啥东西

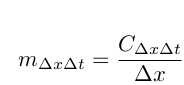

对于一些层的阈值计算:

对于函数 y的阈值可以通过如下的式子来计算。

y的阈值可以通过如下的式子来计算。

因为最后的输出层可能没有阈值,他们的阈值就要通过这种方法来计算

以上是关于Deeplift 论文阅读的主要内容,如果未能解决你的问题,请参考以下文章