Scrapyd发布爬虫的工具

Posted xiao-apple36

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Scrapyd发布爬虫的工具相关的知识,希望对你有一定的参考价值。

Scrapyd

Scrapyd是部署和运行Scrapy.spider的应用程序。它使您能够使用JSON API部署(上传)您的项目并控制其spider。

Scrapyd-client

Scrapyd-client是一个专门用来发布scrapy爬虫的工具,安装该程序之后会自动在python目录\\scripts安装一个名为scrapyd-deploy的工具

(其实打开该文件,可以发现它是一个类似setup.py的python脚本,所以可以通过python scrapyd-deploy的方式运行)

下载安装

pip install scrapyd-client pip install enum-compat pip install w3lib

pip install scrapyd

安装完成后检查

C:\\Program Files\\Python36\\Scripts>dir sc*

驱动器 C 中的卷是 BOOTCAMP

卷的序列号是 D471-4F4D

C:\\Program Files\\Python36\\Scripts 的目录

2018/05/07 21:20 98,158 scrapy.exe

2018/05/25 21:17 9,901 scrapyd-deploy

2018/05/25 20:37 98,165 scrapyd.exe

4 个文件 216,128 字节

0 个目录 39,937,785,856 可用字节

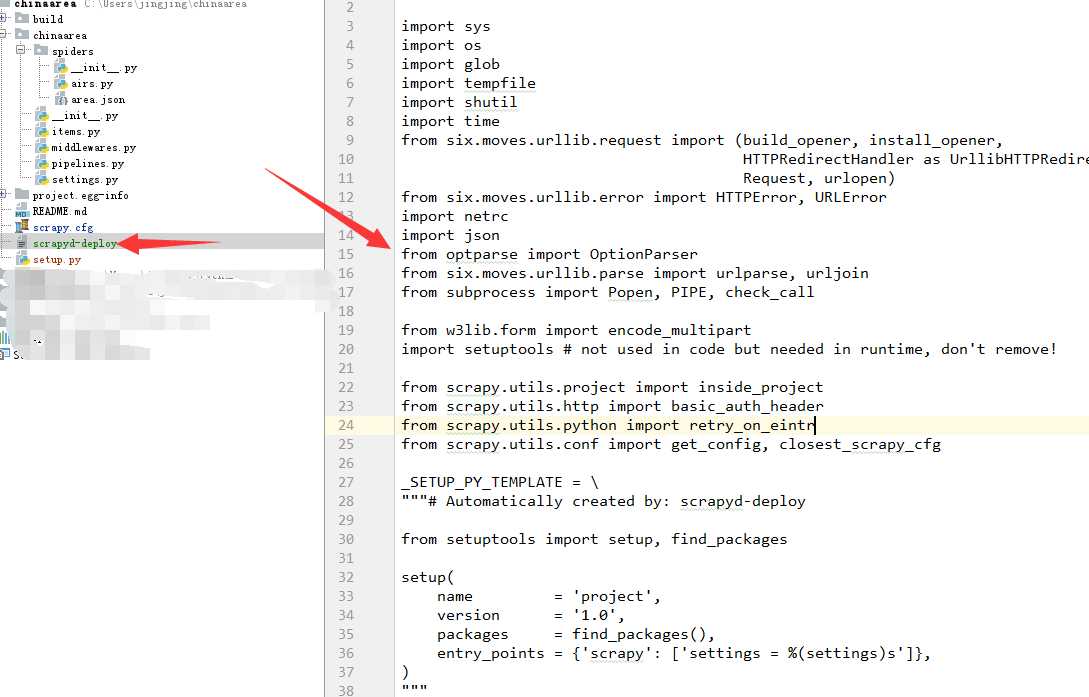

scrapyd-deploy内容

运行方法

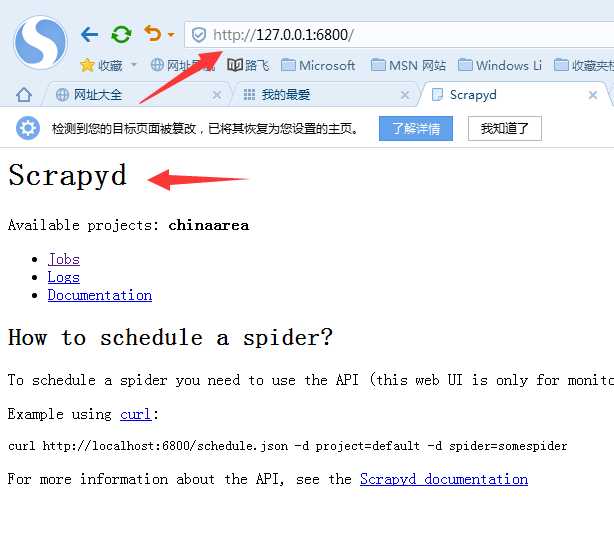

1.运行scrapyd

C:\\>scrapyd 2018-05-25T20:38:52+0800 [-] Loading c:\\program files\\python36\\lib\\site-packages \\scrapyd\\txapp.py... 2018-05-25T20:38:54+0800 [-] Scrapyd web console available at http://127.0.0.1:6 800/ 2018-05-25T20:38:54+0800 [-] Loaded. 2018-05-25T20:38:54+0800 [twisted.application.app.AppLogger#info] twistd 18.4.0 (c:\\program files\\python36\\python.exe 3.6.1) starting up. 2018-05-25T20:38:54+0800 [twisted.application.app.AppLogger#info] reactor class: twisted.internet.selectreactor.SelectReactor. 2018-05-25T20:38:54+0800 [-] Site starting on 6800 2018-05-25T20:38:54+0800 [twisted.web.server.Site#info] Starting factory <twiste d.web.server.Site object at 0x0000000004BB8DA0> 2018-05-25T20:38:54+0800 [Launcher] Scrapyd 1.2.0 started: max_proc=32, runner=‘ scrapyd.runner‘

2.拷贝scrapyd-deploy工具到爬虫目录下

C:\\chinaarea 的目录 2018/05/25 21:19 <DIR> . 2018/05/25 21:19 <DIR> .. 2018/05/24 21:23 <DIR> .idea 2018/05/25 21:19 <DIR> build 2018/05/25 21:16 <DIR> chinaarea 2018/05/25 21:19 <DIR> project.egg-info 2018/05/23 20:38 74 README.md 2018/05/25 21:02 264 scrapy.cfg 2018/05/25 20:37 9,904 scrapyd-deploy 2018/05/25 21:19 266 setup.py 4 个文件 10,508 字节 6 个目录 39,973,642,240 可用字节

3.修改爬虫的scapy.cfg文件

首先去掉url前的注释符号,这里url就是你的scrapyd服务器的网址。

其次,deploy:100表示把爬虫发布到名为100的爬虫服务器上。

这个名叫target名字可以随意起,一般情况用在需要同时发布爬虫到多个目标服务器时,可以通过指定名字的方式发布到指定服务器。

其次,default=ccpmess.settings 中 ccpmess也是可以改的,貌似没啥用,默认还是用工程名字。

关键是scrapyd-deploy 所在目录,具体其实可以读下scrapyd-deploy 的代码。

# Automatically created by: scrapy startproject # # For more information about the [deploy] section see: # https://scrapyd.readthedocs.io/en/latest/deploy.html [settings] default = chinaarea.settings [deploy:100] url = http://localhost:6800/ project = chinaarea

4.查看配置

检查scrapy配置是否正确。

$python scrapyd-deploy -l

100 http://localhost:6800/

5.发布爬虫

scrapyd-deploy <target> -p <project> --version <version>

target就是前面配置文件里deploy后面的的target名字。

project 可以随意定义,跟爬虫的工程名字无关。

version自定义版本号,不写的话默认为当前时间戳。

注意,爬虫目录下不要放无关的py文件,放无关的py文件会导致发布失败,但是当爬虫发布成功后,会在当前目录生成一个setup.py文件,可以删除掉。

C:\\chinaarea>python scrapyd-deploy 100 -p chinaarea --version ver20180525 Packing version ver20180525 Deploying to project "chinaarea" in http://localhost:6800/addversion.json Server response (200): {"node_name": "jingjing-PC", "status": "ok", "project": "chinaarea", "version": "ver20180525", "spiders": 1}

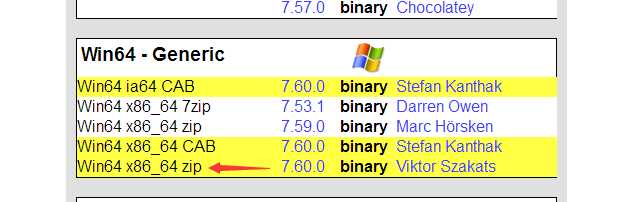

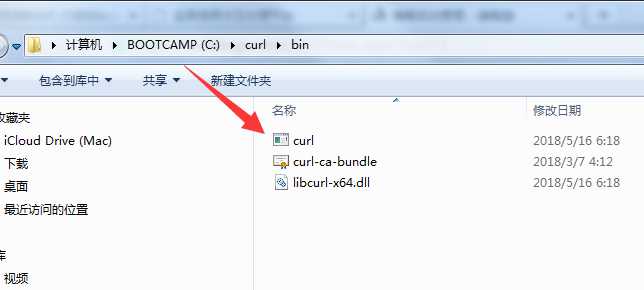

6.下载安装curl

下载地址:https://curl.haxx.se/download.html

根据电脑系统下载适合的版本

下载完成后会看到curl.exe文件

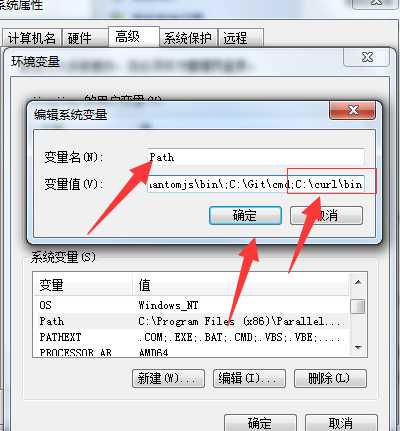

设置环境变量

测试配置

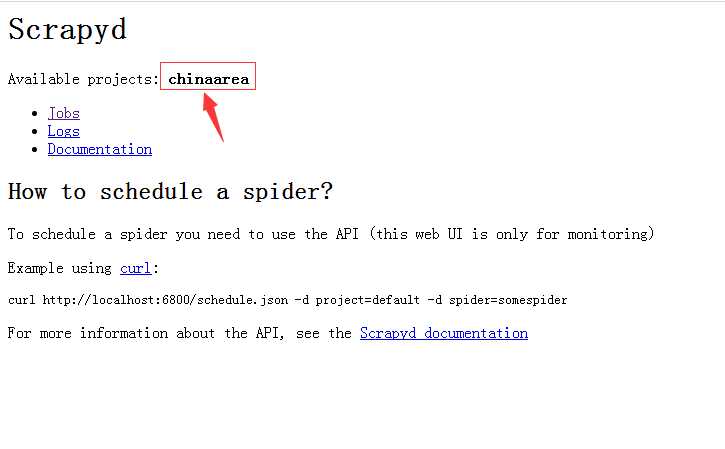

C:\\curl\\bin>curl localhost:6800 <html> <head><title>Scrapyd</title></head> <body> <h1>Scrapyd</h1> <p>Available projects: <b>chinaarea</b></p> <ul> <li><a href="/jobs">Jobs</a></li> <li><a href="/logs/">Logs</a></li>

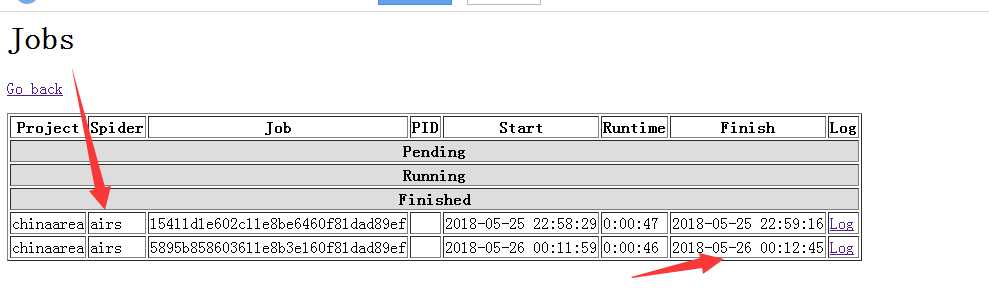

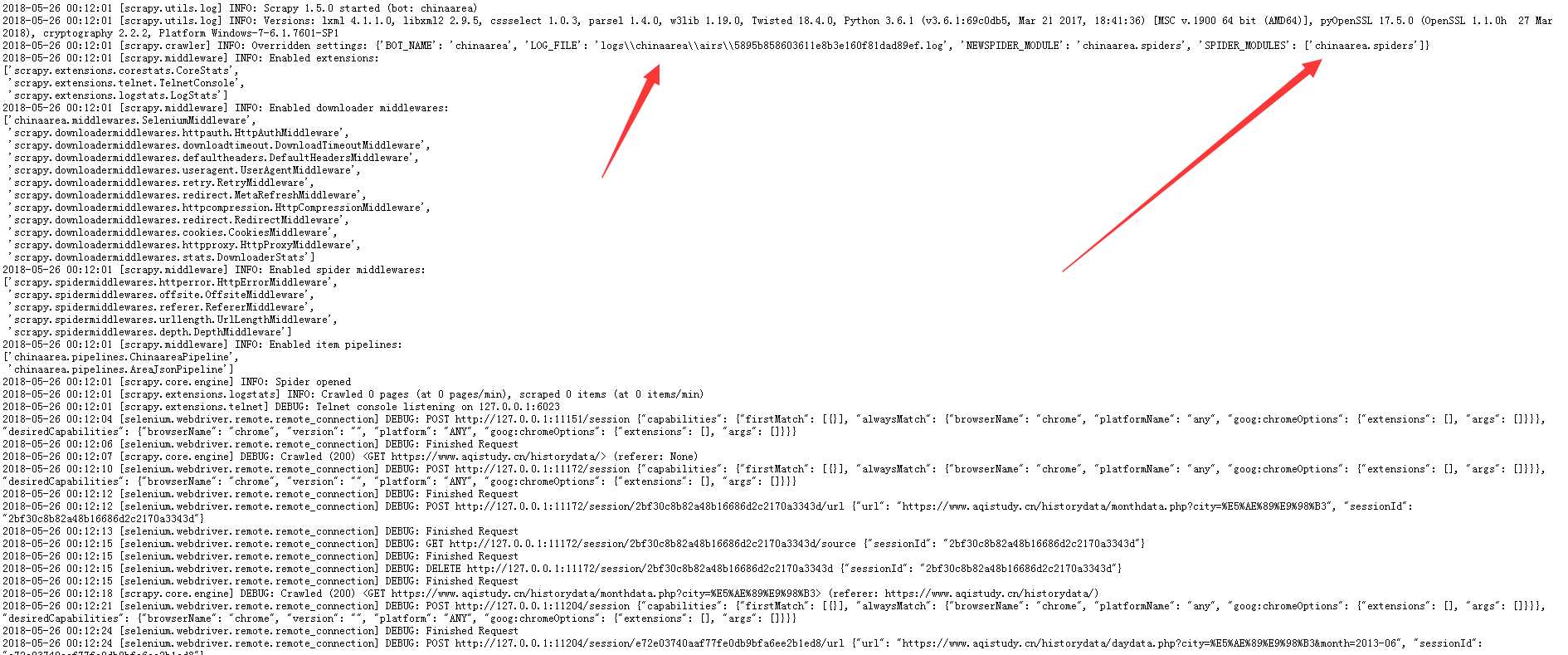

7.启动scrapyd服务器上myproject工程下的myspider爬虫

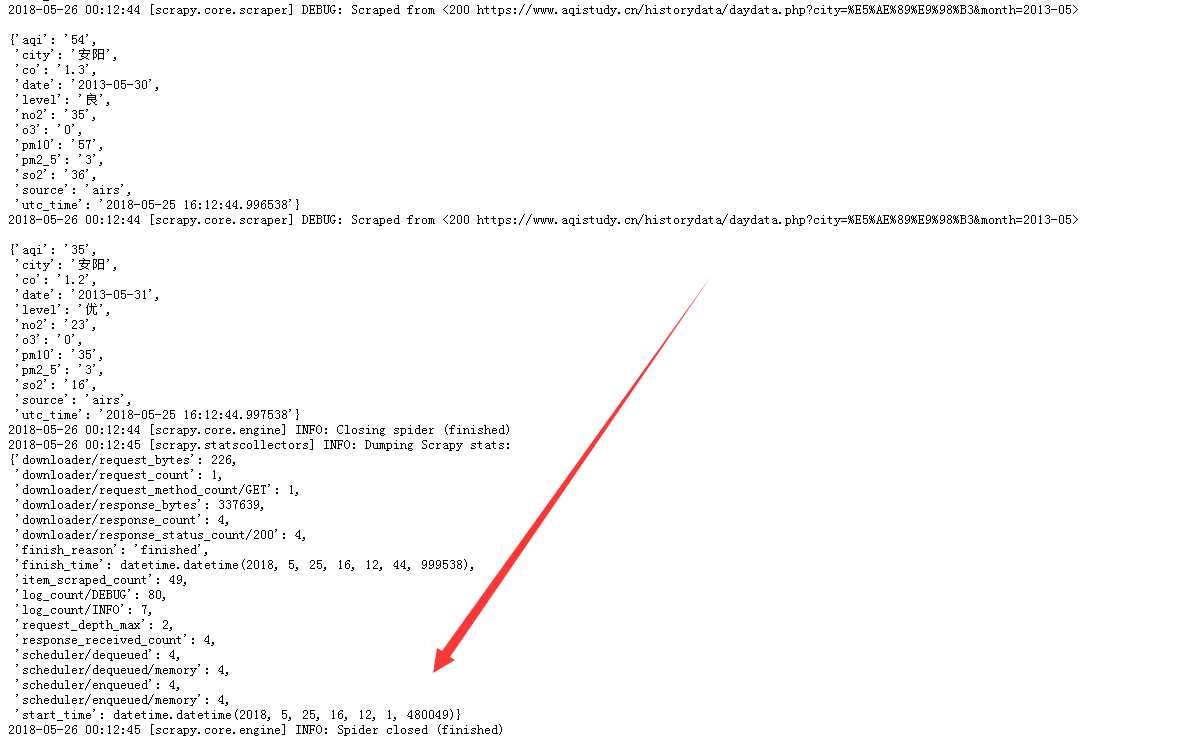

C:\\curl\\bin>curl http://localhost:6800/schedule.json -d project=chinaarea -d spider=airs {"node_name": "jingjing-PC", "status": "ok", "jobid": "5895b858603611e8b3e160f81 dad89ef"}

8.删除scrapyd服务器上myproject工程

C:\\curl\\bin>curl http://127.0.0.1:6800/delproject.json -d project=chinaarea {"node_name": "jingjing-PC", "status": "ok"}

9.其他操作API

# -*- coding: utf-8 -*- import requests import json baseUrl =‘http://127.0.0.1:6800/‘ daemUrl =‘http://127.0.0.1:6800/daemonstatus.json‘ listproUrl =‘http://127.0.0.1:6800/listprojects.json‘ listspdUrl =‘http://127.0.0.1:6800/listspiders.json?project=%s‘ listspdvUrl= ‘http://127.0.0.1:6800/listversions.json?project=%s‘ listjobUrl =‘http://127.0.0.1:6800/listjobs.json?project=%s‘ delspdvUrl= ‘http://127.0.0.1:6800/delversion.json‘ #http://127.0.0.1:6800/daemonstatus.json #查看scrapyd服务器运行状态 r= requests.get(daemUrl) print ‘1.stats :\\n %s \\n\\n‘ %r.text #http://127.0.0.1:6800/listprojects.json #获取scrapyd服务器上已经发布的工程列表 r= requests.get(listproUrl) print ‘1.1.listprojects : [%s]\\n\\n‘ %r.text if len(json.loads(r.text)["projects"])>0 : project = json.loads(r.text)["projects"][0] #http://127.0.0.1:6800/listspiders.json?project=myproject #获取scrapyd服务器上名为myproject的工程下的爬虫清单 listspd=listspd % project r= requests.get(listspdUrl) print ‘2.listspiders : [%s]\\n\\n‘ %r.text if json.loads(r.text).has_key("spiders")>0 : spider =json.loads(r.text)["spiders"][0] #http://127.0.0.1:6800/listversions.json?project=myproject ##获取scrapyd服务器上名为myproject的工程下的各爬虫的版本 listspdvUrl=listspdvUrl % project r = requests.get(listspdvUrl) print ‘3.listversions : [%s]\\n\\n‘ %rtext if len(json.loads(r.text)["versions"])>0 : version = json.loads(r.text)["versions"][0] #http://127.0.0.1:6800/listjobs.json?project=myproject #获取scrapyd服务器上的所有任务清单,包括已结束,正在运行的,准备启动的。 listjobUrl=listjobUrl % proName r=requests.get(listjobUrl) print ‘4.listjobs : [%s]\\n\\n‘ %r.text #schedule.json #http://127.0.0.1:6800/schedule.json -d project=myproject -d spider=myspider #启动scrapyd服务器上myproject工程下的myspider爬虫,使myspider立刻开始运行,注意必须以post方式 schUrl = baseurl + ‘schedule.json‘ dictdata ={ "project":project,"spider":spider} r= reqeusts.post(schUrl, json= dictdata) print ‘5.1.delversion : [%s]\\n\\n‘ %r.text #http://127.0.0.1:6800/delversion.json -d project=myproject -d version=r99‘ #删除scrapyd服务器上myproject的工程下的版本名为version的爬虫,注意必须以post方式 delverUrl = baseurl + ‘delversion.json‘ dictdata={"project":project ,"version": version } r= reqeusts.post(delverUrl, json= dictdata) print ‘6.1.delversion : [%s]\\n\\n‘ %r.text #http://127.0.0.1:6800/delproject.json -d project=myproject #删除scrapyd服务器上myproject工程,注意该命令会自动删除该工程下所有的spider,注意必须以post方式 delProUrl = baseurl + ‘delproject.json‘ dictdata={"project":project } r= reqeusts.post(delverUrl, json= dictdata) print ‘6.2.delproject : [%s]\\n\\n‘ %r.text

10.总结

1、获取状态 http://127.0.0.1:6800/daemonstatus.json 2、获取项目列表 http://127.0.0.1:6800/listprojects.json 3、获取项目下已发布的爬虫列表 http://127.0.0.1:6800/listspiders.json?project=myproject 4、获取项目下已发布的爬虫版本列表 http://127.0.0.1:6800/listversions.json?project=myproject 5、获取爬虫运行状态 http://127.0.0.1:6800/listjobs.json?project=myproject 6、启动服务器上某一爬虫(必须是已发布到服务器的爬虫) http://localhost:6800/schedule.json (post方式,data={"project":myproject,"spider":myspider}) 7、删除某一版本爬虫 http://127.0.0.1:6800/delversion.json (post方式,data={"project":myproject,"version":myversion}) 8、删除某一工程,包括该工程下的各版本爬虫 http://127.0.0.1:6800/delproject.json(post方式,data={"project":myproject})

到此,基于scrapyd的爬虫发布教程就写完了。

可能有人会说,我直接用scrapy cwal 命令也可以执行爬虫,个人理解用scrapyd服务器管理爬虫,至少有以下几个优势:

1、可以避免爬虫源码被看到。

2、有版本控制。

3、可以远程启动、停止、删除,正是因为这一点,所以scrapyd也是分布式爬虫的解决方案之一

以上是关于Scrapyd发布爬虫的工具的主要内容,如果未能解决你的问题,请参考以下文章