感知子平均算法

Posted lywangjapan

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了感知子平均算法相关的知识,希望对你有一定的参考价值。

一个很简单的感知子最基本的原理 被某书作者跳步写的离奇的不行。

感知子通过感知预测数据符号与y的相同与不同决定是否更新自己。

然而这样做的话,最后一个数据的影响过于庞大。

这时就需要将每次产生的模型乘以他的存活轮数

活得久 话语权就大嘛。

在一个常规情况下 通过训练 我们有w1 w2。。。wk这k个模型及n个数据对(x,y)

理论上来说 我们应该对每个数据对都将现存的模型w输入进累计值里方便以后求平均

但这个太浪费时间了

简单的代数即可告诉我们 假设数据点(xj,yj)产生了更新,则delta j的影响会算入下一个w,又被算入下一个w直到最后

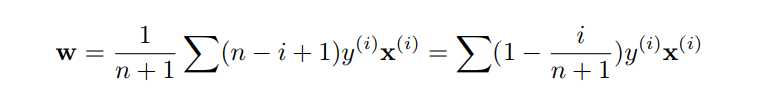

简单地说,第j个数据点的更新,都会对w产生(n-j+1)倍的影响,加1是因为j从1开始算的。

那么我们就可以将W写成对所有这些delta和对应权重的求和。

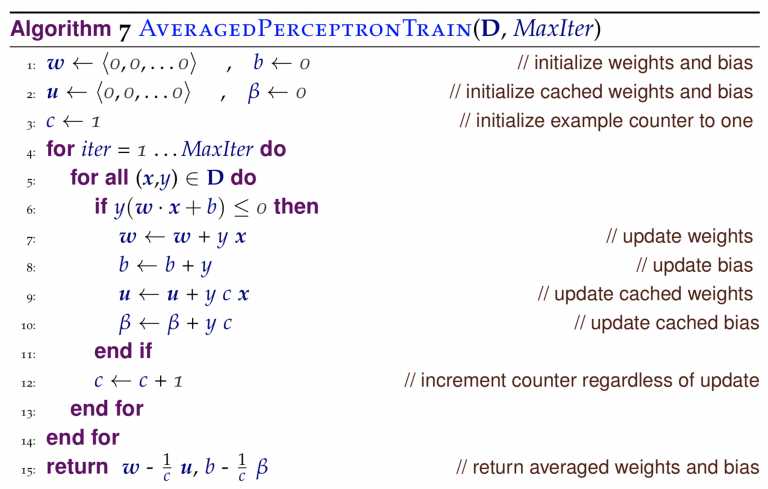

接下来再回到原作者提到的算法模型

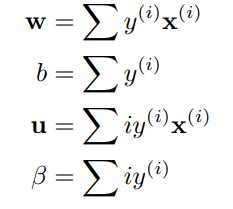

我们可以发现算法中的c 对应了上面所说的i

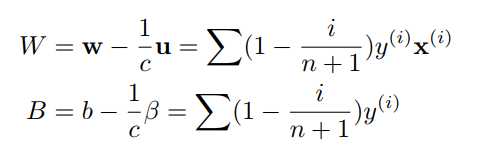

整理可得

符合之前所提出的公式。

这个算法是通过常规更新获得了常规终极w和终极b及一个看上去很不好理解的含c权重(也就是含i)的和

根据我们图1的公式,和最后的公式,只需要w以及这个和,减一减除一除,我们就能获得含权重的感知子权重w了。

也就只是优化罢了。

以上是关于感知子平均算法的主要内容,如果未能解决你的问题,请参考以下文章