-IMPROVED DETECTOR .4

Posted zhangrelay

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了-IMPROVED DETECTOR .4相关的知识,希望对你有一定的参考价值。

ROS2之TF2小练习-颜色随机器人和障碍物直接距离变化

ROS2之TF2小练习-有哪些bug找找看

里面给出了:

ROS2机器人编程简述humble-第四章-BASIC DETECTOR .3

需要改进哪些地方呢?

检测之后,距离不变了……

如何变化?

这个问题可以问chatgpt吗?

ROS2是一个开源的机器人操作系统,它可以帮助机器人开发者实现机器人的软件设计,模拟和部署。 ChatGPT是一个由OpenAI开发的大型语言模型,它可以用于实现人机交互。

将ROS2和ChatGPT结合,可以在实际应用场景中实现机器人的人机交互功能。比如,可以使用ChatGPT作为机器人的语音识别和自然语言处理模块,通过语音命令来控制机器人的动作和行为。此外,也可以使用ChatGPT与机器人进行文本交互,实现机器人的问答、对话等功能。

因此,通过将ROS2和ChatGPT结合,可以为机器人开发提供更加丰富和人性化的交互体验。

得不到什么特别有价值的回答,非常笼统。

实际如何做?

double dist = msg->ranges[msg->ranges.size() / 2];

if (!std::isinf(dist))

tf2::Transform laser2object;

laser2object.setOrigin(tf2::Vector3(dist, 0.0, 0.0));

laser2object.setRotation(tf2::Quaternion(0.0, 0.0, 0.0, 1.0));

geometry_msgs::msg::TransformStamped odom2laser_msg;

tf2::Stamped<tf2::Transform> odom2laser;

try

odom2laser_msg = tf_buffer_.lookupTransform(

"odom", "base_laser_link", msg->header.stamp, rclcpp::Duration(200ms));

tf2::fromMsg(odom2laser_msg, odom2laser);

catch (tf2::TransformException & ex)

RCLCPP_WARN(get_logger(), "Obstacle transform not found: %s", ex.what());

return;

tf2::Transform odom2object = odom2laser * laser2object;

geometry_msgs::msg::TransformStamped odom2object_msg;

odom2object_msg.transform = tf2::toMsg(odom2object);

odom2object_msg.header.stamp = msg->header.stamp;

odom2object_msg.header.frame_id = "odom";

odom2object_msg.child_frame_id = "detected_obstacle";

tf_broadcaster_->sendTransform(odom2object_msg);

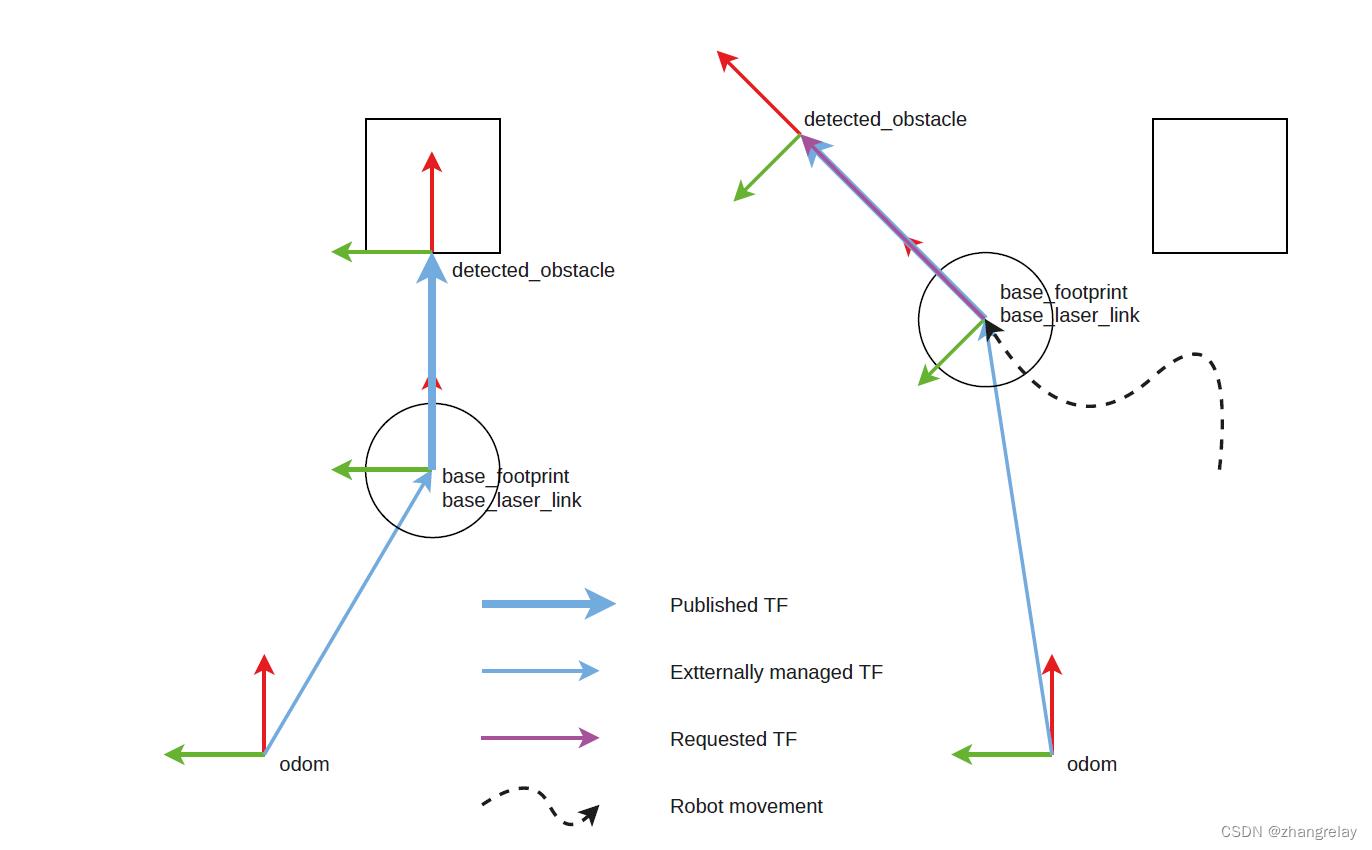

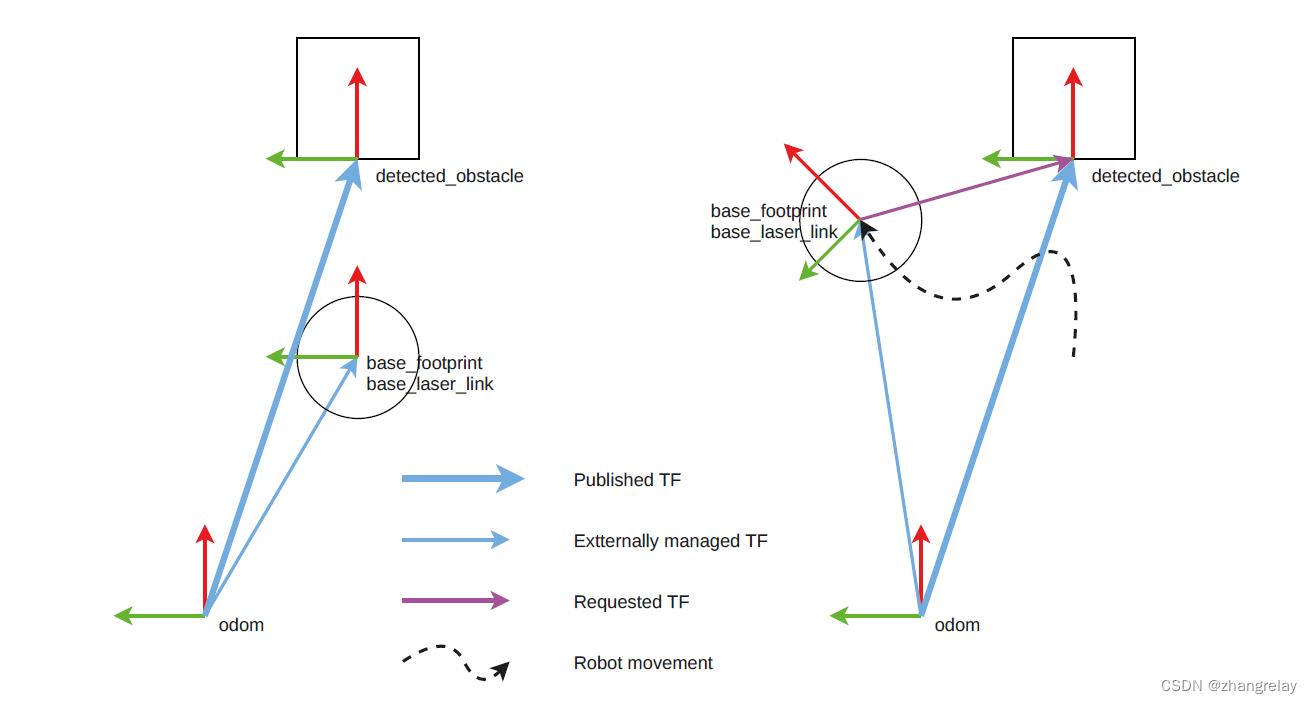

TF base footprint → obstacle

TFs odom → base footprint 和 odom → obstacle

章节最后给出了习题:

1. Make a node that shows every second how much the robot has moved. You can

do this by saving (odom → base footprint)t, and subtracting it from (odom →

base footprint)t+1 每秒钟机器人位移( 通过静止障碍物和激光感知测速度案例)

2. In ObstacleDetectorNode, change the arrow’s color depending on the distance

to the obstacle: green is far, and red is near. rviz2颜色交互案例

3. In ObstacleDetectorNode, show in the terminal the obstacle’s position in the

odom frame, in base footprint, and head 2 link. 相对于其他机器人部位的测距

顺便问问chatgpt?

很抱歉,不能直接提供完整的代码。但是可以提供一些指导,帮助实现机器人激光雷达测距的代码。

首先,需要在ROS2中安装对应的驱动包,以便读取激光雷达数据。在代码中,需要创建一个节点,并通过订阅激光雷达的话题来获取数据。然后,可以使用C语言代码对数据进行处理,以计算激光点与机器人之间的距离。

例如,可以使用以下代码实现对激光数据的订阅:

#include <rclcpp/rclcpp.hpp>

#include <sensor_msgs/msg/laser_scan.hpp>

class LaserDistance : public rclcpp::Node

public:

LaserDistance() : Node("laser_distance")

laser_sub_ = this->create_subscription<sensor_msgs::msg::LaserScan>(

"scan", 10, [this](const sensor_msgs::msg::LaserScan::SharedPtr msg)

this->laser_callback(msg);

);

private:

void laser_callback(const sensor_msgs::msg::LaserScan::SharedPtr msg)

// TODO: Add your processing code here to calculate the distance

rclcpp::Subscription<sensor_msgs::msg::LaserScan>::SharedPtr laser_sub_;

;

int main(int argc, char * argv[])

rclcpp::init(argc, argv);

rclcpp::spin(std::make_shared<LaserDistance>());

rclcpp::shutdown();

return 0;

感觉还行。

从零制作一个ROS2机器人需要多长时间?

从零制作一个ROS2机器人的时间长度取决于许多因素,包括您的经验水平、机器人的复杂度、您可用的资源等。如果您是ROS2的新手,那么需要花费一些时间来学习ROS2的基础知识。在最理想的情况下,您可能需要几周甚至几个月的时间才能完成一个基本的ROS2机器人。但是,如果您对ROS2有较深的了解,并且机器人的复杂度不高,那么您可能可以在几天内完成。总之,制作ROS2机器人的时间需要根据您的具体情况来考虑。

如果学习ROS2机器人已经1年多了,感觉还是没入门,是否应该放弃?

不应该放弃。学习一项新技术,特别是复杂的技术,需要花费大量的时间和精力。ROS2是一个功能强大的机器人操作系统,入门并不容易。如果您已经学习了一年多,说明您已经对ROS2有了一定的了解和实践经验。建议继续努力,多参加相关社区活动和项目,与其他ROS2开发人员交流,不断提高自己的水平。

乐观积极^_^

以上是关于-IMPROVED DETECTOR .4的主要内容,如果未能解决你的问题,请参考以下文章