模式识别与机器学习——4.1模式分类可分性的测度

Posted chihaoyuisnothere

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了模式识别与机器学习——4.1模式分类可分性的测度相关的知识,希望对你有一定的参考价值。

特征选择和提取

特征选择和提取是模式识别中的一个关键问题 前面讨论分类器设计的时候,一直假定已给出了特征向量维数确定的样本集,其中各样本的每一维都是该样本的一个特征; 这些特征的选择是很重要的,它强烈地影响到分类器的设计及其性能; 假若对不同的类别,这些特征的差别很大,则比较容易设计出具有较好性能的分类器。

特征选择和提取是构造模式识别系统时的一个重要课题 在很多实际问题中,往往不容易找到那些最重要的特征,或受客观条件的限制,不能对它们进行有效的测量; 因此在测量时,由于人们心理上的作用,只要条件许可总希望把特征取得多一些; 另外,由于客观上的需要,为了突出某些有用信息,抑制无用信息,有意加上一些比值、指数或对数等组合计算特征; 如果将数目很多的测量值不做分析,全部直接用作分类特征,不但耗时,而且会影响到分类的效果,产生“特征维数灾难”问题。

为了设计出效果好的分类器,通常需要对原始的测量值集合进行分析,经过选择或变换处理,组成有效的识别特征; 在保证一定分类精度的前提下,减少特征维数,即进行“降维”处理,使分类器实现快速、准确和高效的分类。 为达到上述目的,关键是所提供的识别特征应具有很好的可分性,使分类器容易判别。为此,需对特征进行选择。 应去掉模棱两可、不易判别的特征; 所提供的特征不要重复,即去掉那些相关性强且没有增加更多分类信息的特征。

说明:

实际上,特征选择和提取这一任务应在设计分类器之前进行; 从通常的模式识别教学经验看,在讨论分类器设计之后讲述特征选择和提取,更有利于加深对该问题的理解。

特征选择:

就是从n个度量值集合{x1, x2,…, xn}中,按某一准则选取出供分类用的子集,作为降维(m维,m<n)的分类特征; 所谓特征提取,就是使(x1, x2,…, xn)通过某种变换,产生m个特征(y1, y2,…, ym) (m<n) ,作为新的分类特征(或称为二次特征); 其目的都是为了在尽可能保留识别信息的前提下,降低特征空间的维数,已达到有效的分类。

以细胞自动识别为例:

通过图像输入得到一批包括正常细胞和异常细胞的图像,我们的任务是根据这些图像区分哪些细胞是正常的,哪些细胞是异常的; 首先找出一组能代表细胞性质的特征,为此可计算 细胞总面积 总光密度 胞核面积 核浆比 细胞形状 核内纹理 ……

这样产生出来的原始特征可能很多(几十甚至几百个),或者说原始特征空间维数很高,需要降低(或称压缩)维数以便分类; 一种方式是从原始特征中挑选出一些最有代表性的特征,称之为特征选择; 另一种方式是用映射(或称变换)的方法把原始特征变换为较少的特征,称之为特征提取。

4.1 模式类别可分性的测度

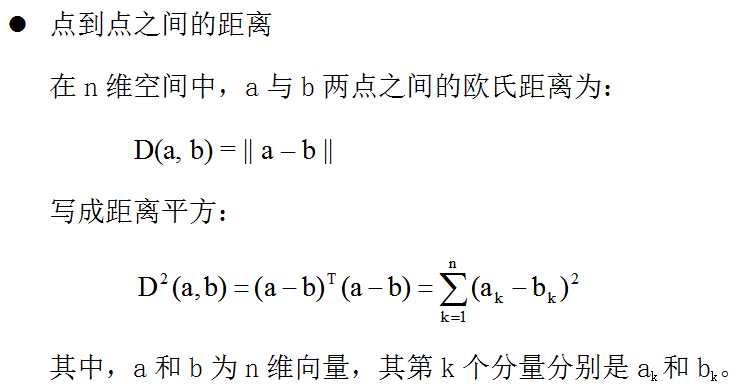

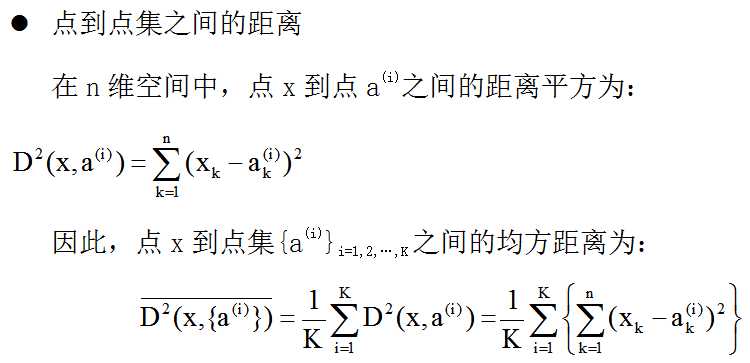

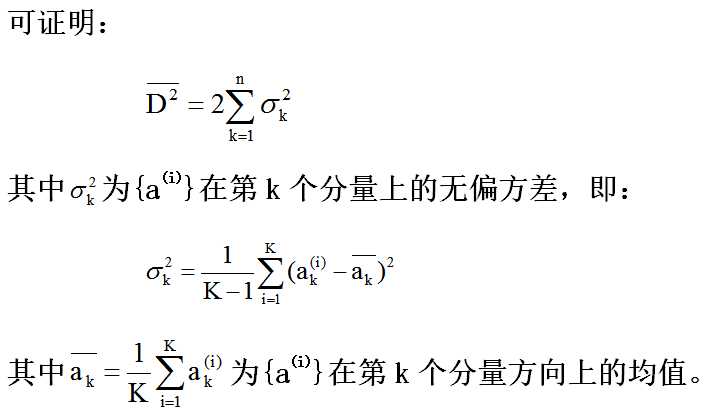

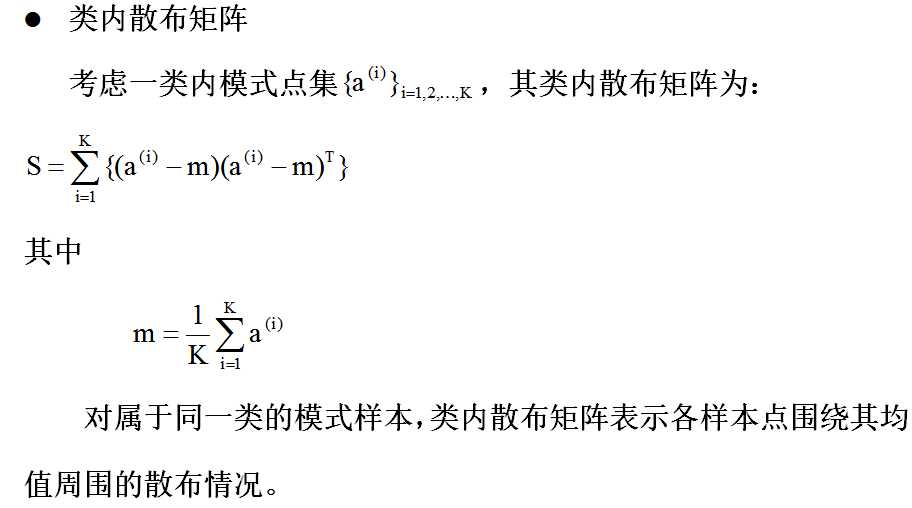

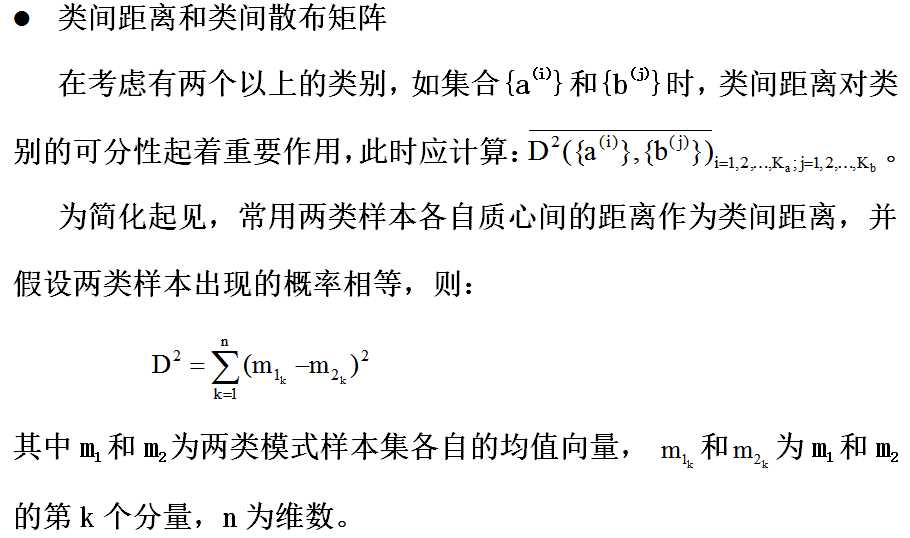

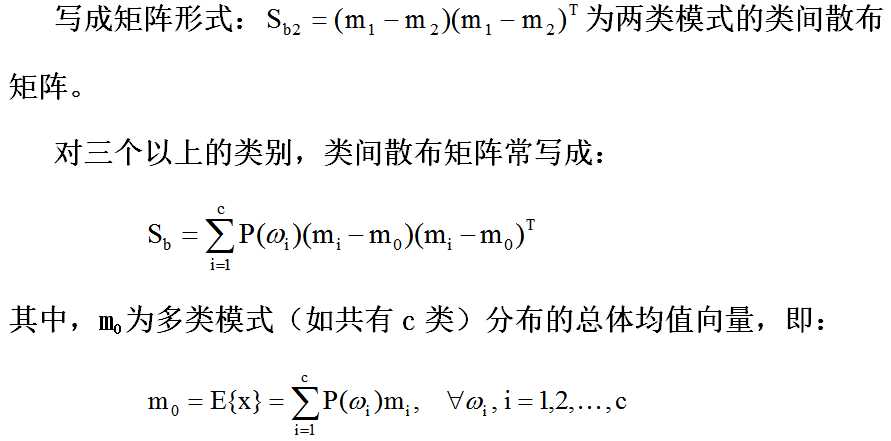

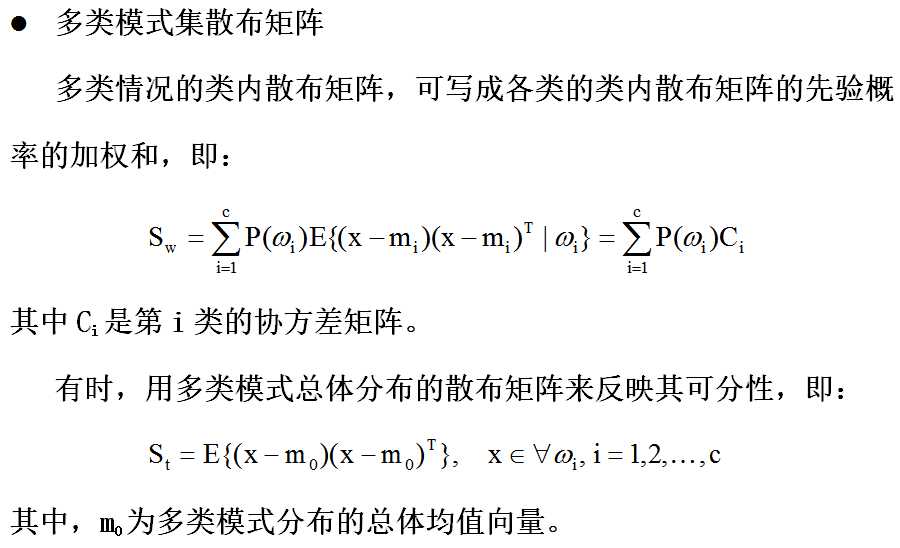

(1)距离和散布矩阵

知识储备:

以上是关于模式识别与机器学习——4.1模式分类可分性的测度的主要内容,如果未能解决你的问题,请参考以下文章