Spark Streaming的工作机制

Posted sevenyang

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Spark Streaming的工作机制相关的知识,希望对你有一定的参考价值。

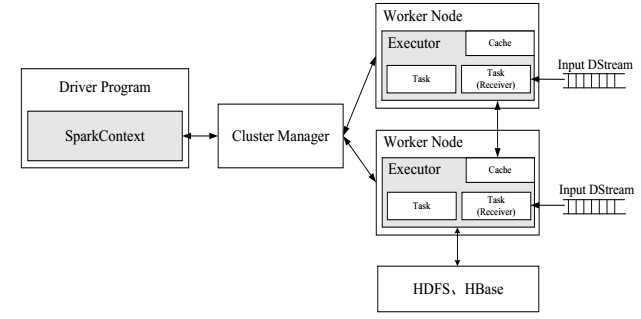

1. Spark Streaming的工作机制

Spark Streaming 是Spark核心API的一个扩展,可以实现高吞吐量的、具备容错机制的实时流数据的处理。

支持从多种数据源获取数据,包括Kafk、Flume、Twitter、ZeroMQ、Kinesis 以及TCP sockets,

从数据源获取数据之后,可以使用诸如map、reduce、join和window等高级函数进行复杂算法的处理。

最后还可以将处理结果存储到文件系统,数据库和现场仪表盘。

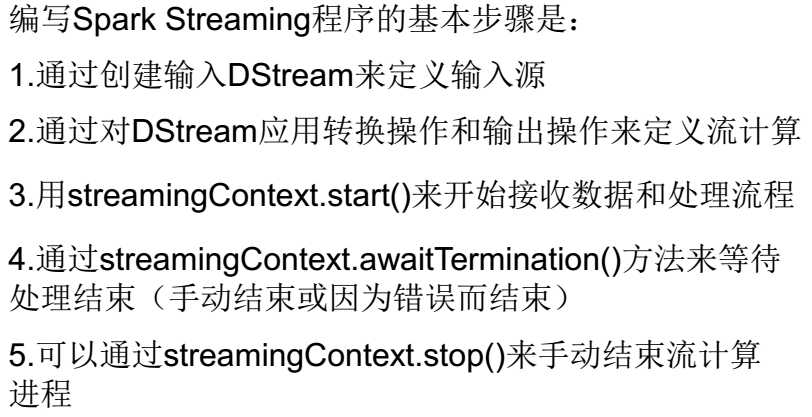

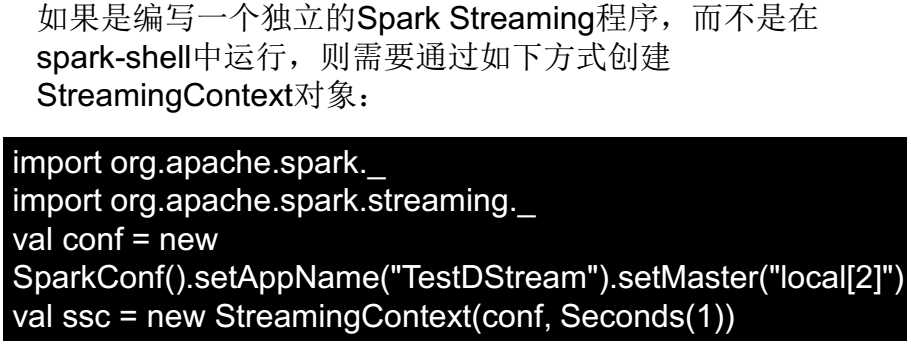

2.编写Spark Streaming程序的基本步骤:

以上是关于Spark Streaming的工作机制的主要内容,如果未能解决你的问题,请参考以下文章

面试题:Flink反压机制及与Spark Streaming的区别

面试题:Flink反压机制及与Spark Streaming的区别