Spark on YARN

Posted zimo-jing

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Spark on YARN相关的知识,希望对你有一定的参考价值。

Spark on YARN

YARN概述

YARN是什么

Apache Hadoop YARN(Yet Another Resource Negotiator,另一种资源协调者)是一种新的 Hadoop 资源管理器,它是一个通用资源管理系统,可为上层应用提供统一的资源管理和调度,它的引入为集群在利用率、资源统一管理和数据共享等方面带来了巨大好处。

YARN在Hadoop生态系统中的位置

YARN产生的背景

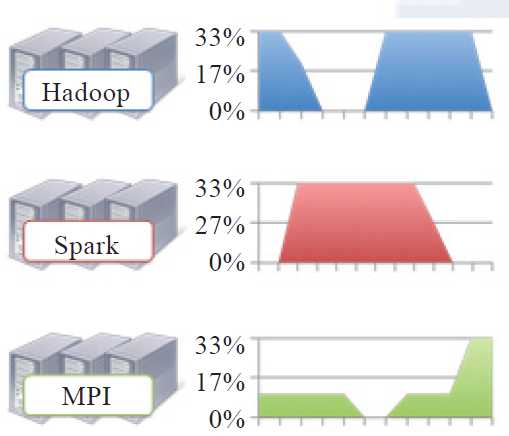

随着互联网高速发展导致数据量剧增,MapReduce 这种基于磁盘的离线计算框架已经不能满足应用要求,从而出现了一些新的计算框架以应对各种场景,包括内存计算框架、流式计算框架和迭代式计算框架等,而MRv1 不能支持多种计算框架并存。

YARN基本架构

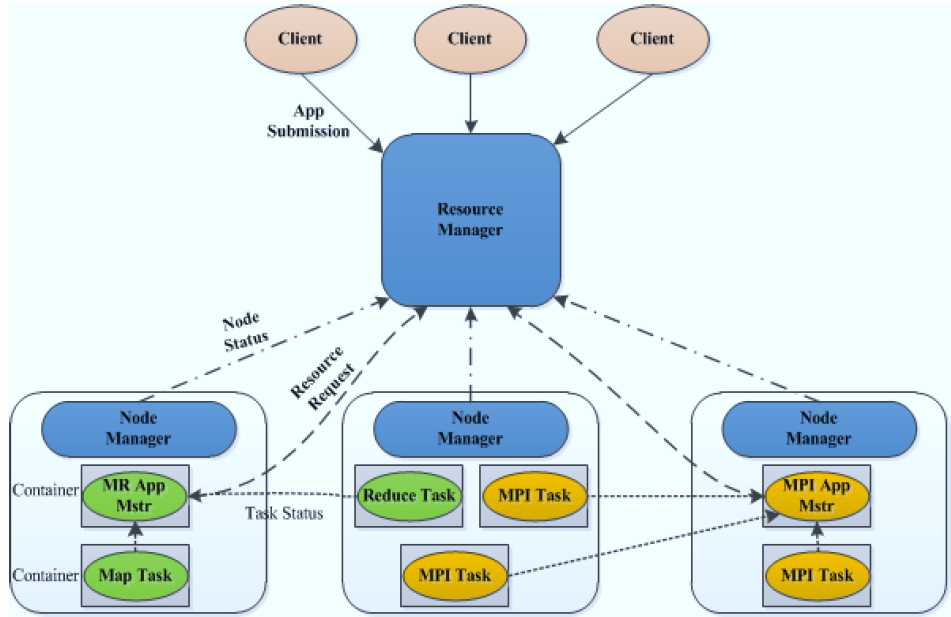

ResourceManager(RM)

ResourceManager负责集群资源的统一管理和调度,承担了 JobTracker 的角色,整个集群只有“一个”,总的来说,RM有以下作用:

- 1.处理客户端请求

- 2.启动或监控ApplicationMaster

- 3.监控NodeManager

- 4.资源的分配与调度

NodeManager(NM)

NodeManager管理YARN集群中的每个节点。NodeManager 提供针对集群中每个节点的服务,从监督对一个容器的终生管理到监视资源和跟踪节点健康。MRv1 通过slot管理 Map 和 Reduce 任务的执行,而 NodeManager 管理抽象容器,这些容器代表着可供一个特定应用程序使用的针对每个节点的资源。NM有以下作用

- 1.管理单个节点上的资源

- 2.处理来自ResourceManager的命令

- 3.处理来自ApplicationMaster的命令

ApplicationMaster(AM)

每个应用有一个,负责应用程序的管理 。ApplicationMaster 负责协调来自 ResourceManager 的资源,并通过 NodeManager 监视容器的执行和资源使用(CPU、内存等的资源分配)。请注意,尽管目前的资源更加传统(CPU 核心、内存),但未来会支持新资源类型(比如图形处理单元或专用处理设备)。AM有以下作用:

- 1.负责数据的切分

- 2.为应用程序申请资源并分配给内部的任务

- 3.任务的监控与容错

Container

Container 是 YARN 中的资源抽象,它封装了某个节点上的多维度资源,如内存、CPU、磁盘、网络等,当AM向RM申请资源时,RM为AM返回的资源便是用Container表示的。YARN会为每个任务分配一个Container,且该任务只能使用该Container中描述的资源。Container有以下作用:

- 对任务运行环境进行抽象,封装CPU、内存等多维度的资源以及环境变量、启动命令等任务运行相关的信息

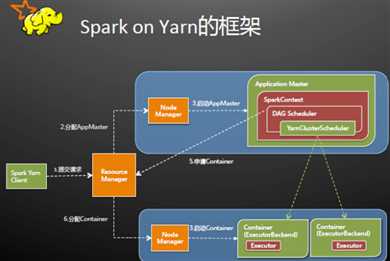

Spark on YARN运行架构解析

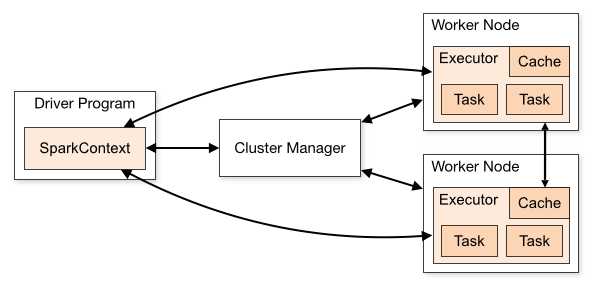

回顾Spark基本工作流程

以SparkContext为程序运行的总入口,在SparkContext的初始化过程中,Spark会分别创建DAGScheduler作业调度和TaskScheduler任务调度两级调度模块。其中作业调度模块是基于任务阶段的高层调度模块,它为每个Spark作业计算具有依赖关系的多个调度阶段(通常根据shuffle来划分),然后为每个阶段构建出一组具体的任务(通常会考虑数据的本地性等),然后以TaskSets(任务组)的形式提交给任务调度模块来具体执行。而任务调度模块则负责具体启动任务、监控和汇报任务运行情况。

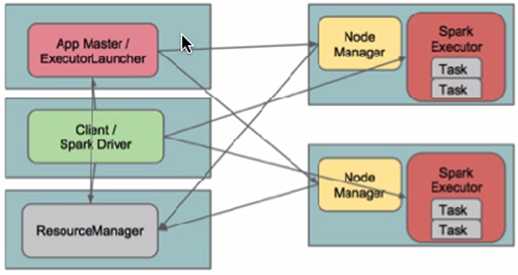

YARN standalone/YARN cluster

- YARN standalone是0.9及之前版本的叫法,1.0开始更名为YARN cluster

- yarn-cluster(YarnClusterScheduler)

- Driver和AM运行在起,Client单独的

- ./bin/spark-submit --class path.to.your.Class --master yarn --deploy-mode cluster [options] [app options]

YARN standalone/YARN cluster

Spark Driver首选作为一个ApplicationMaster在Yarn集群中启动,客户端提交给ResourceManager的每一个job都会在集群的worker节点上分配一个唯一的ApplicationMaster,由该ApplicationMaster管理全生命周期的应用。因为Driver程序在YARN中运行,所以事先不用启动Spark Master/Client,应用的运行结果不能再客户端显示(可以在history server中查看)

YARN standalone/YARN cluster

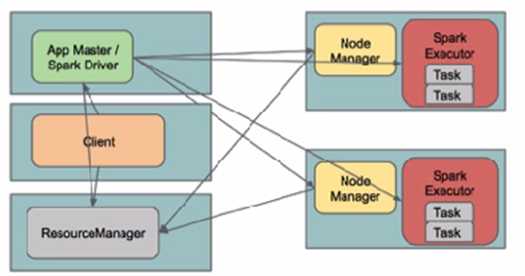

YARN client

- yarn-client(YarnClientClusterScheduler)

- Client和Driver运行在一起(运行在本地),AM只用来管理资源

- ./bin/spark-submit --class path.to.your.Class --master yarn --deploy-mode client [options] [app options]

YARN client

在Yarn-client模式下,Driver运行在Client上,通过ApplicationMaster向RM获取资源。本地Driver负责与所有的executor container进行交互,并将最后的结果汇总。结束掉终端,相当于kill掉这个spark应用。一般来说,如果运行的结果仅仅返回到terminal上时需要配置这个。

如何选择

- 如果需要返回数据到client就用YARN client模式

- 数据存储到hdfs的建议用YARN cluster模式

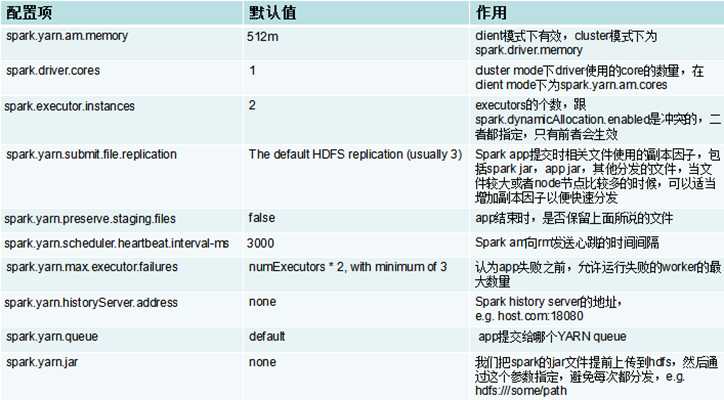

其他配置和注意事项

如何更改默认配置

- spark_home/conf/spark-defaults.conf,每个app提交时都会使用他里面的配置

- --conf PROP=VALUE,为单独的app指定个性化参数

环境变量

- spark_home/conf/spark-defaults.conf,每个app提交时都会使用他里面的配置

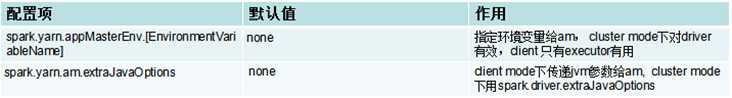

- spark.yarn.appMasterEnv.[EnvironmentVariableName]

相关配置

特别注意

- 在cluster mode下,yarn.nodemanager.local-dirs对?Spark executors 和Spark driver都管用, spark.local.dir将被忽略

- 在client mode下, Spark executors 使用yarn.nodemanager.local-dirs, Spark driver使用spark.local.dir

- --files and –archives支持用#映射到hdfs

- --jars

以上就是博主为大家介绍的这一板块的主要内容,这都是博主自己的学习过程,希望能给大家带来一定的指导作用,有用的还望大家点个支持,如果对你没用也望包涵,有错误烦请指出。如有期待可关注博主以第一时间获取更新哦,谢谢!同时也欢迎转载,但必须在博文明显位置标注原文地址,解释权归博主所有!

以上是关于Spark on YARN的主要内容,如果未能解决你的问题,请参考以下文章

黑猴子的家:Spark on hive 与 hive on spark 的区别