深度卷积网络原理—实例讲解梯度下降法参数更新过程

Posted wangyong

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了深度卷积网络原理—实例讲解梯度下降法参数更新过程相关的知识,希望对你有一定的参考价值。

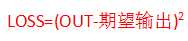

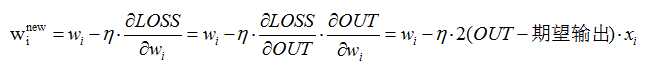

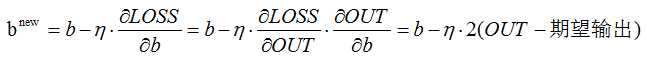

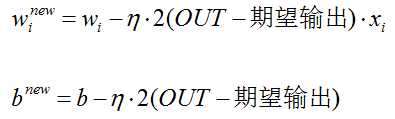

首先,先回顾梯度下降公式:(下面利用均方差MSE损失来进行演示)

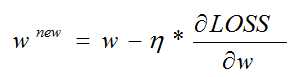

梯度下降的训练公式:

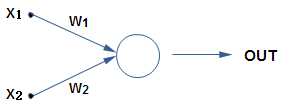

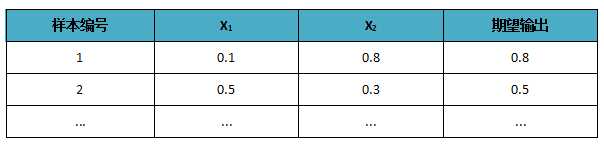

接下来,按照上面的公式进行求最大值的案例讲解

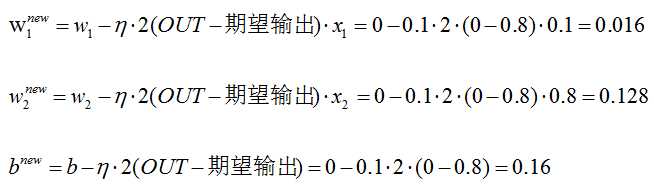

令,学习速率![]() 为0.1,初始化参数w1=0,w2=0,b=0

为0.1,初始化参数w1=0,w2=0,b=0

样本一:x1=0.1,x2=0.8

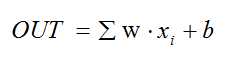

输出:

OUT=w1x1 + w2x2 + b =0*0.1 + 0*0.8 + 0 = 0

期望输出=0.8

损失:

LOSS=(OUT-期望输出)2=(0 - 0.8)2=0.64

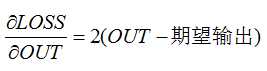

回顾此前的公式:

因此,新的权重:

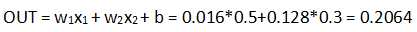

继续看下一组样本:

输入:x1=0.5,x2=0.3

输出:

期望输出=0.5

损失:

LOSS=(OUT-期望输出)2 = (0.2064-0.5)2 = 0.0862

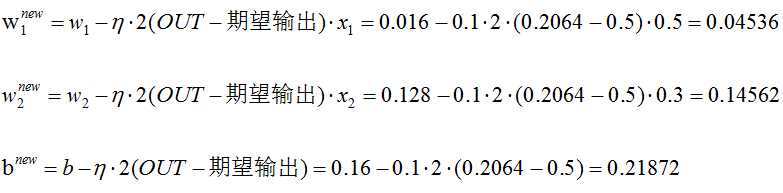

得到新权重:

训练几百个样本后,参数w1=0.5,w2=0.5,b=0.166667

以上是关于深度卷积网络原理—实例讲解梯度下降法参数更新过程的主要内容,如果未能解决你的问题,请参考以下文章