模型压缩95%:Lite Transformer,MIT韩松等人

Posted wujianming-110117

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了模型压缩95%:Lite Transformer,MIT韩松等人相关的知识,希望对你有一定的参考价值。

模型压缩95%:Lite Transformer,MIT韩松等人

Lite Transformer with Long-Short Range Attention

Zhanghao Wu, Zhijian Liu, Ji Lin, Yujun Lin, Song Han

- 论文地址:https://arxiv.org/abs/2004.11886v1

- GitHub 地址:https://github.com/mit-han-lab/lite-transformer

摘要

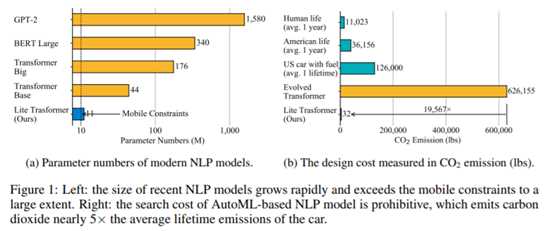

Transformer在自然语言处理(如机器翻译、问答等)中已经非常普遍,但是它需要大量的计算才能达到较高的性能,这使得它不适合于硬件资源和电池的严格限制下的移动应用。本文提出了一种高效的移动NLP架构Lite Transformer,以便于在边缘设备上部署移动NLP应用。关键原语是长-短距离注意(LSRA),其中一组负责人专门研究局部上下文建模(通过卷积),另一组负责人专门研究长距离关系建模(通过注意)。这种专业化在三个公认的语言任务(机器翻译、抽象摘要和语言建模)上比普通的转换程序带来了一致的改进。在资源受限(500米/100米MACs)的情况下,Lite Transformer的性能分别比WMT的14英法文高1.2/1.7 BLEU。Lite-Transformer在BLEU评分下降0.3的情况下,将变压器基础模型的计算量减少了2.5x。结合剪枝和量化,进一步压缩了Lite-Transformer的模型尺寸18.2x,在语言建模方面,Lite-Transformer在500M左右的MACs下比Transformer的复杂度降低了1.8。值得注意的是,Lite Transformer比基于AutoML的演进Transformer在移动NLP设置上的BLEU高0.5,而无需花费超过250 GPU年的昂贵架构搜索。

Transformer 的高性能依赖于极高的算力,这让移动端 NLP 严重受限。在不久之前的 ICLR 2020 论文中,MIT 与上海交大的研究人员提出了一种高效的移动端 NLP 架构 Lite Transformer,向在边缘设备上部署移动级 NLP 应用迈进了一大步。

虽然推出还不到 3 年,Transformer 已成为自然语言处理(NLP)领域里不可或缺的一环。然而这样流行的算法却需要极高的算力才能实现足够的性能,这对于受到算力和电池严格限制的移动端来说有些力不从心。

在 MIT 最近的研究《Lite Transformer

with Long-Short Range Attention》中,MIT

与上海交大的研究人员提出了一种高效的移动端 NLP 架构 Lite Transformer,向在边缘设备上部署移动级 NLP 应用迈进了一大步。该论文已被人工智能顶会 ICLR 2020 收录。

该研究是由 MIT 电气工程和计算机科学系助理教授韩松领导的。韩松的研究广泛涉足深度学习和计算机体系结构,他提出的 Deep Compression 模型压缩技术曾获得 ICLR2016 最佳论文,论文 ESE 稀疏神经网络推理引擎 2017 年曾获得芯片领域顶级会议——FPGA 最佳论文奖,引领了世界深度学习加速研究,对业界影响深远。

图1:左:最近NLP模型的大小增长迅速,超过了移动限制很多。右图:基于AutoML的NLP模型的搜索成本高得令人望而却步,因为它会排放碳,二氧化碳几乎是汽车寿命平均排放量的5倍。

注意机制在各种应用中得到了广泛的应用,包括1-D(language 处理(Vaswani等人,2017年)、二维(图像识别)和三维(视频识别)(Wang等人2018年)。它计算所有输入元素之间的成对点积,以对两个短期元素进行建模以及长期的关系。尽管该操作有效,但它引入了大量计算。

假设元素的数量(例如,语言处理中标记的长度、像素的数量在图像等中,输入到注意层的是N,而特征(即通道)的维数是d,则点积所需的计算是N2d。

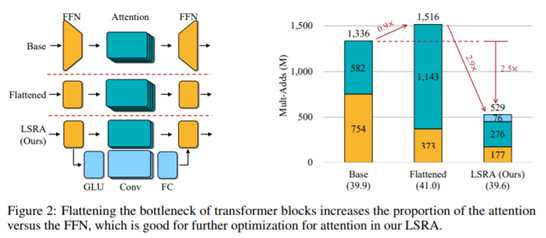

为了解决这个难题,通常的做法是首先使用注意力之前的线性投影层,然后增加尺寸(如图2所示)。在transformer的原始设计中(Vaswani等人,2017),通道尺寸注意模块比FFN层小4倍。同样,在非本地视频中,网络(Wang等人,2018),在应用非本地注意模块。这种做法节省了16×或4×的计算量。然而,它也减少了语境对特征维度较小的注意层的捕获能力。情况可能更糟的是语言处理,因为注意力是获取上下文的主要模块(不像卷积进行图像和视频的主要信息捕获)。

Transformer 在自然语言处理任务(如机器翻译、问答)中应用广泛,但它需要大量计算去实现高性能,而这不适合受限于硬件资源和电池严格限制的移动应用。

这项研究提出了一种高效的移动端 NLP 架构——Lite

Transformer,它有助于在边缘设备上部署移动 NLP 应用。其核心是长短距离注意力(Long-Short Range Attention,LSRA),其中一组注意力头(通过卷积)负责局部上下文建模,而另一组则(依靠注意力)执行长距离关系建模。

这样的专门化配置使得模型在三个语言任务上都比原版 transformer 有所提升,这三个任务分别是机器翻译、文本摘要和语言建模。

在资源有限的情况下(500M/100M MACs),Lite

Transformer 在 WMT’14 英法数据集上的

BLEU 值比分别比 transformer 高

1.2/1.7。Lite Transformer 比

transformer base 模型的计算量减少了 60%,而 BLEU 分数却只降低了 0.3。结合剪枝和量化技术,研究者进一步将 Lite Transformer 模型的大小压缩到原来的 5%。

对于语言建模任务,在大约 500M MACs 上,Lite

Transformer 比 transformer 的困惑度低

1.8。

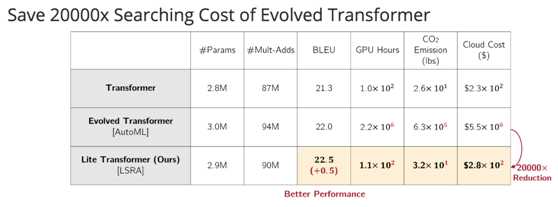

值得注意的是,对于移动 NLP 设置,Lite Transformer 的 BLEU 值比基于 AutoML 的 Evolved Transformer 高 0.5,而且它不需要使用成本高昂的架构搜索。

从 Lite Transformer 与 Evolved Transformer、原版 transformer 的比较结果中可以看出,Lite Transformer 的性能更佳,搜索成本相比 Evolved Transformer 大大减少。

那么,Lite Transformer 为何能够实现高性能和低成本呢?接下来我们来了解其核心思想。

长短距离注意力(LSRA)

NLP 领域的研究人员试图理解被注意力捕捉到的上下文。Kovaleva 等人 (2019) 和 Clark 等人

(2020) 对 BERT 不同层的注意力权重进行了可视化。

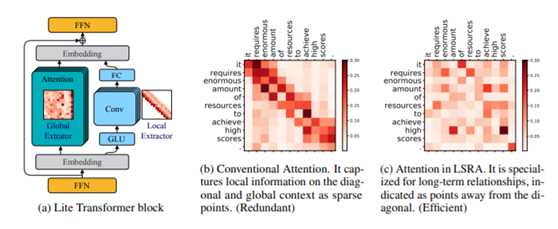

如下图 3b 所示,权重 w 表示源句单词与目标句单词之间的关系(自注意力也是如此)。随着权重 w_ij 的增加(颜色加深),源句中的第 i 个词更加注意目标句中的第 j 个词。注意力图通常有很强的模式化特征:稀疏和对角线。它们代表了一些特定单词之间的关系:稀疏表示长距离信息间的关系,对角线表示近距离信息间的关系。研究者将前者称为「全局」关系,将后者称为「局部」关系。

图 3:Lite Transformer 架构 (a) 和注意力权重的可视化。传统的注意力 (b) 过于强调局部关系建模(参见对角线结构)。该研究使用卷积层专门处理局部特征提取工作,以高效建模局部信息,从而使注意力分支可以专门进行全局特征提取 (c)。

在翻译任务中,注意力模块必须捕获全局和局部上下文,这需要很大的容量。与专门化的设计相比,这并非最佳选择。以硬件设计为例,CPU 等通用硬件的效率比 FPGA 等专用硬件低。研究者认为应该分别捕捉全局和局部上下文。模型容量较大时,可以容忍冗余,甚至可以提供更好的性能。但是在移动应用上,由于计算和功率的限制,模型应该更加高效。因此,更需要专门化的上下文捕获。

为了解决该问题,该研究提出一个更专门化的架构,即长短距离注意力(LSRA),而不是使用处理 “一般” 信息的模块。该架构分别捕获局部和全局上下文。

如图 3a 所示,LSRA 模块遵循两分支设计。左侧注意力分支负责捕获全局上下文,右侧卷积分支则建模局部上下文。研究者没有将整个输入馈送到两个分支,而是将其沿通道维度分为两部分,然后由后面的 FFN 层进行混合。这种做法将整体计算量减少了 50%。

左侧分支是正常的注意力模块(Vaswani et al. (2017)),不过通道维度减少了一半。至于处理局部关系的右分支,一个自然的想法是对序列应用卷积。使用滑动窗口,模块可以轻松地覆盖对角线组。为了进一步减少计算量,研究者将普通卷积替换为轻量级的版本,该版本由线性层和深度卷积组成。通过这种方式,研究者将注意力模块和卷积模块并排放置,引导它们对句子进行全局和局部的不同角度处理,从而使架构从这种专门化设置中受益,并实现更高的效率。

实验设置

数据集和评估 研究者在机器翻译、文本摘要和语言建模三个任务上进行了实验和评估。

具体而言,机器翻译任务使用了三个基准数据集:IWSLT’14 德语 - 英语 (De-En)、WMT 英语 - 德语 (En-De)、WMT 英语 - 法语(En-Fr)。

文本摘要任务使用的是 CNN-DailyMail 数据集。

语言建模任务则在 WIKITEXT-103 数据集上进行。

架构

模型架构是基于序列到序列学习的编码器 - 解码器。在机器翻译任务中,针对 WMT 数据集,基线模型基于 Vaswani 等人提出的模型。对于 IWSLT 数据集,基线模型遵循 Wu 等人的设置。对于文本摘要任务,研究者采用了与 WMT 相同的模型。至于语言建模任务,模型与 Baevski & Auli

(2019) 一致,但模型尺寸较小。

该研究提出的架构首先将 transformer base 模型中的 bottleneck 拉平,然后用 LSRA 替换自注意力。更具体地说,是使用两个专门的模块,一个注意力分支和一个卷积分支。

实验结果

机器翻译

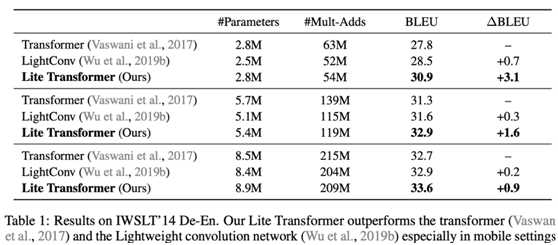

表 1 展示了 Lite Transformer 在 IWSLT’14 De-En 数据集上的定量结果,并与 transformer 基线方法和 LightConv 做了对比。在大约 100M Mult-Adds 时,Lite Transformer 模型的 BLEU 值比 transformer 高出 1.6。

表 1:IWSLT’14 De-En 上的结果。

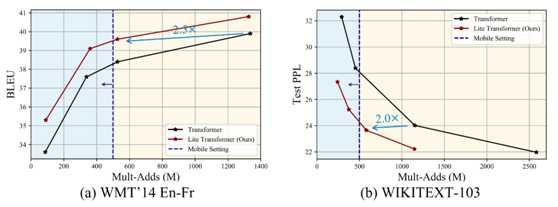

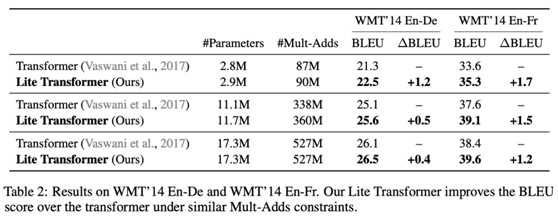

表 2 中的定量结果表明,在 100M Mult-Adds 设置下,Lite Transformer 在 WMT En-De 数据集和 WMT En-Fr 数据集上的 BLEU 值分别比 Transformer 高出 1.2 和 1.7,在 300M Mult-Adds 设置下,也有 0.5 和 1.5 分的提升。

表 2:在 WMT’14 En-De 和 WMT’14 En-Fr 上的结果。

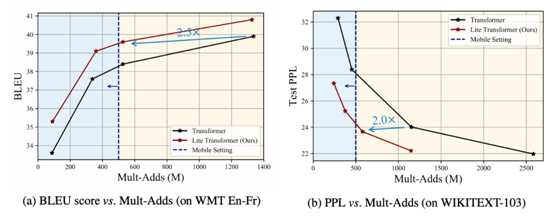

研究者还提供了模型在 WMT En-Fr 上的权衡曲线,如图 4a 所示,Lite Transformer 一直优于原版 transformer。

图 4:在 WMT En-Fr 数据集上的机器翻译权衡曲线,以及在 WIKITEXT-103 数据集上的语言建模权衡曲线。两个曲线都说明了在移动设置下,Lite Transformer 比 transformer 性能更佳(蓝色区域)。

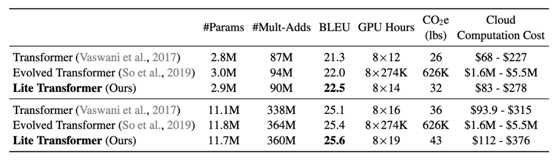

与自动化设计模型的对比

与基于 AutoML 的 Evolved Transformer(ET)相比,Lite Transformer 在移动设置中也有明显的改进。此外,在 100M 和 300M 的

Mult-Adds 下,Lite Transformer 的

BLEU 值分别比 ET 高 0.5 和 0.2,详见表 3。

表 3:不同 NMT 模型的性能和训练成本。

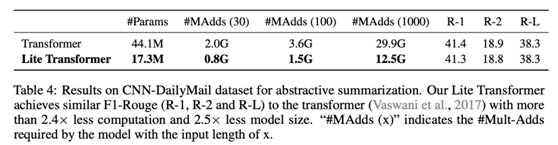

文本摘要

表 4:在 CNN-DailyMail 数据集上的文本摘要结果。

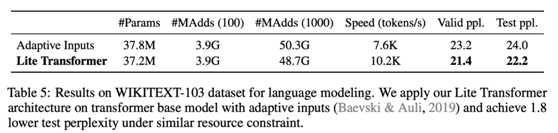

表 5:在 WIKITEXT-103 数据集上的语言建模结果。

以上是关于模型压缩95%:Lite Transformer,MIT韩松等人的主要内容,如果未能解决你的问题,请参考以下文章

模型压缩75%,推理速度提升20%,Paddle Lite v2.3发布

两行代码自动压缩ViT模型!模型体积减小3.9倍,推理加速7.1倍

两行代码自动压缩ViT模型!模型体积减小3.9倍,推理加速7.1倍

人工智能(Pytorch)搭建transformer模型,真正跑通transformer模型,深刻了解transformer的架构