Spark在实际项目中分配更多资源

Posted screen

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Spark在实际项目中分配更多资源相关的知识,希望对你有一定的参考价值。

Spark在实际项目中分配更多资源

性能调优概述

分配更多资源

性能调优的根本,就是增加和分配更多的资源,性能和速度上的提升,是显而易见的

基本上,在一定范围之内,增加资源与性能的提升,是成正比的

写完了一个复杂的spark作业之后,进行性能调优的时候,首先第一步,就是要来调节最优的资源配置

在这个基础之上,如果说你的spark作业,能够分配的资源达到了你的能力范围的顶端之后,无法再分配更多的资源了,公司资源有限,那么才是考虑去做后面的这些性能调优的点

性能调优问题

- 分配哪些资源?

- 在哪里分配这些资源?

- 为什么多分配了这些资源以后,性能会得到提升?

解决思路

- 分配哪些资源?

- executor、cpu per executor、memory per executor、driver memory

- 在哪里分配这些资源?

- 在我们在生产环境中,提交spark作业时,用的spark-submit shell脚本,里面调整对应的参数

/usr/local/spark/bin/spark-submit --class cn.spark.sparktest.core.WordCountCluster --num-executors 3 // 配置executor的数量

--driver-memory 100m // 配置driver的内存(影响不大)

--executor-memory 100m //配置每个executor的内存大小

--executor-cores 3 //配置每个executor的cpu core数量

/usr/local/SparkTest-0.0.1-SNAPSHOT-jar-with-dependencies.jar - 调节到多大,算是最大呢?

第一种,Spark Standalone,公司集群上,搭建了一套Spark集群,你心里应该清楚每台机器还能够给你使用的,大概有多少内存,多少cpu core;那么,设置的时候,就根据这个实际的情况,去调节每个spark作业的资源分配。比如说你的每台机器能够给你使用4G内存,2个cpu core;20台机器;executor,20;4G内存,2个cpu core,平均每个executor。

第二种,Yarn。资源队列。资源调度。应该去查看,你的spark作业,要提交到的资源队列,大概有多少资源?500G内存,100个cpu core;executor,50;10G内存,2个cpu core,平均每个executor。

一个原则,你能使用的资源有多大,就尽量去调节到最大的大小(executor的数量,几十个到上百个不等;executor内存;executor cpu core)

为什么调节了资源以后,性能可以提升?

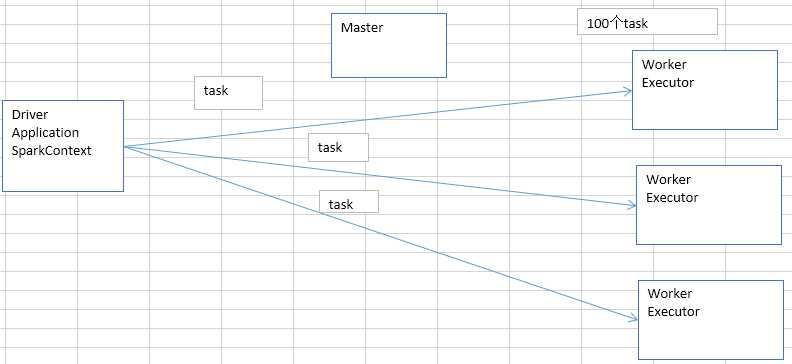

SparkContext,DAGScheduler,TaskScheduler,会将我们的算子,切割成大量的task,提交到Application的executor上面去执行。

- 增加executor:

如果executor数量比较少,那么,能够并行执行的task数量就比较少,就意味着,我们的Application的并行执行的能力就很弱。

比如有3个executor,每个executor有2个cpu core,那么同时能够并行执行的task,就是6个。6个执行完以后,再换下一批6个task。

增加了executor数量以后,那么,就意味着,能够并行执行的task数量,也就变多了。比如原先是6个,现在可能可以并行执行10个,甚至20个,100个。那么并行能力就比之前提升了数倍,数十倍。

相应的,性能(执行的速度),也能提升数倍~数十倍。

增加每个executor的内存量。增加了内存量以后,对性能的提升,有三点:

如果需要对RDD进行cache,那么更多的内存,就可以缓存更多的数据,将更少的数据写入磁盘,甚至不写入磁盘。减少了磁盘IO。

对于shuffle操作,reduce端,会需要内存来存放拉取的数据并进行聚合。如果内存不够,也会写入磁盘。如果给executor分配更多内存以后,就有更少的数据,需要写入磁盘,甚至不需要写入磁盘。减少了磁盘IO,提升了性能。

对于task的执行,可能会创建很多对象。如果内存比较小,可能会频繁导致JVM堆内存满了,然后频繁GC,垃圾回收,minor GC和full GC。(速度很慢)。内存加大以后,带来更少的GC,垃圾回收,避免了速度变慢,速度变快了。

增加每个executor的cpu core,也是增加了执行的并行能力。

原本20个executor,每个才2个cpu core。能够并行执行的task数量,就是40个task。

现在每个executor的cpu core,增加到了5个。能够并行执行的task数量,就是100个task。

执行的速度,提升了2.5倍。

以上是关于Spark在实际项目中分配更多资源的主要内容,如果未能解决你的问题,请参考以下文章