吴恩达 2.7 2.8 2.9 logistic中的梯度下降

Posted dar-

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了吴恩达 2.7 2.8 2.9 logistic中的梯度下降相关的知识,希望对你有一定的参考价值。

逻辑回归中包含了正向传播和反向传播,用一个计算图来表示其过程

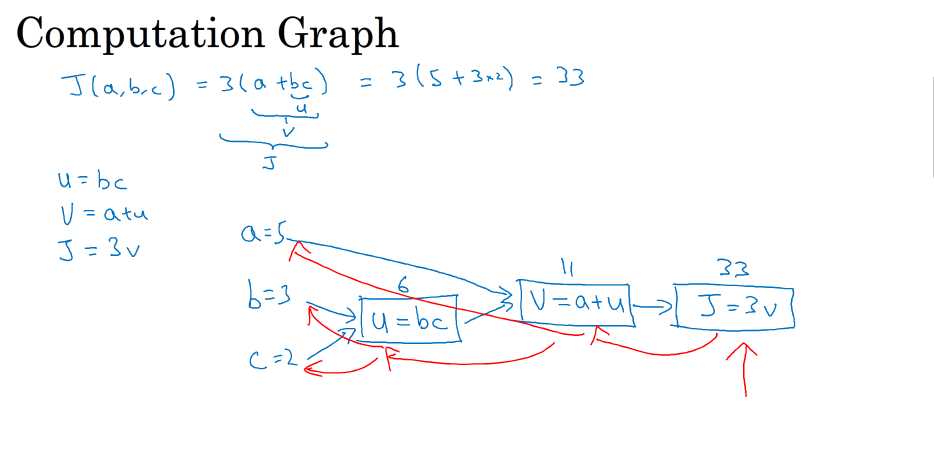

计算图:

举一个简单的例子例:

把j(a,b,c)看作logistic回归成本函数j=3(a+bc),它的计算过程为让u=bc,v=a+u 得j=3v

其中正向传播为从左到右得到成本函数的过程

反向传播为对其进行求导得到dJ/da,dJ/db,dJ/dc

现在对一个逻辑回归进行梯度计算:

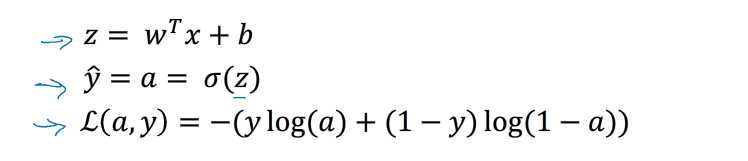

给定的逻辑回归中,Loss Function 表达式如下:

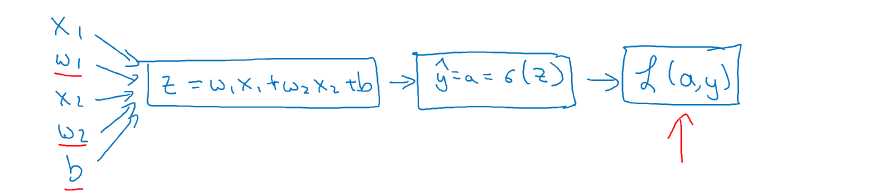

对于正向传播非常简单,假设输入样本x有两个特征值(x1,x2)则对应的w为w1,w2,则对应的最后的Loss Fuction如下:

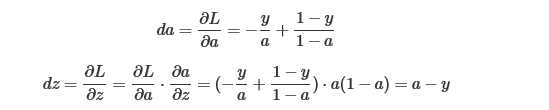

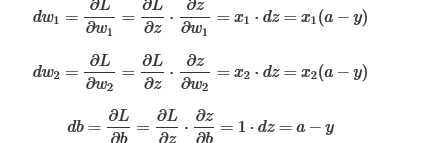

对于反向传播计算如下:

得到dz以后就可以对w1,w2进行求导了

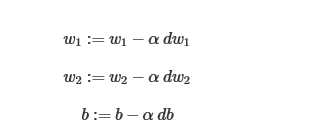

则梯度下降算法为

以上是关于吴恩达 2.7 2.8 2.9 logistic中的梯度下降的主要内容,如果未能解决你的问题,请参考以下文章