kafka消费byte数据的序列化

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了kafka消费byte数据的序列化相关的知识,希望对你有一定的参考价值。

参考技术A 之前做一个项目的时候,需要消费kafka的消息,并将它序列化为protocolbuffer类型,网上找了好久,没有找到怎么序列化,后来自己摸索了一个,记录一下。@Slf4j

public class LogModelDeserializerimplements Deserializer

private Stringencoding ="UTF8";

public LogModelDeserializer()

@Override

public void configure(Map configs,boolean isKey)

String propertyName = isKey ?"key.deserializer.encoding" :"value.deserializer.encoding";

Object encodingValue = configs.get(propertyName);

if (encodingValue ==null)

encodingValue = configs.get("deserializer.encoding");

if (encodingValueinstanceof String)

this.encoding = (String)encodingValue;

@Override

public log_model deserialize(String topic,byte[] data)

try

return data ==null ?null : log_model.parseFrom(data);//这里可以将其他的byte处理逻辑

catch (InvalidProtocolBufferException e)

log.error("Error when deserializing byte[] to log_model due to invalid protocolBuffer");

e.printStackTrace();

return null;

consumer消费程序如下,这里的key序列化为string,value则序列化为protocolbuffer类型

Properties properties =new Properties();

properties.putAll(JDQConfigUtil.getClientConfigs(USER, DOMAIN, PASS));

properties.setProperty("auto.offset.reset","latest");//latest 表示最新offset

KafkaConsumer consumer =new KafkaConsumer<>(properties,new StringDeserializer(),new LogModelDeserializer());

consumer.subscribe(Collections.singleton(TOPIC));

try

ConsumerRecords records = consumer.poll(Duration.ofSeconds(5L));

for (ConsumerRecord record : records)

String model = record.value().toString();

log.info("the key message:", model);

catch (Exception e)

log.error("数据处理错误,e=", e);

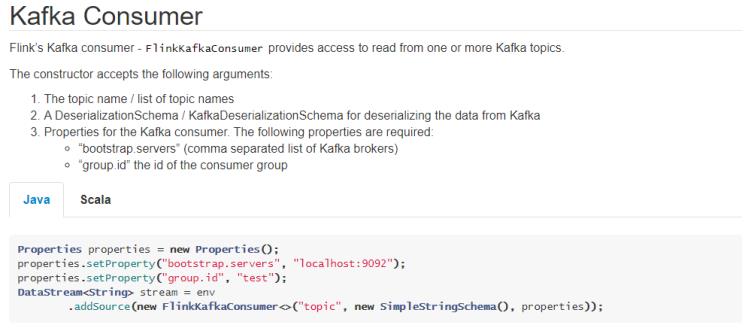

Flink Connectors之消费Kafka数据相关参数以及API说明

1-参数设置

以下参数都必须/建议设置上

1.订阅的主题

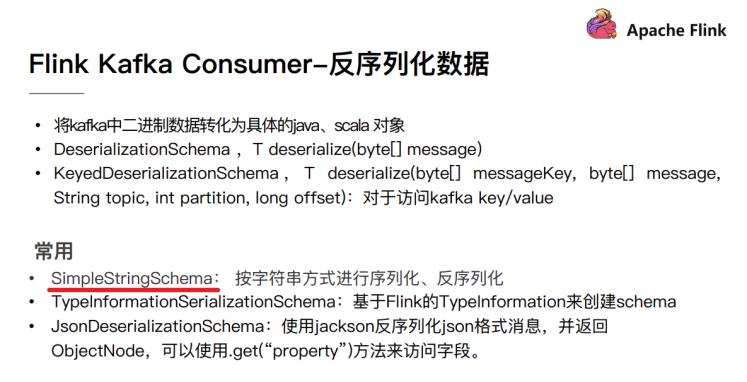

2.反序列化规则

3.消费者属性-集群地址

4.消费者属性-消费者组id(如果不设置,会有默认的,但是默认的不方便管理)

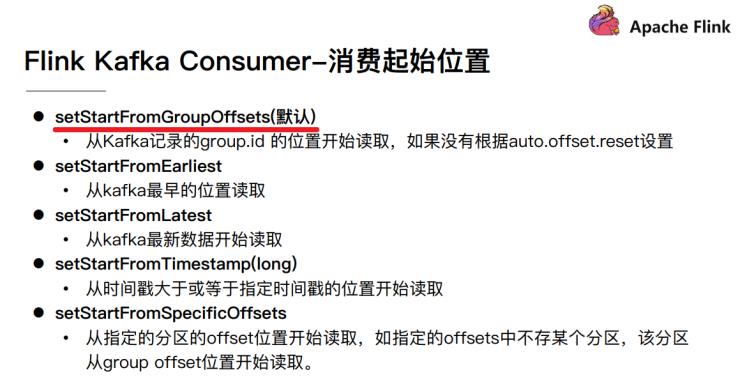

5.消费者属性-offset重置规则,如earliest/latest…

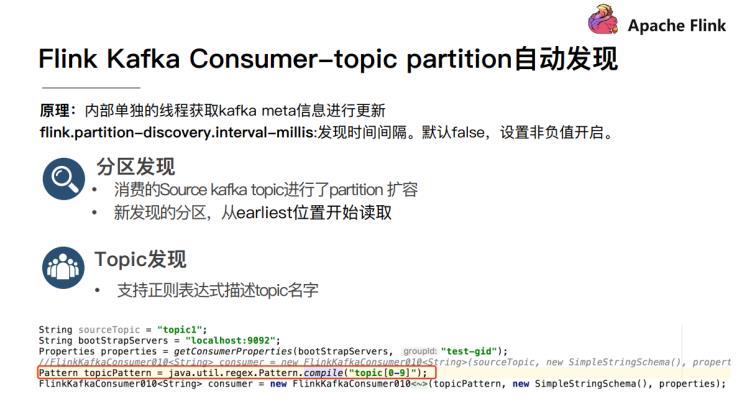

6.动态分区检测(当kafka的分区数变化/增加时,Flink能够检测到!)

7.Checkpoint会把offset随着做Checkpoint的时候提交到Checkpoint和默认主题中

2- 参数说明

注意:

实际的生产环境中可能有这样一些需求,比如:

场景一:有一个 Flink 作业需要将五份数据聚合到一起,五份数据对应五个 kafka topic,随着业务增长,新增一类数据,同时新增了一个 kafka topic,如何在不重启作业的情况下作业自动感知新的 topic。

场景二:作业从一个固定的 kafka topic 读数据,开始该 topic 有 10 个 partition,但随着业务的增长数据量变大,需要对 kafka partition 个数进行扩容,由 10 个扩容到 20。该情况下如何在不重启作业情况下动态感知新扩容的 partition?

针对上面的两种场景,首先需要在构建 FlinkKafkaConsumer 时的 properties 中设置 flink.partition-discovery.interval-millis 参数为非负值,表示开启动态发现的开关,以及设置的时间间隔。此时 FlinkKafkaConsumer 内部会启动一个单独的线程定期去 kafka 获取最新的 meta 信息。

针对场景一,还需在构建 FlinkKafkaConsumer 时,topic 的描述可以传一个正则表达式描述的 pattern。每次获取最新 kafka meta 时获取正则匹配的最新 topic 列表。

针对场景二,设置前面的动态发现参数,在定期获取 kafka 最新 meta 信息时会匹配新的 partition。为了保证数据的正确性,新发现的 partition 从最早的位置开始读取。

注意:

开启 checkpoint 时 offset 是 Flink 通过状态 state 管理和恢复的,并不是从 kafka 的 offset 位置恢复。在 checkpoint 机制下,作业从最近一次checkpoint 恢复,本身是会回放部分历史数据,导致部分数据重复消费,Flink 引擎仅保证计算状态的精准一次,要想做到端到端精准一次需要依赖一些幂等的存储系统或者事务操作。

3-代码

import org.apache.flink.api.common.RuntimeExecutionMode;

import org.apache.flink.api.common.functions.FlatMapFunction;

import org.apache.flink.api.common.serialization.SimpleStringSchema;

import org.apache.flink.api.java.tuple.Tuple2;

import org.apache.flink.streaming.api.datastream.DataStreamSource;

import org.apache.flink.streaming.api.datastream.SingleOutputStreamOperator;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.connectors.kafka.FlinkKafkaConsumer;

import org.apache.flink.util.Collector;

import java.util.Properties;

/**

* @author liu a fu

* @version 1.0

* @date 2021/8/4 0004

* @DESC

*/

public class KafkaComsumerConn {

public static void main(String[] args) throws Exception {

//TODO 0.env

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

env.setRuntimeMode(RuntimeExecutionMode.AUTOMATIC);

//TODO: 1-Source

//准备kafka连接参数

Properties props = new Properties();

props.setProperty("bootstrap.servers", "node1:9092");//broker地址 集群地址

props.setProperty("group.id", "flink");//消费者组id

props.setProperty("auto.offset.reset","latest");//latest有offset记录从记录位置开始消费,没有记录从最新的/最后的消息开始消费 /earliest有offset记录从记录位置开始消费,没有记录从最早的/最开始的消息开始消费

props.setProperty("flink.partition-discovery.interval-millis","5000");//会开启一个后台线程每隔5s检测一下Kafka的分区情况,实现动态分区检测

props.setProperty("enable.auto.commit", "true");//自动提交(提交到默认主题,后续学习了Checkpoint后随着Checkpoint存储在Checkpoint和默认主题中)

props.setProperty("auto.commit.interval.ms", "2000");//自动提交的时间间隔

//使用连接参数创建FlinkKafkaConsumer/kafkaSource

FlinkKafkaConsumer<String> kafkaSource = new FlinkKafkaConsumer<>("flink_kafka", new SimpleStringSchema(), props);

DataStreamSource<String> kafkaDs = env.addSource(kafkaSource);

//TODO:2-transformation 做什么wordcount这些的

SingleOutputStreamOperator<Tuple2<String, Integer>> resultDS = kafkaDs.flatMap(new FlatMapFunction<String, Tuple2<String, Integer>>() {

@Override

public void flatMap(String value, Collector<Tuple2<String, Integer>> out) throws Exception {

String[] arr = value.split(" ");

for (String word : arr) {

out.collect(Tuple2.of(word, 1));

}

}

}).keyBy(0).sum(1);

//TODO:3-Sink

resultDS.print();

//获取流试执行环境

env.execute();

}

}

//准备主题 /export/server/kafka_2.12-2.4.1/bin/kafka-topics.sh --create --zookeeper node1:2181 --replication-factor 2 --partitions 3 --topic flink_kafka

//启动控制台生产者发送数据 /export/server/kafka_2.12-2.4.1/bin/kafka-console-producer.sh --broker-list node1:9092 --topic flink_kafka

//启动程序

//观察控制台输出结果

import org.apache.flink.api.common.RuntimeExecutionMode;

import org.apache.flink.api.common.functions.FilterFunction;

import org.apache.flink.api.common.serialization.SimpleStringSchema;

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.datastream.SingleOutputStreamOperator;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.connectors.kafka.FlinkKafkaConsumer;

import org.apache.flink.streaming.connectors.kafka.FlinkKafkaProducer;

import java.util.Properties;

/**

* Author itcast

* Desc 演示Flink-Connectors-KafkaProducer + FlinkStreaming(ETL) + KafkaComsumer

*/

public class KafkaSinkDemo {

public static void main(String[] args) throws Exception {

//TODO 0.env

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

env.setRuntimeMode(RuntimeExecutionMode.AUTOMATIC);

//TODO 1.source

//准备kafka连接参数

Properties props = new Properties();

props.setProperty("bootstrap.servers", "node1:9092");//集群地址

props.setProperty("group.id", "flink");//消费者组id

props.setProperty("auto.offset.reset","latest");//latest有offset记录从记录位置开始消费,没有记录从最新的/最后的消息开始消费 /earliest有offset记录从记录位置开始消费,没有记录从最早的/最开始的消息开始消费

props.setProperty("flink.partition-discovery.interval-millis","5000");//会开启一个后台线程每隔5s检测一下Kafka的分区情况,实现动态分区检测

props.setProperty("enable.auto.commit", "true");//自动提交(提交到默认主题,后续学习了Checkpoint后随着Checkpoint存储在Checkpoint和默认主题中)

props.setProperty("auto.commit.interval.ms", "2000");//自动提交的时间间隔

//使用连接参数创建FlinkKafkaConsumer/kafkaSource

FlinkKafkaConsumer<String> kafkaSource = new FlinkKafkaConsumer<String>("flink_kafka", new SimpleStringSchema(), props);

//使用kafkaSource

DataStream<String> kafkaDS = env.addSource(kafkaSource);

//TODO 2.transformation

SingleOutputStreamOperator<String> etlDS = kafkaDS.filter(new FilterFunction<String>() {

@Override

public boolean filter(String value) throws Exception {

return value.contains("success"); //返回得到包含success的结果

}

});

//TODO 3.sink

etlDS.print();//----> 控制台打印输出

Properties props2 = new Properties();

props2.setProperty("bootstrap.servers", "node1:9092");

FlinkKafkaProducer<String> kafkaSink = new FlinkKafkaProducer<>("flink_kafka2", new SimpleStringSchema(), props2);

etlDS.addSink(kafkaSink);

//TODO 4.execute

env.execute();

}

}

//控制台生成者 ---> flink_kafka主题 --> Flink -->etl ---> flink_kafka2主题--->控制台消费者

//准备主题 /export/server/kafka_2.12-2.4.1/bin/kafka-topics.sh --create --zookeeper node1:2181 --replication-factor 2 --partitions 3 --topic flink_kafka

//准备主题 /export/server/kafka_2.12-2.4.1/bin/kafka-topics.sh --create --zookeeper node1:2181 --replication-factor 2 --partitions 3 --topic flink_kafka2

//启动生产者发送数据 /export/server/kafka_2.12-2.4.1/bin/kafka-console-producer.sh --broker-list node1:9092 --topic flink_kafka

//log:2020-10-10 success xxx

//log:2020-10-10 success xxx

//log:2020-10-10 success xxx

//log:2020-10-10 fail xxx

//启动消费者消费数据 /export/server/kafka_2.12-2.4.1/bin/kafka-console-consumer.sh --bootstrap-server node1:9092 --topic flink_kafka2 --from-beginning

//启动自己编写的FLink程序 进行ETL处理

//观察控制台输出结果 和 Kafka的consumer消费者的结果

以上是关于kafka消费byte数据的序列化的主要内容,如果未能解决你的问题,请参考以下文章