Python爬虫学习——获取网页

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Python爬虫学习——获取网页相关的知识,希望对你有一定的参考价值。

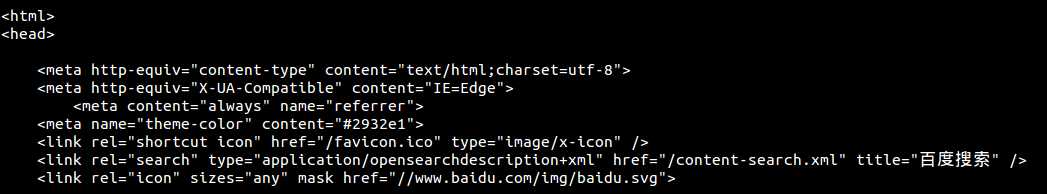

通过GET请求获取返回的网页,其中加入了User-agent信息,不然会抛出"HTTP Error 403: Forbidden"异常,

因为有些网站为了防止这种没有User-agent信息的访问,会验证请求信息中的UserAgent(它的信息包括硬件平台、系统软件、应用软件和用户个人偏好),如果UserAgent存在异常或者是不存在,那么这次请求将会被拒绝。

#coding=utf-8

import urllib2

import re

#使用Python2.7

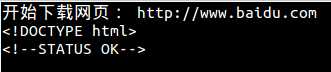

def getHtml(url,user_agent="wswp",num_retries=2): #下载网页,如果下载失败重新下载两次

print ‘开始下载网页:‘,url

headers = {"User-agent":user_agent}

# headers = {

# ‘User-Agent‘: ‘Mozilla/5.0 (Windows NT 6.1; rv:24.0) Gecko/20100101 Firefox/24.0‘,

# ‘cookie‘: cookie

# }

request = urllib2.Request(url,headers=headers)

try:

html = urllib2.urlopen(request).read() #GET请求

except urllib2.URLError as e:

print "下载失败:",e.reason

html = None

if num_retries > 0:

if hasattr(e,‘code‘) and 500 <= e.code < 600:

return getHtml(url,num_retries-1)

return html

if __name__ == ‘__main__‘:

html = getHtml("http://www.baidu.com")

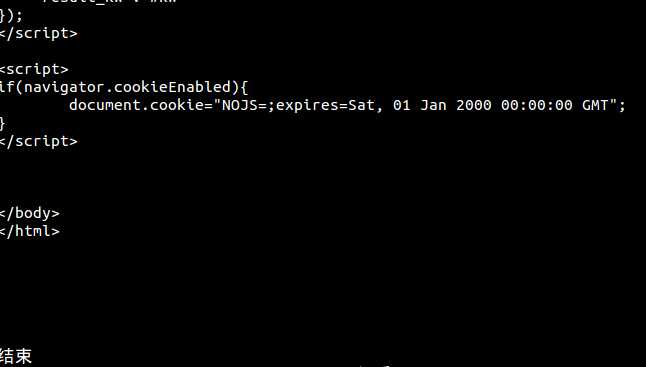

print html

print "结束"

...

以上是关于Python爬虫学习——获取网页的主要内容,如果未能解决你的问题,请参考以下文章

系统进阶学习python,爬虫,网页设计,正则表达式(附源代码)