回归预测 | MATLAB实现GA-LSTM遗传算法优化长短期记忆网络的数据多输入单输出回归预测

Posted 机器学习之心

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了回归预测 | MATLAB实现GA-LSTM遗传算法优化长短期记忆网络的数据多输入单输出回归预测相关的知识,希望对你有一定的参考价值。

回归预测 | MATLAB实现GA-LSTM遗传算法优化长短期记忆网络的数据多输入单输出回归预测

目录

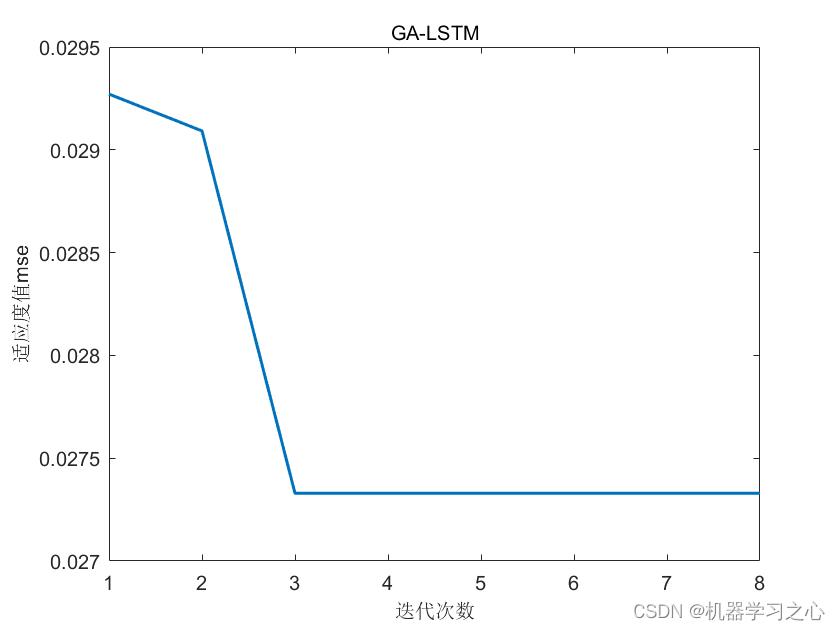

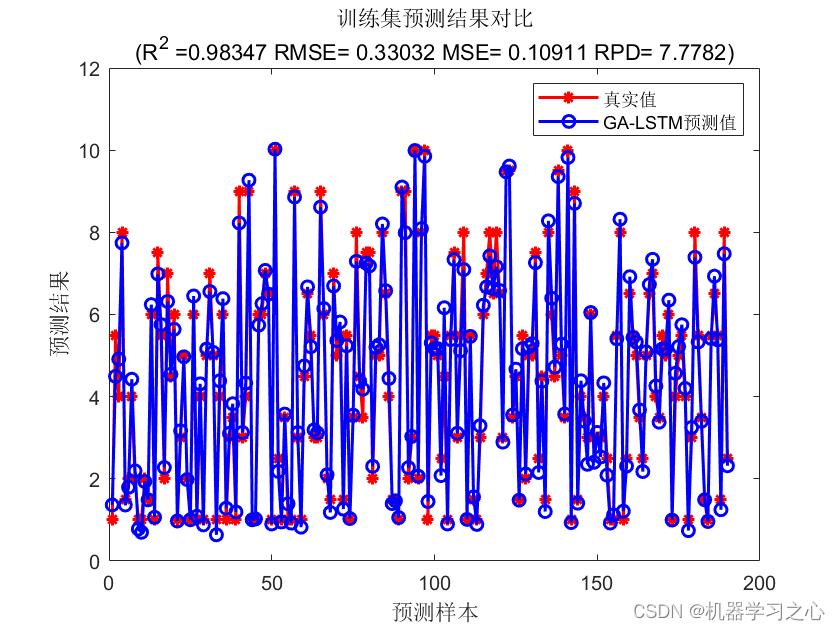

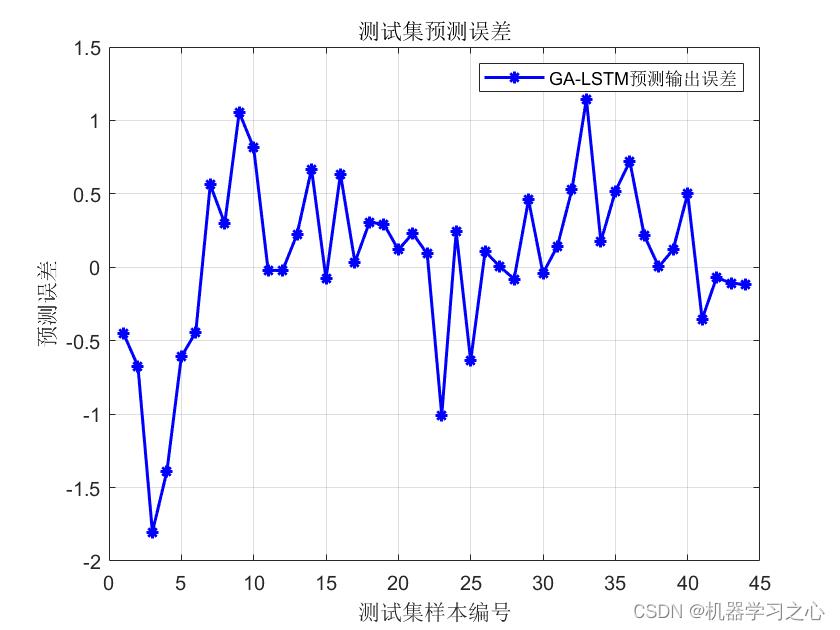

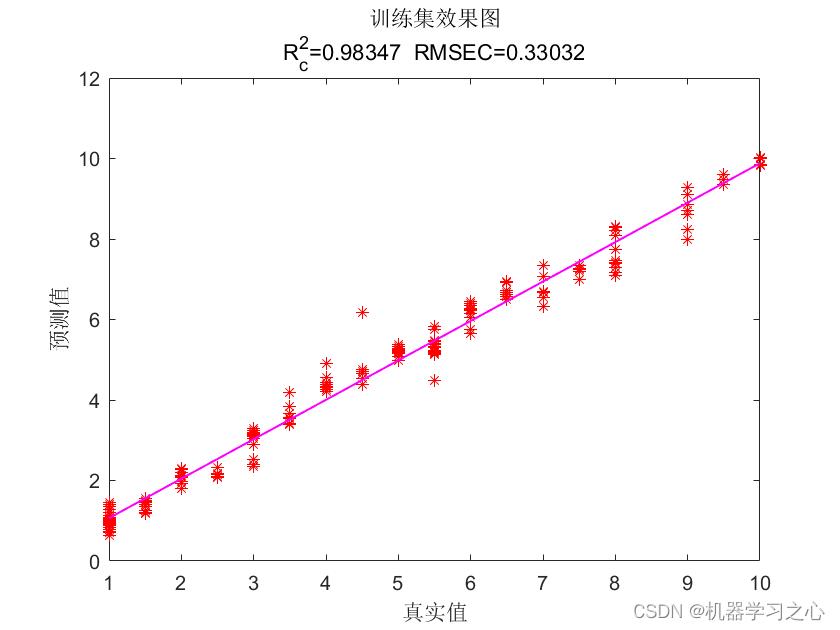

效果一览

基本介绍

MATLAB实现GA-LSTM遗传算法优化长短期记忆网络的数据多输入单输出回归预测

GA-LSTM遗传算法优化长短期记忆网络回归预测(Matlab完整程序和数据)

输入6个特征,输出1个,即多输入单输出;

运行环境Matlab2018及以上,运行主程序main即可,其余为函数文件无需运行,所有程序放在一个文件夹,data为数据集;

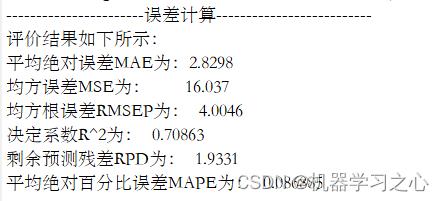

命令窗口输出RMSEP、MAE、R2、MAPE。

程序设计

- 完整程序和数据下载方式1(资源处直接下载):MATLAB实现GA-LSTM遗传算法优化长短期记忆网络的数据多输入单输出回归预测

- 完整程序和数据下载方式2(订阅《LSTM长短期记忆神经网络》专栏,同时可阅读《RF随机森林》专栏收录的所有内容,数据订阅后私信我获取):MATLAB实现GA-LSTM遗传算法优化长短期记忆网络的数据多输入单输出回归预测

- 完整程序和数据下载方式3(订阅《智能学习》专栏,同时获取《智能学习》专栏收录程序6份,数据订阅后私信我获取):MATLAB实现GA-LSTM遗传算法优化长短期记忆网络的数据多输入单输出回归预测

%% 记录最佳参数

Best_pos(1, 2) = round(Best_pos(1, 2));

best_lr = Best_pos(1, 1);

best_hd = Best_pos(1, 2);

best_l2 = Best_pos(1, 3);

%% 建立模型

% ---------------------- 修改模型结构时需对应修改fical.m中的模型结构 --------------------------

layers = [

sequenceInputLayer(f_) % 输入层

lstmLayer(best_hd) % LSTM层

reluLayer % Relu激活层

fullyConnectedLayer(outdim) % 输出回归层

regressionLayer];

%% 参数设置

% ---------------------- 修改模型参数时需对应修改fical.m中的模型参数 --------------------------

options = trainingOptions('adam', ... % Adam 梯度下降算法

'MaxEpochs', 500, ... % 最大训练次数 500

'InitialLearnRate', best_lr, ... % 初始学习率 best_lr

'LearnRateSchedule', 'piecewise', ... % 学习率下降

'LearnRateDropFactor', 0.5, ... % 学习率下降因子 0.1

'LearnRateDropPeriod', 400, ... % 经过 400 次训练后 学习率为 best_lr * 0.5

'Shuffle', 'every-epoch', ... % 每次训练打乱数据集

'ValidationPatience', Inf, ... % 关闭验证

'L2Regularization', best_l2, ... % 正则化参数

'Plots', 'training-progress', ... % 画出曲线

'Verbose', false);

%% 训练模型

net = trainNetwork(p_train, t_train, layers, options);

%% 仿真验证

t_sim1 = predict(net, p_train);

t_sim2 = predict(net, p_test );

%% 数据反归一化

T_sim1 = mapminmax('reverse', t_sim1, ps_output);

T_sim2 = mapminmax('reverse', t_sim2, ps_output);

T_sim1=double(T_sim1);

T_sim2=double(T_sim2);

%% 均方根误差

error1 = sqrt(sum((T_sim1 - T_train).^2) ./ M);

error2 = sqrt(sum((T_sim2 - T_test ).^2) ./ N);

%% 参数初始化

popsize=pop; %种群规模

lenchrom=dim; %变量字串长度

fun = fobj; %适应度函数

pc=0.7; %设置交叉概率

pm=0.3; %设置变异概率

if(max(size(ub)) == 1)

ub = ub.*ones(dim,1);

lb = lb.*ones(dim,1);

end

maxgen=Max_iter; % 进化次数

%种群

%% 产生初始粒子和速度

%随机产生一个种群

GApop=initialization(pop, dim, ub, lb); %随机产生个体

for i=1:popsize

%计算适应度

fitness(i)=fun(GApop(i,:)); %染色体的适应度

end

%找最好的染色体

[bestfitness bestindex]=min(fitness);

zbest=GApop(bestindex,:); %全局最佳

gbest=GApop; %个体最佳

fitnessgbest=fitness; %个体最佳适应度值

fitnesszbest=bestfitness; %全局最佳适应度值

%% 迭代寻优

for i=1:maxgen

disp(['第',num2str(i),'次迭代'])

%种群更新 GA选择更新

GApop=Select2(GApop,fitness,popsize);

% 交叉操作 GA

GApop=Cross(pc,lenchrom,GApop,popsize,lb,ub);

% 变异操作 GA变异

GApop=Mutation(pm,lenchrom,GApop,popsize,[i maxgen],lb,ub);

pop=GApop;

for j=1:popsize

%适应度值

fitness(j)=fun(pop(j,:));

%个体最优更新

if fitness(j) < fitnessgbest(j)

gbest(j,:) = pop(j,:);

fitnessgbest(j) = fitness(j);

end

%群体最优更新

if fitness(j) < fitnesszbest

zbest = pop(j,:);

fitnesszbest = fitness(j);

end

end

curve(i)=fitnesszbest;

end

%% 边界数目

Boundary_no= size(ub, 2);

%% 变量数目等于1

if Boundary_no == 1

Positions = rand(SearchAgents_no, dim) .* (ub - lb) + lb;

end

%% 如果每个变量有不同的上下界

if Boundary_no > 1

for i = 1 : dim

ub_i = ub(i);

lb_i = lb(i);

Positions(:, i) = rand(SearchAgents_no, 1) .* (ub_i - lb_i) + lb_i;

end

end

参考资料

[1] https://blog.csdn.net/kjm13182345320/article/details/129215161

[2] https://blog.csdn.net/kjm13182345320/article/details/128105718

回归预测 | MATLAB实现PSO-RF粒子群算法优化随机森林多输入单输出回归预测

回归预测 | MATLAB实现PSO-RF粒子群算法优化随机森林多输入单输出回归预测

目录

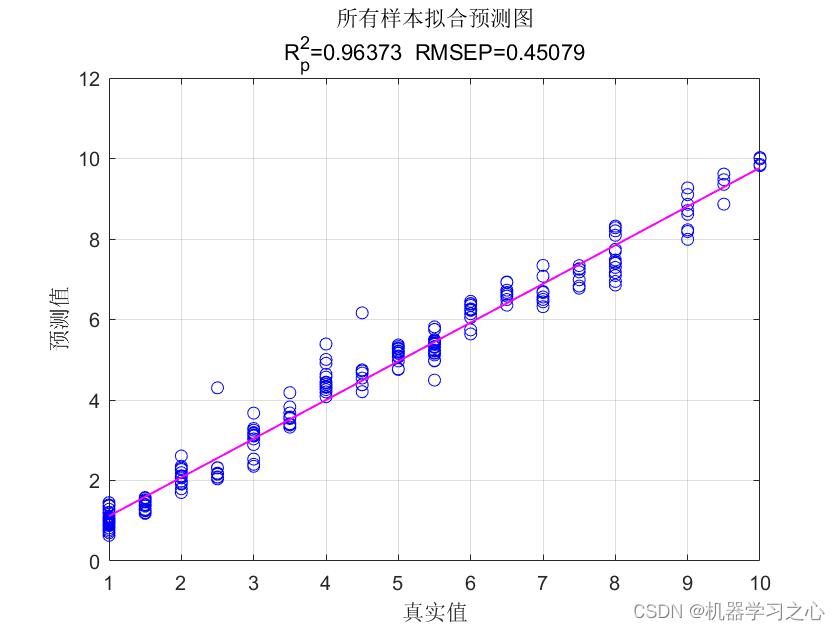

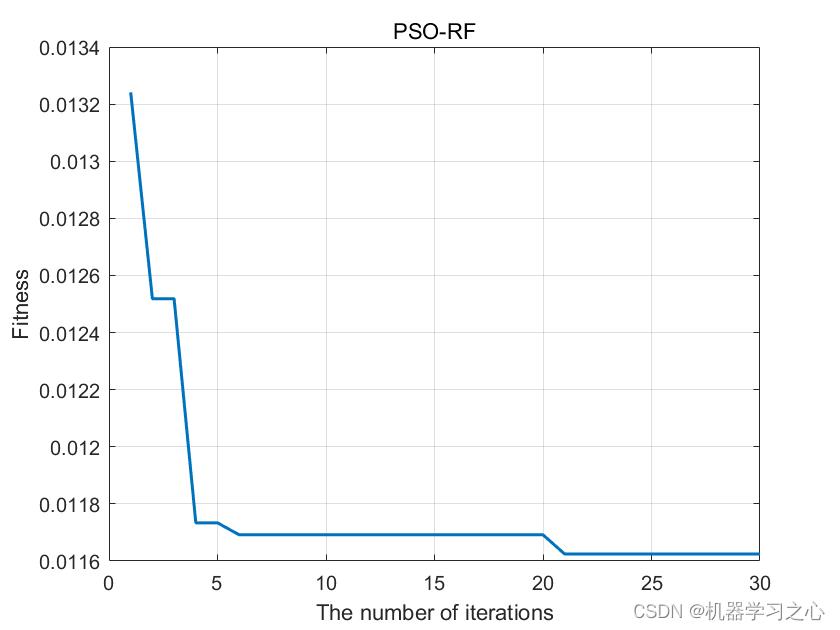

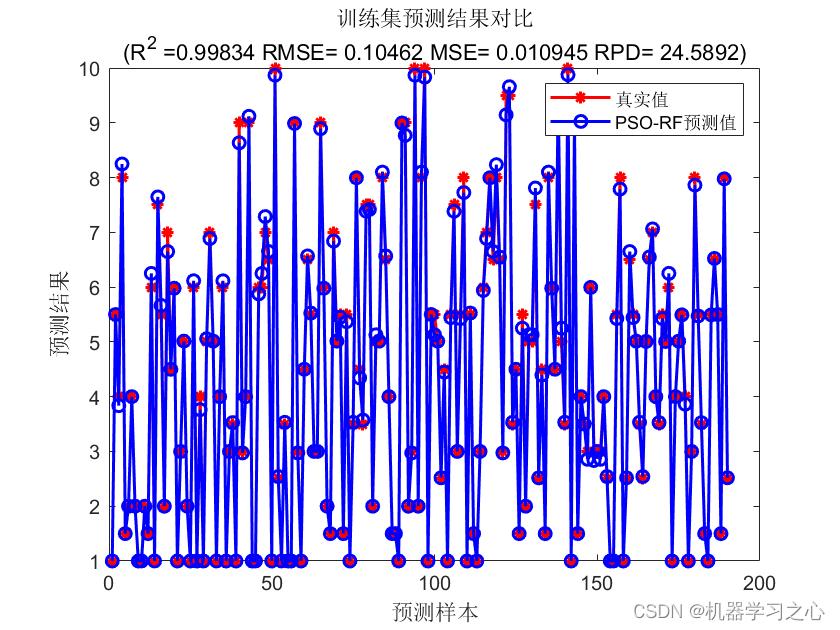

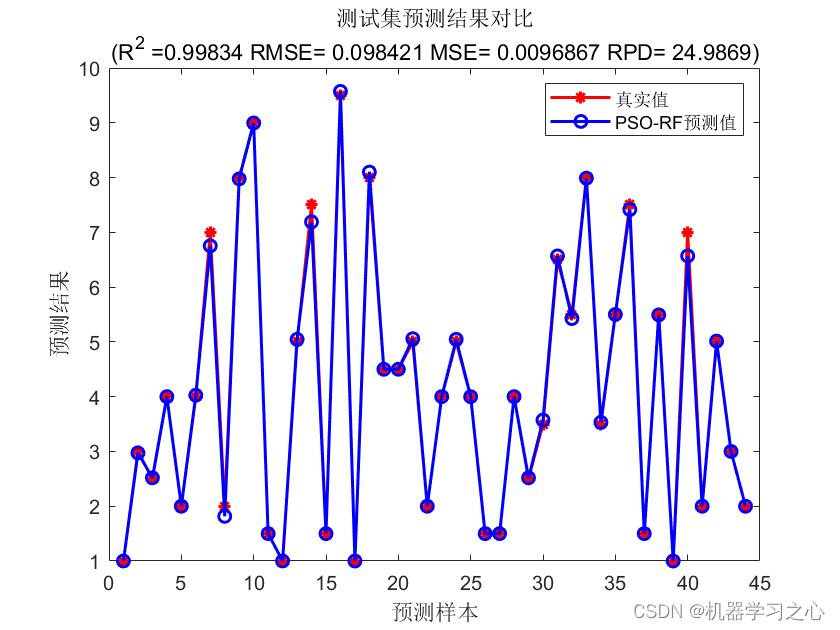

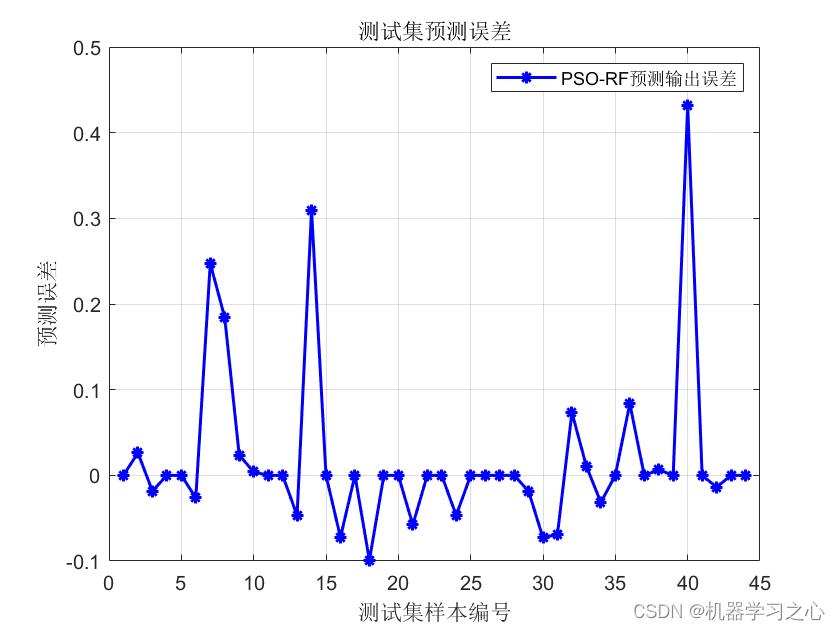

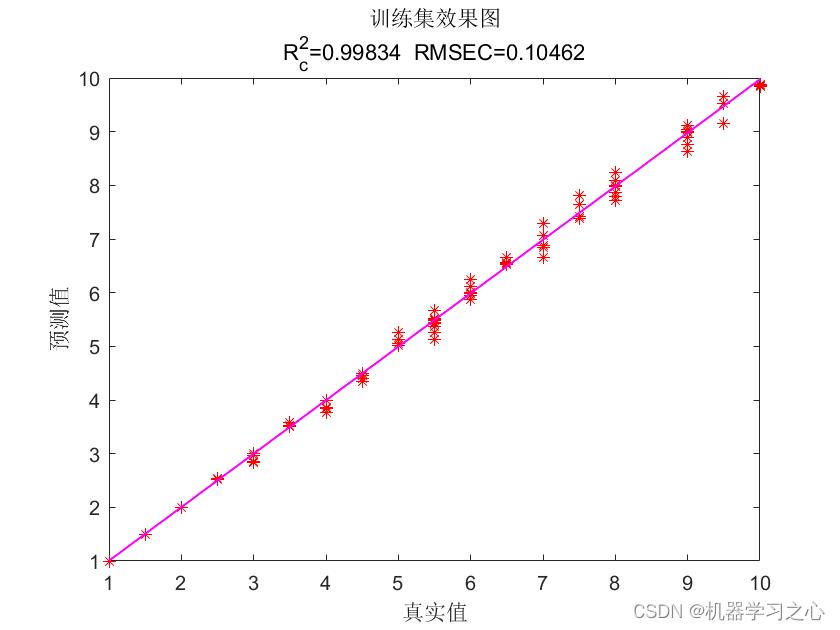

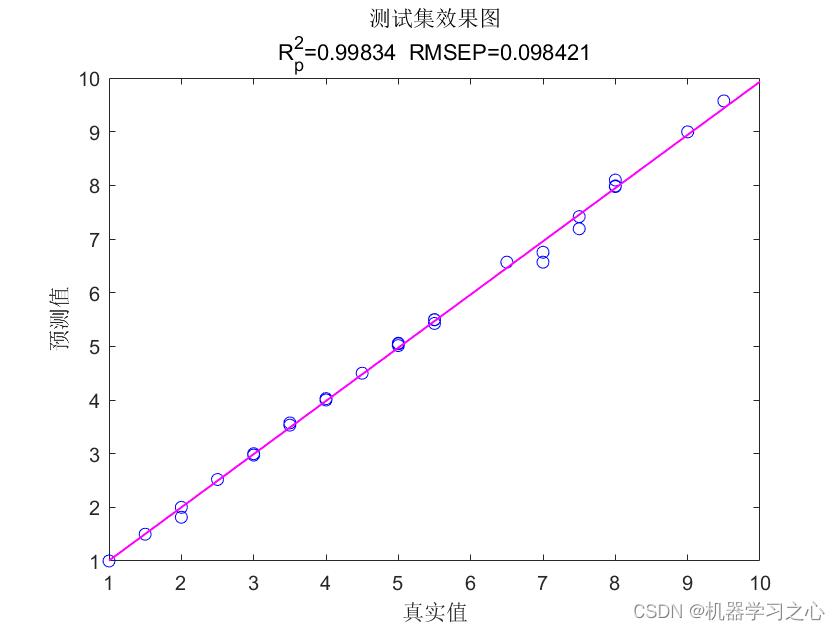

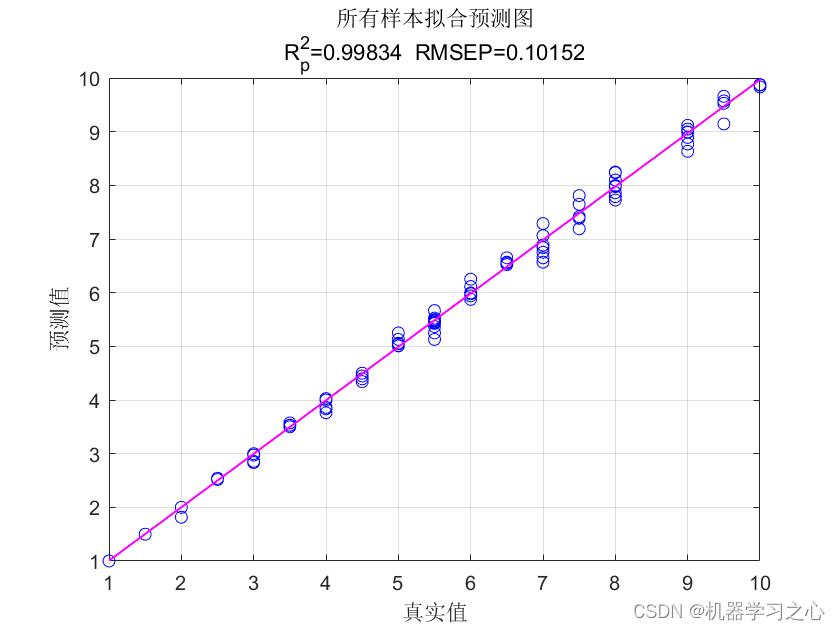

效果一览

基本介绍

MATLAB实现PSO-RF粒子群算法优化随机森林多输入单输出回归预测

粒子群算法优化随机森林(PSO-RF)回归预测(Matlab完整程序和数据)

输入6个特征,输出1个,即多输入单输出;

运行环境Matlab2018及以上,运行主程序main即可,其余为函数文件无需运行,所有程序放在一个文件夹,data为数据集;

命令窗口输出RMSEP、MAE、R2、MAPE。

程序设计

- 完整程序和数据下载方式1(资源处直接下载):MATLAB实现PSO-RF粒子群算法优化随机森林多输入单输出回归预测

- 完整程序和数据下载方式2(订阅《RF随机森林》专栏,同时可阅读《RF随机森林》专栏收录的所有内容,数据订阅后私信我获取):MATLAB实现PSO-RF粒子群算法优化随机森林多输入单输出回归预测

- 完整程序和数据下载方式3(订阅《智能学习》专栏,同时获取《智能学习》专栏收录程序6份,数据订阅后私信我获取):MATLAB实现PSO-RF粒子群算法优化随机森林多输入单输出回归预测

%% 定义粒子群算法参数

% N 种群 T 迭代次数

%% 随机初始化种群

D=dim; %粒子维数

c1=1.5; %学习因子1

c2=1.5; %学习因子2

w=0.8; %惯性权重

Xmax=ub; %位置最大值

Xmin=lb; %位置最小值

Vmax=ub; %速度最大值

Vmin=lb; %速度最小值

%%

%%%%%%%%%%%%%%%%初始化种群个体(限定位置和速度)%%%%%%%%%%%%%%%%

x=rand(N,D).*(Xmax-Xmin)+Xmin;

v=rand(N,D).*(Vmax-Vmin)+Vmin;

%%%%%%%%%%%%%%%%%%初始化个体最优位置和最优值%%%%%%%%%%%%%%%%%%%

p=x;

pbest=ones(N,1);

for i=1:N

pbest(i)=fobj(x(i,:));

end

%%%%%%%%%%%%%%%%%%%初始化全局最优位置和最优值%%%%%%%%%%%%%%%%%%

g=ones(1,D);

gbest=inf;

for i=1:N

if(pbest(i)<gbest)

g=p(i,:);

gbest=pbest(i);

end

end

%%%%%%%%%%%按照公式依次迭代直到满足精度或者迭代次数%%%%%%%%%%%%%

for i=1:T

i

for j=1:N

%%%%%%%%%%%%%%更新个体最优位置和最优值%%%%%%%%%%%%%%%%%

if (fobj(x(j,:))) <pbest(j)

p(j,:)=x(j,:);

pbest(j)=fobj(x(j,:));

end

%%%%%%%%%%%%%%%%更新全局最优位置和最优值%%%%%%%%%%%%%%%

if(pbest(j)<gbest)

g=p(j,:);

gbest=pbest(j);

end

%%%%%%%%%%%%%%%%%跟新位置和速度值%%%%%%%%%%%%%%%%%%%%%

v(j,:)=w*v(j,:)+c1*rand*(p(j,:)-x(j,:))...

+c2*rand*(g-x(j,:));

x(j,:)=x(j,:)+v(j,:);

%%%%%%%%%%%%%%%%%%%%边界条件处理%%%%%%%%%%%%%%%%%%%%%%

if length(Vmax)==1

for ii=1:D

if (v(j,ii)>Vmax) | (v(j,ii)< Vmin)

v(j,ii)=rand * (Vmax-Vmin)+Vmin;

end

if (x(j,ii)>Xmax) | (x(j,ii)< Xmin)

x(j,ii)=rand * (Xmax-Xmin)+Xmin;

end

end

else

for ii=1:D

if (v(j,ii)>Vmax(ii)) | (v(j,ii)< Vmin(ii))

v(j,ii)=rand * (Vmax(ii)-Vmin(ii))+Vmin(ii);

end

if (x(j,ii)>Xmax(ii)) | (x(j,ii)< Xmin(ii))

x(j,ii)=rand * (Xmax(ii)-Xmin(ii))+Xmin(ii);

end

end

end

end

%%%%%%%%%%%%%%%%%%%%记录历代全局最优值%%%%%%%%%%%%%%%%%%%%%

Convergence_curve(i)=gbest;%记录训练集的适应度值

%% 清空环境变量

warning off % 关闭报警信息

close all % 关闭开启的图窗

clear % 清空变量

clc % 清空命令行

tic

restoredefaultpath

%% 导入数据

P_train = xlsread('data','training set','B2:G191')';

T_train= xlsread('data','training set','H2:H191')';

% 测试集——44个样本

P_test=xlsread('data','test set','B2:G45')';

T_test=xlsread('data','test set','H2:H45')';

%% 划分训练集和测试集

M = size(P_train, 2);

N = size(P_test, 2);

f_ = size(P_train, 1);

%% 数据归一化

[p_train, ps_input] = mapminmax(P_train, 0, 1);

p_test = mapminmax('apply', P_test, ps_input);

[t_train, ps_output] = mapminmax(T_train, 0, 1);

t_test = mapminmax('apply', T_test, ps_output);

%% 参数初始化

pop=10; %种群数量

Max_iter=30; % 设定最大迭代次数

dim = 2;% 维度为2,即优化两个超参数

lb = [1,1];%下边界

ub = [20,20];%上边界

fobj = @(x) fun(x,p_train,t_train);

[Best_pos,Best_score,curve]=PSO(pop,Max_iter,lb,ub,dim,fobj); %开始优化

%% 提取最优参数

n_trees = Best_pos(1);

n_layer = Best_pos(2);

%% 转置以适应模型

p_train = p_train'; p_test = p_test';

t_train = t_train'; t_test = t_test';

%% 创建模型

model = regRF_train(p_train, t_train, n_trees, n_layer);

参考资料

[1] https://blog.csdn.net/kjm13182345320/article/details/129215161

[2] https://blog.csdn.net/kjm13182345320/article/details/128105718

以上是关于回归预测 | MATLAB实现GA-LSTM遗传算法优化长短期记忆网络的数据多输入单输出回归预测的主要内容,如果未能解决你的问题,请参考以下文章