Python基于OpenCV的实时疲劳检测[源码&演示视频&部署教程]

Posted 群马视觉

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Python基于OpenCV的实时疲劳检测[源码&演示视频&部署教程]相关的知识,希望对你有一定的参考价值。

1.图片演示

2.视频演示

3.检测方法

1)方法

与用于计算眨眼的传统图像处理方法不同,该方法通常涉及以下几种组合:

1、眼睛定位。

2、阈值找到眼睛的白色。

3、确定眼睛的“白色”区域是否消失了一段时间(表示眨眼)。

相反,眼睛长宽比是一种更为优雅的解决方案,它涉及基于眼睛面部轮廓之间的距离之比的非常简单的计算。

这种眨眼检测方法快速,高效且易于实现。

(2)眼睛纵横比

我们可以应用脸部界标检测来定位脸部重要区域,包括眼睛,眉毛,鼻子,耳朵和嘴巴

这也意味着我们可以通过了解特定面部部分的索引来提取特定面部结构:

在眨眼检测方面,我们只对两套面部结构感兴趣:眼睛。

每只眼睛都由6 (x,y)坐标表示,从坐标的左角开始(就像您在看那个人一样),然后沿该区域的其余部分顺时针旋转:

基于此图像,我们应该取消关键点:

这些坐标的宽度和高度之间存在关系。

根据Soukupová和Čech在2016年的论文《使用面部地标进行实时眼睛眨眼检测》的工作,我们可以得出一个反映这种关系的方程,称为眼睛纵横比(EAR):

def eye_aspect_ratio(eye):

# 计算距离,竖直的

A = dist.euclidean(eye[1], eye[5])

B = dist.euclidean(eye[2], eye[4])

# 计算距离,水平的

C = dist.euclidean(eye[0], eye[3])

# ear值

ear = (A + B) / (2.0 * C)

return ear

其中p1,…,p6是2D面部界标位置。

该方程的分子计算垂直眼界标之间的距离,而分母计算水平眼界标之间的距离,对分母进行适当加权,因为只有一组水平点,但有两组垂直点。

(3)眨眼检测标准

睁开眼睛时眼睛的纵横比大约是恒定的,但是当眨眼时眼睛的纵横比会迅速降至零。

使用这个简单的方程式,我们可以避免使用图像处理技术,而只需依靠眼睛界标距离的比率来确定一个人是否在眨眼。

为了更清楚地说明这一点,请看下图:

图: 左上:当眼睛睁开时,眼睛界标的可视化。右上:闭上眼睛时的眼睛地标。底部:绘制随时间变化的眼睛纵横比。眼睛纵横比的下降表示眨眼

def shape_to_np(shape, dtype="int"):

# 创建68*2

coords = np.zeros((shape.num_parts, 2), dtype=dtype)

# 遍历每一个关键点

# 得到坐标

for i in range(0, shape.num_parts):

coords[i] = (shape.part(i).x, shape.part(i).y)

return coords

在左上角,我们的眼睛完全张开-此处的眼睛长宽比会很大(r),并且随着时间的推移会相对保持恒定。

但是,一旦眨眼(右上角),眼睛的宽高比就会急剧下降,接近零。

在底部图中绘出了眼纵横比随时间的视频剪辑的曲线图。如我们所见,眼睛的纵横比是恒定的,然后迅速下降到接近零,然后再次增加,表明已经发生了一次眨眼。

在确定视频流中是否发生眨眼时,我们需要计算眼睛的宽高比。

# 设置判断参数

EYE_AR_THRESH = 0.3 # ear小于0.3判断为闭眼

EYE_AR_CONSEC_FRAMES = 3 # 连续三帧ear都小于0.3判断为眨眼

# 初始化计数器

COUNTER = 0

TOTAL = 0

如果眼睛的宽高比下降到某个阈值以下,然后又上升到该阈值以上,那么我们将注册“眨眼”- EYE_AR_THRESH 是此阈值。我们将其默认设置为0. 3 因为这对我的应用程序最有效,但是您可能需要针对自己的应用程序进行调整。

# 遍历每一帧

while True:

# 预处理

frame = vs.read()[1]

if frame is None:

break

(h, w) = frame.shape[:2]

width=1200

r = width / float(w)

dim = (width, int(h * r))

frame = cv2.resize(frame, dim, interpolation=cv2.INTER_AREA)

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 检测人脸

rects = detector(gray, 0)

# 遍历每一个检测到的人脸

for rect in rects:

# 获取坐标

shape = predictor(gray, rect)

shape = shape_to_np(shape)

# 分别计算ear值

leftEye = shape[lStart:lEnd]

rightEye = shape[rStart:rEnd]

leftEAR = eye_aspect_ratio(leftEye)

rightEAR = eye_aspect_ratio(rightEye)

# 算一个平均的

ear = (leftEAR + rightEAR) / 2.0

# 绘制眼睛区域

leftEyeHull = cv2.convexHull(leftEye)

rightEyeHull = cv2.convexHull(rightEye)

cv2.drawContours(frame, [leftEyeHull], -1, (0, 255, 0), 1)

cv2.drawContours(frame, [rightEyeHull], -1, (0, 255, 0), 1)

# 检查是否满足阈值

if ear < EYE_AR_THRESH:

COUNTER += 1

else:

# 如果连续几帧都是闭眼的,总数算一次

if COUNTER >= EYE_AR_CONSEC_FRAMES:

TOTAL += 1

# 重置

COUNTER = 0

# 显示

cv2.putText(frame, "Blinks: ".format(TOTAL), (10, 30),

cv2.FONT_HERSHEY_SIMPLEX, 0.7, (0, 0, 255), 2)

cv2.putText(frame, "EAR: :.2f".format(ear), (300, 30),

cv2.FONT_HERSHEY_SIMPLEX, 0.7, (0, 0, 255), 2)

cv2.imshow("Frame", frame)

key = cv2.waitKey(10) & 0xFF

if key == 27:

break

vs.release()

cv2.destroyAllWindows()

然后我们有一个重要的常数, EYE_AR_CONSEC_FRAME —此值设置为 3 表示连续三个帧的眼睛长宽比小于EYE_AR_THRESH 必须进行眨眼才能注册眨眼。

同样,根据流水线的帧处理吞吐率,您可能需要为自己的实现提高或降低此数字。

第44和45行初始化两个计数器。柜台 是眼睛长宽比小于的连续帧的总数 EYE_AR_THRESH 尽管 全部的 是脚本运行期间发生的总闪烁次数。

4.完整源码&环境部署视频教程&自定义UI界面:

5.参考文献

[1] 汪明明,林小竹.基于OpenCV人眼定位的人脸检测方法[D].北京石油化工学院.2012(12).

[2] 傅亚煌,黄鸣宇.基于眼动特性的机动车驾驶疲劳系统[J].电脑与信息技术.2013(2).

[3] 王奕直,周凌霄,孔万增.基于Adaboost的疲劳驾驶眨眼检测[D].杭州电子科技大学学报.2013(8).

[4] 张旭,李亚利,陈晨,王生进,丁晓青.嵌入式驾驶员状态检测算法的实现与优化[J].自动化学报.2012(12).

[5] 赵钟.驾驶员疲劳检测方法研究及嵌入式实现[D]. 大连海事大学.2010(6).

[6] 徐淑峰,孙炜,赵峰,张忠.Adaboost人脸检测算法在嵌入式平台上的优化与实现[D].上海交通大学微电子学院.2008(6).

[7] 牛慧萍.基于DSP的人眼状态信息检测系统的研究和设计.[D].沈阳理工大学.2010(3).

[8] 郑玉铎.田杨萌.靳薇.基于Adaboost 和ASM 算法的人眼定位.[J] .北京信息科技大学学报.2013(6).

[9] 郭纯宏.基于嵌入式的人眼信息检测系统研究.[D].沈阳理工大学.2011(3).

[10] 王洪涛.驾驶疲劳测评方法研究及其DSP实现.[D].武汉理工大学.2007(5).

[11] 向本科.基于人眼检测的驾驶员疲劳检测研究.[D].西南大学.2010(5).

[12] 常瑜亮.基于DSP的疲劳驾驶检测系统硬件设计与实现. [D].沈阳理工大学.2010(3).

[13] 李文磊.基于DSP的疲劳驾驶实时监测系统研究.[D] .南京理工大学.2007(6).

毕业设计疲劳驾驶检测系统 - 机器学习 机器视觉 OpenCV python

文章目录

0 前言

🔥 Hi,大家好,这里是丹成学长的毕设系列文章!

🔥 对毕设有任何疑问都可以问学长哦!

这两年开始,各个学校对毕设的要求越来越高,难度也越来越大… 毕业设计耗费时间,耗费精力,甚至有些题目即使是专业的老师或者硕士生也需要很长时间,所以一旦发现问题,一定要提前准备,避免到后面措手不及,草草了事。

为了大家能够顺利以及最少的精力通过毕设,学长分享优质毕业设计项目,今天要分享的新项目是

🚩 基于机器学习的驾驶疲劳检测

🥇学长这里给一个题目综合评分(每项满分5分)

- 难度系数:4分

- 工作量:4分

- 创新点:3分

🧿 选题指导, 项目分享:

https://blog.csdn.net/Mr_DC_IT/article/details/126460477

1 总结

首先,总结一下检测某一特征的方法:

- (1)模板匹配计算当前帧与模板相同位置处的灰度值或颜色值的差值,通过特定的距离公式来计算匹配程度。

稳定可靠与光照和姿势无关计算量大

- (2)区域分割对面部区域进行二值化分割对孤立区域进行标示,再根据几何特征进行定位。(如连通面积等)。

运算量小噪声影响大

-

(3)对称变换法:DST方向对称变换计算量大

-

(4)灰度投影法:对人脸图像进行水平和垂直方向的投影,根据波峰波谷分布信息确定眼睛的位置。(将二维换到一维中去)定位速度较快受瞳孔灰度类似的眉毛或头发影响大。

-

(5)基于统计的方法通过对大量目标样本和非目标样本进行训练学习得到一组模型参数,基于模型构建分类器或者滤波器来检测目标。采用大量样本训练分类器,最后基于统计信息进行分类。

基于机器学习的疲劳识别,为第5种方案,属于统计方法。即输入训练样本,使用嘴巴部分、眼睛部分的图片作为训练样本的输入,可标注为闭嘴、中度张嘴和张嘴,闭眼、微闭和睁眼,也可直接检测嘴巴部分的哈欠状态和闭眼时的眼睛状态,当检测到哈欠状态时,对连续帧进行计数。当连续到一定阈值,即可进行疲劳报警。此时这种方法的优点在于可以考虑到尽可能多的影响因素,如光线的变化,克服人脸偏转的影响,直接对面部情况进行标注。

2 基于多视频窗口的疲劳驾驶监测系

使用Adaboost算法提高准确率,其作用是:检测人脸。基于haar特征的Adaboost算法在不同的背景下对人脸检测具有好的效果。积分图就是从图像起点到各个点所形成的矩形区域像素之和作为一个数组元素保存在内存中。使用积分图可方便计算。为规避头部偏转和光照强度的影响,使用动态肤色建模:首先确定人脸肤色候选区域;再对候选区域进行二次判别,如进行器官分布特征来验证人脸区域。增加初始时的采样环节,对不同的驾驶员建立肤色CgCr模型。

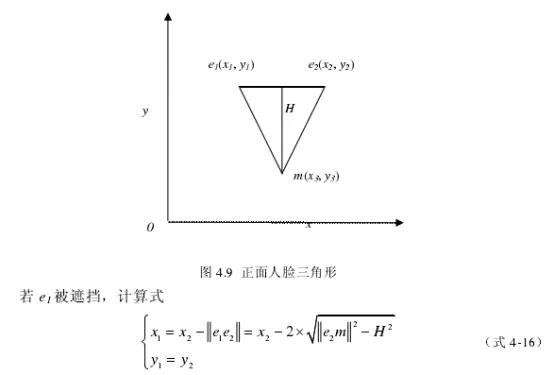

对于遮挡问题,还有一种解决方案:使用面部几何规律,使用基于等腰三角形的自适应遮挡估计:

有了这组公式,即使一面被遮挡,也可以计算出关键点的坐标信息。

3 基于近红外图像的疲劳驾驶检测

其实质就是使用几个特征训练多个分类器,然后将这些分类器进行结合,而结合的过程也是机器学习的过程,每一次在分类过程中都把分错的样本加大权重,确保下次在分类时该类样本能够被正确分类。Adaboost能够保证在若干个迭代学习后整体错误率低,在每次迭代之后会更新样本的权重,Adaboost算法会对分错的样本加重权重,使得其在下一个分类器中能够被正确分类,最后将这些分类器结合起来得到一个强分类器。

4 基于面部特征的全天候疲劳驾驶检测及预警

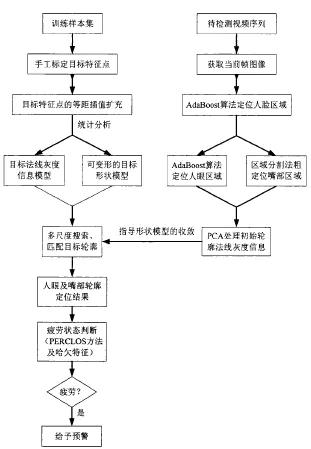

使用改进ASM算法(Active shape model结合了Adaboost),其是基于PDM点分布模型的统计学习算法,实现待定位模板产生了一定程度形变时的目标定位。步骤如下:

-

(1)建立统计形状模型 手工标定目标特征点 对齐后的形状向量集进行PCA

-

(2)建立统计特征模型 灰度信息采样 构建局部灰度特征

-

(3)目标搜索匹配 对法线采样点进行灰度值求导的方法得到特征点的局部特征。

共搜集了30幅左眼图像组建左眼库(该方法可能对头部转过角度有改善)

步骤流程图如下:

5 其他方法

使用基于Haar特征的Adaboost算法训练分类器, 实现嘴的正常状态和张嘴状态的区分,再针对区分结果实现二次处理,计算嘴的张开程度,判定是否处于疲劳状态。

处理方法:

文中选取打哈欠及各种张嘴时的嘴部图像为正样本,选取脸部其他部分图像为负样本,正样本和负样本图像均从网上搜索得到,正样本图像250张,大小统一缩放为24×24,负样本图像550张,部分样本图片如图7所示。

数量:正样本250张,负样本550张。

正样本:

负样本:

训练分类器使用Opencv提供的opencv_haartraining.exe训练程序得到分类器描述文件。由于嘴位于人脸的下半部分,所以搜索区域可缩小至人脸下半部分,节省搜索时间。检测完成得到打哈欠(或张嘴)的图片,则再用局部搜索确定二值化分割阈值,把嘴的轮廓分割出来。 为判断嘴的张开程度,我们同样在轮廓上取最具代表性的4个点: 上下边缘点和左右边缘点, 通过计算轮廓的外接矩形的宽高比来判定是否为打哈欠状态,一般认为当宽高比大于1.5的时候处于疲劳状态。

以上这些文献中均为使用了机器学习训练分类器的方法得到哈欠、闭眼特征,从而判定疲劳。

🧿 选题指导, 项目分享:

https://blog.csdn.net/Mr_DC_IT/article/details/126460477

以上是关于Python基于OpenCV的实时疲劳检测[源码&演示视频&部署教程]的主要内容,如果未能解决你的问题,请参考以下文章