深度学习 CNN中的混合域注意力机制(DANet,CBAM),附Tensorflow完整代码

Posted 立Sir

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了深度学习 CNN中的混合域注意力机制(DANet,CBAM),附Tensorflow完整代码相关的知识,希望对你有一定的参考价值。

各位同学好,今天和大家分享一下如何使用 Tensorflow 构建 DANet 和 CBAM 混合域注意力机制模型。在之前的文章中我介绍了CNN中的通道注意力机制 SENet 和 ECANet,感兴趣的可以看一下:https://blog.csdn.net/dgvv4/article/details/123572065

1. 注意力机制介绍

注意力机制本质上是一种资源分配机制,它可以根据关注目标的重要性程度改变资源分配方式,使资源更多的向attention的对象倾斜。在卷积神经网络中,注意力机制所要分配的资源就是权重参数。在模型训练过程中对于attention的对象分配更多的权重参数,能够提高对于attention对象的特征提取能力。在目标检测任务中添加注意力机制,可以提高模型的表征能力,有效减少无效目标的千扰,提升对关注目标的检测效果,进而提高模型的整体检测准确率。

2. CBAM 注意力机制

2.1 方法介绍

CBAM注意力机制是由通道注意力机制(channel)和空间注意力机制(spatial)组成。

CNAM注意力机制的优点:

(1)轻量化程度高:CBAM模块内部无大量卷积结构,少量池化层和特征融合操作,这种结构避免了卷积乘法带来的大量计算,使得其模块复杂度低,计算量小。实验证明,在轻量模型上添加CBAM模块能够带来稳定的性能提升,相较于其带来的少量的计算量的增加,CBAM的引入具有很局的性价比。

(2)通用性强:其结构特点决定了CBAM的通用性强,可移植性高,主要体现在两方面:一方面,基于池化操作的CBAM模块能够直接嵌入到卷积操作后,这意味着该模块可以添加到诸如VGG的传统神经网络中,同时也可以添加到包含基于shortcut连接的残差结构的网络中,如ResNet50、MobileNetV3;另一方面,CBAM同时适用于目标检测和分类任务,且对于不同数据特征的数据集,在检测或者分类精度上均能取得较好的性能提升。

(3)作用效果佳:传统基于卷积神经网络的注意力机制更多的是关注对通道域的分析,局限于考虑特征图通道之间的作用关系。CBAM从 channel 和 spatial 两个作用域出发,引入空间注意力和通道注意力两个分析维度,实现从通道到空间的顺序注意力结构。空间注意力可使神经网络更加关注图像中对分类起决定作用的像素区域而忽略无关紧要的区域,通道注意力则用于处理特征图通道的分配关系,同时对两个维度进行注意力分配增强了注意力机制对模型性能的提升效果。

2.2 网络结构

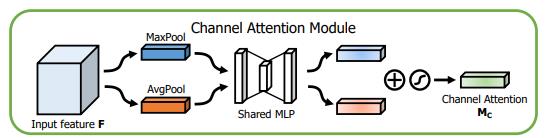

(1)通道注意力机制

CBAM中的通道注意力机制模块流程图如下。先将输入特征图分别进行全局最大池化和全局平均池化,对特征映射基于两个维度压缩,获得两张不同维度的特征描述。池化后的特征图共用一个多层感知器网络,先通过1*1卷积降维再1*1卷积升维。将两张特征图叠加layers.add(),经过sigmoid激活函数归一化特征图的每个通道的权重。将归一化后的权重和输入特征图相乘。

代码展示

#(1)通道注意力

def channel_attenstion(inputs, ratio=0.25):

'''ratio代表第一个全连接层下降通道数的倍数'''

channel = inputs.shape[-1] # 获取输入特征图的通道数

# 分别对输出特征图进行全局最大池化和全局平均池化

# [h,w,c]==>[None,c]

x_max = layers.GlobalMaxPooling2D()(inputs)

x_avg = layers.GlobalAveragePooling2D()(inputs)

# [None,c]==>[1,1,c]

x_max = layers.Reshape([1,1,-1])(x_max) # -1代表自动寻找通道维度的大小

x_avg = layers.Reshape([1,1,-1])(x_avg) # 也可以用变量channel代替-1

# 第一个全连接层通道数下降1/4, [1,1,c]==>[1,1,c//4]

x_max = layers.Dense(channel*ratio)(x_max)

x_avg = layers.Dense(channel*ratio)(x_avg)

# relu激活函数

x_max = layers.Activation('relu')(x_max)

x_avg = layers.Activation('relu')(x_avg)

# 第二个全连接层上升通道数, [1,1,c//4]==>[1,1,c]

x_max = layers.Dense(channel)(x_max)

x_avg = layers.Dense(channel)(x_avg)

# 结果在相叠加 [1,1,c]+[1,1,c]==>[1,1,c]

x = layers.Add()([x_max, x_avg])

# 经过sigmoid归一化权重

x = tf.nn.sigmoid(x)

# 输入特征图和权重向量相乘,给每个通道赋予权重

x = layers.Multiply()([inputs, x]) # [h,w,c]*[1,1,c]==>[h,w,c]

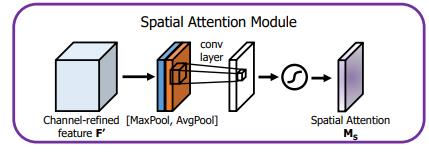

return x(2)空间注意力机制

CBAM中的空间注意力机制模块如下。对通道注意力机制的输出特征图进行空间域的处理。首先,特征图分别经过基于通道维度的最大池化和平均池化,将输出的两张特征图在通道维度堆叠 layers.concatenate()。然后使用1*1卷积调整通道数,最后经过sigmoid函数归一化权重。将归一化权重和输入特征度相乘。

代码展示

#(2)空间注意力机制

def spatial_attention(inputs):

# 在通道维度上做最大池化和平均池化[b,h,w,c]==>[b,h,w,1]

# keepdims=Fale那么[b,h,w,c]==>[b,h,w]

x_max = tf.reduce_max(inputs, axis=3, keepdims=True) # 在通道维度求最大值

x_avg = tf.reduce_mean(inputs, axis=3, keepdims=True) # axis也可以为-1

# 在通道维度上堆叠[b,h,w,2]

x = layers.concatenate([x_max, x_avg])

# 1*1卷积调整通道[b,h,w,1]

x = layers.Conv2D(filters=1, kernel_size=(1,1), strides=1, padding='same')(x)

# sigmoid函数权重归一化

x = tf.nn.sigmoid(x)

# 输入特征图和权重相乘

x = layers.Multiply()([inputs, x])

return x(3)总体流程

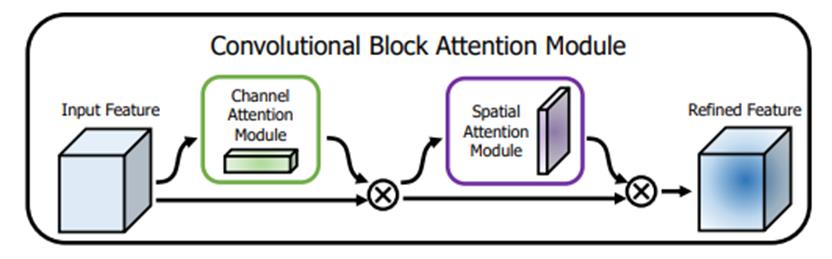

CBAM的总体流程图如下。输入特征图想经过通道注意力机制,将权重和输入特征图相乘后再送入空间注意力机制,将归一化权重和空间注意力机制的输入特征图相乘,得到最终的特征图。

完整代码展示

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras import layers, Model

#(1)通道注意力

def channel_attenstion(inputs, ratio=0.25):

'''ratio代表第一个全连接层下降通道数的倍数'''

channel = inputs.shape[-1] # 获取输入特征图的通道数

# 分别对输出特征图进行全局最大池化和全局平均池化

# [h,w,c]==>[None,c]

x_max = layers.GlobalMaxPooling2D()(inputs)

x_avg = layers.GlobalAveragePooling2D()(inputs)

# [None,c]==>[1,1,c]

x_max = layers.Reshape([1,1,-1])(x_max) # -1代表自动寻找通道维度的大小

x_avg = layers.Reshape([1,1,-1])(x_avg) # 也可以用变量channel代替-1

# 第一个全连接层通道数下降1/4, [1,1,c]==>[1,1,c//4]

x_max = layers.Dense(channel*ratio)(x_max)

x_avg = layers.Dense(channel*ratio)(x_avg)

# relu激活函数

x_max = layers.Activation('relu')(x_max)

x_avg = layers.Activation('relu')(x_avg)

# 第二个全连接层上升通道数, [1,1,c//4]==>[1,1,c]

x_max = layers.Dense(channel)(x_max)

x_avg = layers.Dense(channel)(x_avg)

# 结果在相叠加 [1,1,c]+[1,1,c]==>[1,1,c]

x = layers.Add()([x_max, x_avg])

# 经过sigmoid归一化权重

x = tf.nn.sigmoid(x)

# 输入特征图和权重向量相乘,给每个通道赋予权重

x = layers.Multiply()([inputs, x]) # [h,w,c]*[1,1,c]==>[h,w,c]

return x

#(2)空间注意力机制

def spatial_attention(inputs):

# 在通道维度上做最大池化和平均池化[b,h,w,c]==>[b,h,w,1]

# keepdims=Fale那么[b,h,w,c]==>[b,h,w]

x_max = tf.reduce_max(inputs, axis=3, keepdims=True) # 在通道维度求最大值

x_avg = tf.reduce_mean(inputs, axis=3, keepdims=True) # axis也可以为-1

# 在通道维度上堆叠[b,h,w,2]

x = layers.concatenate([x_max, x_avg])

# 1*1卷积调整通道[b,h,w,1]

x = layers.Conv2D(filters=1, kernel_size=(1,1), strides=1, padding='same')(x)

# sigmoid函数权重归一化

x = tf.nn.sigmoid(x)

# 输入特征图和权重相乘

x = layers.Multiply()([inputs, x])

return x

#(3)CBAM注意力

def CBAM_attention(inputs):

# 先经过通道注意力再经过空间注意力

x = channel_attenstion(inputs)

x = spatial_attention(x)

return x

#(4)构建模型结构

if __name__ == '__main__':

# 构建输入层

inputs = keras.Input(shape=[26,26,512])

# CBAM注意力机制

x = CBAM_attention(inputs)

# 构建模型

model = Model(inputs, x)

# 查看模型结构

model.summary()参数量如下

Total params: 263,427

Trainable params: 263,427

Non-trainable params: 03. DANet 注意力机制

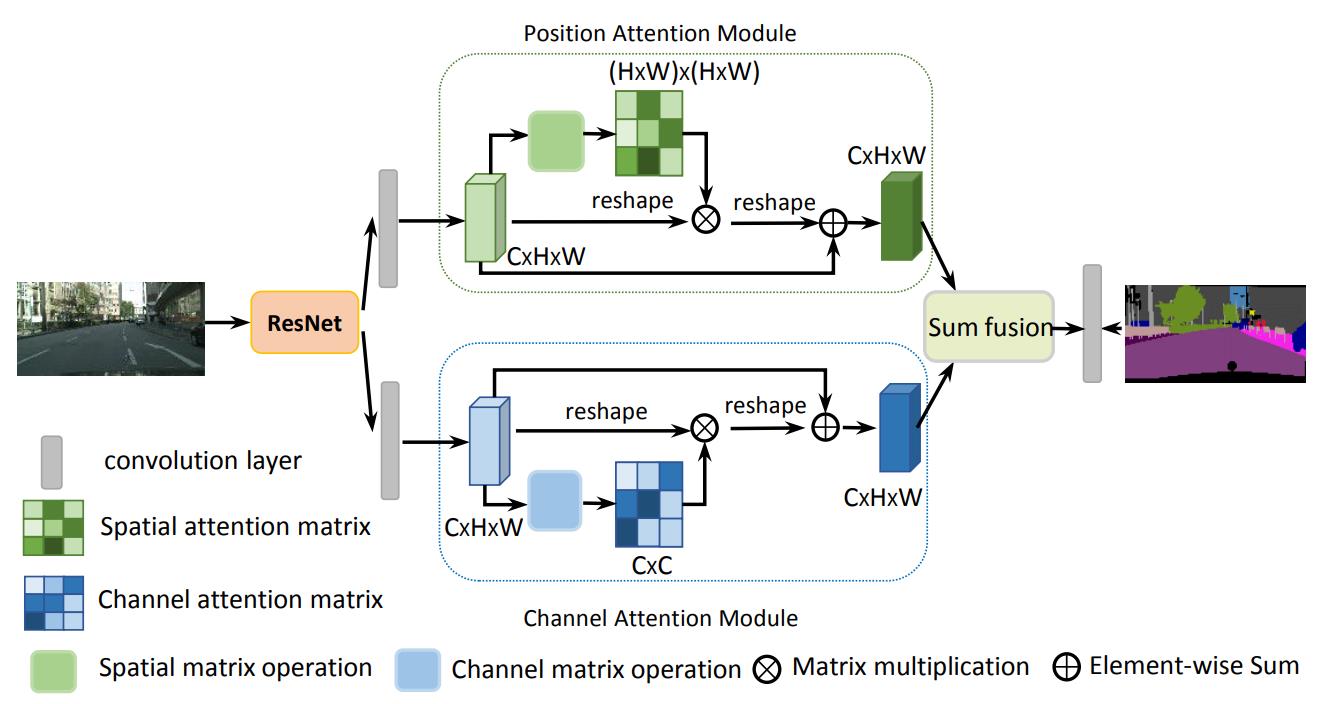

DANet 注意力机制由位置注意力机制(position)和通道注意力机制(channel)组合而成。

位置注意力机制负责捕获特征图在任意两个位置的空间依赖关系,无论距离如何,类似的特征都会彼此相关。通道注意力机制负责整合所有通道映射之间的相关特征来选择性地强调存在相互依赖的通道映射。

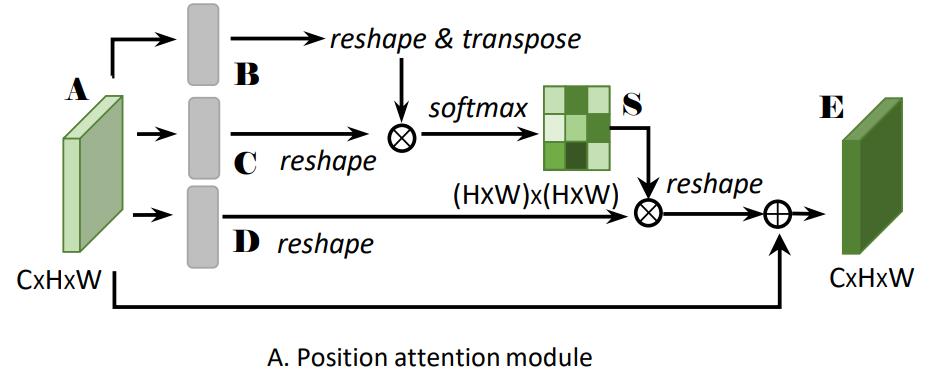

3.1 位置注意力机制

位置注意力机制的流程图如下

(1)输入特征图A(C×H×W)首先分别通过3个卷积层得到3个特征图B,C,D,然后将B,C,D reshape为C×N,其中N=H×W

(2)然后将reshape后的特征图B的转置(NxC)与reshape后的特征图C(CxN)矩阵相乘tf.multul(),再通过softmax得到归一化后的权重 S(N×N)

(3)接着在reshape后的特征图D(CxN)和权重S的转置(NxN)之间执行矩阵乘法tf.multul(),再乘以尺度系数α,再reshape为原来形状,其中α初始化为0,并逐渐的学习得到更大的权重

(4)最后与输入特征图A相叠加layers.add()得到最后的输出E

代码展示

# 位置注意力

def position_attention(inputs):

# 定义可训练变量,反向传播可更新

gama = tf.Variable(tf.ones(1)) # 初始化1

# 获取输入特征图的shape

b, h, w, c = inputs.shape

# 深度可分离卷积[b,h,w,c]==>[b,h,w,c//8]

x1 = layers.SeparableConv2D(filters=c//8, kernel_size=(1,1), strides=1, padding='same')(inputs)

# 调整维度排序[b,h,w,c//8]==>[b,c//8,h,w]

x1_trans = tf.transpose(x1, perm=[0,3,1,2])

# 重塑特征图尺寸[b,c//8,h,w]==>[b,c//8,h*w]

x1_trans_reshape = tf.reshape(x1_trans, shape=[-1,c//8,h*w])

# 调整维度排序[b,c//8,h*w]==>[b,h*w,c//8]

x1_trans_reshape_trans = tf.transpose(x1_trans_reshape, perm=[0,2,1])

# 矩阵相乘

x1_mutmul = x1_trans_reshape_trans @ x1_trans_reshape

# 经过softmax归一化权重

x1_mutmul = tf.nn.softmax(x1_mutmul)

# 深度可分离卷积[b,h,w,c]==>[b,h,w,c]

x2 = layers.SeparableConv2D(filters=c, kernel_size=(1,1), strides=1, padding='same')(inputs)

# 调整维度排序[b,h,w,c]==>[b,c,h,w]

x2_trans = tf.transpose(x2, perm=[0,3,1,2])

# 重塑尺寸[b,c,h,w]==>[b,c,h*w]

x2_trans_reshape = tf.reshape(x2_trans, shape=[-1,c,h*w])

# 调整x1_mutmul的轴,和x2矩阵相乘

x1_mutmul_trans = tf.transpose(x1_mutmul, perm=[0,2,1])

x2_mutmul = x2_trans_reshape @ x1_mutmul_trans

# 重塑尺寸[b,c,h*w]==>[b,c,h,w]

x2_mutmul = tf.reshape(x2_mutmul, shape=[-1,c,h,w])

# 轴变换[b,c,h,w]==>[b,h,w,c]

x2_mutmul = tf.transpose(x2_mutmul, perm=[0,2,3,1])

# 结果乘以可训练变量

x2_mutmul = x2_mutmul * gama

# 输入和输出叠加

x = layers.add([x2_mutmul, inputs])

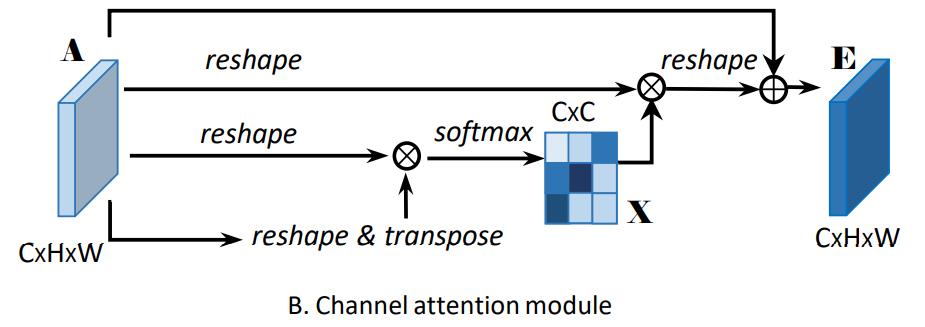

return x3.2 通道注意力模块

通道注意力模块的流程图如下。

(1)分别对特征图A做reshape(CxN)以及reshape与transpose(NxC);

(2)将得到的两个特征图矩阵相乘tf.multul(),再通过softmax得到归一化后的权重X(C×C);

(3)接着把权重X的转置(CxC)与reshape后的特征图A(CxN)做矩阵乘法tf.multul(),再乘以尺度系数β,再reshape为原来形状。其中β初始化为0,并逐渐的学习得到更大的权重

(4)最后与输入特征图A相叠加得到最后的输出特征图E

代码展示

# 通道注意力

def channel_attention(inputs):

# 定义可训练变量,反向传播可更新

gama = tf.Variable(tf.ones(1)) # 初始化1

# 获取输入特征图的shape

b, h, w, c = inputs.shape

# 重新排序维度[b,h,w,c]==>[b,c,h,w]

x = tf.transpose(inputs, perm=[0,3,1,2]) # perm代表重新排序的轴

# 重塑特征图尺寸[b,c,h,w]==>[b,c,h*w]

x_reshape = tf.reshape(x, shape=[-1,c,h*w])

# 重新排序维度[b,c,h*w]==>[b,h*w,c]

x_reshape_trans = tf.transpose(x_reshape, perm=[0,2,1]) # 指定需要交换的轴

# 矩阵相乘

x_mutmul = x_reshape_trans @ x_reshape

# 经过softmax归一化权重

x_mutmul = tf.nn.softmax(x_mutmul)

# reshape后的特征图与归一化权重矩阵相乘[b,x,h*w]

x = x_reshape @ x_mutmul

# 重塑形状[b,c,h*w]==>[b,c,h,w]

x = tf.reshape(x, shape=[-1,c,h,w])

# 重新排序维度[b,c,h,w]==>[b,h,w,c]

x = tf.transpose(x, perm=[0,2,3,1])

# 结果乘以可训练变量

x = x * gama

# 输入和输出特征图叠加

x = layers.add([x, inputs])

return x3.3 总体流程

DANet的总体流程图如下,输入图像分别经过位置注意力机制和通道注意力机制,将输出的特征图叠加layers.add(),得到输出特征图。

完整代码展示

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras import layers, Model

#(1)通道注意力

def channel_attention(inputs):

# 定义可训练变量,反向传播可更新

gama = tf.Variable(tf.ones(1)) # 初始化1

# 获取输入特征图的shape

b, h, w, c = inputs.shape

# 重新排序维度[b,h,w,c]==>[b,c,h,w]

x = tf.transpose(inputs, perm=[0,3,1,2]) # perm代表重新排序的轴

# 重塑特征图尺寸[b,c,h,w]==>[b,c,h*w]

x_reshape = tf.reshape(x, shape=[-1,c,h*w])

# 重新排序维度[b,c,h*w]==>[b,h*w,c]

x_reshape_trans = tf.transpose(x_reshape, perm=[0,2,1]) # 指定需要交换的轴

# 矩阵相乘

x_mutmul = x_reshape_trans @ x_reshape

# 经过softmax归一化权重

x_mutmul = tf.nn.softmax(x_mutmul)

# reshape后的特征图与归一化权重矩阵相乘[b,x,h*w]

x = x_reshape @ x_mutmul

# 重塑形状[b,c,h*w]==>[b,c,h,w]

x = tf.reshape(x, shape=[-1,c,h,w])

# 重新排序维度[b,c,h,w]==>[b,h,w,c]

x = tf.transpose(x, perm=[0,2,3,1])

# 结果乘以可训练变量

x = x * gama

# 输入和输出特征图叠加

x = layers.add([x, inputs])

return x

#(2)位置注意力

def position_attention(inputs):

# 定义可训练变量,反向传播可更新

gama = tf.Variable(tf.ones(1)) # 初始化1

# 获取输入特征图的shape

b, h, w, c = inputs.shape

# 深度可分离卷积[b,h,w,c]==>[b,h,w,c//8]

x1 = layers.SeparableConv2D(filters=c//8, kernel_size=(1,1), strides=1, padding='same')(inputs)

# 调整维度排序[b,h,w,c//8]==>[b,c//8,h,w]

x1_trans = tf.transpose(x1, perm=[0,3,1,2])

# 重塑特征图尺寸[b,c//8,h,w]==>[b,c//8,h*w]

x1_trans_reshape = tf.reshape(x1_trans, shape=[-1,c//8,h*w])

# 调整维度排序[b,c//8,h*w]==>[b,h*w,c//8]

x1_trans_reshape_trans = tf.transpose(x1_trans_reshape, perm=[0,2,1])

# 矩阵相乘

x1_mutmul = x1_trans_reshape_trans @ x1_trans_reshape

# 经过softmax归一化权重

x1_mutmul = tf.nn.softmax(x1_mutmul)

# 深度可分离卷积[b,h,w,c]==>[b,h,w,c]

x2 = layers.SeparableConv2D(filters=c, kernel_size=(1,1), strides=1, padding='same')(inputs)

# 调整维度排序[b,h,w,c]==>[b,c,h,w]

x2_trans = tf.transpose(x2, perm=[0,3,1,2])

# 重塑尺寸[b,c,h,w]==>[b,c,h*w]

x2_trans_reshape = tf.reshape(x2_trans, shape=[-1,c,h*w])

# 调整x1_mutmul的轴,和x2矩阵相乘

x1_mutmul_trans = tf.transpose(x1_mutmul, perm=[0,2,1])

x2_mutmul = x2_trans_reshape @ x1_mutmul_trans

# 重塑尺寸[b,c,h*w]==>[b,c,h,w]

x2_mutmul = tf.reshape(x2_mutmul, shape=[-1,c,h,w])

# 轴变换[b,c,h,w]==>[b,h,w,c]

x2_mutmul = tf.transpose(x2_mutmul, perm=[0,2,3,1])

# 结果乘以可训练变量

x2_mutmul = x2_mutmul * gama

# 输入和输出叠加

x = layers.add([x2_mutmul, inputs])

return x

#(3)DANet网络架构

def danet(inputs):

# 输入分为两个分支

x1 = channel_attention(inputs) # 通道注意力

x2 = position_attention(inputs) # 位置注意力

# 叠加两个注意力的结果

x = layers.add([x1,x2])

return x

# 构建网络

if __name__ == '__main__':

# 构造输入层

inputs = keras.Input(shape=[26,26,512])

# 经过DANet注意力机制返回结果

outputs = danet(inputs)

# 构造模型

model = Model(inputs, outputs)

# 查看模型结构

model.summary()查看网络参数量

Total params: 296,512

Trainable params: 296,512

Non-trainable params: 0深度学习--图像处理中的注意力机制

文章目录

前言

注意力机制是一个非常有效的trick,注意力机制的实现方式有许多。可以在知网上搜索一下yolov下的目标监测的硕士论文,没有一篇不提到注意力机制的迭代修改的,所以很有必要学一下.

最后给出了一个例子。

注意力机制

注意力机制是深度学习常用的一个小技巧,它有多种多样的实现形式,每一种注意力机制的实现的核心都是类似的,核心重点就是让网络关注到它更需要关注的地方。

当使用卷积神经网络去处理图片的时候,我们会更希望卷积神经网络去注意应该注意的地方,而不是什么都关注,因此,如何让卷积神经网络去自适应的注意重要的物体变得极为重要。

因此一句话总结:注意力机制就是实现网络自适应注意的一个方式。

注意力机制分为三类:通道注意力机制,空间注意力机制,以及二者的结合。

注意力机制的实现方式

在深度学习中,常见的注意力机制的实现方式有SENet,CBAM,ECA等等。

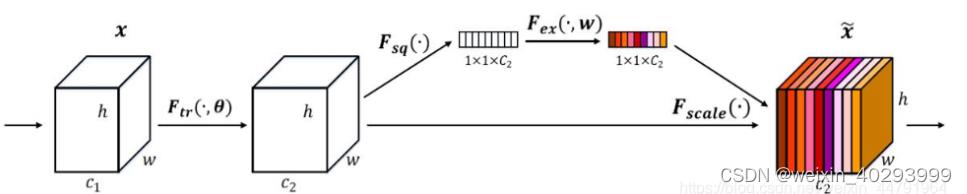

SENet的实现

SENet是通道注意力机制,它是最后一届ImageNet竞赛的冠军。对于SENet而言,其重点是获得输入进来的特征层,每一个通道的权值。利用SENet,我们可以让网络关注它最需要关注的通道。

实现步骤:

1、对输入进来的特征层进行全局平均池化。

2、然后进行两次全连接,第一次全连接神经元个数较少,第二次全连接神经元个数和输入特征层相同。

3、在完成两次全连接后,我们再取一次Sigmoid将值固定到0-1之间,此时我们获得了输入特征层每一个通道的权值(0-1之间)。

4、在获得这个权值后,我们将这个权值乘上原输入特征层即可。

实现代码:

import torch

import torch.nn as nn

import math

class se_block(nn.Module):

def __init__(self, channel, ratio=16):

super(se_block, self).__init__()

self.avg_pool = nn.AdaptiveAvgPool2d(1)

self.fc = nn.Sequential(

nn.Linear(channel, channel // ratio, bias=False),

nn.ReLU(inplace=True),

nn.Linear(channel // ratio, channel, bias=False),

nn.Sigmoid()

)

def forward(self, x):

b, c, _, _ = x.size()

y = self.avg_pool(x).view(b, c)

y = self.fc(y).view(b, c, 1, 1)

return x * y

追加一个使用案例

if __name__ == '__main__':

#inut: 构建数据 bz = 8 c= 64 w =227 h=227

data = np.random.randn(8,64,227,227)

data = torch.from_numpy(data)

data = data.to(torch.float32)

seblock = se_block(64,2)

res = seblock(data)

print(res)

# output 输出:torch.Size([8, 64, 227, 227])

输入还是等于输出,可是却是已经获取和注意力的特征.正是因为这个特点,所以注意力机制可以任意插拔。 输入等于输出,可以侵入搭建block的任意模块!

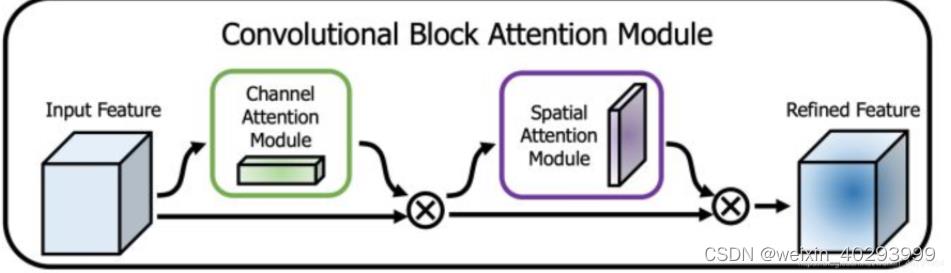

CBAM的实现

CBAM将通道注意力机制和空间注意力机制进行一个结合,相比于SENet只关注通道的注意力机制可以取得更好的效果。其实现示意图如下所示,CBAM会对输入进来的特征层,分别进行通道注意力机制的处理和空间注意力机制的处理。

通道注意力机制和空间注意力机制的具体实现方式如下图:

图像的上半部分为通道注意力机制,通道注意力机制的实现可以分为两个部分,我们会对输入进来的单个特征层,分别进行全局平均池化和全局最大池化。之后对平均池化和最大池化的结果,利用共享的全连接层进行处理,我们会对处理后的两个结果进行相加,然后取一个sigmoid,此时我们获得了输入特征层每一个通道的权值(0-1之间)。在获得这个权值后,我们将这个权值乘上原输入特征层即可。

图像的下半部分为空间注意力机制,我们会对输入进来的特征层,在每一个特征点的通道上取最大值和平均值。之后将这两个结果进行一个堆叠,利用一次通道数为1的卷积调整通道数,然后取一个sigmoid,此时我们获得了输入特征层每一个特征点的权值(0-1之间)。在获得这个权值后,我们将这个权值乘上原输入特征层即可。

class ChannelAttention(nn.Module):

def __init__(self, in_planes, ratio=8):

super(ChannelAttention, self).__init__()

self.avg_pool = nn.AdaptiveAvgPool2d(1)

self.max_pool = nn.AdaptiveMaxPool2d(1)

# 利用1x1卷积代替全连接

self.fc1 = nn.Conv2d(in_planes, in_planes // ratio, 1, bias=False)

self.relu1 = nn.ReLU()

self.fc2 = nn.Conv2d(in_planes // ratio, in_planes, 1, bias=False)

self.sigmoid = nn.Sigmoid()

def forward(self, x):

avg_out = self.fc2(self.relu1(self.fc1(self.avg_pool(x))))

max_out = self.fc2(self.relu1(self.fc1(self.max_pool(x))))

out = avg_out + max_out

return self.sigmoid(out)

class SpatialAttention(nn.Module):

def __init__(self, kernel_size=7):

super(SpatialAttention, self).__init__()

assert kernel_size in (3, 7), 'kernel size must be 3 or 7'

padding = 3 if kernel_size == 7 else 1

self.conv1 = nn.Conv2d(2, 1, kernel_size, padding=padding, bias=False)

self.sigmoid = nn.Sigmoid()

def forward(self, x):

avg_out = torch.mean(x, dim=1, keepdim=True)

max_out, _ = torch.max(x, dim=1, keepdim=True)

x = torch.cat([avg_out, max_out], dim=1)

x = self.conv1(x)

return self.sigmoid(x)

class cbam_block(nn.Module):

def __init__(self, channel, ratio=8, kernel_size=7):

super(cbam_block, self).__init__()

self.channelattention = ChannelAttention(channel, ratio=ratio)

self.spatialattention = SpatialAttention(kernel_size=kernel_size)

def forward(self, x):

x = x * self.channelattention(x)

x = x * self.spatialattention(x)

return x

ECA的实现

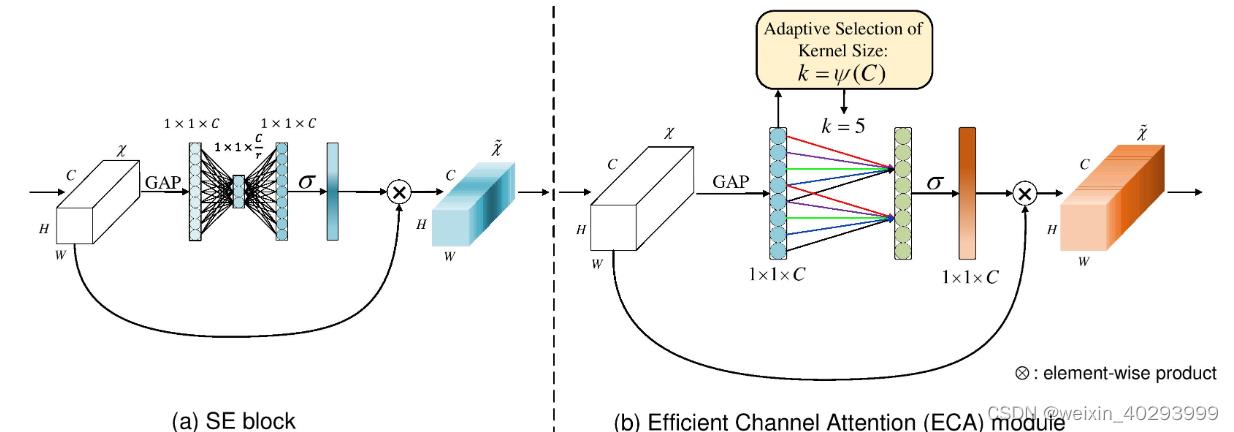

ECANet是也是通道注意力机制的一种实现形式。ECANet可以看作是SENet的改进版。

ECANet的作者认为SENet对通道注意力机制的预测带来了副作用,捕获所有通道的依赖关系是低效并且是不必要的,并且认为卷积具有良好的跨通道信息获取能力。

ECA模块的思想是非常简单的,它去除了原来SE模块中的全连接层,直接在全局平均池化之后的特征上通过一个1D卷积进行学习。

既然使用到了1D卷积,那么1D卷积的卷积核大小的选择就变得非常重要了,了解过卷积原理的同学很快就可以明白,1D卷积的卷积核大小会影响注意力机制每个权重的计算要考虑的通道数量。用更专业的名词就是跨通道交互的覆盖率。

如下图所示,左图是常规的SE模块,右图是ECA模块。ECA模块用1D卷积替换两次全连接。

class eca_block(nn.Module):

def __init__(self, channel, b=1, gamma=2):

super(eca_block, self).__init__()

kernel_size = int(abs((math.log(channel, 2) + b) / gamma))

kernel_size = kernel_size if kernel_size % 2 else kernel_size + 1

self.avg_pool = nn.AdaptiveAvgPool2d(1)

self.conv = nn.Conv1d(1, 1, kernel_size=kernel_size, padding=(kernel_size - 1) // 2, bias=False)

self.sigmoid = nn.Sigmoid()

def forward(self, x):

y = self.avg_pool(x)

y = self.conv(y.squeeze(-1).transpose(-1, -2)).transpose(-1, -2).unsqueeze(-1)

y = self.sigmoid(y)

return x * y.expand_as(x)

if __name__ == '__main__':

data = np.random.randn(8,64,227,227)

data = torch.from_numpy(data)

data = data.to(torch.float32)

seblock = eca_block(64,2)

res = seblock(data)

print(res.shape)

即插即用真是好使

注意力机制的应用

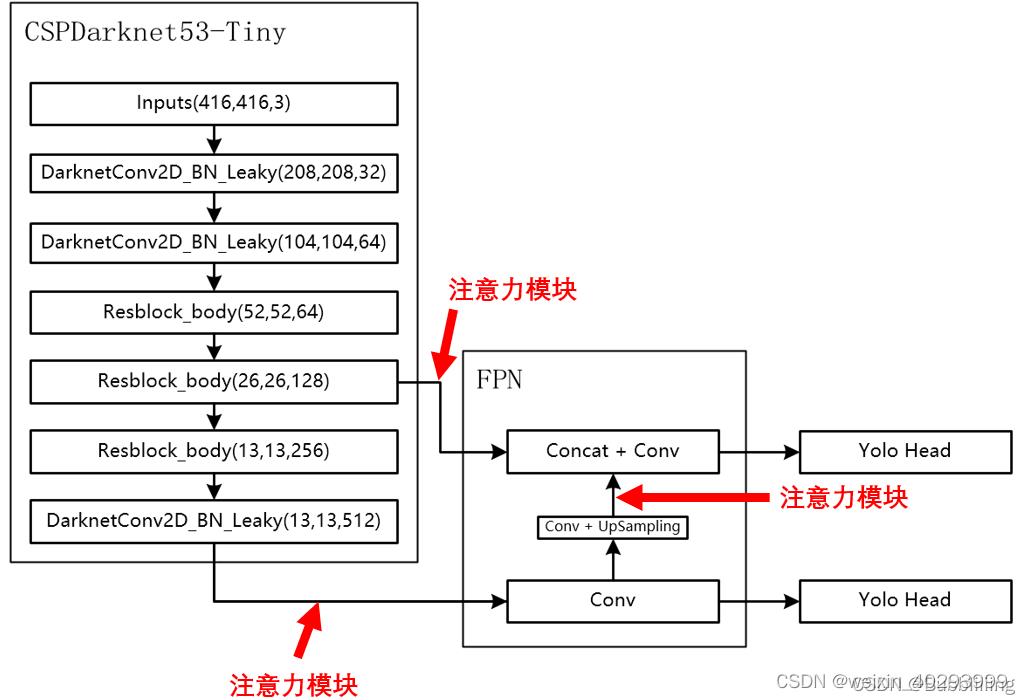

注意力机制是一个即插即用的模块,理论上可以放在任何一个特征层后面,可以放在主干网络,也可以放在加强特征提取网络。

由于放置在主干会导致网络的预训练权重无法使用,本文以YoloV4-tiny为例,将注意力机制应用加强特征提取网络上。

如下图所示,我们在主干网络提取出来的两个有效特征层上增加了注意力机制,同时对上采样后的结果增加了注意力机制。

实现代码如下:

attention_block = [se_block, cbam_block, eca_block]

#---------------------------------------------------#

# 特征层->最后的输出

#---------------------------------------------------#

class YoloBody(nn.Module):

def __init__(self, anchors_mask, num_classes, phi=0):

super(YoloBody, self).__init__()

self.phi = phi

self.backbone = darknet53_tiny(None)

self.conv_for_P5 = BasicConv(512,256,1)

self.yolo_headP5 = yolo_head([512, len(anchors_mask[0]) * (5 + num_classes)],256)

self.upsample = Upsample(256,128)

self.yolo_headP4 = yolo_head([256, len(anchors_mask[1]) * (5 + num_classes)],384)

if 1 <= self.phi and self.phi <= 3:

self.feat1_att = attention_block[self.phi - 1](256)

self.feat2_att = attention_block[self.phi - 1](512)

self.upsample_att = attention_block[self.phi - 1](128)

def forward(self, x):

#---------------------------------------------------#

# 生成CSPdarknet53_tiny的主干模型

# feat1的shape为26,26,256

# feat2的shape为13,13,512

#---------------------------------------------------#

feat1, feat2 = self.backbone(x)

if 1 <= self.phi and self.phi <= 3:

feat1 = self.feat1_att(feat1)

feat2 = self.feat2_att(feat2)

# 13,13,512 -> 13,13,256

P5 = self.conv_for_P5(feat2)

# 13,13,256 -> 13,13,512 -> 13,13,255

out0 = self.yolo_headP5(P5)

# 13,13,256 -> 13,13,128 -> 26,26,128

P5_Upsample = self.upsample(P5)

# 26,26,256 + 26,26,128 -> 26,26,384

if 1 <= self.phi and self.phi <= 3:

P5_Upsample = self.upsample_att(P5_Upsample)

P4 = torch.cat([P5_Upsample,feat1],axis=1)

# 26,26,384 -> 26,26,256 -> 26,26,255

out1 = self.yolo_headP4(P4)

return out0, out1

以上是关于深度学习 CNN中的混合域注意力机制(DANet,CBAM),附Tensorflow完整代码的主要内容,如果未能解决你的问题,请参考以下文章