论文笔记——Intra- and Inter-Action Understanding via Temporal Action Parsing

Posted 不烦人的凡凡

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了论文笔记——Intra- and Inter-Action Understanding via Temporal Action Parsing相关的知识,希望对你有一定的参考价值。

目录

原文链接:跳转

论文主要工作:

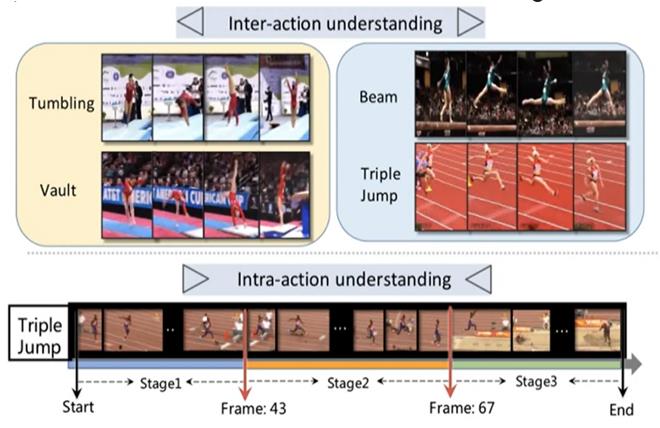

- 进行动作分析——识别子动作,一个动作由多个子动作构成;

- 判断动作关系——不同动作可能存在相似的子动作。

创新点:

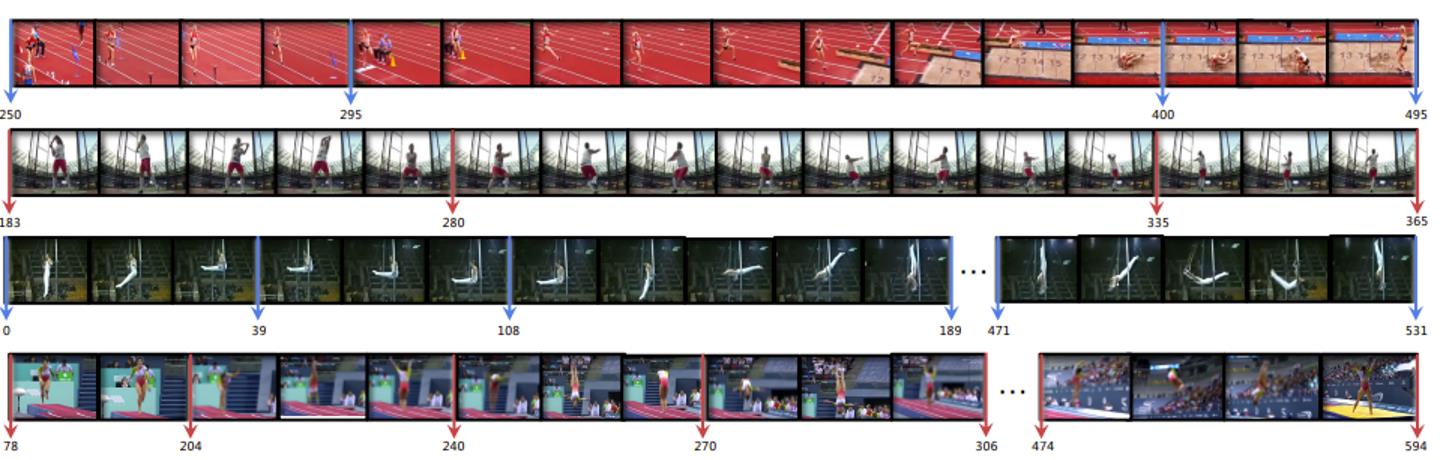

- 构建数据集TAPOS(Temporal Action Parsing of Olympics Sports),对动作进行细粒度上的时间解析注释。

- 设计改进的动作时间解析方法TransPaser,在未知动作标签的情况下,挖掘出子动作,即识别视频中子动作的起始帧。

设计思路:

现有技术和数据集的局限性:

-

缺少对动作本身之外的更深层的解释

-

仅有少数的研究者对动作进行细粒度分析

-

现有的数据集侧重于粗粒度动作类别

-

目前的研究方法中动作背景发挥着很大作用

论文改进

- 以人对动作内部或动作边界较敏感为启发

- 以更细粒度进行动作分析

- 探索动作内部结构

- 寻找不同动作间的联系

| Inter-: 一个子动作可能存在于不同的动作中 Intra-: 子动作是如何构成一个动作实例的 |

数据集特点:

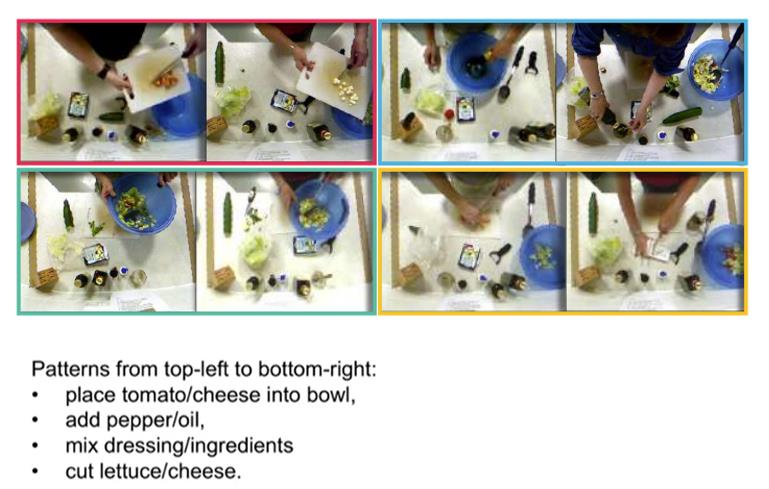

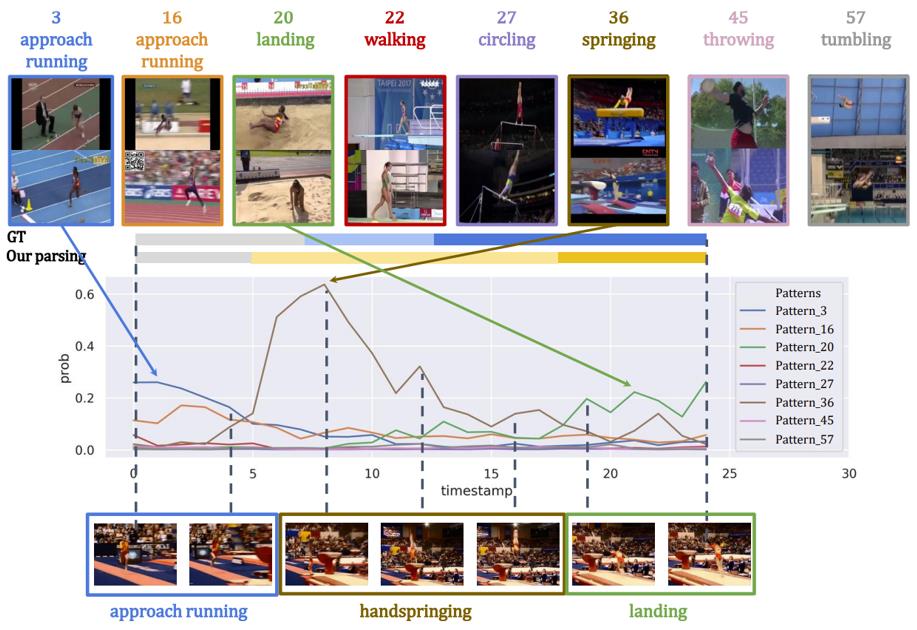

TAPOS数据集,有着一致且干净的背景,更关注于动作本身,标记出子动作的边界

论文方法:

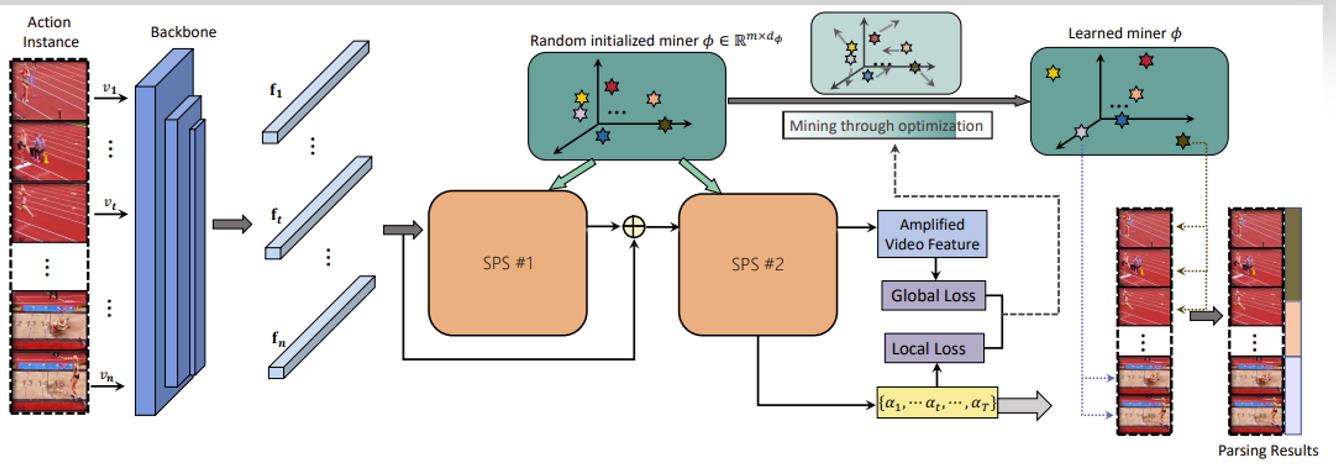

基于transformer改进的TransPaser,在没有子动作标签的情况下,挖掘出子动作

- 输入动作实例的视频帧(Action Instance)

- 经过骨干网络Backbone,提取帧特征fn

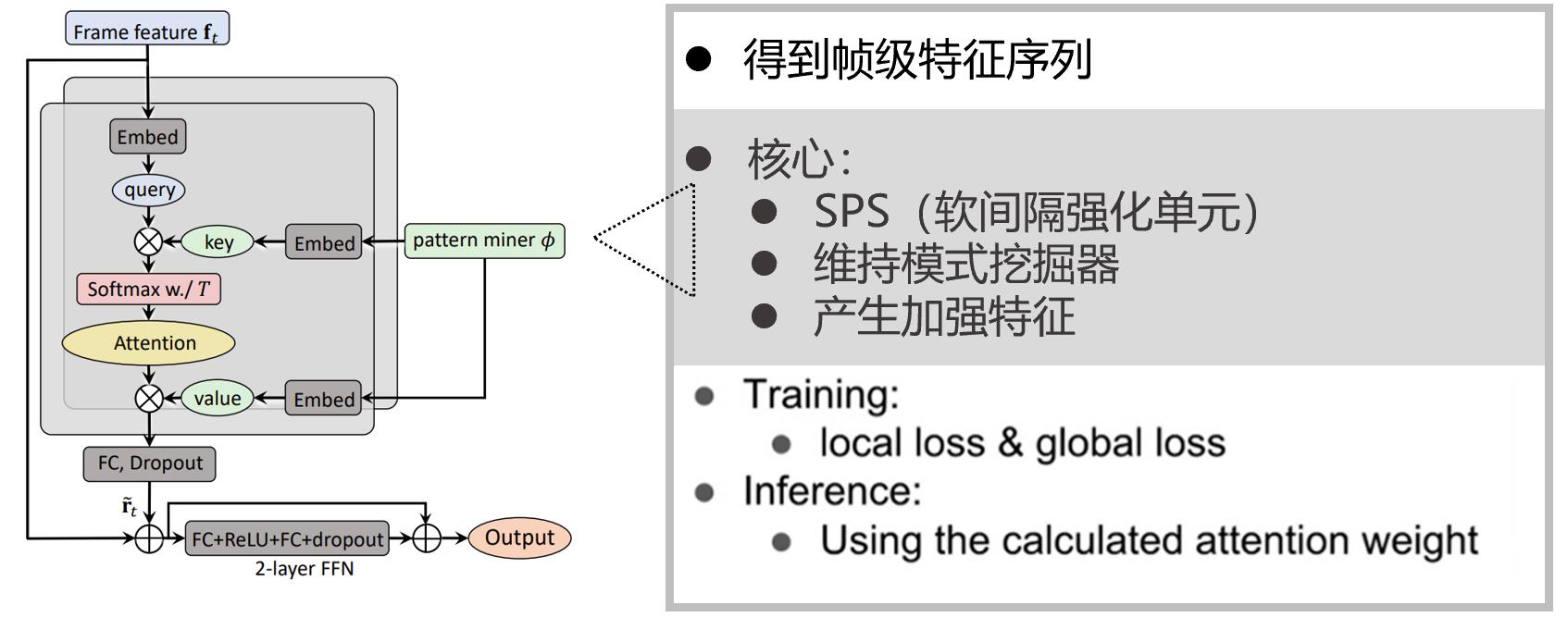

- 将帧特征输入到软间隔强化单元(SPS),与模式挖掘器Φ做一个交互,得到放大特征

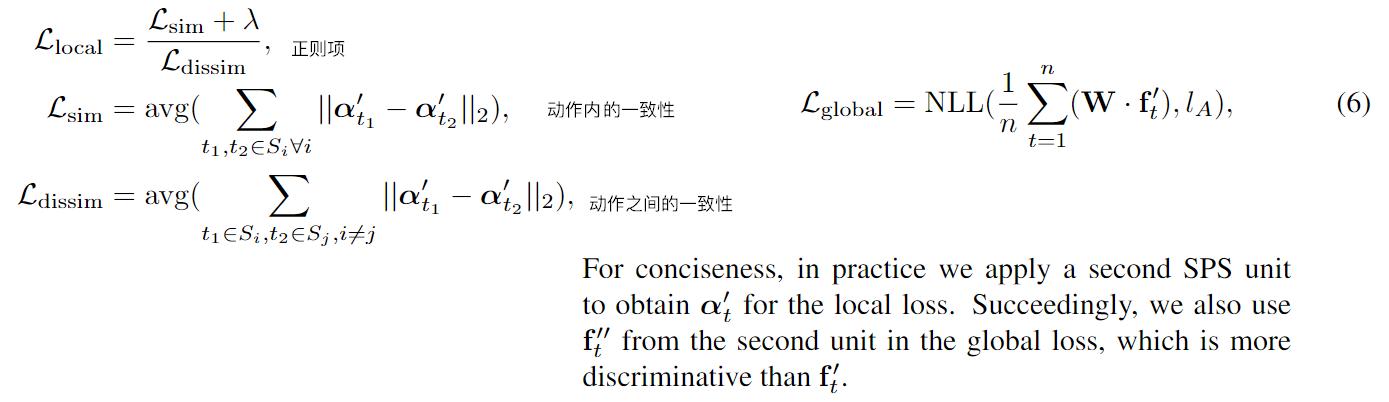

- 两个损失函数进行优化:local loss:最大化子动作内的框架之间的一致性,同时抑制子动作之间的一致性,在动作框架的特征中捕获信息;global loss:行为类别分类的损失

- 方法核心SPS:

实验结果分析:

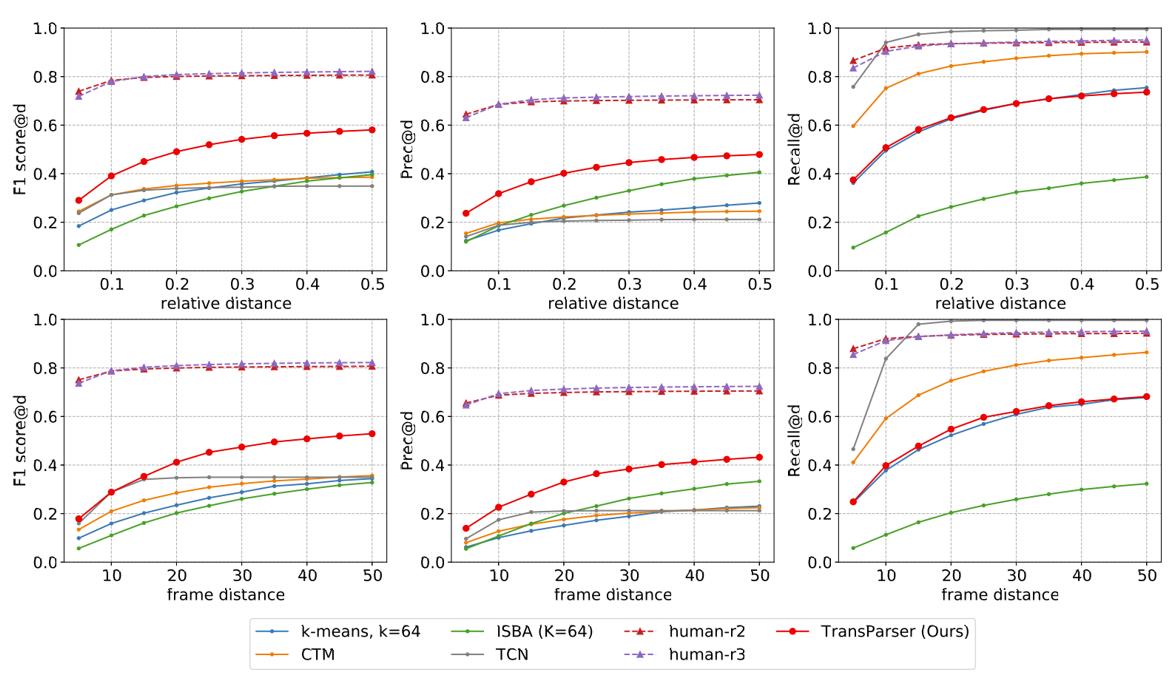

评判标准:召回率,精确度,F1值

基线方法(baseline):TCN,ISBA,CTM,K-Means

定量分析:

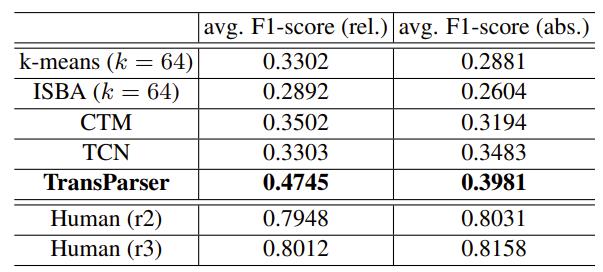

- 该方法的F1值比基线方法有很大优势,但较人的表现还有很大的提升空间

- TCN和CTM有较高的recall,但pre较低,表明它们存在着过度解析,过于关注局部差异

- ISBA在recall上表现较差,但精确度(pre)比CTM和TCN高,可能捕捉得到粗到精的粒度变化,无法利用内部行为信息

- 当增加阈值时,基线方法快速饱和,而该方法的性能持续提高

通过平均F1分数计算得到TAPOS数据集产生的当前动作解析结果

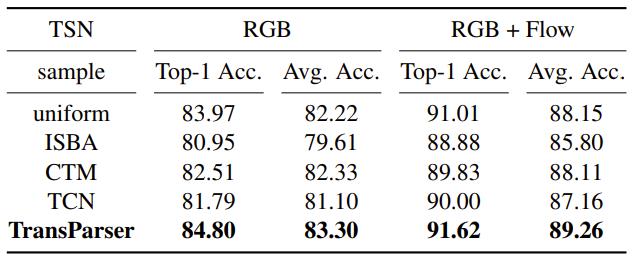

TSN在使用不同的抽样方案在动作分类上的性能表现

TAPOS数据集实验应用:

在50Salads数据集上的应用:

论文可优化的地方:

部分来源:论文

- 不能对长篇视频进行建模

- 检测已分割好的视频,对于未划分的视频的分类可能存在问题

- 对动作进行时间上的划分出子动作,而不是通过用的划分边界

- 视觉速度的巨大变化可能会捕捉不到

- 数据集的逐帧注释成本太高

以上是关于论文笔记——Intra- and Inter-Action Understanding via Temporal Action Parsing的主要内容,如果未能解决你的问题,请参考以下文章

EXPLAINING AND HARNESSING ADVERSARIAL EXAMPLES 论文笔记

Visualizing and Understanding Convolutional Networks(ZFNet网络)-论文阅读笔记

MobileNetV2: Inverted Residuals and Linear Bottlenecks(MobileNetV2)-论文阅读笔记

联邦学习笔记-《Federated Machine Learning: Concept and Applications》论文翻译个人笔记

A_Machine_Vision_Apparatus_and_Method_for_Can-End_Inspection-论文阅读笔记

论文笔记:[ICLR 2020] Tips for prospective and early-stage PhD students