数据标准化、归一化、正则化概念厘定

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了数据标准化、归一化、正则化概念厘定相关的知识,希望对你有一定的参考价值。

参考技术A 网上较为混乱,书上看过又忘了,查找不便,特地总结于此。首先吐槽一点,我记不住,当然有个人记性不好的原因,但更重要的是,本身概念就是混乱的,如身边的同事、网上各类业余的文章(很多文章是有误导性的),甚至某些论文里的定义都不太一样。

进行数据尺度变化的目的,在于更好的训练模型,详见参考资料3。在聚类算法中,不进行尺度变化,会导致错误的结果(量纲不同,取值较小的特征会被取值较大的特征淹没),至于决策树类的算法倒是无此问题(计算信息增益比,是否尺度变化并不影响)。

scaling,是将数据按比例缩放,使之落入一个小的特定区间。

零均值标准化(z-score standardization), ,分布转换为正态分布,均值为0,方差为1,取值[-1,1]。该方法对异常值、噪声不敏感,应用最为广泛,一般在涉及距离度量计算相似性(如KNN、Kmeans聚类)或PCA(核心是计算方差、协方差)时使用。

线性归一化(min-max normalization),该方法在sklearn中被称为另一种形式的standardization。通过对原始数据的线性变换 ,使结果落到[0,1]区间。该方法对原始数据进行线性变化,可保持原始数据之间的联系,缺陷是当有新数据加入时,最大最小值可能改变,需重新计算转换函数。

有朋友可能会问,那在PCA时使用最大最小标准化代替零均值标准化可以么?参考资料3中给出了清晰的证明,有兴趣的朋友可以阅读,大意就是,最大最小标准化使得协方差产生了倍数值缩放,无法消除量纲的影响。

因此,如果需要每个特征值都对整体归一化产生一定影响的话(和分布相关的话),选择零均值标准化。

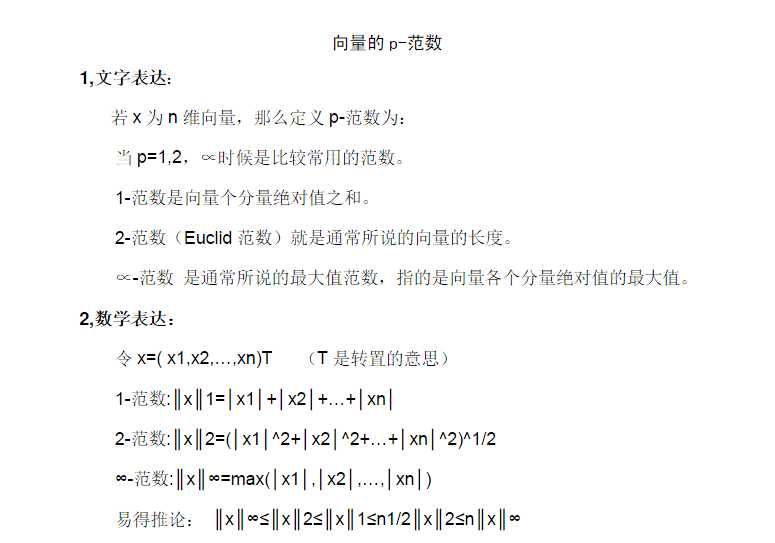

在sklearn中定义为, 缩放单个样本使其具有单位范数的过程,计算方式是计算每个样本的p范数,然后对该样本中的每个元素除以该范数,使得处理后样本的p范数等于1,把数变为(0-1)之间的小数,消除量纲。

该方法主要应用于文本分类和聚类,例如对于TF-IDF向量的l2-norm点积,即得到这两个向量的余弦相似度。

机器学习中对损失函数的操作,非数据特征集进行的尺度变化。

映射到其他分布,如指定区间、均匀分布、高斯分布、np.log1p等,特别是对于较多异常值的数据集时,采用 robust_scale 、 RobustScaler 是更好的选择。

阅读sklearn文档是学习机器学习最好的方式。

附,参考资料:

1、sklearn文档,4.3. 预处理数据,https://www.studyai.cn/modules/preprocessing.html

2、几种数据预处理方法综述,https://www.pythonf.cn/read/152530

3、特征归一化特性及其数学原理推导,http://www.bewindoweb.com/216.html

关于使用sklearn进行数据预处理 —— 归一化/标准化/正则化

转自:https://www.cnblogs.com/chaosimple/p/4153167.html

一、标准化(Z-Score),或者去除均值和方差缩放

公式为:(X-mean)/std 计算时对每个属性/每列分别进行。

将数据按期属性(按列进行)减去其均值,并处以其方差。得到的结果是,对于每个属性/每列来说所有数据都聚集在0附近,方差为1。

实现时,有两种不同的方式:

-

使用sklearn.preprocessing.scale()函数,可以直接将给定数据进行标准化。

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

|

>>> from sklearn import preprocessing>>> import numpy as np>>> X = np.array([[ 1., -1., 2.],... [ 2., 0., 0.],... [ 0., 1., -1.]])>>> X_scaled = preprocessing.scale(X)>>> X_scaled array([[ 0. ..., -1.22..., 1.33...], [ 1.22..., 0. ..., -0.26...], [-1.22..., 1.22..., -1.06...]])>>>#处理后数据的均值和方差>>> X_scaled.mean(axis=0)array([ 0., 0., 0.])>>> X_scaled.std(axis=0)array([ 1., 1., 1.]) |

-

使用sklearn.preprocessing.StandardScaler类,使用该类的好处在于可以保存训练集中的参数(均值、方差)直接使用其对象转换测试集数据。

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

|

>>> scaler = preprocessing.StandardScaler().fit(X)>>> scalerStandardScaler(copy=True, with_mean=True, with_std=True)>>> scaler.mean_ array([ 1. ..., 0. ..., 0.33...])>>> scaler.std_ array([ 0.81..., 0.81..., 1.24...])>>> scaler.transform(X) array([[ 0. ..., -1.22..., 1.33...], [ 1.22..., 0. ..., -0.26...], [-1.22..., 1.22..., -1.06...]])>>>#可以直接使用训练集对测试集数据进行转换>>> scaler.transform([[-1., 1., 0.]]) array([[-2.44..., 1.22..., -0.26...]]) |

二、将属性缩放到一个指定范围

除了上述介绍的方法之外,另一种常用的方法是将属性缩放到一个指定的最大和最小值(通常是1-0)之间,这可以通过preprocessing.MinMaxScaler类实现。

使用这种方法的目的包括:

1、对于方差非常小的属性可以增强其稳定性。

2、维持稀疏矩阵中为0的条目。

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

|

>>> X_train = np.array([[ 1., -1., 2.],... [ 2., 0., 0.],... [ 0., 1., -1.]])...>>> min_max_scaler = preprocessing.MinMaxScaler()>>> X_train_minmax = min_max_scaler.fit_transform(X_train)>>> X_train_minmaxarray([[ 0.5 , 0. , 1. ], [ 1. , 0.5 , 0.33333333], [ 0. , 1. , 0. ]])>>> #将相同的缩放应用到测试集数据中>>> X_test = np.array([[ -3., -1., 4.]])>>> X_test_minmax = min_max_scaler.transform(X_test)>>> X_test_minmaxarray([[-1.5 , 0. , 1.66666667]])>>> #缩放因子等属性>>> min_max_scaler.scale_ array([ 0.5 , 0.5 , 0.33...])>>> min_max_scaler.min_ array([ 0. , 0.5 , 0.33...]) |

当然,在构造类对象的时候也可以直接指定最大最小值的范围:feature_range=(min, max),此时应用的公式变为:

X_std=(X-X.min(axis=0))/(X.max(axis=0)-X.min(axis=0))

X_scaled=X_std/(max-min)+min

三、正则化(Normalization)

正则化的过程是将每个样本缩放到单位范数(每个样本的范数为1),如果后面要使用如二次型(点积)或者其它核方法计算两个样本之间的相似性这个方法会很有用。

Normalization主要思想是对每个样本计算其p-范数,然后对该样本中每个元素除以该范数,这样处理的结果是使得每个处理后样本的p-范数(l1-norm,l2-norm)等于1。

该方法主要应用于文本分类和聚类中。例如,对于两个TF-IDF向量的l2-norm进行点积,就可以得到这两个向量的余弦相似性。

1、可以使用preprocessing.normalize()函数对指定数据进行转换:

|

1

2

3

4

5

6

7

8

9

|

>>> X = [[ 1., -1., 2.],... [ 2., 0., 0.],... [ 0., 1., -1.]]>>> X_normalized = preprocessing.normalize(X, norm=‘l2‘)>>> X_normalized array([[ 0.40..., -0.40..., 0.81...], [ 1. ..., 0. ..., 0. ...], [ 0. ..., 0.70..., -0.70...]]) |

2、可以使用processing.Normalizer()类实现对训练集和测试集的拟合和转换:

|

1

2

3

4

5

6

7

8

9

10

11

12

|

>>> normalizer = preprocessing.Normalizer().fit(X) # fit does nothing>>> normalizerNormalizer(copy=True, norm=‘l2‘)>>>>>> normalizer.transform(X) array([[ 0.40..., -0.40..., 0.81...], [ 1. ..., 0. ..., 0. ...], [ 0. ..., 0.70..., -0.70...]])>>> normalizer.transform([[-1., 1., 0.]]) array([[-0.70..., 0.70..., 0. ...]]) |

补充:

以上是关于数据标准化、归一化、正则化概念厘定的主要内容,如果未能解决你的问题,请参考以下文章