VCIP2021:基于神经网络的双向预测blending过程

Posted Dillon2015

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了VCIP2021:基于神经网络的双向预测blending过程相关的知识,希望对你有一定的参考价值。

本文来自VCIP2021论文《Neural Network based Inter bi-prediction Blending》

介绍

双向预测最终会产生两个MV和两个参考块,这两个参考块通过加权最终形成一个预测块,这个过程即为blending。双向预测能减少编码失真、亮度变化、块内小运动引起的误差。

VVC中提出了多种工具来提升双向预测过程的表现,例如BCW技术对两个参考块分别赋予一个权重,最终的预测块由两个参考块加权生成,相比在HEVC中进行双向预测时预测值等于前向预测值和后向预测值的均值,BCW的加权预测效果更好,同时为了降低复杂度BCW使用一组固定权重-1/4,3/8,1/2,5/8,5/4。另一个技术是BDOF,基于光流的概念计算出来的运动修正值来调整4x4子块的双向预测值。还有一个技术是几何划分GPM,每个像素的权重取决于它到边界的距离。最后还有一个技术是CIIP,它将帧内预测和帧间预测结合了起来。

基于神经网络的双向预测blending

简介

论文提出使用神经网络来进行双向预测时两个参考块的blending过程。网络模型通过全连接神经网络构成,输入是两个参考块,输出是最终的预测块,网络结构如Fig.1所示。

应用条件:

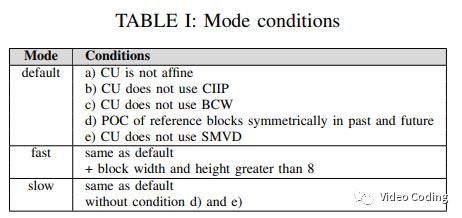

该方法不需要在码流中传输额外信息,但是需要一些条件限制其是否开启。由于该方法和BDOF不兼容,所以论文中关闭了BDOF。且该模型仅在亮度分量上训练,对于色度分量还是使用原始的blending方法。为了平衡复杂度,设置了三个档次的开启条件,如表1所示。

实验结果

训练数据集使用BVI-DVC和UVG数据集,使用STAD作为loss 函数,使用Hadamard矩阵进行变换。具体信息如表4所示。

实验平台使用VTM11.0,QP=22,27,32,37,42。

模型大小比较

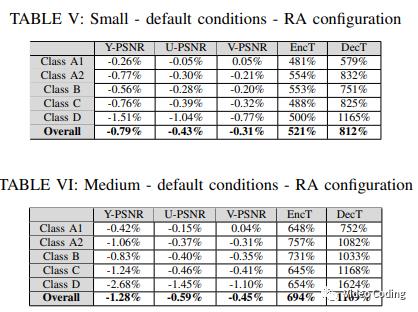

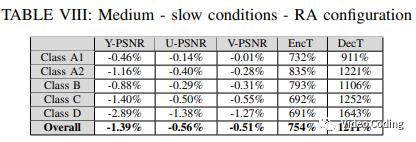

首先比较网络大小的影响,使用RA配置,从表5和表6可得,大模型的gain增加了0.5%但是解码复杂度增加了40%

不同配置比较

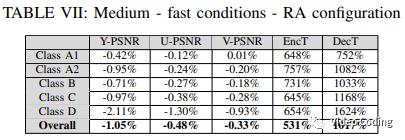

表7和表8比较了不同配置下的效果,

LDB配置

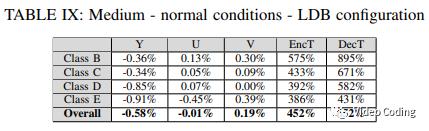

一个有趣的现象,该工具在LDB配置下也会有增益,如表9,在LDB配置下两个参考帧都来自前面,而BDOF在LDB配置下效果不好。

该工具在VTM上相比于BDOF的效果如表10,BD-Rate增益2.2%以上。

感兴趣的请关注微信公众号Video Coding

以上是关于VCIP2021:基于神经网络的双向预测blending过程的主要内容,如果未能解决你的问题,请参考以下文章

数据预测基于matlab双向长短时记忆(BiLSTM)数据预测含Matlab源码 1824期

注意力机制 | CNN-BiLSTM-Attention基于卷积-双向长短期记忆网络结合注意力机制多输入单输出回归预测(Matlab程序)

数据预测基于matlab双向长短时记忆BiLSTM(多输入单输出)数据预测含Matlab源码 1826期

LSTM预测基于matlab鲸鱼算法优化双向长短时记忆BiLSTM航空发动机寿命预测 (多输入单输出)含Matlab源码 2288期