流媒体开发17FFmpeg基础入门API结构体

Posted 努力努力再努力~~

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了流媒体开发17FFmpeg基础入门API结构体相关的知识,希望对你有一定的参考价值。

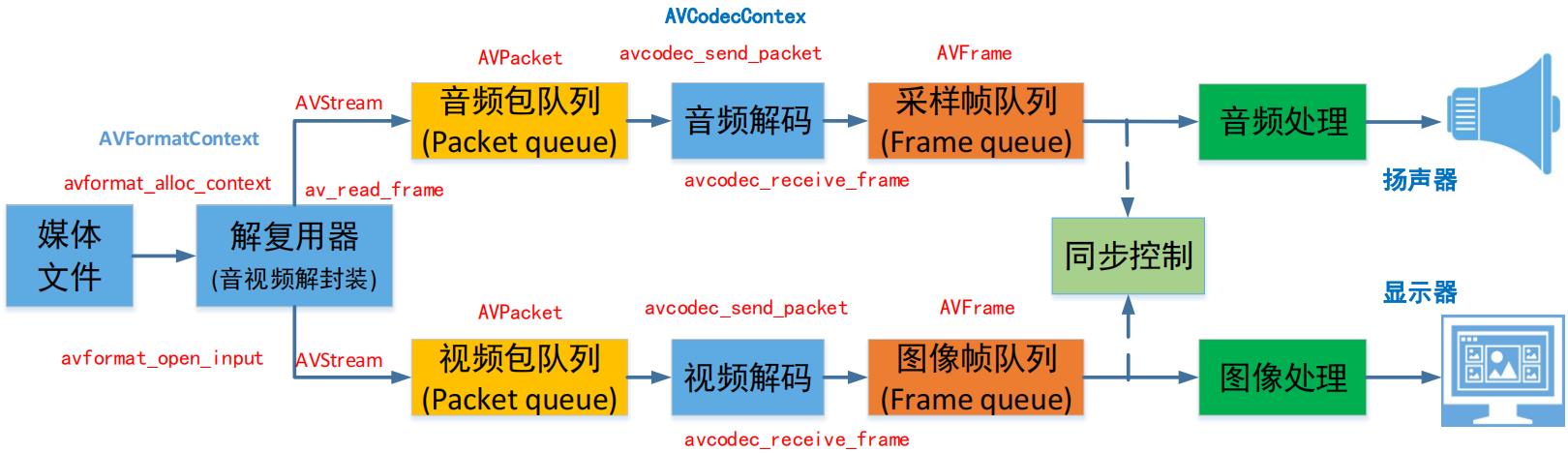

一、播放器框架

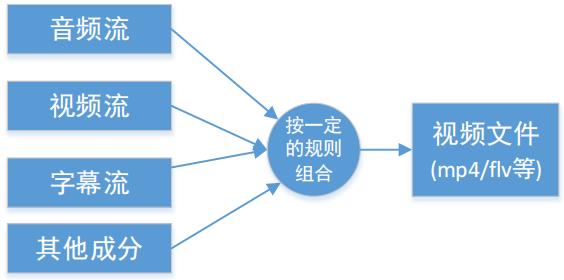

二、常用音视频概念

- 容器/文件(Conainer/File): 即特定格式的多媒体文件,比如mp4、flv、mkv等。

- 媒体流(Stream): 表示时间轴上的一段连续数据,如一段声音数据、一段视频数据或一段字幕数据,可以是压缩的,也可以是非压缩的,压缩的数据需要关联特定的编解码器(有些码流音频他是纯PCM)。

- 数据帧/数据包(Frame/Packet): 通常,一个媒体流是由大量的数据帧组成的,对于压缩数据,帧对应着编解码器的最小处理单元,分属于不同媒体流的数据帧交错存储于容器之中。

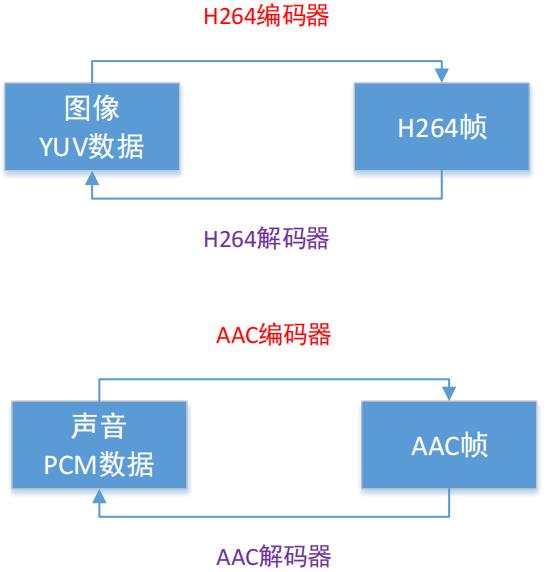

- 编解码器: 编解码器是以帧为单位实现压缩数据和原始数据之间的相互转换的。

- 复用器: 比如MP4、FLV等

- 编解码器: 将YUV或音频PCM数据进行压缩

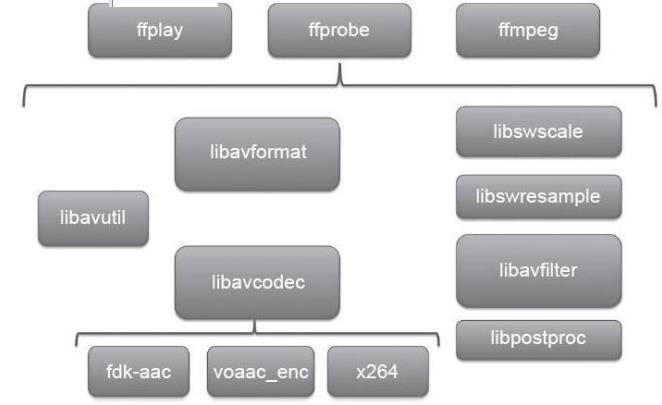

三、FFmpeg库简介

FFMPEG有8个常用库:

- AVUtil: 核心工具库,下面的许多其他模块都会依赖该库做一些基本的音视频处理操作。

- AVFormat: 文件格式和协议库,该模块是最重要的模块之一,封装了Protocol层和Demuxer、Muxer层,使得协议和格式对于开发者来说是透明的。

- AVCodec: 编解码库,封装了Codec层,但是有一些Codec是具备自己的License的,FFmpeg是不会默认添加像libx264、FDK-AAC等库的,但是FFmpeg就像一个平台一样,可以将其他的第三方的Codec以插件的方式添加进来,然后为开发者提供统一的接口。

- AVFilter: 音视频滤镜库,该模块提供了包括音频特效和视频特效的处理,在使用FFmpeg的API进行编解码的过程中,直接使用该模块为音视频数据做特效处理是非常方便同时也非常高效的一种方式。

- AVDevice: 输入输出设备库,比如,需要编译出播放声音或者视频的工具ffplay,就需要确保该模块是打开的,同时也需要SDL的预先编译,因为该设备模块播放声音与播放视频使用的都是SDL库。

- SwrRessample: 该模块可用于音频重采样,可以对数字音频进行声道数、数据格式、采样率等多种基本信息的转换。

- SWScale: 该模块是将图像进行格式转换的模块,比如,可以将YUV的数据转换为RGB的数据,缩放尺寸由1280 * 720变为800 * 480。

- PostProc: 该模块可用于进行后期处理,当我们使用AVFilter的时候需要打开该模块的开关,因为Filter中会使用到该模块的一些基础函数。

四、FFmpeg函数简介

4.1初始化

av_register_all():注册所有组件,4.0已经弃用- avdevice_register_all()对设备进行注册,比如V4L2等。

- avformat_network_init();初始化网络库以及网络加密协议相关的库(比如openssl)

4.2封装格式相关

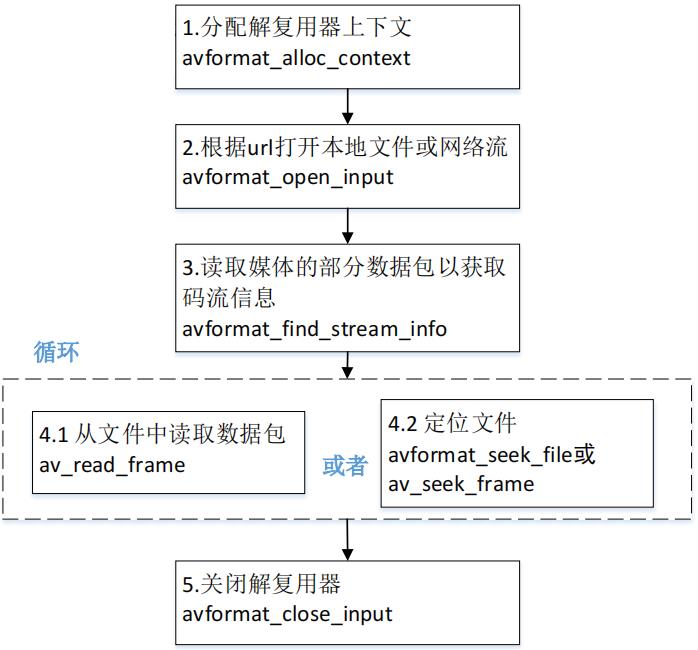

- avformat_alloc_context(): 负责申请一个AVFormatContext结构的内存,并进行简单初始化

- avformat_free_context(): 释放该结构里的所有东西以及该结构本身

- avformat_close_input(): 关闭解复用器,关闭后就不再需要使用avformat_free_context 进行释放。

- avformat_open_input(): 打开输入视频文件

- avformat_find_stream_info(): 获取音视频文件信息

- av_read_frame(): 读取音视频包

- avformat_seek_file(): 定位文件。(如:播放器拖动时间轴,1分钟拖到5分钟位置)

- av_seek_frame(): 定位文件。(拖动文件两种方式,按照pts和按照文件大小,如一共10分钟10M,拖动到5分钟则是拖动到5M大小位置)

alloc申请一个AVFormatContext结构的内存,avformat_open_input打开文件将其与AVFormatContext结构体进行关联,之后就可以获取音视频文件的一些信息(大小、时长、编码格式等),然后调用av_read_frame分别读取音频和视频文件。

封装大体流程:

4.3编解码

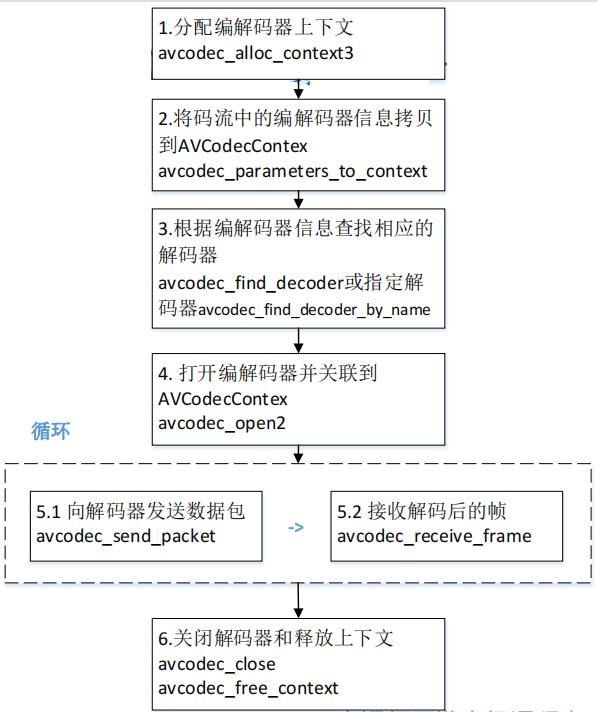

- avcodec_alloc_context3(): 分配解码器上下文

- avcodec_find_decoder(): 根据ID查找解码器,查找到第一个解码器就退出

- avcodec_find_decoder_by_name(): 根据解码器名字查找,找不到指定名字就返回没找到

- avcodec_open2(): 打开编解码器,和解码上下文做关联

avcodec_decode_video2():解码一帧视频数据,编和取在一个API,4.0新版本不建议使用avcodec_decode_audio4():解码一帧音频数据,编和取在一个API,4.0新版本不建议使用- avcodec_send_packet(): 发送编码数据包

- avcodec_receive_frame(): 接收解码后数据

- avcodec_free_context(): 释放解码器上下文,包含了avcodec_close()

- avcodec_close(): 关闭解码器

解码相关疑问解析:(此处很重要)

- avcodec_find_decoder()和avcodec_find_decoder_by_name(),一个是使用ID查找,一个使用解码器名字查找,他们的区别是什么呢?

- H264解码,H264只是一种解码标准,可能是由很多个产商根据这个标准来实现解码,如x264、JM等,这些不同的厂商他们使用的ID是相同的,但是名字使用不同的,这样就可以区分开(ID和名字都是针对ffmpeg内部的定义)

- 解码器和解码上下文的区别是什么?

- 假如有多路解码,解码器需要时支持多路可重入的,假如我们将上下文数据保存到解码器中,那么解码器 该怎么区分是哪个通道呢?所以引入了上下文的概念

解码相关大体流程图:

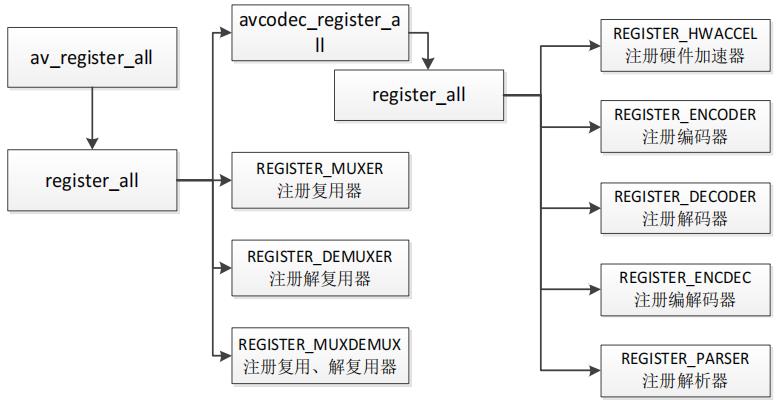

4.4组件注册方式

1、ffmpeg 3.x组件注册方式

我们使用ffmpeg,首先要执行av_register_all,把全局的解码器、编码器等结构体注册到各自全局的对象链表里,以便后面查找调用。

2、FFmpeg 4.x 组件注册方式

FFmpeg内部去做,不需要用户调用API去注册。

以codec编解码器为例:

- 在configure的时候生成要注册的组件

./configure:7203:print_enabled_components libavcodec/codec_list.c

AVCodec codec_list $CODEC_LIST

这里会生成一个codec_list.c 文件,里面只有static const AVCodec * const codec_list[]数组。 - 在libavcodec/allcodecs.c将static const AVCodec * const codec_list[]的编解码器用链表的方式组织起来

demuxer/muxer(解复用器,也称容器)

- 对应libavformat/muxer_list.c

libavformat/demuxer_list.c 这两个文件也是在configure的时候生成,也就是说直接下载源码是没有这两个文件的。 - 在libavformat/allformats.c将demuxer_list[]和muexr_list[]以链表的方式组织。

其他模块也是类似的

五、FFmpeg数据结构简介

1、基础结构体

- AVFormatContext

- 封装格式上下文结构体,也是统领全局的结构体,保存了视频文件封装格式相关信息。

- AVInputFormat demuxer

- 每种封装格式(例如FLV, MKV, MP4, AVI)对应一个该结构体。

- AVOutputFormat muxer

- AVStream

- 视频文件中每个视频(音频)流对应一个该结构体。

- AVCodecContext

- 编解码器上下文结构体,保存了视频(音频)编解码相关信息。

- AVCodec

- 每种视频(音频)编解码器(例如H.264解码器)对应一个该结构体。

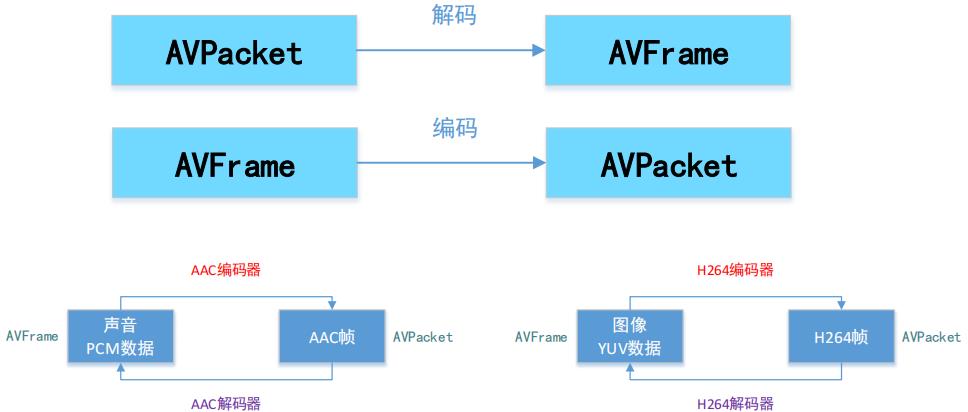

- AVPacket

- 存储一帧压缩编码数据。

- AVFrame

- 存储一帧解码后像素(采样)数据

2、AVFormatContext, AVStream和AVCodecContext之间的关系:

avcodec_parameters_to_context()将find_stream_info流的信息拷贝到AVCodecContext中,后面find avcodec时使用

3、区分不同的码流

- AVMEDIA_TYPE_VIDEO视频流

video_index = av_find_best_stream(ic, AVMEDIA_TYPE_VIDEO,-1,-1, NULL, 0)

- AVMEDIA_TYPE_AUDIO音频流

audio_index = av_find_best_stream(ic, AVMEDIA_TYPE_AUDIO,-1,-1, NULL, 0)

- AVPacket 里面也有一个index的字段,video_index和audio_index就是用于和avPacket中的index字段比较,指导当前是音频还是视频

4、AVPacket和AVFrame之间的关系

5、结构体

- AVFormatContext

- iformat:输入媒体的AVInputFormat,比如指向AVInputFormat f_flv_demuxer

- nb_streams:输入媒体的AVStream 个数

- streams:输入媒体的AVStream []数组

- duration:输入媒体的时长(以微秒为单位),计算方式可以参考av_dump_format()函数。

- bit_rate:输入媒体的码率

- AVInputFormat

- name:封装格式名称

- extensions:封装格式的扩展名

- id:封装格式ID

- 一些封装格式处理的接口函数,比如read_packet()

- AVStream

- index:标识该视频/音频流

- time_base:该流的时基,PTS*time_base=真正的时间(秒)

- avg_frame_rate: 该流的帧率

- duration:该视频/音频流长度

- codecpar:编解码器参数属性

- AVCodecParameters

- codec_type:媒体类型,比如AVMEDIA_TYPE_VIDEO AVMEDIA_TYPE_AUDIO等

- codec_id:编解码器类型, 比如AV_CODEC_ID_H264 AV_CODEC_ID_AAC等

- AVCodecContext

- codec:编解码器的AVCodec,比如指向AVCodec ff_aac_latm_decoder

- width, height:图像的宽高(只针对视频)

- pix_fmt:像素格式(只针对视频)

- sample_rate:采样率(只针对音频)

- channels:声道数(只针对音频)

- sample_fmt:采样格式(只针对音频)

- AVCodec

- name:编解码器名称

- type:编解码器类型

- id:编解码器ID

- 一些编解码的接口函数,比如int (*decode)()

- AVPacket

- pts:显示时间戳

- dts:解码时间戳

- data:压缩编码数据

- size:压缩编码数据大小

- pos:数据的偏移地址

- stream_index:所属的AVStream

- AVFrame

- data:解码后的图像像素数据(音频采样数据)

- linesize:对视频来说是图像中一行像素的大小;对音频来说是整个音频帧的大小

- width, height:图像的宽高(只针对视频)

- key_frame:是否为关键帧(只针对视频) 。 • pict_type:帧类型(只针对视频) 。例如I, P, B • sample_rate:音频采样率(只针对音频)

- nb_samples:音频每通道采样数(只针对音频)

- pts:显示时间戳

以上是关于流媒体开发17FFmpeg基础入门API结构体的主要内容,如果未能解决你的问题,请参考以下文章