架构师之路 — 部署架构 — 超大规模负载均衡架构演进

Posted 范桂飓

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了架构师之路 — 部署架构 — 超大规模负载均衡架构演进相关的知识,希望对你有一定的参考价值。

目录

文章目录

- 目录

- 超大规模负载均衡架构演进技术路线

- 0、单机架构

- 1、HTTP 与 DB 服务器分开部署

- 2、引入本地缓存和分布式缓存

- 3、引入反向代理实现负载均衡

- 4、数据库读写分离

- 5、数据库按业务分库

- 6、把大表拆分为小表

- 7、使用 LVS 或 F5 来使多个 Nginx 负载均衡

- 8、通过 DNS 轮询实现机房间的负载均衡

- 9、引入 NoSQL 数据库和搜索引擎等技术

- 10、大应用拆分为小应用

- 11、复用的功能抽离成微服务

- 12、引入企业服务总线 ESB 屏蔽服务接口的访问差异

- 13、引入容器化技术实现运行环境隔离与动态服务管理

- 14、以云平台承载系统

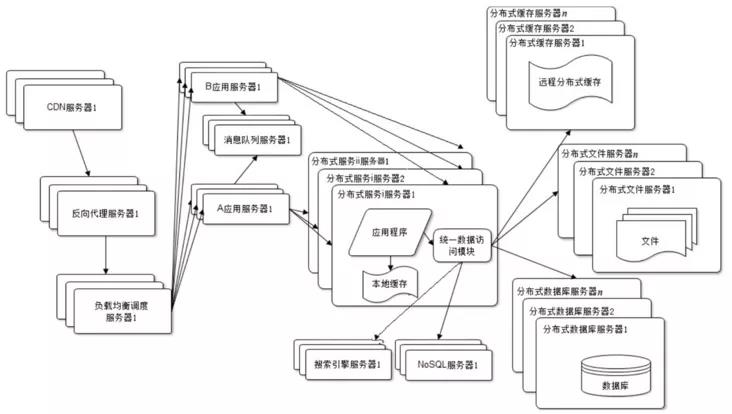

超大规模负载均衡架构演进技术路线

-

引入应用和数据分离。

-

引入缓存。

-

引入服务器集群。

-

引入数据库读写分离。

-

引入反向代理和 CDN。

-

引入分布式文件系统和分布式数据库系统。

-

引入 NoSQL 和搜索引擎。

-

业务拆分。

-

分布式服务。

0、单机架构

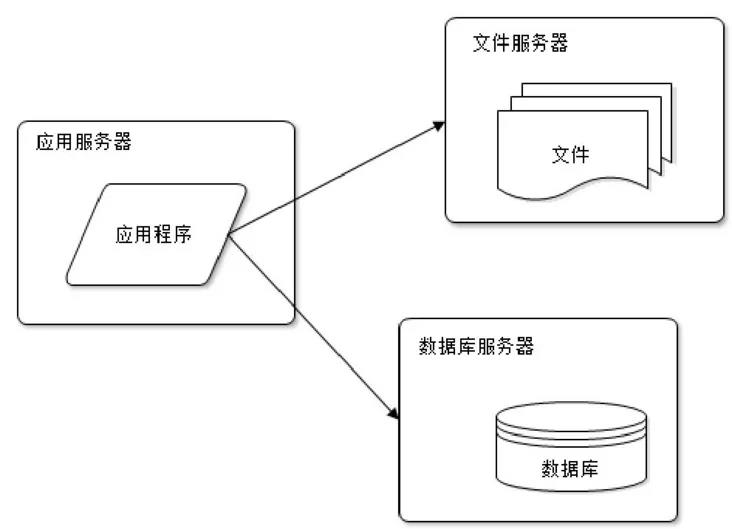

1、HTTP 与 DB 服务器分开部署

随着用户数的增长,Tomcat 和数据库之间竞争资源,单机性能不足以支撑业务。

HTTP 与 DB 服务器分开部署,Tomcat 和 DB 分别独占服务器资源,显著提高两者各自性能。并且这不同的服务器对硬件资源的要求各不相同:

- 应用服务器需要处理大量的业务逻辑,因此需要更快更强大的 CPU;

- 数据库服务器需要快速磁盘检索和数据缓存,因此需要更快的硬盘和更大的内存;

- 文件服务器需要存储大量用户上传的文件,因此需要更大的硬盘。

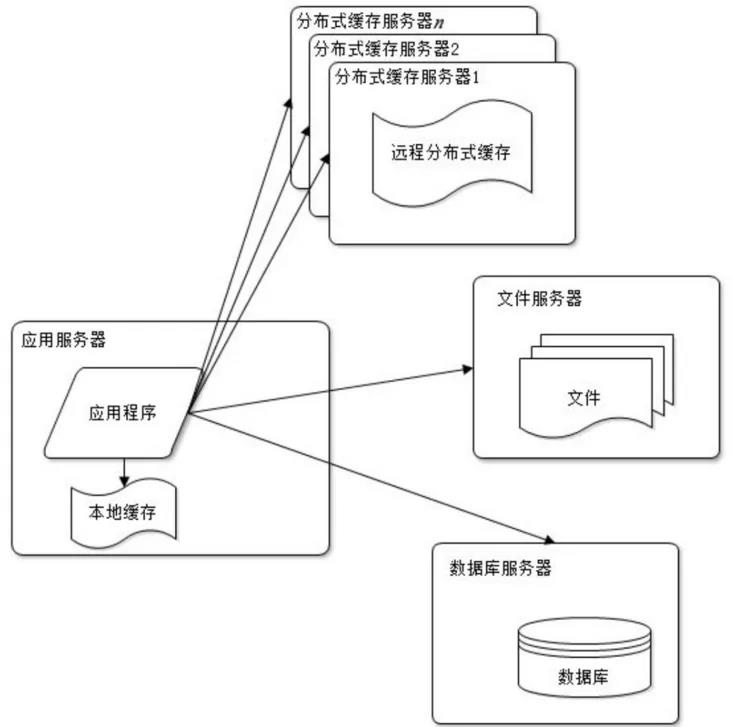

2、引入本地缓存和分布式缓存

随着用户数的增长,并发读写数据库成为瓶颈。

并且大多数网站访问遵循二八定律:80% 的业务访问集中在 20% 的数据上。既然大部分的业务访问集中在一小部分数据上,把这一小部分数据缓存在内存中,就可以减少数据库的访问压力,提高整个网站的数据访问速度。

网站使用的缓存可以分为两种:

- 缓存在应用服务器上的本地缓存:本地缓存的访问速度更快一些,但是受应用服务器内存限制,其缓存数据量有限,而且会出现和应用程序争用内存的情况。

- 缓存在专门的分布式缓存服务器上的远程缓存:远程分布式缓存可以使用集群的方式,部署大内存的服务器作为专门的缓存服务器,可以在理论上做到不受内存容量限制的缓存服务。

通过缓存能把绝大多数请求在读写数据库前拦截掉,大大降低数据库压力。例如:使用 Memcached 作为本地缓存,使用 Redis 作为分布式缓存,还会涉及缓存一致性、缓存穿透/击穿、缓存雪崩、热点数据集中失效等问题。

本地缓存(一级缓存)就是使用站点服务器缓存去存储数据,注意只存储部分请求量大的数据,并且缓存的数据量要控制,不能过分的使用站点服务器的内存而影响了站点应用程序的正常运行。一级缓存需要设置秒单位的过期时间,具体时间根据业务场景设定,目的是当有高并发请求的时候可以让数据的获取命中到一级缓存,而不用连接缓存分布式的 NoSQL 数据服务器,减少 NoSQL 数据服务器的压力。

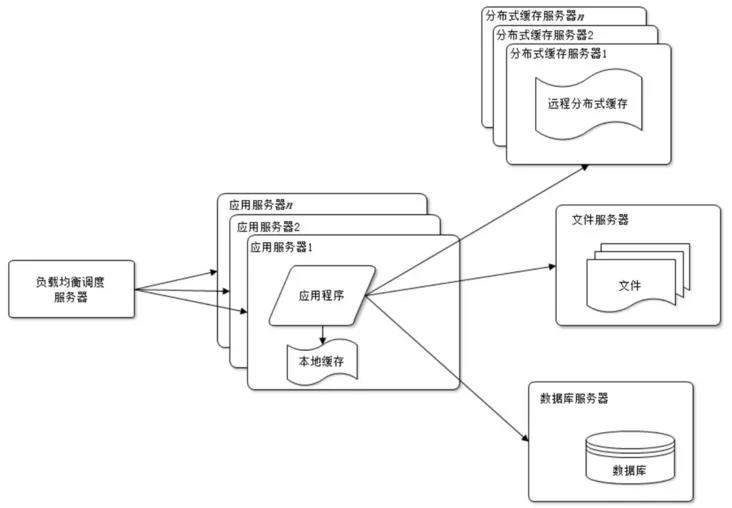

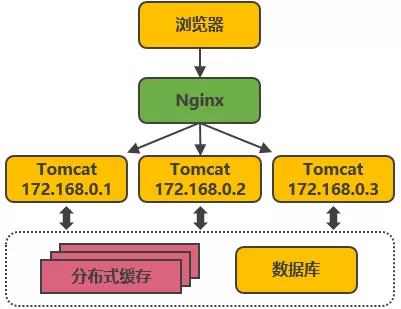

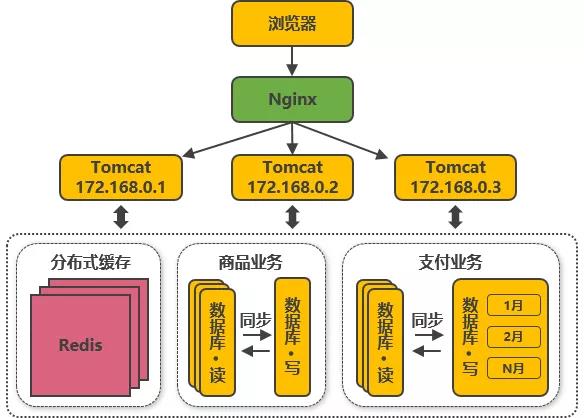

3、引入反向代理实现负载均衡

缓存抗住了大部分的访问请求,随着用户数的增长,并发压力主要落在单机的 Tomcat 上,响应逐渐变慢。并且单一应用服务器能够处理的请求连接有限,在网站访问高峰期,应用服务器成为整个网站的瓶颈。

使用负载均衡集群是解决高并发、海量数据问题的常用手段。当一台服务器的处理能力、存储空间不足时,不要企图去换更强大的服务器,对大型网站而言,不管多么强大的服务器,都满足不了网站持续增长的业务需求。这种情况下,更恰当的做法是增加一台服务器分担原有服务器的访问及存储压力。

只要能通过增加一台服务器的方式改善负载压力,就可以以同样的方式持续增加服务器不断改善系统性能,从而实现系统的可伸缩性。应用服务器集群是可伸缩集群架构设计中较为简单成熟的一种。

在多台服务器上分别部署 Tomcat,使用反向代理软件(nginx)把请求均匀分发到每个 Tomcat 中。此处假设 Tomcat 最多支持 100 个并发,Nginx 最多支持 50000 个并发,那么理论上 Nginx 把请求分发到 500 个 Tomcat 上,就能抗住 50000 个并发。

其中涉及的技术包括:Nginx、HAProxy,两者都是工作在网络第七层的反向代理软件,主要支持 HTTP 协议,还会涉及 Session 共享、文件上传下载的问题。

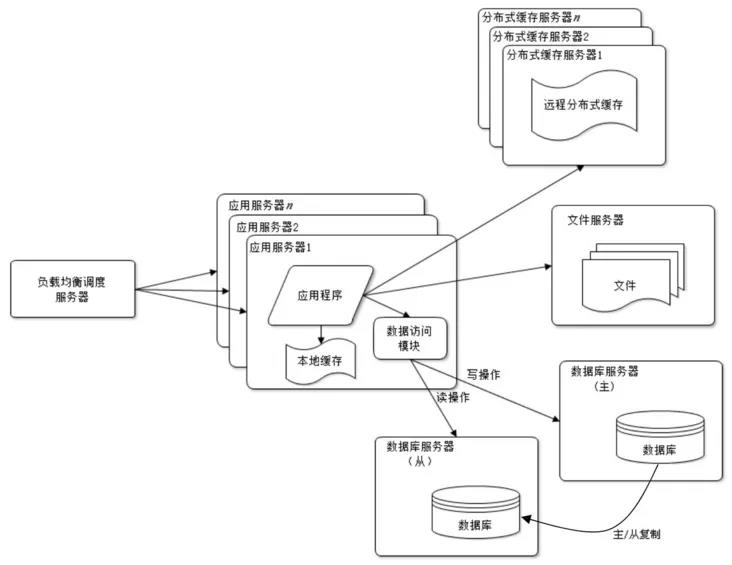

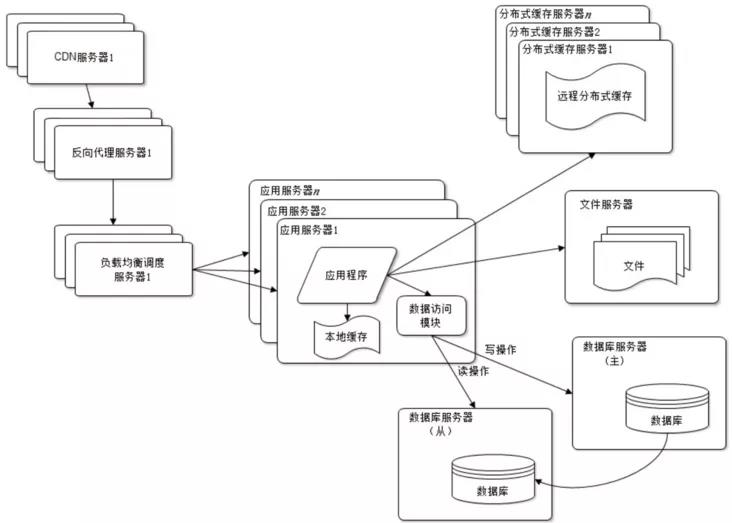

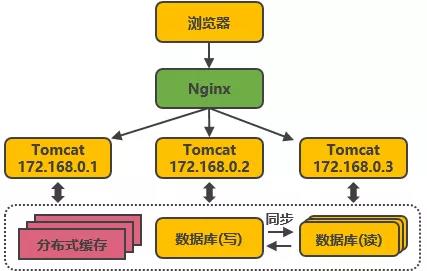

4、数据库读写分离

反向代理使应用服务器可支持的并发量大大增加,但并发量的增长也意味着更多请求穿透到数据库,单机的数据库最终成为瓶颈。

网站在使用缓存后,使绝大部分数据读操作访问都可以不通过数据库就能完成,但是仍有一部分读操作和全部的写操作需要访问数据库,在网站的用户达到一定规模后,数据库因为负载压力过高而成为网站的瓶颈。

目前大部分的主流数据库都提供主从热备功能,通过配置两台数据库主从关系,可以将一台数据库服务器的数据更新同步到另一台服务器上。网站利用数据库的这一功能,实现数据库读写分离,从而改善数据库负载压力。应用服务器在写数据的时候,访问主数据库,主数据库通过主从复制机制将数据更新同步到从数据库,这样当应用服务器读数据的时候,就可以通过从数据库获得数据。

把数据库划分为读库和写库,读库可以有多个,通过同步机制把写库的数据同步到读库,对于需要查询最新写入数据场景,可通过在缓存中多写一份,通过缓存获得最新数据。

其中涉及的技术包括:MyCAT,它是数据库中间件,可通过它来组织数据库的分离读写和分库分表,客户端通过它来访问下层数据库,还会涉及数据同步,数据一致性的问题。

5、数据库按业务分库

业务逐渐变多,不同业务之间的访问量差距较大,不同业务直接竞争数据库,相互影响性能。

把不同业务的数据保存到不同的数据库中,使业务之间的资源竞争降低,对于访问量大的业务,可以部署更多的服务器来支撑。

但这样会导致跨业务的表无法直接做关联分析,需要通过其他途径来解决,但这不是本文讨论的重点,有兴趣的可以自行搜索解决方案。

6、把大表拆分为小表

随着用户数的增长,单机的写库会逐渐会达到性能瓶颈。

比如:针对评论数据,可按照商品 ID 进行 HASH,路由到对应的表中存储;针对支付记录,可按照小时创建表,每个小时表继续拆分为小表,使用用户 ID 或记录编号来路由数据。只要实时操作的表数据量足够小,请求能够足够均匀的分发到多台服务器上的小表,那数据库就能通过水平扩展的方式来提高性能。其中前面提到的 MyCAT 也支持在大表拆分为小表情况下的访问控制。这种做法显著的增加了数据库运维的难度,对 DBA 的要求较高。

数据库设计到这种结构时,已经可以称为分布式数据库。但是这只是一个逻辑的数据库整体,数据库里不同的组成部分是由不同的组件单独来实现的,如分库分表的管理和请求分发,由 MyCAT 实现,SQL 的解析由单机的数据库实现,读写分离可能由网关和消息队列来实现,查询结果的汇总可能由数据库接口层来实现等等,这种架构其实是 MPP(大规模并行处理)架构的一类实现。

目前开源和商用都已经有不少 MPP 数据库,开源中比较流行的有 Greenplum、TiDB、Postgresql XC、HAWQ 等,商用的如南大通用的 GBase、睿帆科技的雪球 DB、华为的 LibrA 等等,不同的 MPP 数据库的侧重点也不一样,如:

- TiDB 更侧重于分布式 OLTP 场景

- Greenplum 更侧重于分布式 OLAP 场景

这些 MPP 数据库基本都提供了类似 PostgreSQL、Oracle、mysql 那样的 SQL 标准支持能力,能把一个查询解析为分布式的执行计划分发到每台机器上并行执行,最终由数据库本身汇总数据进行返回,也提供了诸如权限管理、分库分表、事务、数据副本等能力,并且大多能够支持 100 个节点以上的集群,大大降低了数据库运维的成本,并且使数据库也能够实现水平扩展。

分布式数据库是网站数据库拆分的最后手段,只有在单表数据规模非常庞大的时候才使用。不到不得已时,网站更常用的数据库拆分手段是业务分库,将不同业务的数据库部署在不同的物理服务器上。

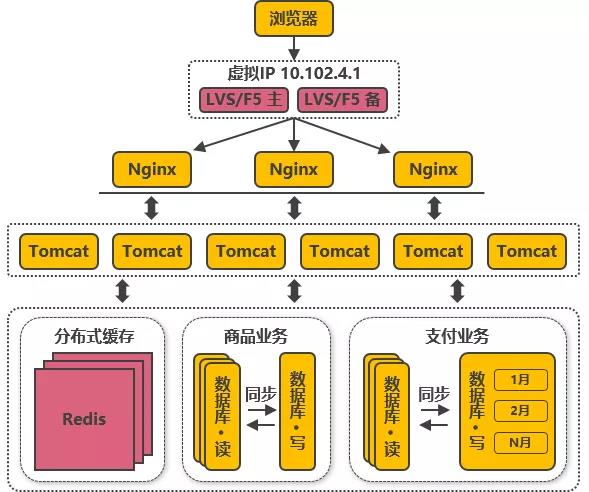

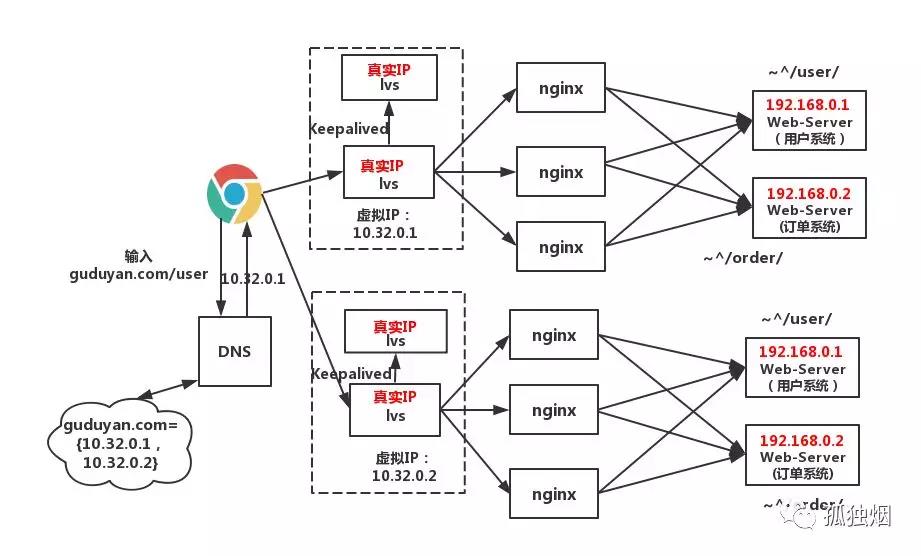

7、使用 LVS 或 F5 来使多个 Nginx 负载均衡

数据库和 Tomcat 都能够水平扩展,可支撑的并发大幅提高,随着用户数的增长,最终单机的 Nginx 会成为瓶颈。

因为无法通过两层的 Nginx 来实现多个 Nginx 的负载均衡,引入 LVS / F5 此类的 L4 负载均衡解决方案。其中 LVS 是软件,运行在操作系统内核态,可对 TCP 请求或更高层级的网络协议进行转发,因此支持的协议更丰富,并且性能也远高于 Nginx,可假设单机的 LVS 可支持几十万个并发的请求转发;而 F5 是一种负载均衡硬件,与 LVS 提供的能力类似,性能比 LVS 更高,但价格昂贵。

由于 LVS 是单机版的软件,若 LVS 所在服务器宕机则会导致整个后端系统都无法访问,因此需要有备用节点。可使用 Keepalived 软件模拟出 VIP,然后把 VIP绑定到多台 LVS 服务器上,浏览器访问 VIP 时,会被路由器重定向到真实的 LVS 服务器,当主 LVS 服务器宕机时,Keepalived 软件会自动更新路由器中的路由表,把 VIP 重定向到另外一台正常的 LVS 服务器,从而达到 LVS 服务器高可用的效果。

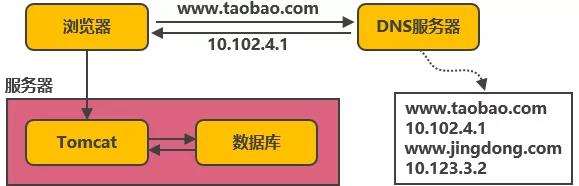

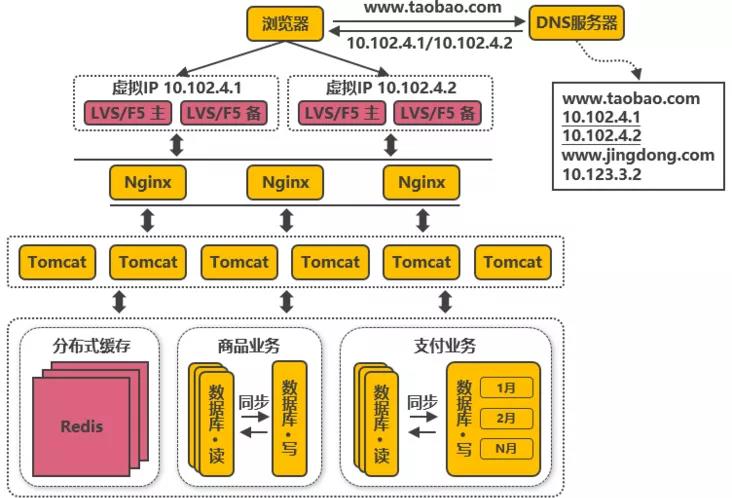

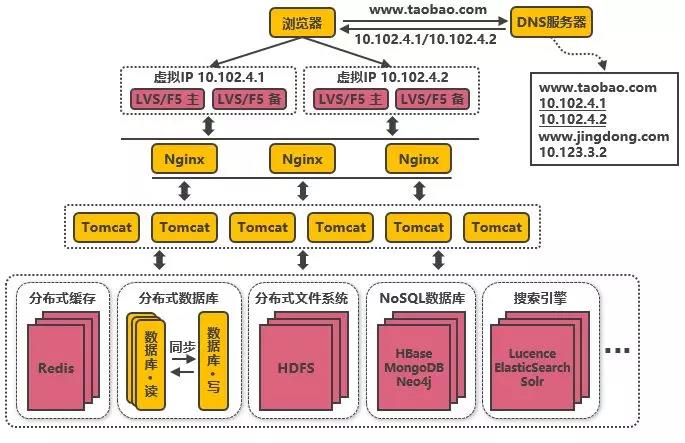

8、通过 DNS 轮询实现机房间的负载均衡

由于 LVS 也是单机的,随着并发数增长到几十万时,LVS 服务器最终会达到瓶颈,此时用户数达到千万甚至上亿级别,用户分布在不同的地区,与服务器机房距离不同,导致了访问的延迟会明显不同。

在 DNS 服务器中可配置一个域名对应多个 IP 地址,每个 IP 地址对应到不同的机房里的 VIP。当用户访问 www.taobao.com 时,DNS 服务器会使用轮询策略或其他策略,来选择某个 IP 供用户访问。此方式能实现机房间的负载均衡,至此,系统可做到机房级别的水平扩展,千万级到亿级的并发量都可通过增加机房来解决,系统入口处的请求并发量不再是问题。

需要注意的是,上图中从 Nginx 层到 Tomcat 层这样画并不代表全部 Nginx 都转发请求到全部的 Tomcat,在实际使用时,可能会是几个 Nginx 下面接一部分的 Tomcat,这些 Nginx 之间通过 Keepalived 实现高可用,其他的 Nginx 接另外的 Tomcat,这样可接入的 Tomcat 数量就能成倍的增加。

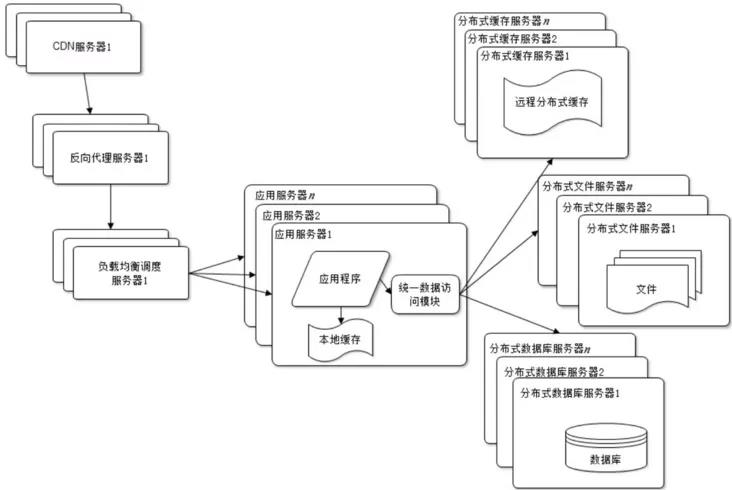

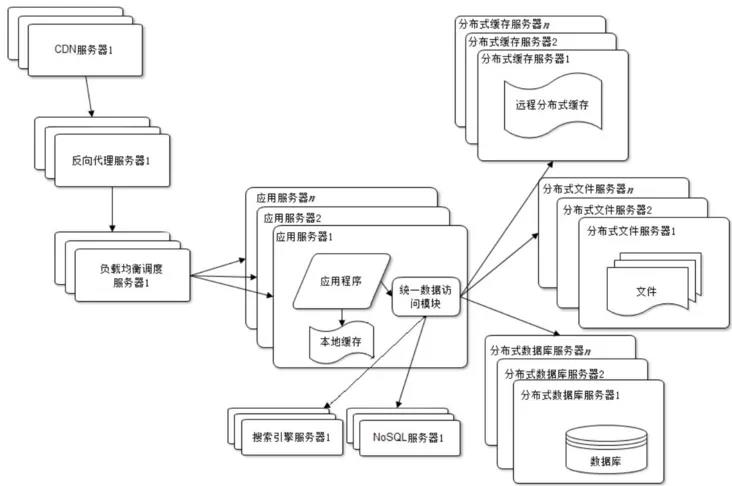

9、引入 NoSQL 数据库和搜索引擎等技术

随着数据的丰富程度和业务的发展,检索、分析等需求越来越丰富,单单依靠数据库无法解决如此丰富的需求。网站需要采用一些非关系数据库技术,如 NoSQL 和非数据库查询技术如搜索引擎。

当数据库中的数据多到一定规模时,数据库就不适用于复杂的查询了,往往只能满足普通查询的场景。对于统计报表场景,在数据量大时不一定能跑出结果,而且在跑复杂查询时会导致其他查询变慢,对于全文检索、可变数据结构等场景,数据库天生不适用。

因此需要针对特定的场景,引入合适的解决方案。如对于海量文件存储,可通过分布式文件系统 HDFS 解决,对于 key/value 类型的数据,可通过 HBase 和 Redis 等方案解决,对于全文检索场景,可通过搜索引擎如 Elasticsearch 解决,对于多维分析场景,可通过 Kylin 或 Druid 等方案解决。

当然,引入更多组件同时会提高系统的复杂度,不同的组件保存的数据需要同步,需要考虑一致性的问题,需要有更多的运维手段来管理这些组件等。

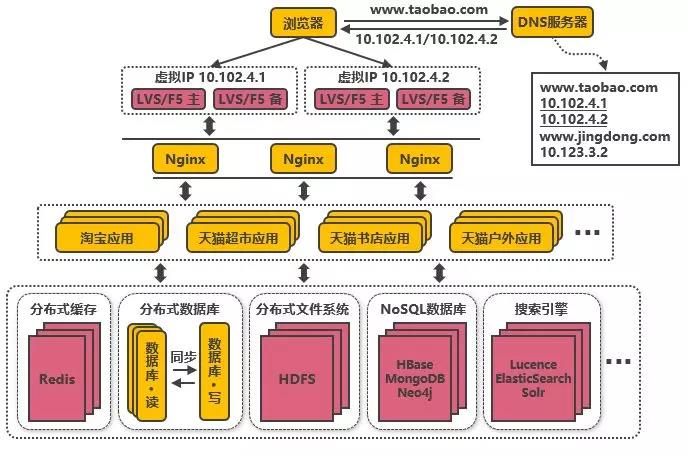

10、大应用拆分为小应用

引入更多组件解决了丰富的需求,业务维度能够极大扩充,随之而来的是一个应用中包含了太多的业务代码,业务的升级迭代变得困难。

大型网站为了应对日益复杂的业务场景,通过使用分而治之的手段将整个网站业务分成不同的产品线。具体到技术上,将一个网站拆分成许多不同的应用,每个应用独立部署维护。应用之间可以通过一个超链接建立关系(在首页上的导航链接每个都指向不同的应用地址),也可以通过消息队列进行数据分发,当然最多的还是通过访问同一个数据存储系统来构成一个关联的完整系。

按照业务板块来划分应用代码,使单个应用的职责更清晰,相互之间可以做到独立升级迭代。这时候应用之间可能会涉及到一些公共配置,可以通过分布式配置中心 ZooKeeper 来解决。

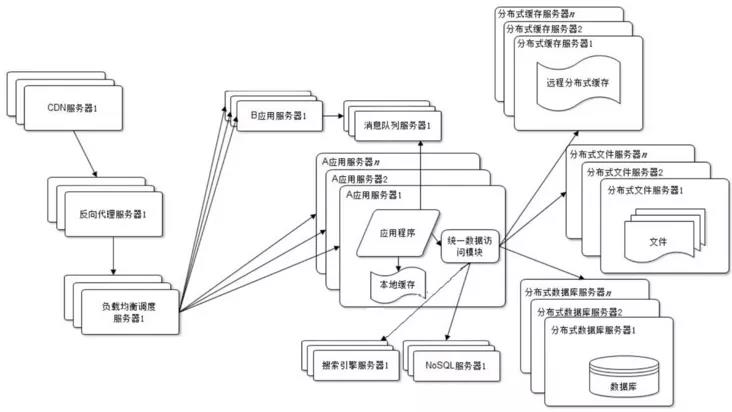

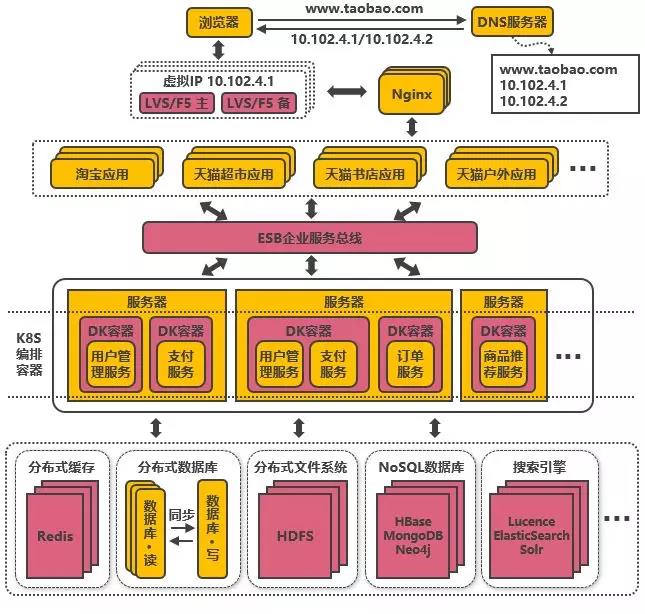

11、复用的功能抽离成微服务

不同应用之间存在共用的模块,由应用单独管理会导致相同代码存在多份,导致公共功能升级时全部应用代码都要跟着升级。

如用户管理、订单、支付、鉴权等功能在多个应用中都存在,那么可以把这些功能的代码单独抽取出来形成一个单独的服务来管理,这样的服务就是所谓的微服务,应用和服务之间通过 HTTP、TCP 或 RPC 请求等多种方式来访问公共服务,每个单独的服务都可以由单独的团队来管理。此外,可以通过 Dubbo、Spring Cloud 等框架实现服务治理、限流、熔断、降级等功能,提高服务的稳定性和可用性。

12、引入企业服务总线 ESB 屏蔽服务接口的访问差异

不同服务的接口访问方式不同,应用代码需要适配多种访问方式才能使用服务,此外,应用访问服务,服务之间也可能相互访问,调用链将会变得非常复杂,逻辑变得混乱。

通过 ESB 统一进行访问协议转换,应用统一通过 ESB 来访问后端服务,服务与服务之间也通过 ESB 来相互调用,以此降低系统的耦合程度。这种单个应用拆分为多个应用,公共服务单独抽取出来来管理,并使用企业消息总线来解除服务之间耦合问题的架构,就是所谓的 SOA(面向服务)架构,这种架构与微服务架构容易混淆,因为表现形式十分相似。个人理解,微服务架构更多是指把系统里的公共服务抽取出来单独运维管理的思想,而 SOA 架构则是指一种拆分服务并使服务接口访问变得统一的架构思想,SOA 架构中包含了微服务的思想。

13、引入容器化技术实现运行环境隔离与动态服务管理

业务不断发展,应用和服务都会不断变多,应用和服务的部署变得复杂,同一台服务器上部署多个服务还要解决运行环境冲突的问题,此外,对于如大促这类需要动态扩缩容的场景,需要水平扩展服务的性能,就需要在新增的服务上准备运行环境,部署服务等,运维将变得十分困难。

目前最流行的容器化技术是 Docker,最流行的容器管理服务是 Kubernetes(K8S),应用/服务可以打包为 Docker 镜像,通过 Kubernetes 来动态分发和部署镜像。Docker 镜像可理解为一个能运行你的应用/服务的最小的操作系统,里面放着应用/服务的运行代码,运行环境根据实际的需要设置好。把整个 “操作系统” 打包为一个镜像后,就可以分发到需要部署相关服务的机器上,直接启动 Docker 镜像就可以把服务起起来,使服务的部署和运维变得简单。

在大促的之前,可以在现有的机器集群上划分出服务器来启动 Docker 镜像,增强服务的性能,大促过后就可以关闭镜像,对机器上的其他服务不造成影响。

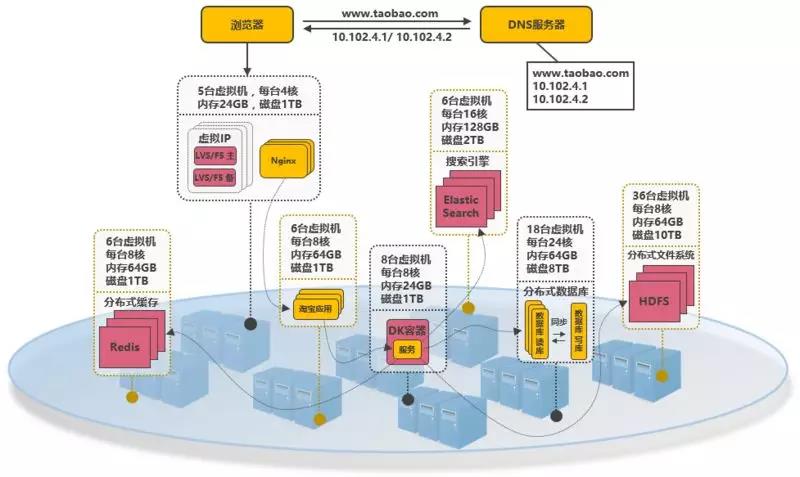

14、以云平台承载系统

使用容器化技术后服务动态扩缩容问题得以解决,但是机器还是需要公司自身来管理,在非大促的时候,还是需要闲置着大量的机器资源来应对大促,机器自身成本和运维成本都极高,资源利用率低。

系统可部署到公有云上,利用公有云的海量机器资源,解决动态硬件资源的问题,在大促的时间段里,在云平台中临时申请更多的资源,结合 Docker 和 K8S 来快速部署服务,在大促结束后释放资源,真正做到按需付费,资源利用率大大提高,同时大大降低了运维成本。

至此,以上所提到的从高并发访问问题,到服务的架构和系统实施的层面都有了各自的解决方案,但同时也应该意识到,在上面的介绍中,其实是有意忽略了诸如跨机房数据同步、分布式事务实现等等的实际问题,这些问题以后有机会再拿出来单独讨论。

以上是关于架构师之路 — 部署架构 — 超大规模负载均衡架构演进的主要内容,如果未能解决你的问题,请参考以下文章