卷积神经网络2 (p25-p27)

Posted bohu83

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了卷积神经网络2 (p25-p27)相关的知识,希望对你有一定的参考价值。

经典网络

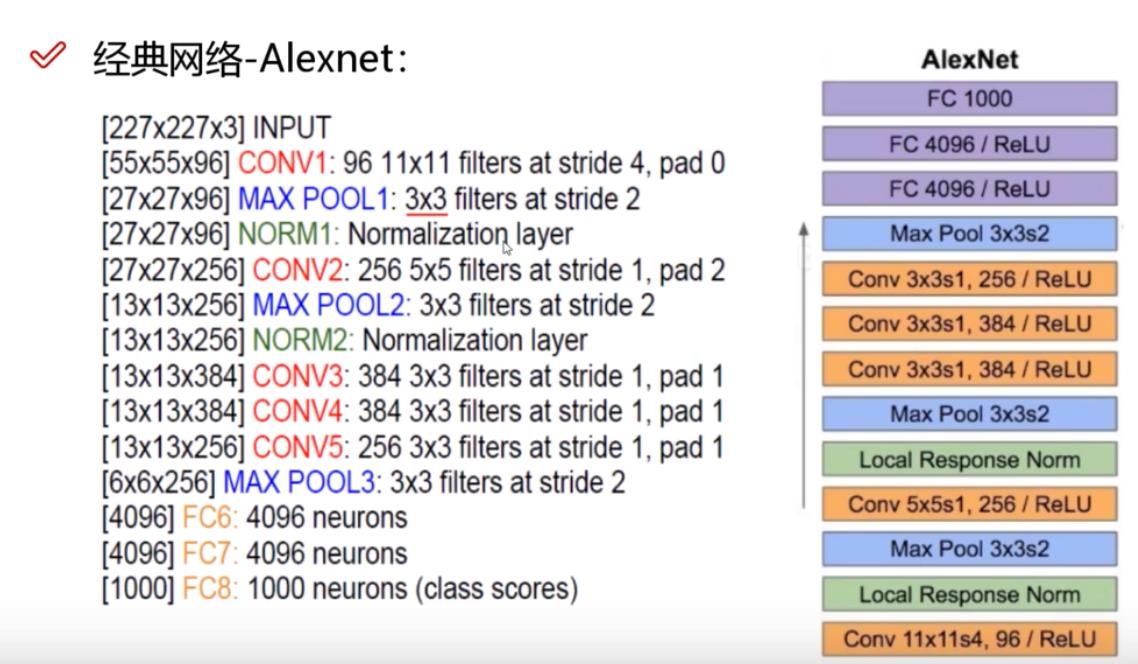

Alexnet 网络

- 用rectified linear units(ReLU)得到非线性;

- 使用 dropout 技巧在训练期间有选择性地忽略单个神经元,来减缓模型的过拟合;

- 重叠最大池,避免平均池的平均效果;

- AlexNet 有8层,有些层已经证明效果不好了。

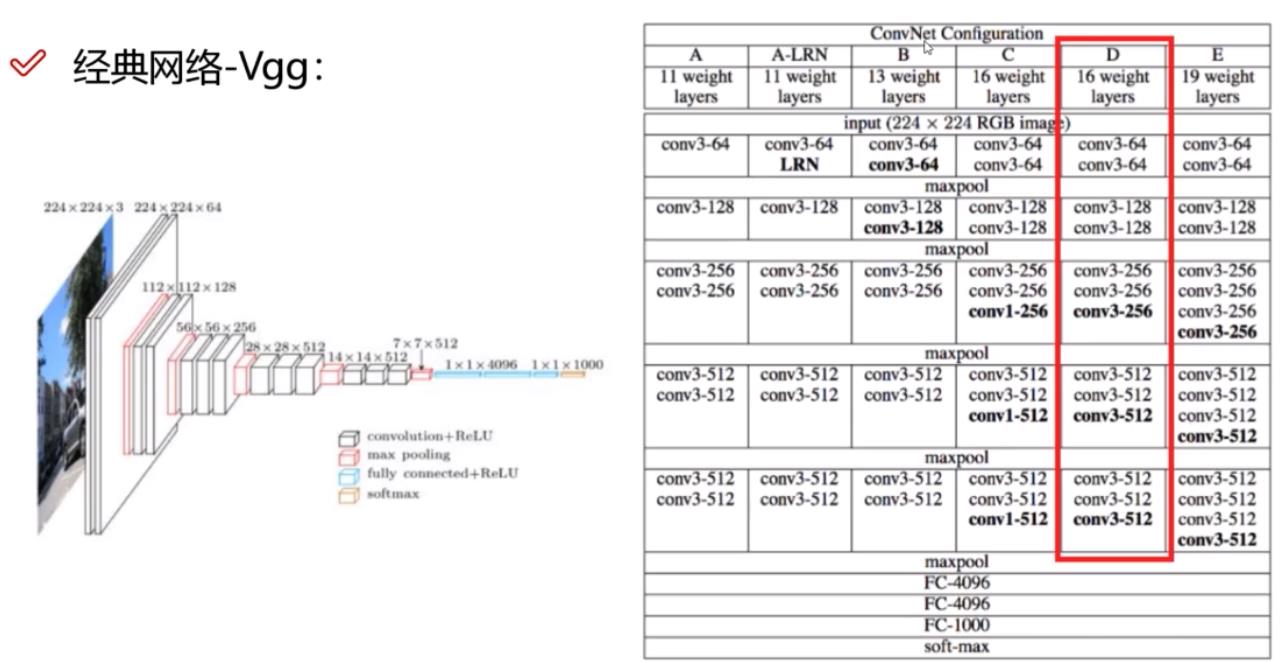

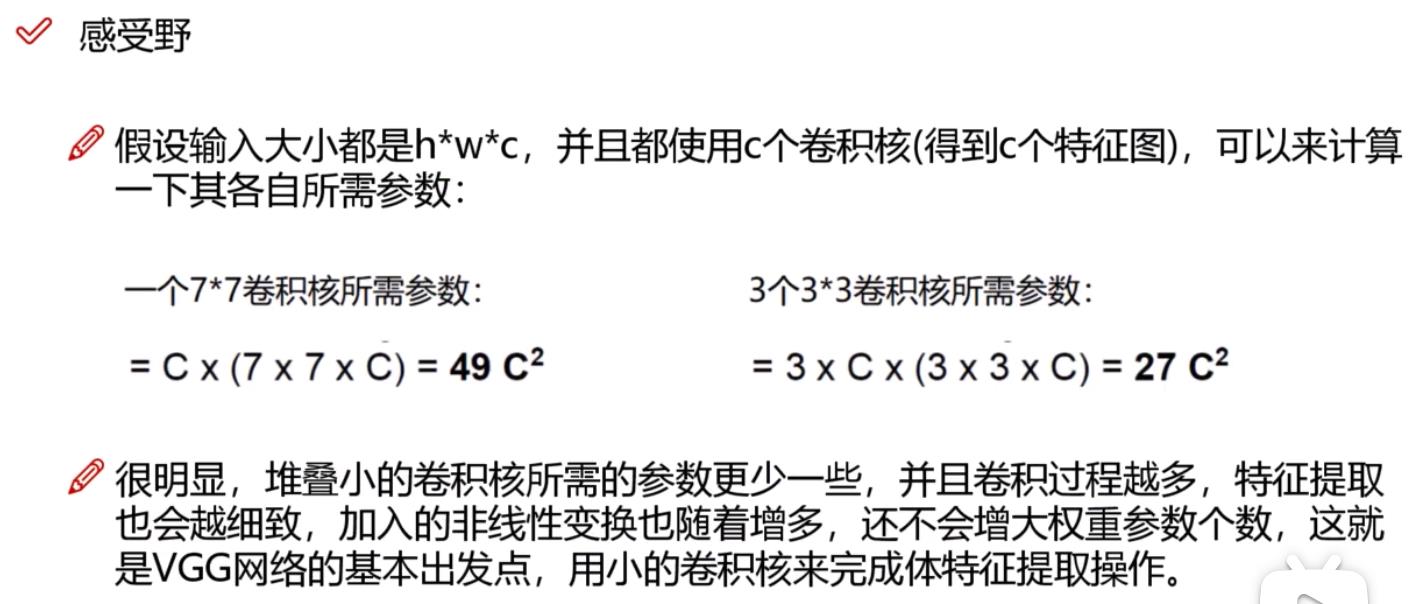

VGG网络

它主要的贡献是展示出网络的深度是算法优良性能的关键部分。他们最好的网络包含了16个卷积/全连接层。网络的结构非常一致,从头到尾全部使用的是3x3的卷积和2x2的汇聚。

缺点:使用了更多的参数,导致更多的内存占用,耗时较长

发现一个问题,不是深度越多越好,16层比32层效果还好。

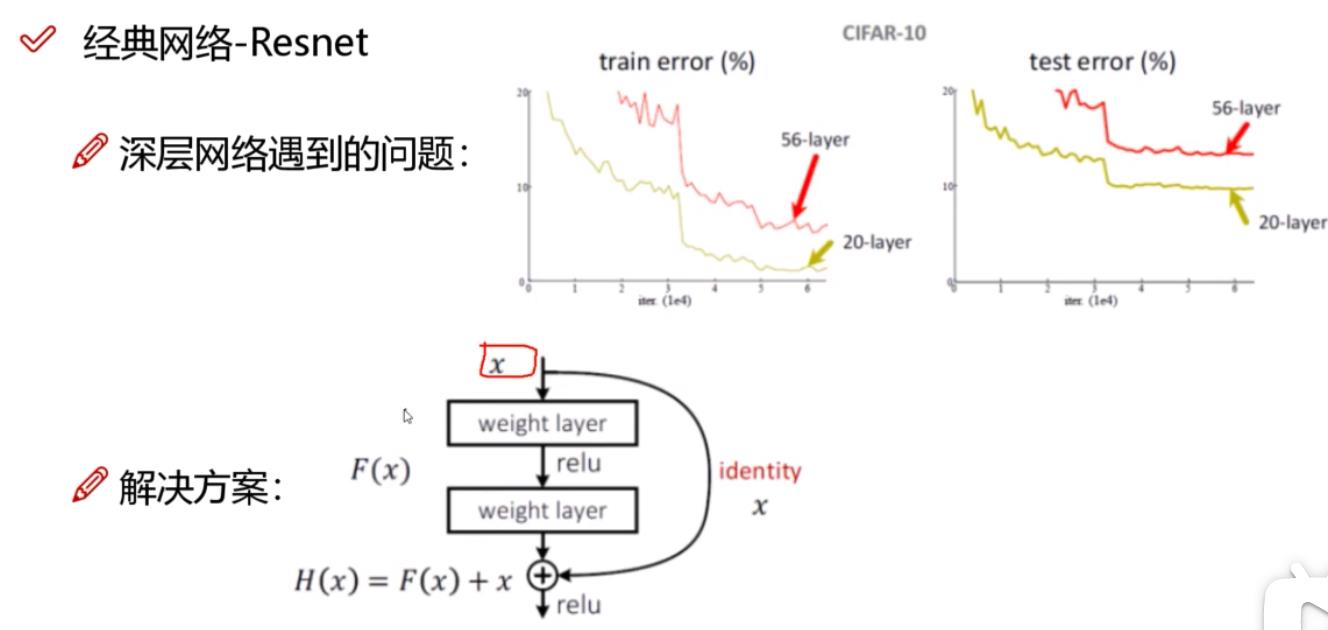

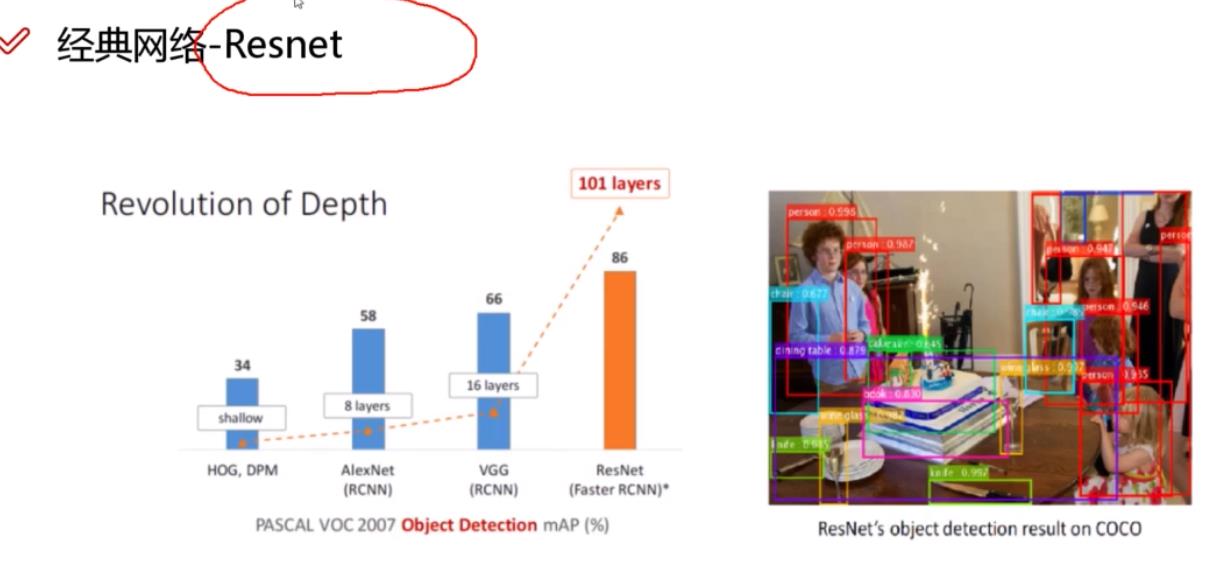

ResNet ,残差网络(Residual Network)

由何恺明等实现,它使用了特殊的跳跃链接,大量使用了批量归一化(batch normalization)。 按照 老师 的 介绍 ,就是如果某一层表现不好,权重为0,可以直接跳过 。累积起来不回避 原来效果差。

理解为特征提取,应用比较广泛

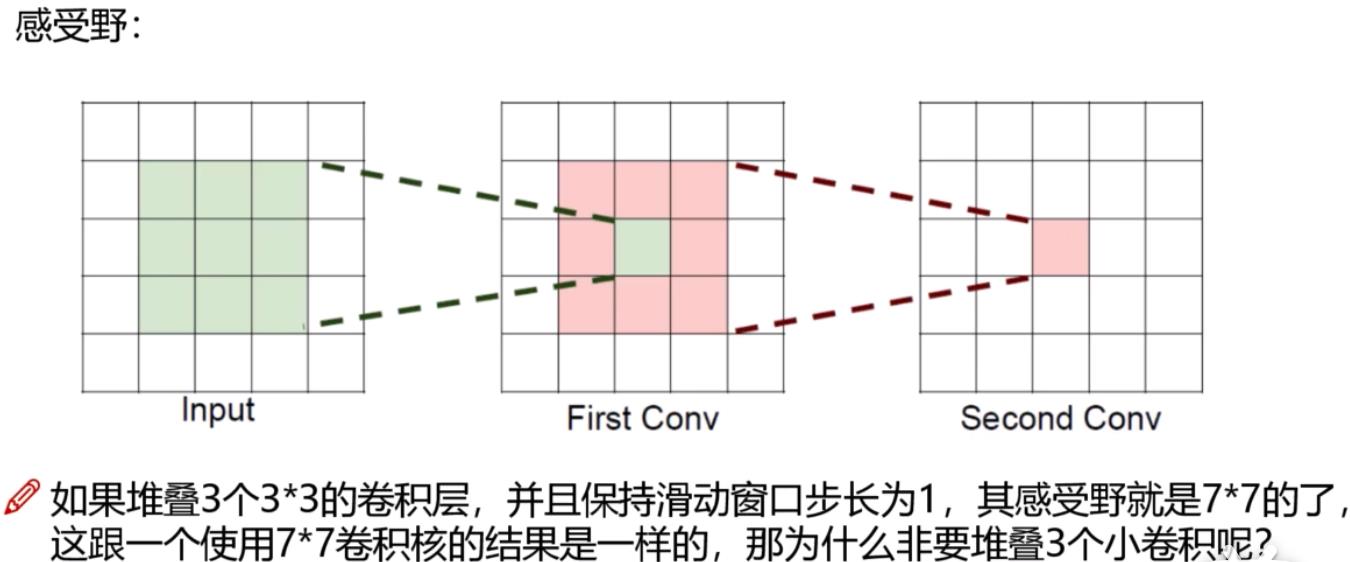

感受野

如果堆叠 3 个 3x3 的卷积层, 并且保持滑动窗口步长为 1, 其感受野就是 7x7 了. 如下图所示:

下一篇开始,结合 demo看具体参数

以上是关于卷积神经网络2 (p25-p27)的主要内容,如果未能解决你的问题,请参考以下文章