Person ReIDBag of Tricks and A Strong Baseline for Deep Person Re-identification 论文解读

Posted 浅然言而信

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Person ReIDBag of Tricks and A Strong Baseline for Deep Person Re-identification 论文解读相关的知识,希望对你有一定的参考价值。

论文名称:Bag of Tricks and A Strong Baseline for Deep Person Re-identification

论文链接:链接

论文代码:链接

目录

三、BNNeck(Batch Normalization Neck)

一、ReID baseline

主要指该篇文章发表前(18-19年)大部分ReID使用的一个baseline

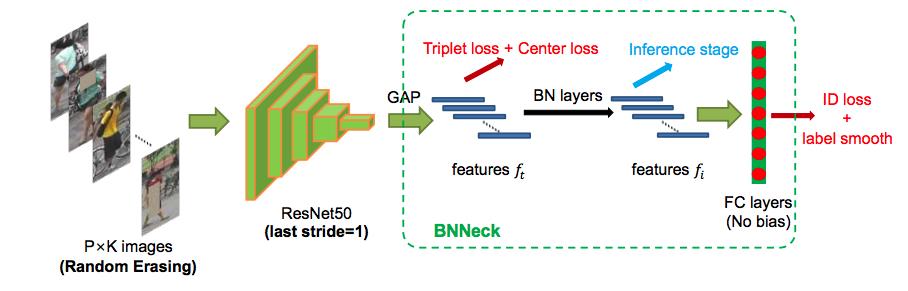

- 首先一个batch里面会有P*K张图像(P指多少人,K指每个人有K张图像)

- 经过一个CNN模型(一般会使用ResNet50),通过Backbone之后会生成feature map

- 通过GAP(Global Avg Pooling):GAP是ReID中最常见的操作之一,将特征全局平均池化为一个特征向量,用该特征向量来表征目标。

- 会得到P*K个特征,每个特征会经过一个Triplet loss(度量学习损失)和ID loss(表征学习损失),利用这两个损失来优化同一个特征

基于以上的baseline,论文主要完成了以下的贡献

- 收集评估了一些train tricks,设计了一个强大而简单的ReID baseline

- 设计了BNNeck结构(下文解释)

- 实现center loss 来弥补聚类性能(下文解释)

二、Training Tricks

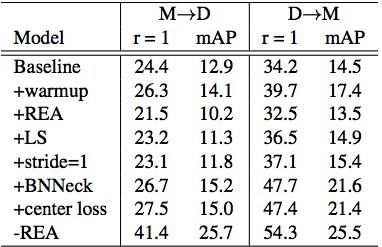

通过在训练中引入一些trick,构建了以下的strong baseline

- Warmup learning rate

- Random Erasing augmentation(数据增广阶段)

- Label smoothing(在id loss的时候加入了标签平滑)

- Last stride=1(在backbone去掉了最后一层的下采样)

- BNNeck

- Center loss

以上六个trick引入的效果如下

三、BNNeck(Batch Normalization Neck)

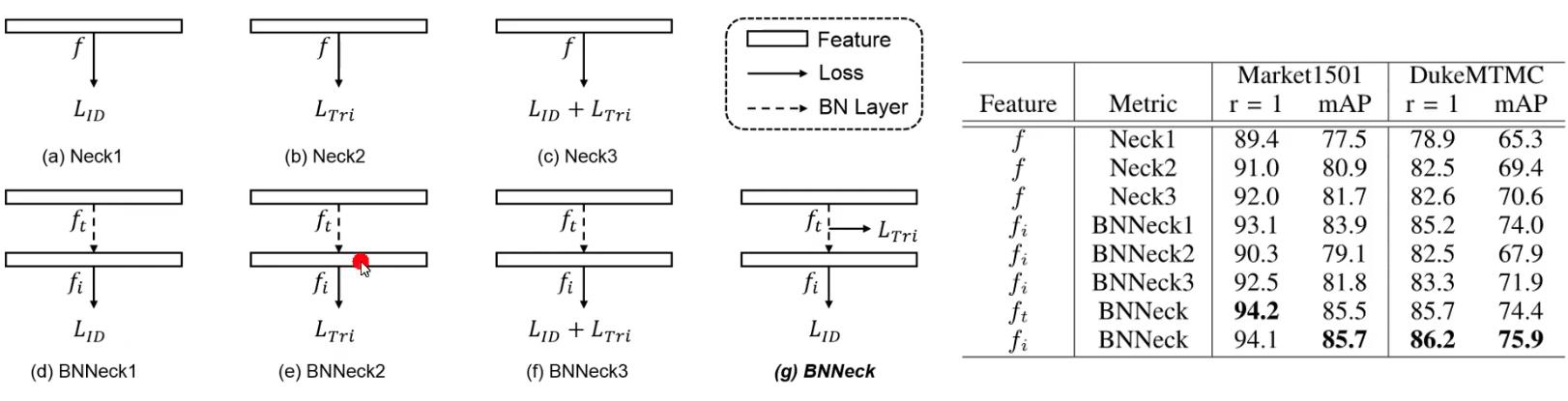

由于Triplet loss 和ID loss存在不一致性,所以加入一层BN层,BN前训练Triplet loss,BN后的训练ID loss。(推理阶段利用BN后特征进行推理)

实验依据如下图,得出以下结论:

- 结合id loss和triplet loss 比只有一个loss效果要好

- BN层有利于id loss 但不利于 triplet loss

四、Center loss

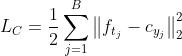

center loss的原理主要是在softmax loss的基础上,通过对训练集的每个类别在特征空间分别维护一个类中心,在训练过程,增加样本经过网络映射后在特征空间与类中心的距离约束,从而兼顾了类内聚合与类间分离。

最早是由Yandong Wen, Kaipeng Zhang, Zhifeng Li, and Yu Qiao. A discriminative feature learning approach for deep face recognition. In European conference on computer vision, pages 499–515. Springer, 2016.提出

- 将特征到类别中心的距离当成loss加进去

:center loss的权重

:center loss的权重 经过实验设置为0.0005

经过实验设置为0.0005

五、实验结果

same domain & cross domain

以上是关于Person ReIDBag of Tricks and A Strong Baseline for Deep Person Re-identification 论文解读的主要内容,如果未能解决你的问题,请参考以下文章