鲁棒的激光雷达与相机标定方法

Posted Being_young

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了鲁棒的激光雷达与相机标定方法相关的知识,希望对你有一定的参考价值。

点云PCL免费知识星球,点云论文速读。

文章:Optimising the selection of samples for robust lidar camera calibration

作者:Darren Tsai1 , Stewart Worrall1 , Mao Shan1 , Anton Lohr2 , and Eduardo Nebot

编译:点云PCL

代码:https://github.com/acfr/cam_lidar_calibration.git

来源:arXiv 2021

欢迎各位加入免费知识星球,获取PDF论文,欢迎转发朋友圈。文章仅做学术分享,如有侵权联系删文。未经博主同意请勿擅自转载。

论文阅读模块将分享点云处理,SLAM,三维视觉,高精地图相关的文章。公众号致力于理解三维视觉领域相关内容的干货分享,欢迎各位加入我,我们一起每天一篇文章阅读,开启分享之旅,有兴趣的可联系微信dianyunpcl@163.com。

摘要

本文提出了一个稳健的标定流程,优化校准样本的选择,以估计适合整个场景的标定参数,我们通过一个称为质量可变性(VOQ)的度量标准自动化数据选择过程,从而最大限度地减少用户采集数据的影响,该度量标准为每个校准样本集打分,实验表明,该VOQ分数与估计的校准参数能够很好地推广到整个场景相关,从而克服了现有校准算法的过度拟合问题,我们的方法的优点是简化了任何标定专业水平从业人员的标定过程,并为标定流程的输入和输出数据提供了质量的客观测量,此外,我们还使用了一种评估标定参数准确性的新方法,它涉及计算整个场景的重投影误差,以确保参数与场景中的所有特征都很好地匹配,该方法的标定流程需要90秒,平均重投影误差为1-1.2cm,在场景中均匀分布的46个姿势上的标准偏差为0.4-0.5cm。这一过程已通过高分辨率、软件可定义的激光雷达Baraja光谱扫描仪以及一台低分辨率激光雷达Velodyne VLP-16等实验得到验证。结果已经证明,尽管激光雷达技术存在巨大差异,但我们提出的方法能够估计这两种技术的鲁棒的标定参数。本文使用的代码和数据集可在https://github.com/acfr/cam_lidar_calibration.git。

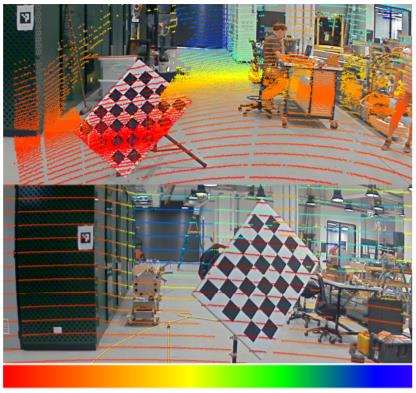

图1:Baraja光谱扫描仪标定结果 (顶部)和Velodyne VLP-16(底部)使用我们的方法,显示了整个场景的投影,以说明我们估计的校准参数适合场景,点的颜色根据到激光雷达的距离而定,距离小于3米的点为红色,距离约20米的点为蓝色

主要贡献

我们工作的目的是提供一个标定工具,该工具可以适用大多场景,并且可以由任何用户以开箱即用的方式使用,而不管标定专业知识如何,该方法允许用户简单地记录尽可能多的姿势变化,并让我们的算法自动选择最佳姿势进行校准,实际上,我们的工作旨在量化对采集数据位姿选择,以减少校准过程的难度、时间。

我们的贡献总结如下。

我们提出了质量可变性(VOQ)指标来评估校准数据,并给出了估计标定参数的泛化能力和不确定性的指示,此度量中使用的特征是大多数其他基于目标的方法中使用的常见特征。

我们认为校准质量并不取决于目标的拟合程度,而是取决于校准参数对整个场景的拟合程度,为了评估这一点,我们对提出的校准流程进行稳健评估,计算均匀分布在校准区域的姿势重投影误差的平均值和标准偏差。

本文使用的代码和数据集均开源可用。

主要内容

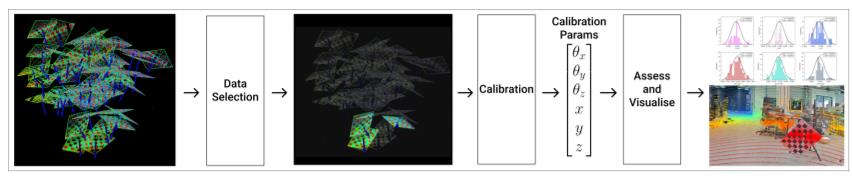

图3:该方法的标定流程,整个流程(不包括手动数据收集阶段)大约需要90秒来评估数据和估计校准参数

我们采用提取棋盘格目标的中心点和平面法线nL,旋转矩阵R_L_C表示相机法线N_C,以与相应的激光雷达法线N_L进行对齐,如等式(1)所示,假设我们知道NC和NL,我们可以求解该旋转矩阵:

在前人的基础上进行了优化,允许在NL和NC中包含更多法线,通过过度训练问题来提高算法的鲁棒性,从而避开了对线性依赖问题,在现有方法中,在计算中包含更多样本是一种常见的方法,然而,在实践中,人们发现,虽然更多的姿势更健壮,但也容易过度拟合棋盘格,在这项工作中,我们没有对单个校准结果使用更多的姿势,而是选择使用多组的3个姿位姿的方法,以获得具有不确定性的校准参数的稳健估计,使用3个姿势的原因是可以完全约束等式(1),并使NC和NL成为方形矩阵(3*3的矩阵),拥有一个方形矩阵可以对矩阵进行更有意义的分析。

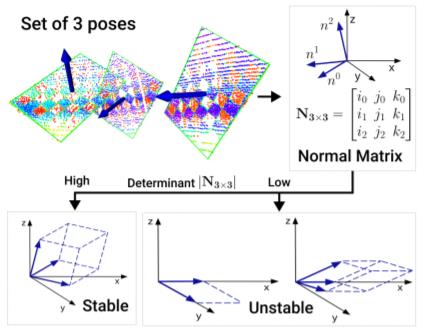

A. 法向量矩阵中的线性相关性

为了避免位姿的冗余,当我们需要计算NC时,能够识别法线矩阵中的线性相关性是很重要的,当我们解方程(1)中的RCL时,当两行或更多行在法线矩阵中接近线性相关时,逆矩阵的计算变得不稳定,并可能对校准结果产生不利影响。对于没有经验的用户来说,知道如何使用棋盘格的位姿可能会很困难,法线矩阵N3×3勾勒出一个平行六面体,其有符号体积可通过取行列式| N3×3 |来计算,行列式| N3×3 |是线性变换的体积比例因子。当行列式为零时,平行六面体几乎没有定义,其体积无法很好地计算,因此其逆运算不稳定,如图5所示。

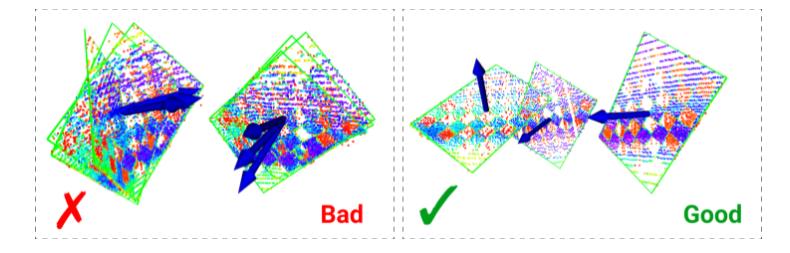

图5:线性相关性的图示。当目标平面的法线(蓝色箭头)有足够的变化时,它会勾勒出一个具有较大行列式的明显的平行(稳定)点,即该平行点的体积。然而,如果法线具有相似或完全相同的方向,则平行点很难定义或不存在,且行列式接近于零。

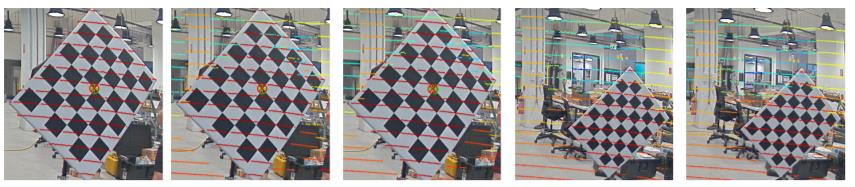

尽可能地改变棋盘格的偏航和俯仰角,对于不好的姿势(左),棋盘的法线对齐,以便其尖端画出一条线,并且它们都处于相同的位置,从而使棋盘在该位置过度拟合的可能性更大。对于良好的姿势(右),我们可以看到棋盘方向和位置的变化。

B. 激光雷达测量误差

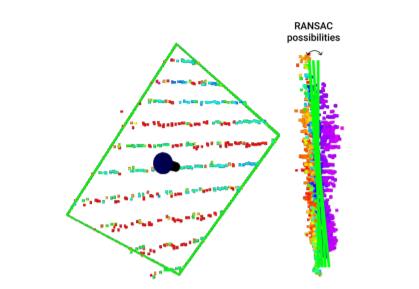

为了更好地估计基于目标的方法的标定参数,需要准确地提取目标的特,然而,在现实中,激光雷达和相机都存在测量误差,影响特征提取过程的准确性,激光雷达的射程精度往往有误差,例如,如果Velodyne VLP-16采集的数据有±3 cm的范围精度,我们的标准方法首先使用随机抽样一致性(RANSAC)确定目标的边缘线,然后找到边缘线的交点来识别棋盘的角点,棋盘格角是受到棋盘上的点数以及这些点数的范围精度的严重影响,如图6所示。

图6:激光雷达距离误差可能会导致它提取到有倾斜角度的棋盘(左),这将错误的估计棋盘格平面(右)。这两个因素都会影响目标特征提取的准确性。

文章通过评估棋盘测量的误差,我们可以对棋盘角点和中心估计的精度进行定量测量。由于平移向量是通过在相机和激光雷达中对齐棋盘的中心来计算的,因此中心估计中的错误将导致校准结果中的错误。

C.质量可变性(VOQ)度量

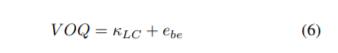

对于一组3个姿势,我们可以使用矩阵的条件评估旋转参数的质量,使用棋盘格测量中的误差评估平移参数的质量,我们将这些指标组合成等式(6)中定义的单个方程,称为质量可变性(VOQ)。

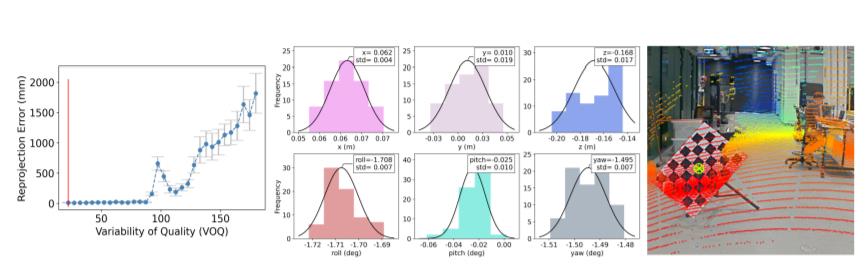

图4:我们计算了50个选定集合的平均VOQ(左图上的红线),并对这些集合产生的结果进行高斯(中间)建模,以获得具有不确定性的估计参数。尽管VOQ较低,但结果可能会有所不同,因为每个姿势集都专门适合其范围。因此,我们取50组的平均值作为最终结果。

实验

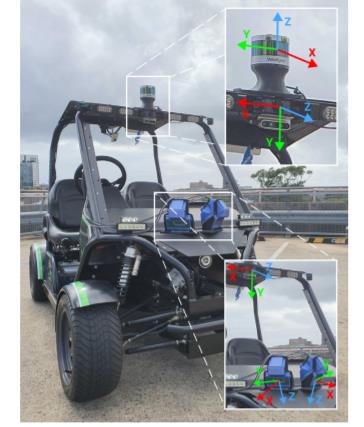

传感器配置。右上角显示VLP-16和相机的坐标系,右下角显示两个Baraja光谱扫描仪和摄像头。

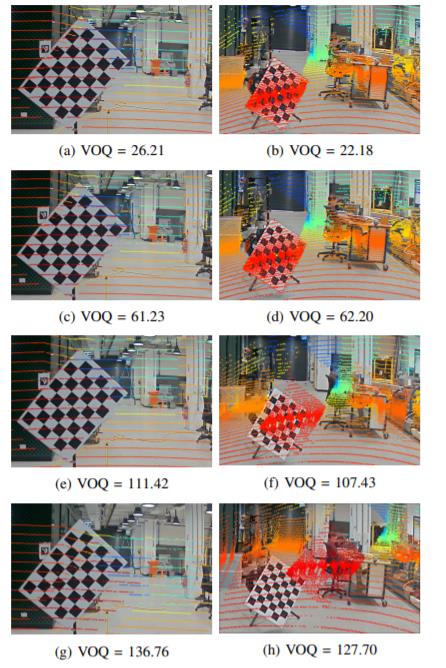

在图11中,VLP-16和Baraja SpectrumScan的激光雷达点云已投影到特定VOQ分数的图像上进行视觉比较,以验证我们方法的有效性

图11:使用虚线所示VOQ分数处的估计校准参数,将激光雷达点云投影到图像上,左侧是VLP16与相机的校准结果,右侧是Baraja光谱扫描与相机标定结果,随着50组的平均VOQ分数增加,场景错位、重投影误差平均值和标准偏差也随之增加,这种相关性在VLP-16和Baraja光谱扫描中都可以观察到 。

总结

本文提出了一种新的、鲁棒的校准方法,重点是优化数据选择过程,我们通过投影整个点云并评估估计的校准参数是否适合整个场景,而不是是否适合单个位姿,从而提供结果的准确性,我们的方法实现了1-1.2cm的平均重投影误差,标准偏差为0.4-0.5cm,整个流程需要90秒,这种方法还带来了简化校准过程的额外好处,适用于任标定人员,他们只需要专注于为算法提供大量不同的数据,此外,我们使用户能够定量评估所提供的数据,以及待估计的校准参数的质量。

资源

三维点云论文及相关应用分享

【点云论文速读】基于激光雷达的里程计及3D点云地图中的定位方法

3D-MiniNet: 从点云中学习2D表示以实现快速有效的3D LIDAR语义分割(2020)

PCL中outofcore模块---基于核外八叉树的大规模点云的显示

更多文章可查看:点云学习历史文章大汇总

SLAM及AR相关分享

点击下方微信视频号可查看最新研究成果及相关开源方案的演示:

如果你对本文感兴趣,请点击“原文阅读”获取知识星球二维码,务必按照“姓名+学校/公司+研究方向”备注加入免费知识星球,免费下载pdf文档,和更多热爱分享的小伙伴一起交流吧!

以上内容如有错误请留言评论,欢迎指正交流。如有侵权,请联系删除

扫描二维码

关注我们

让我们一起分享一起学习吧!期待有想法,乐于分享的小伙伴加入免费星球注入爱分享的新鲜活力。分享的主题包含但不限于三维视觉,点云,高精地图,自动驾驶,以及机器人等相关的领域。

分享及合作:群主微信“920177957”(需要按要求备注) 联系邮箱:dianyunpcl@163.com,欢迎企业来联系公众号展开合作。

点一下“在看”你会更好看耶

以上是关于鲁棒的激光雷达与相机标定方法的主要内容,如果未能解决你的问题,请参考以下文章