现代信号处理 18 - 随机过程的线性预测

Posted Ciaran-byte

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了现代信号处理 18 - 随机过程的线性预测相关的知识,希望对你有一定的参考价值。

随机过程的线性预测

1. 随机过程线性预测问题

1.1 问题引入

前面介绍了一些线性预测的方法,比如levension迭代。但是,现在我们想要知道,对随机信号进行线性预测,究竟能够达到一个怎么样的程度。

我们先把线性预测问题重申一下,假设我们要预测一个宽平稳的随机过程。

Z ( k ) \\ Z(k) \\ Z(k)

我们现在有P个数据,全部都发生在k时刻之前,我们希望用这P个数据去预测k时刻的值

Z ( k ) ← Z ( k − 1 ) , . . . , Z ( k − P ) Z(k) \\leftarrow \\ Z(k-1),...,Z(k-P) \\ Z(k)←Z(k−1),...,Z(k−P)

预测的方法是对这P个数据进行线性组合。

∑ m = 1 P α m Z ( k − m ) \\sum_m=1^P \\alpha_m Z(k-m) m=1∑PαmZ(k−m)

我们假设线性的系数已经是最优的了

α 1 , . . , α P = a r g m i n α E ∣ Z ( k ) − ∑ m = 1 P α m Z ( k − m ) ∣ 2 \\ \\alpha_1,..,\\alpha_P \\ = argmin_\\alpha E|Z(k) - \\sum_m=1^P \\alpha_m Z(k-m) |^2 α1,..,αP=argminαE∣Z(k)−m=1∑PαmZ(k−m)∣2

ϵ P = Z ( k ) − ∑ m = 1 P α m Z ( k − m ) \\epsilon_P = Z(k) - \\sum_m=1^P \\alpha_m Z(k-m) ϵP=Z(k)−m=1∑PαmZ(k−m)

这个方程的求解之前介绍过,通过levension迭代可以解这个wiener hopf方程

Wiener Hopf R Z α = r \\text Wiener Hopf \\\\ R_Z \\alpha = r Wiener HopfRZα=r

一般来说,随着P的增加,估计的误差会不断减小。但是我们想知道,随着P的无穷增加,误差会不会存在一个极限。我们之前探讨过使用Cramér–Rao来判断估计问题的极限,不过这里是线性估计问题,下界可能会有所差异

E ∣ ϵ P ∣ 2 = σ P 2 σ P 2 ≥ σ P + 1 2 ≥ . . . P → ∞ → σ ∞ 2 E|\\epsilon_P|^2 = \\sigma_P^2 \\\\ \\sigma_P^2 \\geq \\sigma_P+1^2 \\geq ... \\underrightarrowP \\rightarrow \\infty \\quad \\sigma_\\infty^2 E∣ϵP∣2=σP2σP2≥σP+12≥...P→∞σ∞2

我们现在希望能够在有限的条件下,找到这个估计的下界。

这个估计的下界是存在的,我们先说结论

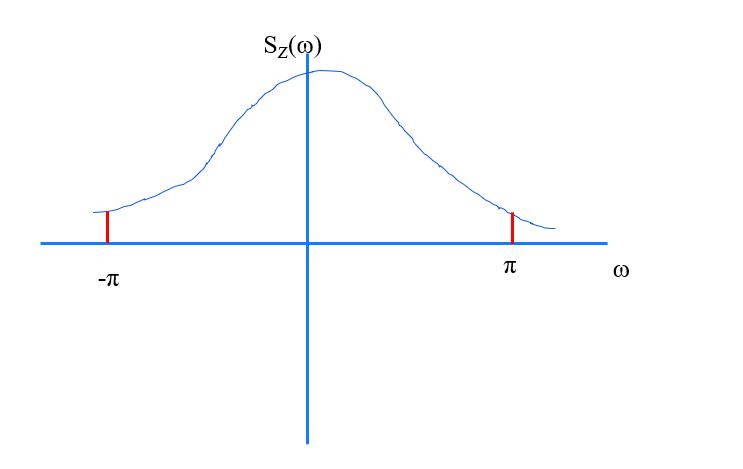

kolmogorov-Szago Identity σ ∞ 2 = e x p ( 1 2 π ∫ − π π l o g ( S Z ( ω ) ) d ω ) \\textkolmogorov-Szago Identity \\sigma_\\infty^2 = exp(\\frac12\\pi \\int _-\\pi^\\pi log( S_Z(\\omega))d\\omega) kolmogorov-Szago Identityσ∞2=exp(2π1∫−ππlog(SZ(ω))dω)

其中SZ(ω)是Z(k)的功率谱密度

1.2 公式解读

我们可以发现,估计的下界与功率谱有关系。因此,我们一旦知道了一个随机过程的功率谱密度,我们就能够知道预测可以做到怎么样的地步

为什么预测会与功率谱密度相关呢

假设功率谱密度比较集中在零点附近,log之后,对功率谱做积分,会得到负值非常大的数字,积分就会趋近于负无穷,取指数之后,就接近与0。说明我们能够很准确的预测。这是因为,如果功率谱比较集中,相关函数就会比较发散,比较胖。就说明不同时刻随机过程的取值,相关度比较高,说明数据之间具有密切的关系,预测就比较好做

这里加一些自己的注解。因为相关函数和功率谱是傅里叶变换对的关系,相关函数是时域,功率谱是频域。如果功率谱比较集中,极端的看就是频谱上只有有限的几根线,时域上就是个标准的正弦函数曲线的叠加。因为相关函数是两个时间差的函数,一旦时域是无限长的函数,就说明任意两个时刻的点都具有相关性。相关性一旦强了,预测就好做

反之,我们知道,如果功率谱很宽,积分会收敛,指数值就能够求出来,就说明误差就会有下界。因为功率谱一旦宽了,相关函数就会比较密集,不同时刻的相关度就会比较低。既然数据相关性不大,那么预测也难做。

1.3 白噪声的预测误差分析

我们以白噪声为例,白噪声的功率谱是个常数。我们求解一下误差下界的这个式子,最后求出来的结果就是功率谱密度

White Noise σ ∞ P = e x p ( 1 2 π ∫ − π π l o g ( S Z ( ω ) ) d ω ) = e x p ( 1 2 π ∫ − π π l o g ( C ) d ω ) = C = S Z ( ω ) \\textWhite Noise \\sigma_\\infty^P = exp(\\frac12\\pi \\int _-\\pi^\\pi log( S_Z(\\omega))d\\omega) \\\\ = exp(\\frac12\\pi \\int _-\\pi^\\pi log( C)d\\omega) \\\\ = C = S_Z(\\omega) White Noiseσ∞P=exp(2π1∫−ππlog(SZ(ω))dω)=exp(2π1∫−ππlog(C)dω)=C=SZ(ω)

再来看一下相关函数,如果功率谱密度是常数,则相关函数的这个积分,只有t=0的时候有值

R Z ( τ ) = 1 2 π ∫ − ∞ + ∞ S Z ( ω ) e x p ( j ω τ ) d ω R Z ( τ ) = C δ ( τ ) R Z ( 0 ) = C R_Z(\\tau) = \\frac12\\pi \\int_-\\infty^+\\infty S_Z(\\omega) exp(j\\omega \\tau)d\\omega \\\\ R_Z(\\tau) = C \\delta(\\tau) \\\\ R_Z(0) = C RZ(τ)=2π1∫−∞+∞SZ(ω)exp(jωτ)dωRZ(τ)=Cδ(τ)RZ(0)=C

因此

σ ∞ P = R Z ( 0 ) = E ( Z ( t ) Z ( t ) ) = E ( ( Z ( t ) − 0 ) 2 ) \\sigma_\\infty^P = R_Z(0) = E(Z(t)Z(t)) = E((Z(t)-0)^2) σ∞