Day449.kafka概述&快速入门 -kafka

Posted 阿昌喜欢吃黄桃

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Day449.kafka概述&快速入门 -kafka相关的知识,希望对你有一定的参考价值。

Kafka 概述

一、定义

Kafka 是一个分布式的基于发布/订阅模式的消息队列(Message Queue),主要应用于大数据实时处理领域。

二、消息队列

1、传统消息队列的应用场景

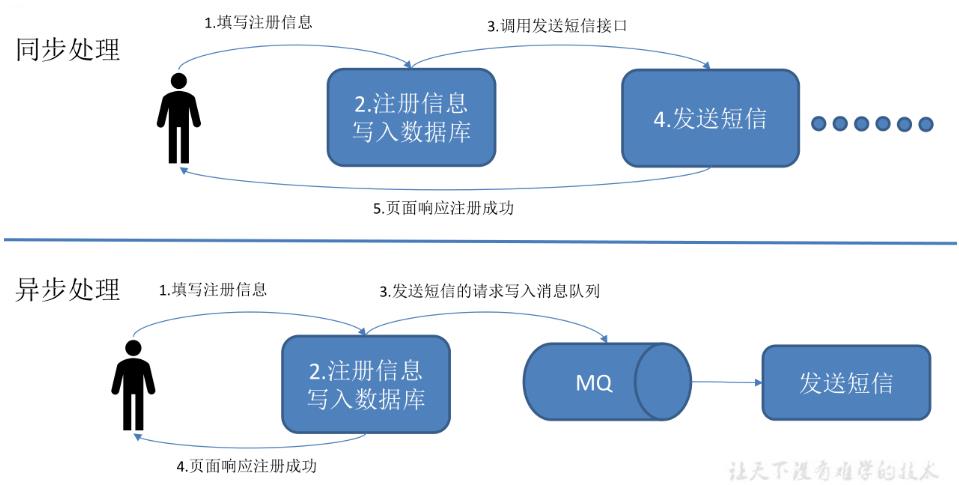

- MQ传统应用场景之异步处理

异步、削峰、解耦

-

使用消息队列的好处

-

1)解耦

允许你独立的扩展或修改两边的处理过程,只要确保它们遵守同样的接口约束。 -

2)可恢复性

系统的一部分组件失效时,不会影响到整个系统。消息队列降低了进程间的耦合度,所以即使一个处理消息的进程挂掉,加入队列中的消息仍然可以在系统恢复后被处理。 -

3)缓冲

有助于控制和优化数据流经过系统的速度,解决生产消息和消费消息的处理速度不一致的情况

-

4)灵活性 & 峰值处理能力

在访问量剧增的情况下,应用仍然需要继续发挥作用,但是这样的突发流量并不常见。如果为以能处理这类峰值访问为标准来投入资源随时待命无疑是巨大的浪费。使用消息队列能够使关键组件顶住突发的访问压力,而不会因为突发的超负荷的请求而完全崩溃。

-

5)异步通信

很多时候,用户不想也不需要立即处理消息。消息队列提供了异步处理机制,允许用户把一个消息放入队列,但并不立即处理它。想向队列中放入多少消息就放多少,然后在需要的时候再去处理它们。

-

-

消息队列的 两种模式

-

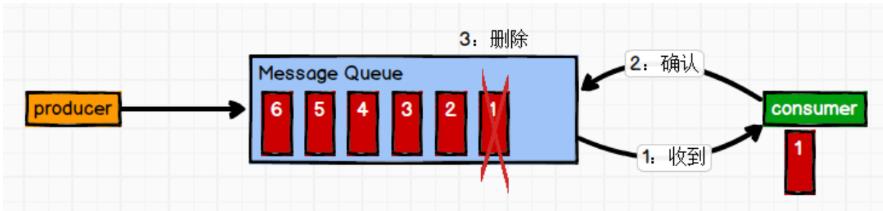

(1 )

点对点模式(一对一,消费者主动拉取数据,消息收到后消息清除)消息生产者生产消息发送到Queue中,然后消息消费者从Queue中取出并且消费消息。消息被消费以后,queue 中不再有存储,所以消息消费者不可能消费到已经被消费的消息。Queue 支持存在多个消费者,但是对一个消息而言,只会有一个消费者可以消费。

-

(2 )

发布/ 订阅模式(一对多,消费者消费数据之后不会清除消息)消息生产者(发布)将消息发布到 topic 中,同时有多个消息消费者(订阅)消费该消息。和点对点方式不同,发布到 topic 的消息会被所有订阅者消费。

-

三、Kafka 基础架构

-

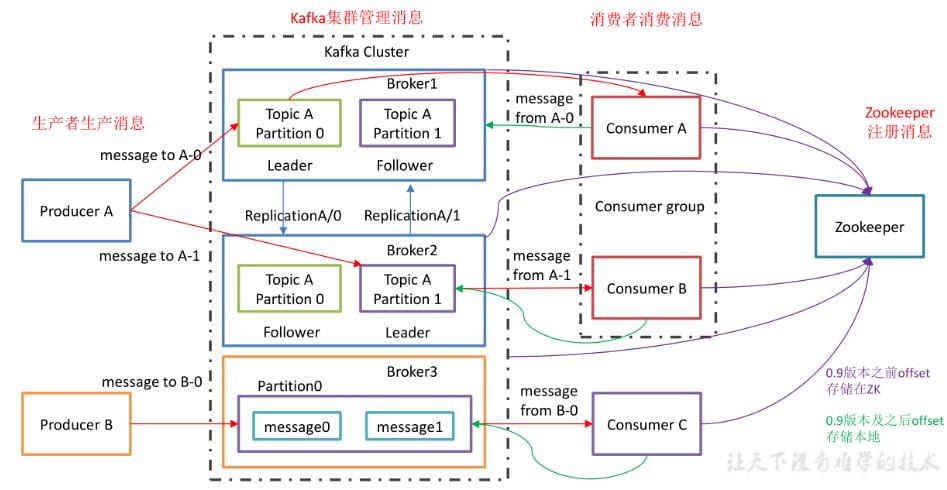

1 )Producer :消息生产者,就是向 kafka broker 发消息的客户端;

-

2 )Consumer :消息消费者,向 kafka broker 取消息的客户端;

-

3 )Consumer Group (CG ):消费者组,由多个 consumer 组成。 消费者组内每个消费者负责消费不同分区的数据,一个分区只能由一个 组内 消费者消费;消费者组之间互不影响。所有的消费者都属于某个消费者组,即 消费者组是逻辑上的一个订阅者。

-

4 )Broker :一台 kafka 服务器就是一个 broker。一个集群由多个 broker 组成。一个 broker可以容纳多个topic。

-

5 )Topic :可以理解为一个队列, 生产者和消费者面向的都是一个 topic;

-

6 )Partition :为了实现扩展性,一个非常大的 topic 可以分布到多个 broker(即服务器)上,一个 topic 可以分为多个 partition,每个 partition 是一个有序的队列;

-

7)Replica: :副本,为保证集群中的某个节点发生故障时,该节点上的 partition 数据不丢失,且 kafka 仍然能够继续工作,kafka 提供了副本机制,一个 topic 的每个分区都有若干个副本,一个 leader 和若干个 follower。

-

8 )leader :每个分区多个副本的“主”,生产者发送数据的对象,以及消费者消费数据的对象都是 leader。

-

9 )follower :每个分区多个副本中的“从”,实时从 leader 中同步数据,保持和 leader 数据的同步。leader 发生故障时,某个 follower 会成为新的 follower。

Kafka 快速入门

一、安装部署

1、集群规划

| hadoop102 | hadoop103 | hadoop104 |

|---|---|---|

| zk | zk | zk |

| kafka | kafka | kafka |

2、jar 包下载

http://kafka.apache.org/downloads.html

3、集群部署

- 解压安装包

tar -zxvf kafka_2.11-0.11.0.0.tgz -C /opt/module/

- 修改解压后的文件名称

mv kafka_2.11-0.11.0.0/ kafka

- 在/opt/module/kafka 目录下创建 logs 文件夹

mkdir logs

- 修改配置文件

cd config/

vi server.properties

# 输入以下内容:

#----------------

#broker 的全局唯一编号,不能重复

broker.id=0

#删除 topic 功能使能

delete.topic.enable=true

#处理网络请求的线程数量

num.network.threads=3

#用来处理磁盘 IO 的现成数量

num.io.threads=8

#发送套接字的缓冲区大小

socket.send.buffer.bytes=102400

#接收套接字的缓冲区大小

socket.receive.buffer.bytes=102400

#请求套接字的缓冲区大小

socket.request.max.bytes=104857600

#kafka 运行日志存放的路径

log.dirs=/opt/module/kafka/logs

#topic 在当前 broker 上的分区个数

num.partitions=1

#用来恢复和清理 data 下数据的线程数量

num.recovery.threads.per.data.dir=1

#segment 文件保留的最长时间,超时将被删除

log.retention.hours=168

#配置连接 Zookeeper 集群地址

zookeeper.connect=hadoop102:2181,hadoop103:2181,hadoop104:2181

- 配置环境变量

sudo vi /etc/profile

#KAFKA_HOME

export KAFKA_HOME=/opt/module/kafka

export PATH=$PATH:$KAFKA_HOME/bin

source /etc/profile

- 分发安装包

xsync kafka/

注意:分发之后记得配置其他机器的环境变量

- 分别在 hadoop103 和 hadoop104 上修改配置文件/opt/module/kafka/config/server.properties中的broker.id=1、broker.id=2

注:broker.id 不得重复

- 启动集群

依次在 hadoop102、hadoop103、hadoop104 节点上启动 kafka

bin/kafka-server-start.sh -daemon config/server.properties

bin/kafka-server-start.sh -daemon config/server.properties

bin/kafka-server-start.sh -daemon config/server.properties

- 关闭集群

bin/kafka-server-stop.sh stop

bin/kafka-server-stop.sh stop

bin/kafka-server-stop.sh stop

- kafka 群起脚本

for i in hadoop102 hadoop103 hadoop104

do

echo "========== $i =========="

ssh $i '/opt/module/kafka/bin/kafka-server-start.sh -daemon /opt/module/kafka/config/server.properties'

done

二、Kafka 命令行操作

- 查看当前服务器中的所有 topic

bin/kafka-topics.sh --zookeeper hadoop102:2181 --list

- 创建 topic

bin/kafka-topics.sh --zookeeper hadoop102:2181 --create --replication-factor 3 --partitions 1 --topic first

选项说明:

–topic 定义 topic 名–replication-factor 定义副本数

–partitions 定义分区数

- 删除 topic

需要 server.properties 中设置 delete.topic.enable=true 否则只是标记删除。

bin/kafka-topics.sh --zookeeper hadoop102:2181 --delete --topic first

- 发送消息

bin/kafka-console-producer.sh --broker-list hadoop102:9092 --topic first

>hello achang

>achang achang

- 消费消息

bin/kafka-console-consumer.sh \\ --zookeeper hadoop102:2181 --topic first

bin/kafka-console-consumer.sh \\ --bootstrap-server hadoop102:9092 --topic first

bin/kafka-console-consumer.sh \\ --bootstrap-server hadoop102:9092 --from-beginning --topic first

--from-beginning:会把主题中以往所有的数据都读取出来。

- 查看某个 Topic 的详情

bin/kafka-topics.sh --zookeeper hadoop102:2181 --describe --topic first

- 修改分区数

bin/kafka-topics.sh --zookeeper hadoop102:2181 --alter --topic first --partitions 6

以上是关于Day449.kafka概述&快速入门 -kafka的主要内容,如果未能解决你的问题,请参考以下文章