数据采集使用scrapy采集天气网豆瓣数据信息

Posted 小生凡一

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了数据采集使用scrapy采集天气网豆瓣数据信息相关的知识,希望对你有一定的参考价值。

- 🎉粉丝福利送书:《 Python数据分析与可视化从入门到精通 》

- 🎉点赞 👍 收藏 ⭐留言 📝 即可参与抽奖送书

- 🎉这周六(11月6日)晚上20:00将会在【点赞区和评论区】抽一位粉丝送这本北京大学出版社的书~🙉

- 🎉详情请看最后的的介绍嗷~✨

第三次实验

实验 1

1.1 题目

指定一个网站,爬取这个网站中的所有的所有图片,例如中国气象网(http://www.weather.com.cn),分别使用单线程和多线程的方式爬取。(限定爬取图片数量为学号后3位)

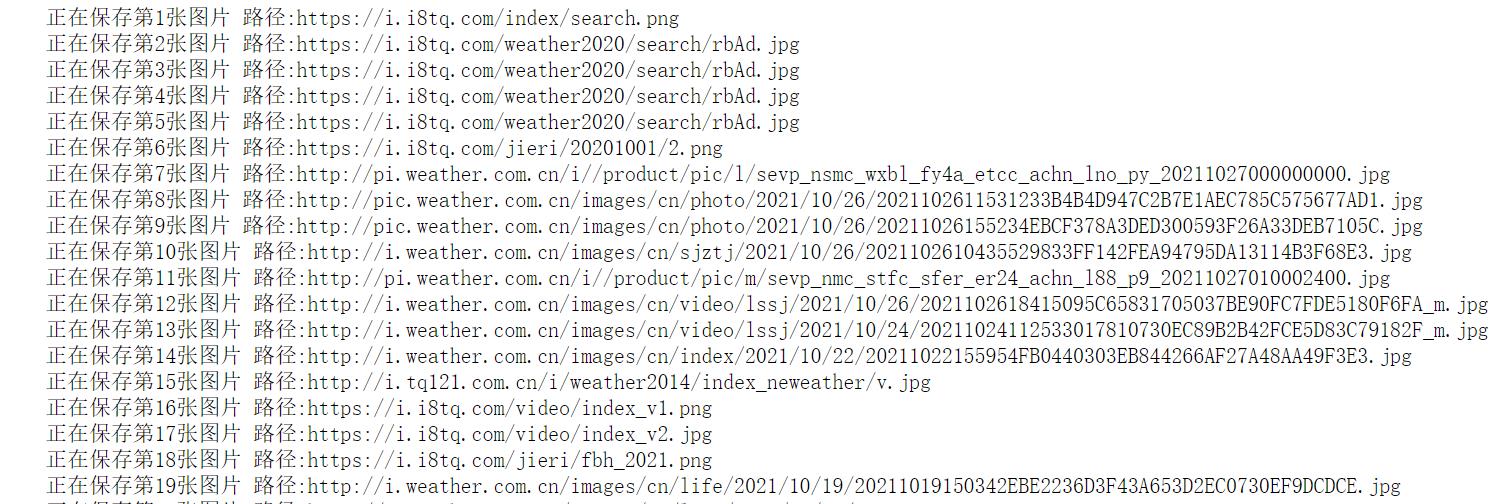

输出信息: 将下载的Url信息在控制台输出,并将下载的图片存储在images子文件中,并给出截图。

1.2 思路

1.2.1 发送请求

- 构造请求头

import requests,re

import urllib

headers =

'Connection': 'keep-alive',

'Cache-Control': 'max-age=0',

'Upgrade-Insecure-Requests': '1',

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (Khtml, like Gecko) Chrome/94.0.4606.61 Safari/537.36',

'Accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,image/avif,image/webp,image/apng,*/*;q=0.8,application/signed-exchange;v=b3;q=0.9',

'Accept-Language': 'zh-CN,zh;q=0.9',

url = "http://www.weather.com.cn/"

request = urllib.request.Request(url, headers=headers)

- 发送请求

request = urllib.request.Request(url, headers=headers)

r = urllib.request.urlopen(request)

1.2.2 解析网页

页面解析,并且替换回车,方便后续进行正则匹配图片。

html = r.read().decode().replace('\\n','')

1.2.3 获取结点

使用正则匹配,先获取所有的a标签,然后爬取a标签下面的所有图片

urlList = re.findall('<a href="(.*?)" ',html,re.S)

获取所有的图片

allImageList = []

for k in urlList:

try:

request = urllib.request.Request(k, headers=headers)

r = urllib.request.urlopen(request)

html = r.read().decode().replace('\\n','')

imgList = re.findall(r'<img.*?src="(.*?)"', html, re.S)

allImageList+=imgList

except Exception as e:

pass

这里的请求其实也是要用多线程爬取的,所有后续会补上!

1.2.4 数据保存 (单线程)

for i, img in enumerate(allImageList[:102]):

print(f"正在保存第i + 1张图片 路径:img")

resp = requests.get(img)

with open(f'./image/img.split("/")[-1]', 'wb') as f: # 保存到这个image路径下

f.write(resp.content)

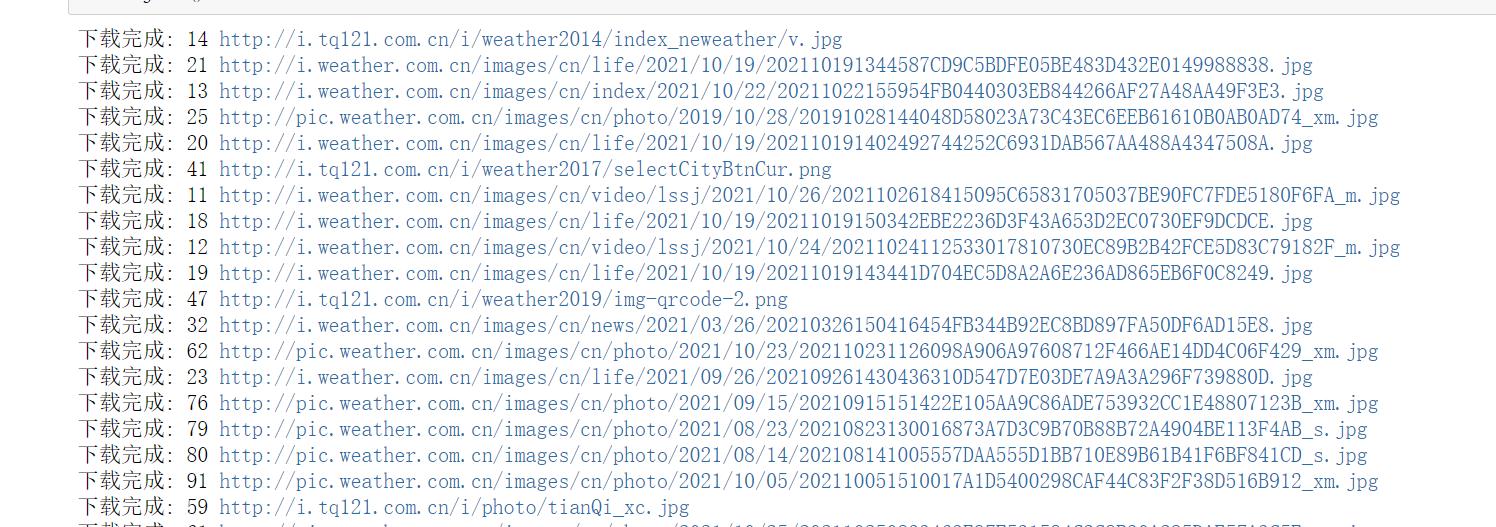

1.2.4 数据保存 (多线程)

- 引入多进程模块

import threading

# 多线程

def download_imgs(imgList,limit):

threads = []

T = [

threading.Thread(target = download, args=(url,i))

for i, url in enumerate(imgList[:limit + 1])

]

for t in T:

t.start()

threads.append(t)

return threads

- 编写下载函数

def download(img_url,name):

resp = requests.get(img_url)

try:

resp = requests.get(img_url)

with open(f'./images/name.jpg', 'wb') as f:

f.write(resp.content)

except Exception as e:

print(f"下载失败: name img_url -> e")

else:

print(f"下载完成: name img_url")

就很随机

实验 2

2.1 题目

使用scrapy框架复现作业①

2.2 思路

2.2.1 setting.py

- 解除限制

ROBOTSTXT_OBEY = False

- 设置保存图片的路径

IMAGES_STORE = r'.\\images' # 保存文件的路径

- 打开pipelines

ITEM_PIPELINES =

'weatherSpider.pipelines.WeatherspiderPipeline': 300,

- 设置请求头

DEFAULT_REQUEST_HEADERS =

'Accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8',

'Accept-Language': 'en',

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/79.0.3945.16 Safari/537.36',

2.2.2 item.py

- 设置要爬取的字段

class WeatherspiderItem(scrapy.Item):

number = scrapy.Field()

pic_url = scrapy.Field()

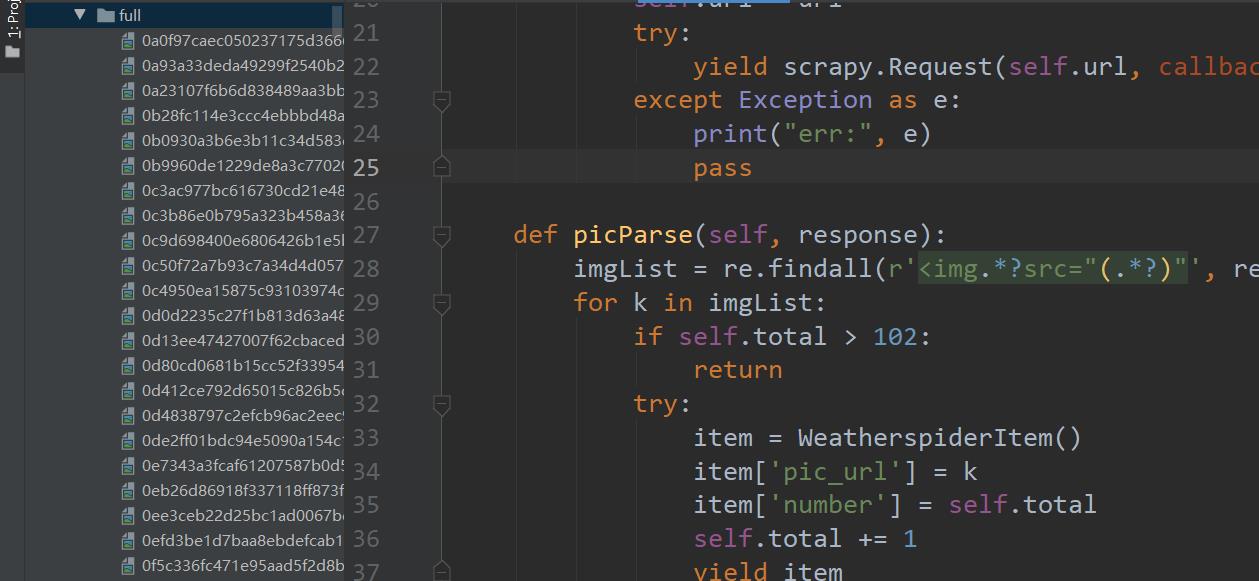

2.2.3 wt_Spider.py

- 发送请求

def start_requests(self):

yield scrapy.Request(self.start_url, callback=self.parse)

- 获取页面所有的

a标签

def parse(self, response):

html = response.text

urlList = re.findall('<a href="(.*?)" ', html, re.S)

for url in urlList:

self.url = url

try:

yield scrapy.Request(self.url, callback=self.picParse)

except Exception as e:

print("err:", e)

pass

- 再次请求所有的a标签下面的网址,再找所有的图片返回

def picParse(self, response):

imgList = re.findall(r'<img.*?src="(.*?)"', response.text, re.S)

for k in imgList:

if self.total > 102:

return

try:

item = WeatherspiderItem()

item['pic_url'] = k

item['number'] = self.total

self.total += 1

yield item

except Exception as e:

pass

- 那么与存入数据库类似,

数据处理全部都应该在pipelines.py中处理,也就是说,pipelines还是要发送请求

2.2.4 pipelines.py

- 导入setting信息

from weatherSpider.settings import IMAGES_STORE as images_store # 读取配置文件的信息

from scrapy.pipelines.images import ImagesPipeline

settings = get_project_settings()

- 编写保存函数

def get_media_requests(self, item, info):

image_url = item["pic_url"]

yield Request(image_url)

- 这里优化的话,应该保存文件的时候重命名会好一点!

实验 3

3.1 题目

爬取豆瓣电影数据使用scrapy和xpath,并将内容存储到数据库,同时将图片存储在 imgs路径下。

3.2 思路

3.2.1 setting.py

- 解除限制

ROBOTSTXT_OBEY = False

- 数据库配置

HOSTNAME = '127.0.0.1'

PORT = 3306

DATABASE = 'scrapy_douban'

USERNAME = 'root'

PASSWORD = 'root'

- 请求头

DEFAULT_REQUEST_HEADERS =

'Accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8',

'Accept-Language': 'en',

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/79.0.3945.16 Safari/537.36',

- 开启pipelines

ITEM_PIPELINES =

'doubanSpider.pipelines.DoubanspiderPipeline': 300,

3.2.2 item.py

- 定义爬取的内容字段

class DoubanspiderItem(scrapy.Item):

number = scrapy.Field()

name = scrapy.Field()

direct = scrapy.Field()

actor = scrapy.Field()

info = scrapy.Field()

score = scrapy.Field()

movie_img = scrapy.Field()

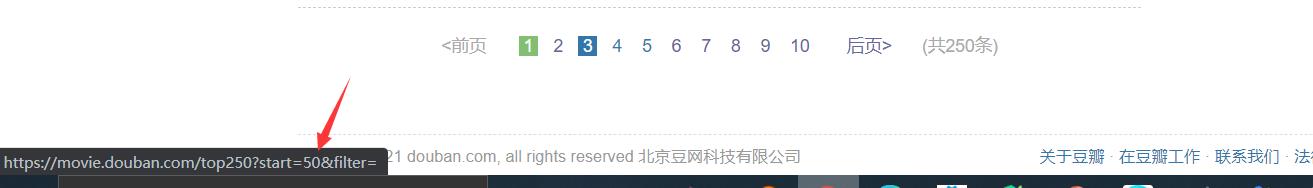

3.2.3 db_Spider.py

- 观察网页,发现翻页规律

第二页

第三页

所以我们就看到规律了!

- 初始信息

page = 0

start_url = 'https://movie.douban.com/top250'

next_url = 'https://movie.douban.com/top250?start=%s&filter='

- 爬取信息

lis = response.xpath('//*[@id="content"]/div/div[1]/ol/li')

for k in lis:

number = k.xpath('div/div[1]/em/text()').extract()

title = k.xpath('div/div[2]/div[1]/a/span[1]/text()').extract()

directT = k.xpath('div/div[2]/div[2]/p[1]/text()').extract()

score = k.xpath('div/div[2]/div[2]/div/span[2]/text()').extract()

info = k.xpath('div/div[2]/div[2]/p[2]/span/text()').extract()

img_url = k.xpath('div/div[1]/a/img/@src').extract()

tmp = directT[0].split("主演:")

- 错误处理

这里有两个地方需要处理

- 导演和演员

我是按照字符串分割进行选择这个导演和主演的!所有可能只出现主这个字的情况

所有进行以下处理

tmp = directT[0].split("主演:")

if len(tmp) < 2:

dt = tmp[0].split("导演:")

dt = dt[1]

ar = ""

else:

dt = tmp[0].split("导演:")

dt = dt[1]

ar = tmp[1]

- 另外我发现有一些的简介是没有的!

所以采用extract_first进行处理,那么没有的就是当作空来处理了

info = k.xpath('div/div[2]/div[2]/p[2]/span/text()').extract_first()

3.2.4 pipelines.py

- 数据库连接

def __init__(self):

# 获取setting中主机名,端口号和集合名

host = settings['HOSTNAME']

port = settings['PORT']

dbname = settings['DATABASE']

username = settings['USERNAME']

password = settings['PASSWORD']

self.conn = pymysql.connect(host=host, port=port,

user=username, password=password,

database=dbname,charset='utf8')

self.cursor = self.conn.cursor()

- 插入数据库中

def process_item(self, item, spider):

data = dict(item)

print("data",data)

sql = "INSERT INTO spider_douban(m_number,m_name,direct,actor,info,score,movie_img)" \\

" VALUES (%s,%s, %s, %s,%s, %s, %s)"

print("sql",sql)

try:

self.conn.commit()

self.cursor.execute(sql, [data["number"],

data["name"],

data["direct"],

data["actor"],

data["info"],

data["score"],

data["movie_img"],

])

print("插入成功")

except Exception as err:

print("插入失败", err)

return item

福利

【点赞】【评论】即可参与送书活动!!

【内容简介】

本书以“零基础”为起点,系统地介绍了Python在数据处理与可视化分析方面的应用。

全书共分3篇12章内容,具体安排如下。

-

第1篇:

基础篇:- 第1章 先来认识一下大蟒:Python入门。

- 第2章 磨好利牙,子弹上膛:准备好工作环境。

- 第3章 大蟒的基本技能之一:Python语言基础。

- 第4章 大蟒的基本技能之二:Python语言进阶。

-

第2篇:

应用篇:- 第5章 给大蟒找食:Python的数据存取操作。

- 第6章 洗干净了再吃:使用Python预处理数据。

- 第7章 什么食物有营养:大数据分析及可视化基础知识。

- 第8章 大蟒神通之一:使用matplotlib绘制基础图形。

- 第9章 大蟒神通之二:使用matplotlib美化和修饰图形。

- 第10章 大蟒神通之三:数据可视化之3D图形应用。

- 第11章 大蟒神通之四:使用图像和地图绘制图表。

-

第3篇:

实战篇:- 第12章 综合案例:全国县级市天气预报数据可视化分析。以抓取中国天气网相关数据存入MySQL数据库,并绘制相应图形为主线,综合本书各章知识点介绍了

数据采集、清理、保存以及绘制可视化图形的基本步骤和方法。

- 第12章 综合案例:全国县级市天气预报数据可视化分析。以抓取中国天气网相关数据存入MySQL数据库,并绘制相应图形为主线,综合本书各章知识点介绍了

本书既适合希望从事Python数据处理与可视化的用户学习,也适合广大职业院校作为相关专业教材。

【评论区】和 【点赞区】 会抽一位粉丝送出这本书籍嗷~

当然如果没有中奖的话,可以到当当,京东北京大学出版社的自营店进行购买。

也可以关注我!每周都会送一本出去哒~

以上是关于数据采集使用scrapy采集天气网豆瓣数据信息的主要内容,如果未能解决你的问题,请参考以下文章