神经网络多层感知机

Posted ZSYL

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了神经网络多层感知机相关的知识,希望对你有一定的参考价值。

多层感知机

我们已经介绍了包括线性回归和softmax回归在内的单层神经网络。然而深度学习主要关注多层模型。在本节中,我们将以多层感知机(multilayer perceptron,MLP)为例,介绍多层神经网络的概念。

隐藏层

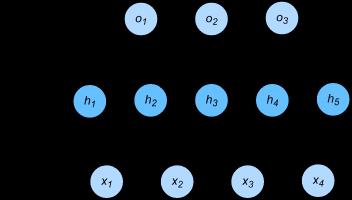

多层感知机在单层神经网络的基础上引入了一到多个隐藏层(hidden layer)。隐藏层位于输入层和输出层之间。图展示了一个多层感知机的神经网络图,它含有一个隐藏层,该层中有5个隐藏单元。

在图所示的多层感知机中,输入和输出个数分别为4和3,中间的隐藏层中包含了5个隐藏单元(hidden unit)。由于输入层不涉及计算,图中的多层感知机的层数为2。由图可见,隐藏层中的神经元和输入层中各个输入完全连接,输出层中的神经元和隐藏层中的各个神经元也完全连接。因此,多层感知机中的隐藏层和输出层都是全连接层。

具体来说,给定一个小批量样本 X ∈ R n × d \\boldsymbolX \\in \\mathbbR^n \\times d X∈Rn×d,其批量大小为 n n n,输入个数为 d d d。假设多层感知机只有一个隐藏层,其中隐藏单元个数为 h h h。记隐藏层的输出(也称为隐藏层变量或隐藏变量)为 H \\boldsymbolH H,有 H ∈ R n × h \\boldsymbolH \\in \\mathbbR^n \\times h H∈Rn×h。因为隐藏层和输出层均是全连接层,可以设隐藏层的权重参数和偏差参数分别为 W h ∈ R d × h \\boldsymbolW_h \\in \\mathbbR^d \\times h Wh∈Rd×h和 b h ∈ R 1 × h \\boldsymbolb_h \\in \\mathbbR^1 \\times h bh∈R1×h,输出层的权重和偏差参数分别为 W o ∈ R h × q \\boldsymbolW_o \\in \\mathbbR^h \\times q Wo∈Rh×q和 b o ∈ R 1 × q \\boldsymbolb_o \\in \\mathbbR^1 \\times q bo∈R1×q。

我们先来看一种含单隐藏层的多层感知机的设计。其输出 O ∈ R n × q \\boldsymbolO \\in \\mathbbR^n \\times q O∈Rn×q的计算为

H = X W h + b h , O = H W o + b o , \\beginaligned \\boldsymbolH &= \\boldsymbolX \\boldsymbolW_h + \\boldsymbolb_h,\\\\ \\boldsymbolO &= \\boldsymbolH \\boldsymbolW_o + \\boldsymbolb_o, \\endaligned HO=XWh+bh,=HWo+bo,

也就是将隐藏层的输出直接作为输出层的输入。如果将以上两个式子联立起来,可以得到

O = ( X W h + b h ) W o + b o = X W h W o + b h W o + b o . \\boldsymbolO = (\\boldsymbolX \\boldsymbolW_h + \\boldsymbolb_h)\\boldsymbolW_o + \\boldsymbolb_o = \\boldsymbolX \\boldsymbolW_h\\boldsymbolW_o + \\boldsymbolb_h \\boldsymbolW_o + \\boldsymbolb_o. O=(XWh+bh)Wo+bo=XWhWo+bhWo+bo.

从联立后的式子可以看出,虽然神经网络引入了隐藏层,却依然等价于一个单层神经网络:其中输出层权重参数为 W h W o \\boldsymbolW_h\\boldsymbolW_o WhWo,偏差参数为 b h W o + b o \\boldsymbolb_h \\boldsymbolW_o + \\boldsymbolb_o bhWo+bo。不难发现,即便再添加更多的隐藏层,以上设计依然只能与仅含输出层的单层神经网络等价。

激活函数

上述问题的根源在于全连接层只是对数据做仿射变换(affine transformation),而多个仿射变换的叠加仍然是一个仿射变换。解决问题的一个方法是引入非线性变换,例如对隐藏变量使用按元素运算的非线性函数进行变换,然后再作为下一个全连接层的输入。这个非线性函数被称为激活函数(activation function)。

下面我们介绍几个常用的激活函数:

ReLU函数

ReLU(rectified linear unit)函数提供了一个很简单的非线性变换。给定元素 x x x,该函数定义为

ReLU ( x ) = max ( x , 0 ) . \\textReLU(x) = \\max(x, 0). ReLU(x)=max(x,0).

可以看出,ReLU函数只保留正数元素,并将负数元素清零。为了直观地观察这一非线性变换,我们先定义一个绘图函数xyplot。

%matplotlib inline

import torch

import numpy as np

import matplotlib.pylab as plt

import sys

sys.path.append("..")

import d2lzh_pytorch as d2l

def xyplot(x_vals, y_vals, name):

d2l.set_figsize(figsize=(5, 2.5))

d2l.plt.plot(x_vals.detach().numpy(), y_vals.detach().numpy())

d2l.plt.xlabel('x')

d2l.plt.ylabel(name + '(x)')

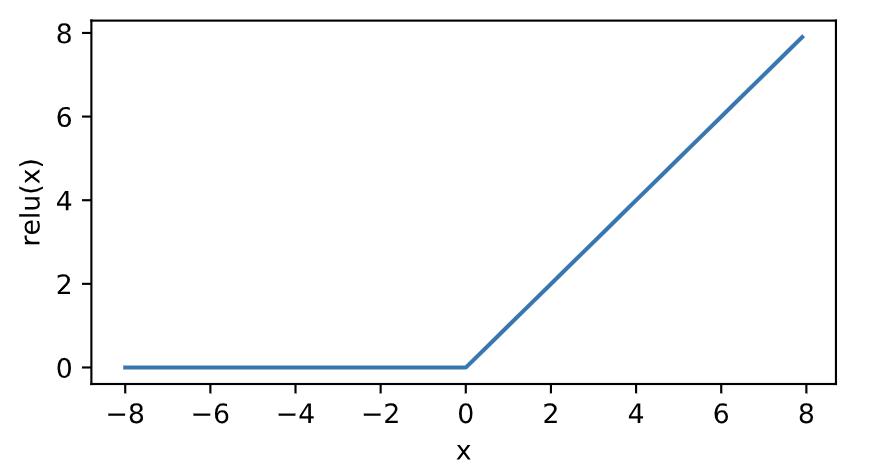

我们接下来通过Tensor提供的relu函数来绘制ReLU函数。可以看到,该激活函数是一个两段线性函数。

x = torch.arange(-8.0, 8.0, 0.1, requires_grad=True)

y = x.relu()

xyplot(x, y, 'relu')

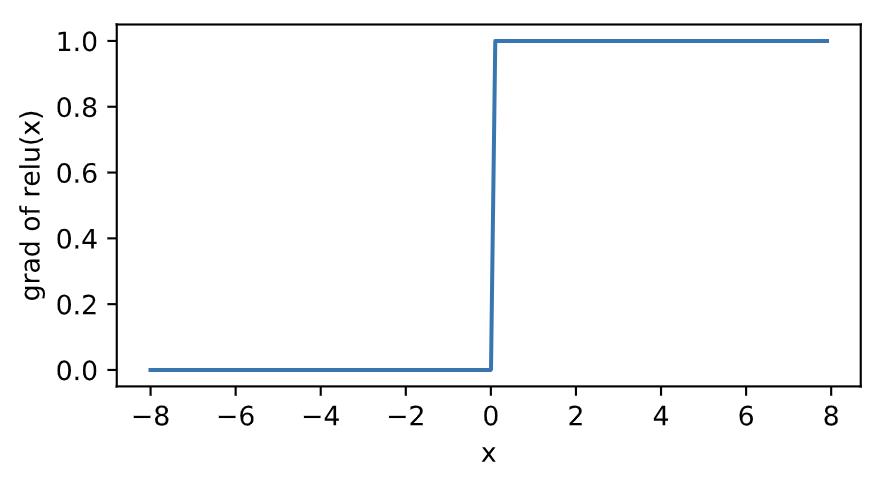

显然,当输入为负数时,ReLU函数的导数为0;当输入为正数时,ReLU函数的导数为1。尽管输入为0时ReLU函数不可导,但是我们可以取此处的导数为0。

下面绘制ReLU函数的导数:

y.sum().backward()

xyplot(x, x.grad, 'grad of relu')

sigmoid函数

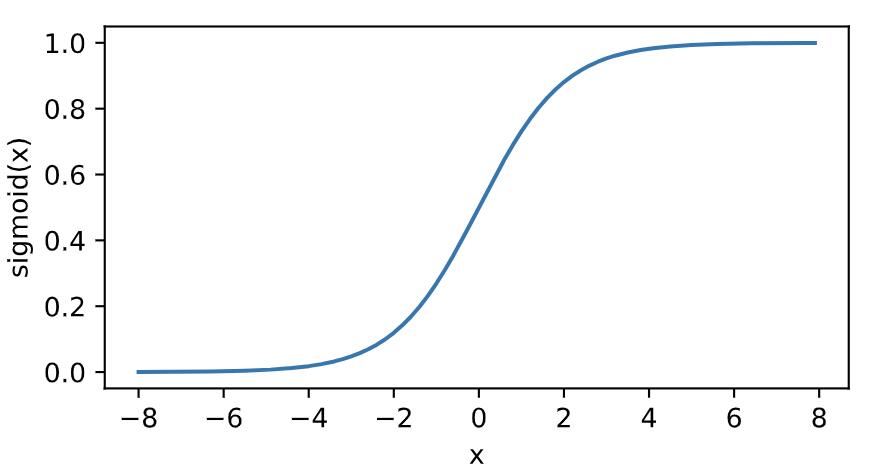

sigmoid函数可以将元素的值变换到0和1之间:

sigmoid ( x ) = 1 1 + exp ( − x ) . \\textsigmoid(x) = \\frac11 + \\exp(-x). sigmoid(x)=1+exp(−x)1.

sigmoid函数在早期的神经网络中较为普遍,但它目前逐渐被更简单的ReLU函数取代。在后面“循环神经网络”一章中我们会介绍如何利用它值域在0到1之间这一特性来控制信息在神经网络中的流动。

下面绘制了sigmoid函数。当输入接近0时,sigmoid函数接近线性变换:

y = x.sigmoid()

xyplot(x, y, 'sigmoid')

依据链式法则,sigmoid函数的导数

sigmoid ′ ( x ) = sigmoid ( x ) ( 1 − sigmoid ( x ) ) . \\textsigmoid'(x) = \\textsigmoid(x)\\left(1-\\textsigmoid(x)\\right). sigmoid′(x)=sigmoid(x)(1−sigmoid(x)).

下面绘制了sigmoid函数的导数。当输入为0时,sigmoid函数的导数达到最大值0.25;当输入越偏离0时,sigmoid函数的导数越接近0。

x.grad.zero_()

y.sum().backward()

xyplot(x, x.grad, 'grad of sigmoid')

tanh函数

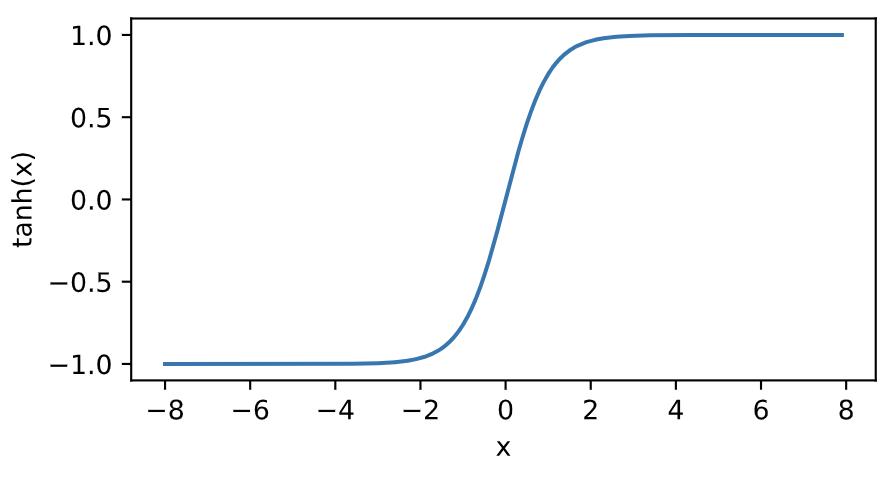

tanh(双曲正切)函数可以将元素的值变换到-1和1之间:

tanh ( x ) = 1 − exp ( − 2 x ) 1 + exp ( − 2 x ) . \\texttanh(x) = \\frac1 - \\exp(-2x)1 + \\exp(-2x). tanh(x)=1+exp(−2x)1−exp(−2x).

我们接着绘制tanh函数。当输入接近0时,tanh函数接近线性变换。虽然该函数的形状和sigmoid函数的形状很像,但tanh函数在坐标系的原点上对称。

y = x.tanh()

xyplot(x, y, 'tanh')

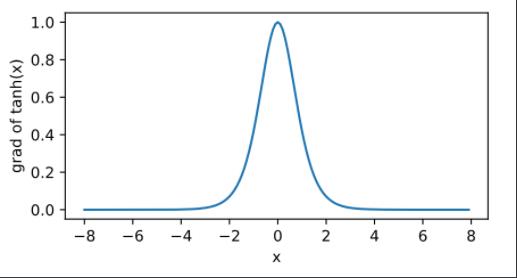

依据链式法则,tanh函数的导数

tanh ′ ( x ) = 1 − tanh 2 ( x ) . \\texttanh'(x) = 1 - \\texttanh^2(x). tanh′(x)=1−tanh2(x).

下面绘制了tanh函数的导数。当输入为0时,tanh函数的导数达到最大值1;当输入越偏离0时,tanh函数的导数越接近0。

x.grad.zero_()

y.sum().backward()

xyplot(x, x.grad, 'grad of tanh')

多层感知机

多层感知机就是含有至少一个隐藏层的由全连接层组成的神经网络,且每个隐藏层的输出通过激活函数进行变换。多层感知机的层数和各隐藏层中隐藏单元个数都是超参数。以单隐藏层为例并沿用本节之前定义的符号,多层感知机按以下方式计算输出:

H = ϕ ( X W h + b h ) , O = H W o + b o , \\beginaligned \\boldsymbolH &= \\phi(\\boldsymbolX \\boldsymbolW_h + \\boldsymbolb_h),\\\\ \\boldsymbolO &= \\boldsymbolH \\boldsymbolW_o + \\boldsymbolb_o, \\endaligned HO=ϕ(XWh+b多层感知机