Hive 一文读懂

Posted 在奋斗的大道

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Hive 一文读懂相关的知识,希望对你有一定的参考价值。

Hive 简介

1.1 什么是Hive

1)hive简介

Hive:由Facebook开源用于解决海量结构化日志的数据统计。

Hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张表,并提供类SQL查询功能。

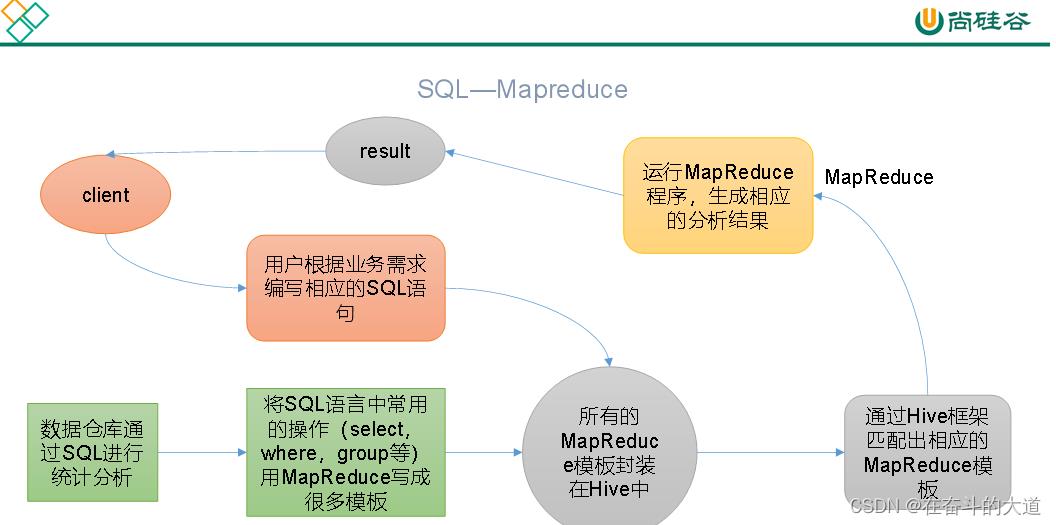

2)Hive本质:将HQL转化成MapReduce程序

1)Hive处理的数据存储在HDFS

2)Hive分析数据底层的实现是MapReduce

3)执行程序运行在Yarn上

1.2 Hive 优缺点

优点:

采用类PL /SQL语言, 开发容易上手。

避免编写MapReduce 程序,减低学习成本。

Hive 延迟较高,常用于数据分析,对时效要求不高场景。

Hive 支持用户自定义函数

缺点:

Hive 的HQL 表达能力有限。

Hive 效率比低。

1.3 Hive 架构原理图

专有名词

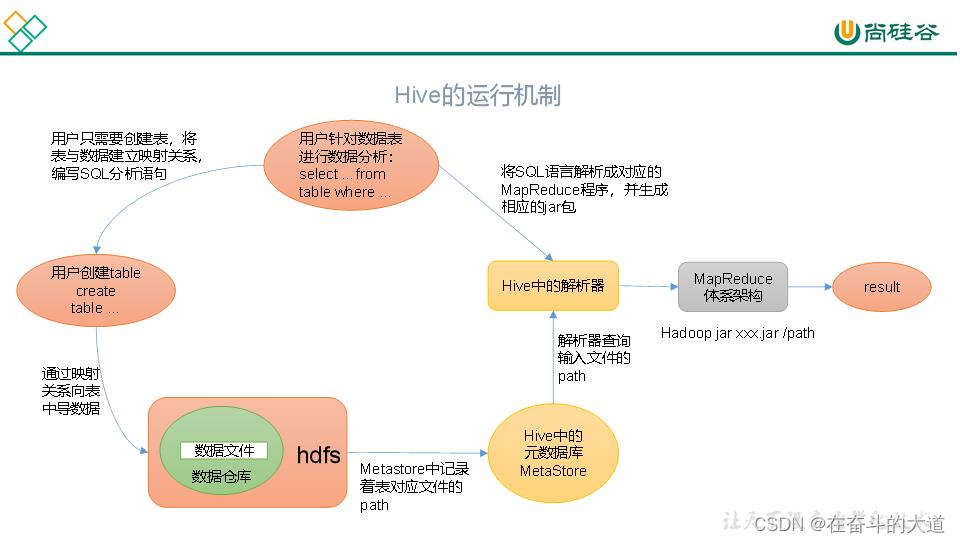

1)用户接口:Client

CLI(command-line interface)、JDBC/ODBC(jdbc访问hive)、WEBUI(浏览器访问hive)

2)元数据:Metastore

元数据包括:表名、表所属的数据库(默认是default)、表的拥有者、列/分区字段、表的类型(是否是外部表)、表的数据所在目录等;

默认存储在自带的derby数据库中,推荐使用mysql存储Metastore

3)Hadoop

使用HDFS进行存储,使用MapReduce进行计算。

4)驱动器:Driver

(1)解析器(SQL Parser):将SQL字符串转换成抽象语法树AST,这一步一般都用第三方工具库完成,比如antlr;对AST进行语法分析,比如表是否存在、字段是否存在、SQL语义是否有误。

(2)编译器(Physical Plan):将AST编译生成逻辑执行计划。

(3)优化器(Query Optimizer):对逻辑执行计划进行优化。

(4)执行器(Execution):把逻辑执行计划转换成可以运行的物理计划。对于Hive来说,就是MR/Spark。

Hive通过给用户提供的一系列交互接口,接收到用户的指令(SQL),使用自己的Driver,结合元数据(MetaStore),将这些指令翻译成MapReduce,提交到Hadoop中执行,最后,将执行返回的结果输出到用户交互接口。

Hive 快速安装

Hive 与Hadoop 版本对应关系表

第一步:进入Hive 官网,https://hive.apache.org/

第二步:点击Release, 进入Hive 下载页面

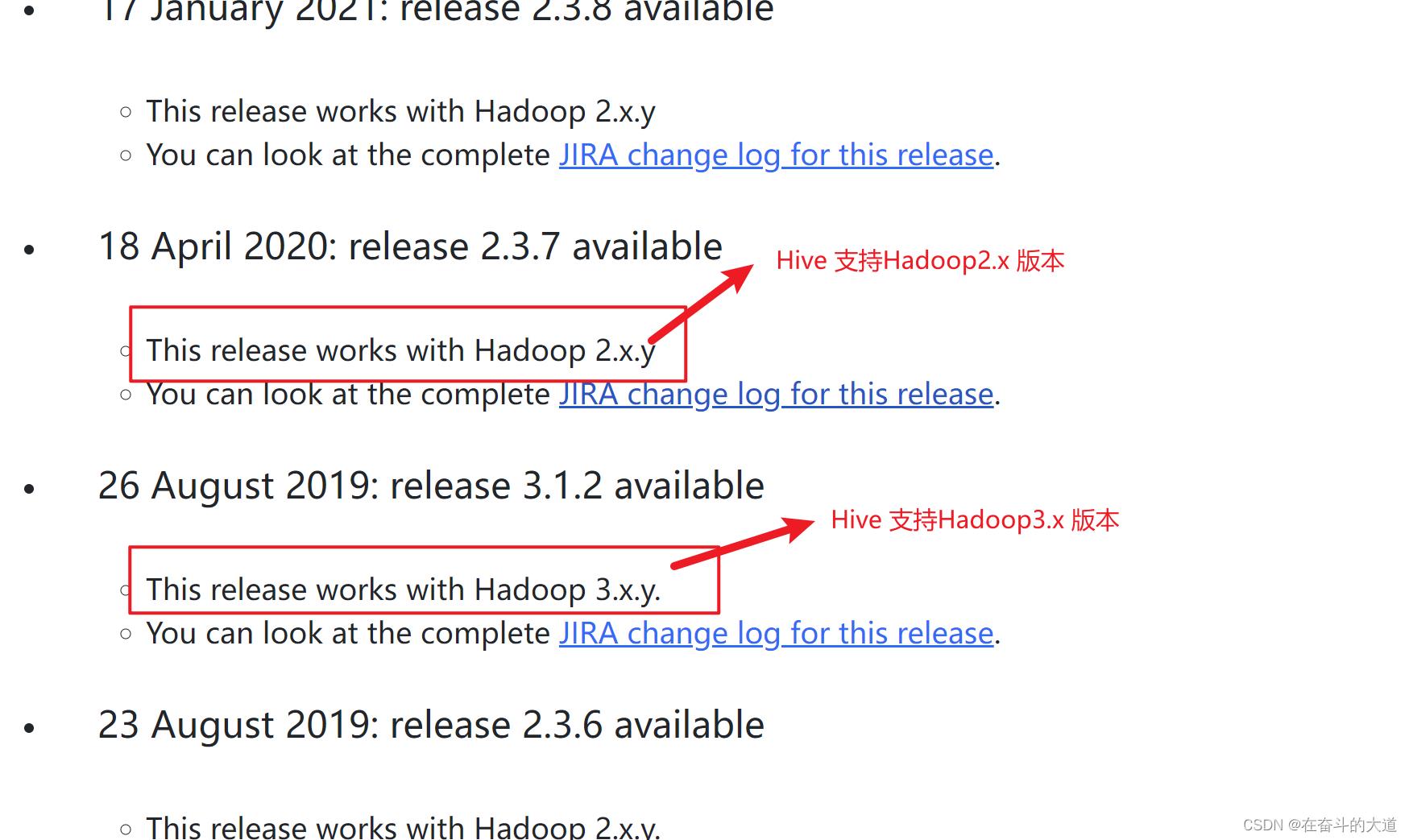

第三步:查看Hive 支持Hadoop版本,我本次演示的Hadoop 版本为3.2.4

最终Hive的版本为:apache-hive-3.1.2.bin.tar.gz 版本

首先将apache-hive-3.1.2-bin.tar.gz,上传到CentOS-7的/usr/local 目录下

使用cd 命令切换至/usr/local 目录,然后使用tar -zxvf apache-hive-3.1.2-bin.tar.gz 解压。

[root@Hadoop3-master local]# tar -zxvf apache-hive-3.1.2-bin.tar.gz使用mv 命令重命名解压后的文件夹apache-hive-3.1.2-bin.tar.gz为hive

[root@Hadoop3-master local]# mv apache-hive-3.1.2-bin hive配置hive 全局环境变量,将Hive 安装目录(/usr/local/hive)配置到/etc/profile的PATH环境变量中。

[root@Hadoop3-master local]# vi /etc/profile编辑内容如下:

# /etc/profile

export JAVA_HOME=/usr/local/jdk

export HADOOP_HOME=/usr/local/hadoop

export SQOOP_HOME=/usr/local/sqoop

export HBASE_HOME=/usr/local/hbase

export HIVE_HOME=/usr/local/hive

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$SQOOP_HOME/bin:$HBASE_HOME/bin:$HIVE_HOME/bin使用source /etc/profile 命令,使环境变量立即生效。

Docker 安装MySQL 8

请求参考文章:Docker 安装MySQL 8

Hive 参数设置

切换至Hive 的 配置文件目录(/usr/local/hive/conf), 分别将配置模板文件hive-env.sh.template 重命名为hive-env.sh, 将hive-default.xml.template 重命名为hive-site.xml

[root@Hadoop3-master local]# cd /usr/local/hive/conf

[root@Hadoop3-master conf]# mv hive-env.sh.template hive-env.sh

[root@Hadoop3-master conf]# mv hive-default.xml.template hive-site.xml配置$HIVE_HOME/bin 的hive-config.sh

在$HIVE_HOME/bin 的hive-config.sh文件末尾,添加如下3行配置,明确Java、Hadoop和Hive的安装目录

export JAVA_HOME=/usr/local/jdk

export HADOOP_HOME=/usr/local/hadoop

export HIVE_HOME=/usr/local/hive复制MySQL 8 驱动

下载MySQL 8 驱动包mysql-connector-java-8.0.12,然后复制到$HIVE_HOME/lib 目录下。

在$HIVE_HOME/ 下新建tmp 临时目录

创建临时目录tmp,用来存储临时数据。

[root@Hadoop3-master jdk]# mkdir /usr/local/hive/tmp配置$HIVE_HOME/conf的hive-site.xml 支持MySQL 8

在$HIVE_HOME/conf的hive-site.xml 文件中,修改ConnectionURL、ConnectionDriverName、ConnectionUserName、ConnectionPassword共四个属性值,将默认Derby 数据库连接配置改成为MySQL 8 数据库连接配置,具体配置如下:

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://192.168.43.10:3306/hive?createDatabaseIfNotExist=true&serverTimezone=Asia/Shanghai</value>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.cj.jdbc.Driver</value>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>123456</value>

</property>配置$HIVE_HOME/conf 的hive-site.xml

替换全部$system:Java.io.tmpdir 为/usr/local/hive/tmp, 总共4处。

替换全部$system:user.name为root, 总共5处。

Hive 验证

Hive 初始化MySQL 8 元数据库

切换至$HIVE_HOME/bin 目录,执行如下指令:

schematool -dbType mysql -initSchema查看控制台有如下输出时:

[root@Hadoop3-master bin]# schematool -dbType mysql -initSchema

SLF4J: Class path contains multiple SLF4J bindings.

SLF4J: Found binding in [jar:file:/usr/local/hive/lib/log4j-slf4j-impl-2.10.0.jar!/org/slf4j/impl/StaticLoggerBinder.class]

SLF4J: Found binding in [jar:file:/usr/local/hadoop/share/hadoop/common/lib/slf4j-reload4j-1.7.35.jar!/org/slf4j/impl/StaticLoggerBinder.class]

SLF4J: See http://www.slf4j.org/codes.html#multiple_bindings for an explanation.

SLF4J: Actual binding is of type [org.apache.logging.slf4j.Log4jLoggerFactory]

Metastore connection URL: jdbc:mysql://192.168.43.10:3306/hive?createDatabaseIfNotExist=true&serverTimezone=Asia/Shanghai

Metastore Connection Driver : com.mysql.cj.jdbc.Driver

Metastore connection User: root

Mon Feb 27 10:34:29 CST 2023 WARN: Establishing SSL connection without server's identity verification is not recommended. According to MySQL 5.5.45+, 5.6.26+ and 5.7.6+ requirements SSL connection must be established by default if explicit option isn't set. For compliance with existing applications not using SSL the verifyServerCertificate property is set to 'false'. You need either to explicitly disable SSL by setting useSSL=false, or set useSSL=true and provide truststore for server certificate verification.

Starting metastore schema initialization to 3.1.0

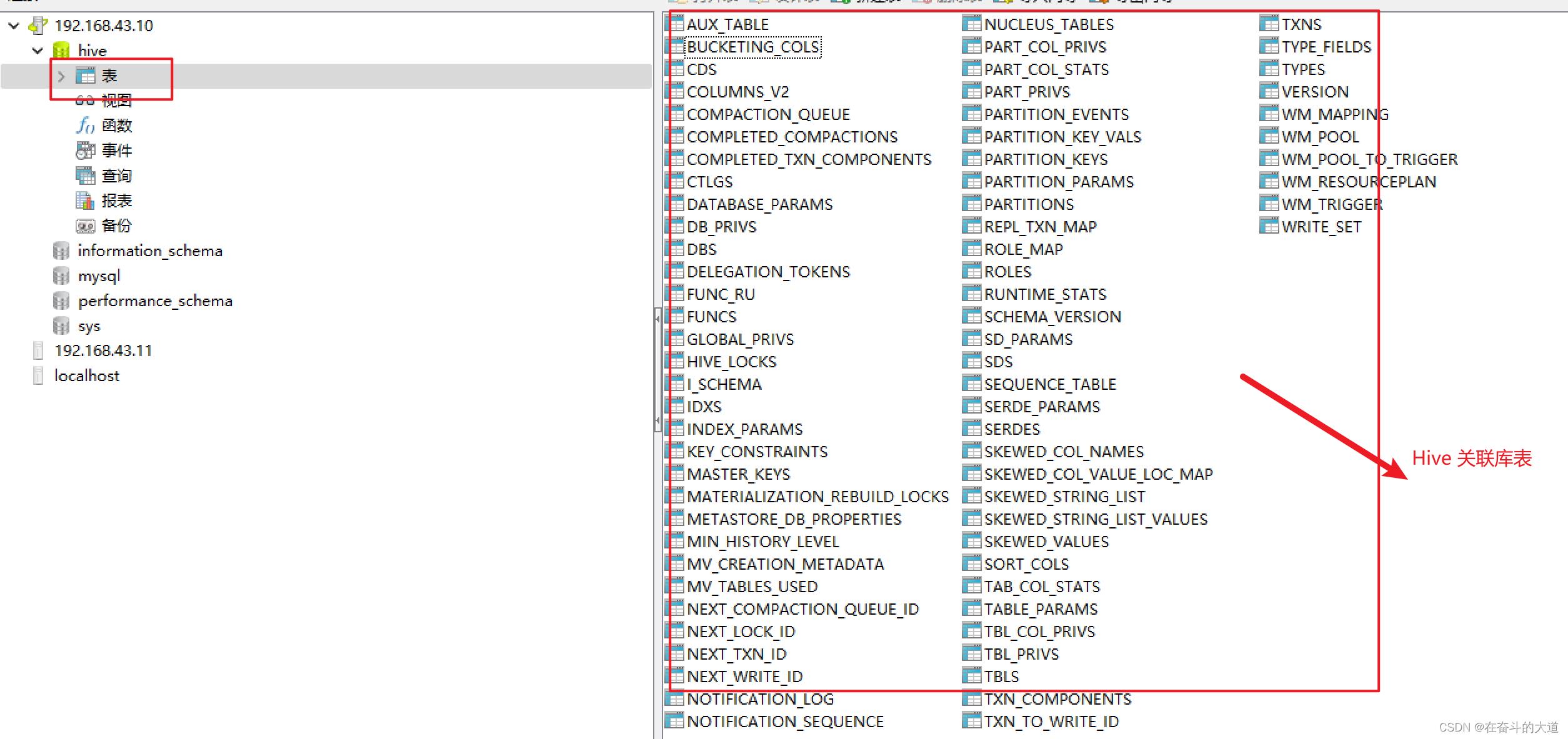

Initialization script hive-schema-3.1.0.mysql.sql在连接MySQL 8/hive 数据库,查看关联表是否生成:

Hive 验证

切换至$HIVE_HOME/bin 目录,执行如下指令:

[root@Hadoop3-master bin]# hive

SLF4J: Class path contains multiple SLF4J bindings.

SLF4J: Found binding in [jar:file:/usr/local/hive/lib/log4j-slf4j-impl-2.10.0.jar!/org/slf4j/impl/StaticLoggerBinder.class]

SLF4J: Found binding in [jar:file:/usr/local/hadoop/share/hadoop/common/lib/slf4j-reload4j-1.7.35.jar!/org/slf4j/impl/StaticLoggerBinder.class]

SLF4J: See http://www.slf4j.org/codes.html#multiple_bindings for an explanation.

SLF4J: Actual binding is of type [org.apache.logging.slf4j.Log4jLoggerFactory]

Hive Session ID = 27a1de92-476b-47bd-b0cf-e91093e28607在此输出show databases 指令,查看Hive 关联库表。

hive> show databases;

OK

default

Time taken: 0.93 seconds, Fetched: 1 row(s)至此Hive 单机版本安装成功。

Hive 常用交互指令

“-e”不进入hive的交互窗口执行sql语句

hive -e "执行SQL语句"“-f”执行脚本中sql语句

hive -f sql文件路径/sql文件名称执行文件中的sql语句并将结果写入文件中

hive -f sql文件路径/sql文件名称 > 保存结果的路径Hive 其他命令

退出Hive 窗口

退出方式一:exit

退出方式二:quit在hive cli命令窗口中查看hdfs文件系统

dfs -ls /;在hive cli命令窗口中查看本地文件系统

!ls /opt;Hive 常用属性配置

数据仓库位置配置

<property>

<name>hive.metastore.warehouse.dir</name>

<value>/opt/hive/warehouse</value>

</property>编辑/usr/local/hive/conf/hive-site.xml

查询后信息显示配置

在hive-site.xml文件中添加如下配置信息,就可以实现显示当前数据库,以及查询表的头信息配置。

<property>

<name>hive.cli.print.header</name>

<value>true</value>

</property>

<property>

<name>hive.cli.print.current.db</name>

<value>true</value>

</property>记得重启hive。

运行日志配置

Hive的log默认存放在/tmp/root/hive.log目录下(root为当前用户名)

[root@Hadoop3-master conf]# cd /tmp/root

[root@Hadoop3-master root]# ll

总用量 24

-rw-r--r-- 1 root root 18239 2月 27 10:59 hive.log

-rw-r--r-- 1 root root 234 2月 26 18:33 hive.log.2023-02-26修改hive的log存放日志到/usr/local/hive/logs

修改/usr/local/hive/conf/hive-log4j.properties.template文件名称为hive-log4j.properties

mv hive-log4j.properties.template hive-log4j.properties在hive-log4j.properties文件中修改log存放位置

hive.log.dir=/opt/hive/logs重启Hive

Hive 基本数据类型

基本数据类型

Hive数据类型 | Java数据类型 | 长度 | 例子 |

TINYINT | byte | 1byte有符号整数 | 20 |

SMALINT | short | 2byte有符号整数 | 20 |

INT | int | 4byte有符号整数 | 20 |

BIGINT | long | 8byte有符号整数 | 20 |

BOOLEAN | boolean | 布尔类型,true或者false | TRUE FALSE |

FLOAT | float | 单精度浮点数 | 3.14159 |

DOUBLE | double | 双精度浮点数 | 3.14159 |

STRING | string | 字符系列。可以指定字符集。可以使用单引号或者双引号。 | ‘now is the time’ “for all good men” |

TIMESTAMP |

| 时间类型 |

|

BINARY |

| 字节数组 |

Hive的String类型相当于数据库的varchar类型,该类型是一个可变的字符串,不过它不能声明其中最多能存储多少个字符,理论上它可以存储2GB的字符数。

集合数据类型

数据类型 | 描述 | 语法示例 |

STRUCT | 和c语言中的struct类似,都可以通过“点”符号访问元素内容。例如,如果某个列的数据类型是STRUCTfirst STRING, last STRING,那么第1个元素可以通过字段.first来引用。 | struct() 例如struct<street:string, city:string> |

MAP | MAP是一组键-值对元组集合,使用数组表示法可以访问数据。例如,如果某个列的数据类型是MAP,其中键->值对是’first’->’John’和’last’->’Doe’,那么可以通过字段名[‘last’]获取最后一个元素 | map() 例如map<string, int> |

ARRAY | 数组是一组具有相同类型和名称的变量的集合。这些变量称为数组的元素,每个数组元素都有一个编号,编号从零开始。例如,数组值为[‘John’, ‘Doe’],那么第2个元素可以通过数组名[1]进行引用。 | Array() 例如array<string> |

Hive有三种复杂数据类型ARRAY、MAP 和 STRUCT。ARRAY和MAP与Java中的Array和Map类似,而STRUCT与C语言中的Struct类似,它封装了一个命名字段集合,复杂数据类型允许任意层次的嵌套。

数据类型转换

隐式类型转换

(1)任何整数类型都可以隐式地转换为一个范围更广的类型,如TINYINT可以转换成INT,INT可以转换成BIGINT。

(2)所有整数类型、FLOAT和STRING类型都可以隐式地转换成DOUBLE。

(3)TINYINT、SMALLINT、INT都可以转换为FLOAT。

(4)BOOLEAN类型不可以转换为任何其它的类型。

强制类型转换/显式类型转换

使用CAST操作显示进行数据类型转换

例如:CAST('1' AS INT)将把字符串'1' 转换成整数1;如果强制类型转换失败,如执行CAST('X' AS INT),表达式返回空值 NULL。

Hive DDL数据 定义

创建数据库

语法:

CREATE DATABASE [IF NOT EXISTS] database_name

[COMMENT database_comment]

[LOCATION hdfs_path]

[WITH DBPROPERTIES (property_name=property_value, ...)];创建一个数据库,数据库在HDFS上的默认存储路径是/user/hive/warehouse/*.db。

hive> create database db_hive;

OK

Time taken: 1.246 seconds避免要创建的数据库已经存在错误,增加if not exists判断。(标准写法)

hive> create database if not exists db_hive;

OK

Time taken: 0.062 seconds创建一个数据库,指定数据库在HDFS上存放的位置

hive> create database db_hive2 location '/db_hive2.db';

OK

Time taken: 0.134 seconds查询数据库

显示数据库

显示数据库

hive> show databases;

OK

db_hive

db_hive2

default

Time taken: 0.305 seconds, Fetched: 3 row(s)过滤显示查询的数据库

hive> show databases like 'de*';

OK

default

Time taken: 0.068 seconds, Fetched: 1 row(s)

查看数据库详情

显示数据库信息

hive> desc database db_hive;

OK

db_hive hdfs://Hadoop3-master:9000/user/hive/warehouse/db_hive.db root USER

Time taken: 0.101 seconds, Fetched: 1 row(s)显示数据库详情信息,extended

hive> desc database extended db_hive;

OK

db_hive hdfs://Hadoop3-master:9000/user/hive/warehouse/db_hive.db root USER

Time taken: 0.089 seconds, Fetched: 1 row(s)切换数据库

hive> use db_hive;

OK

Time taken: 0.091 seconds修改数据库

使用Alter database 命令为某个数据库的dbproperties设置键-值对属性值,来描述这个数据库的属性信息。

hive> alter database db_hive set dbproperties('createtime'='20230227');

OK

Time taken: 0.156 seconds查看修改结果

hive> desc database extended db_hive;

OK

db_hive hdfs://Hadoop3-master:9000/user/hive/warehouse/db_hive.db root USER createtime=20230227

Time taken: 0.101 seconds, Fetched: 1 row(s)删除数据库

删除空数据库

hive>drop database db_hive2;如果删除的数据库不存在,最好采用 if exists判断数据库是否存在

hive> drop database if exists db_hive2;如果数据库不为空,可以采用cascade命令,强制删除

hive> drop database db_hive;创建表

建表语法:

CREATE [EXTERNAL] TABLE [IF NOT EXISTS] table_name

[(col_name data_type [COMMENT col_comment], ...)]

[COMMENT table_comment]

[PARTITIONED BY (col_name data_type [COMMENT col_comment], ...)]

[CLUSTERED BY (col_name, col_name, ...)

[SORTED BY (col_name [ASC|DESC], ...)] INTO num_buckets BUCKETS]

[ROW FORMAT row_format]

[STORED AS file_format]

[LOCATION hdfs_path]

[TBLPROPERTIES (property_name=property_value, ...)]

[AS select_statement]字段说明:

(1)CREATE TABLE 创建一个指定名字的表。如果相同名字的表已经存在,则抛出异常;用户可以用 IF NOT EXISTS 选项来忽略这个异常。

(2)EXTERNAL关键字可以让用户创建一个外部表,在建表的同时可以指定一个指向实际数据的路径(LOCATION),在删除表的时候,内部表的元数据和数据会被一起删除,而外部表只删除元数据,不删除数据。

(3)COMMENT:为表和列添加注释。

(4)PARTITIONED BY创建分区表

(5)CLUSTERED BY创建分桶表

(6)SORTED BY不常用,对桶中的一个或多个列另外排序

(7)ROW FORMAT

DELIMITED [FIELDS TERMINATED BY char] [COLLECTION ITEMS TERMINATED BY char]

[MAP KEYS TERMINATED BY char] [LINES TERMINATED BY char]

| SERDE serde_name [WITH SERDEPROPERTIES (property_name=property_value, property_name=property_value, ...)]

用户在建表的时候可以自定义SerDe或者使用自带的SerDe。如果没有指定ROW FORMAT 或者ROW FORMAT DELIMITED,将会使用自带的SerDe。在建表的时候,用户还需要为表指定列,用户在指定表的列的同时也会指定自定义的SerDe,Hive通过SerDe确定表的具体的列的数据。

SerDe是Serialize/Deserilize的简称, hive使用Serde进行行对象的序列与反序列化。

(8)STORED AS指定存储文件类型

常用的存储文件类型:SEQUENCEFILE(二进制序列文件)、TEXTFILE(文本)、RCFILE(列式存储格式文件)

如果文件数据是纯文本,可以使用STORED AS TEXTFILE。如果数据需要压缩,使用 STORED AS SEQUENCEFILE。

(9)LOCATION :指定表在HDFS上的存储位置。

(10)AS:后跟查询语句,根据查询结果创建表。

(11)LIKE允许用户复制现有的表结构,但是不复制数据。

管理表/内部表

1)理论

默认创建的表都是所谓的管理表,有时也被称为内部表。因为这种表,Hive会(或多或少地)控制着数据的生命周期。Hive默认情况下会将这些表的数据存储在由配置项hive.metastore.warehouse.dir(例如,/user/hive/warehouse)所定义的目录的子目录下。 当我们删除一个管理表时,Hive也会删除这个表中数据。管理表不适合和其他工具共享数据。

普通创建表

hive> create table if not exists student(

> id int, name string

> )

> row format delimited fields terminated by '\\t'

> stored as textfile

> location '/user/hive/warehouse/student';

OK

Time taken: 1.605 seconds

hive> show tables;

OK

student

Time taken: 0.142 seconds, Fetched: 1 row(s)向表中添加数据

创建数据导入文件/usr/local/tmp/student, 待导入数据内容如下:

1001 1

1002 2

1003 3

1004 4

1005 5

1006 6

1007 7

1008 8

1009 9

1010 10

1011 ss11

1012 ss12

1013 ss13

1014 ss14

1015 ss15

1016 ss16通过hive 自带数据导入指令,将数据student 导入default.student表。

hive> load data local inpath '/usr/local/tmp/student' overwrite into table student;

Loading data to table default.student

OK

Time taken: 2.629 seconds

hive> select * from student;

OK

1001 1

1002 2

1003 3

1004 4

1005 5

1006 6

1007 7

1008 8

1009 9

1010 10

1011 ss11

1012 ss12

1013 ss13

1014 ss14

1015 ss15

1016 ss16

Time taken: 2.771 seconds, Fetched: 16 row(s)根据查询结果创建表(查询的结果会添加到新创建的表中)

hive> create table if not exists student2 as select id, name from student;

Query ID = root_20230227153551_c9d3ece8-fa6b-4355-8447-cbf52e6666d5

Total jobs = 3

Launching Job 1 out of 3

Number of reduce tasks is set to 0 since there's no reduce operator

Job running in-process (local Hadoop)

2023-02-27 15:35:55,484 Stage-1 map = 0%, reduce = 0%

2023-02-27 15:35:56,510 Stage-1 map = 100%, reduce = 0%

Ended Job = job_local1259142285_0001

Stage-4 is selected by condition resolver.

Stage-3 is filtered out by condition resolver.

Stage-5 is filtered out by condition resolver.

Moving data to directory hdfs://Hadoop3-master:9000/user/hive/warehouse/.hive-staging_hive_2023-02-27_15-35-51_794_7197413713019532318-1/-ext-10002

Moving data to directory hdfs://Hadoop3-master:9000/user/hive/warehouse/student2

MapReduce Jobs Launched:

Stage-Stage-1: HDFS Read: 262 HDFS Write: 335 SUCCESS

Total MapReduce CPU Time Spent: 0 msec

OK

Time taken: 5.315 seconds

hive> show tables;

OK

student

student2

Time taken: 0.079 seconds, Fetched: 2 row(s)

根据已经存在的表结构创建表

hive> create table if not exists student3 like student;

OK

Time taken: 0.309 seconds查询表的类型

hive> desc formatted student2;

OK

# col_name data_type comment

id int

name string

# Detailed Table Information

Database: default

OwnerType: USER

Owner: root

CreateTime: Mon Feb 27 15:35:56 CST 2023

LastAccessTime: UNKNOWN

Retention: 0

Location: hdfs://Hadoop3-master:9000/user/hive/warehouse/student2

Table Type: MANAGED_TABLE

Table Parameters:

COLUMN_STATS_ACCURATE \\"BASIC_STATS\\":\\"true\\"

bucketing_version 2

numFiles 1

numRows 16

rawDataSize 115

totalSize 131

transient_lastDdlTime 1677483356

# Storage Information

SerDe Library: org.apache.hadoop.hive.serde2.lazy.LazySimpleSerDe

InputFormat: org.apache.hadoop.mapred.TextInputFormat

OutputFormat: org.apache.hadoop.hive.ql.io.HiveIgnoreKeyTextOutputFormat

Compressed: No

Num Buckets: -1

Bucket Columns: []

Sort Columns: []

Storage Desc Params:

serialization.format 1

Time taken: 0.276 seconds, Fetched: 32 row(s)外部表

1)理论

因为表是外部表,所以Hive并非认为其完全拥有这份数据。删除该表并不会删除掉这份数据,不过描述表的元数据信息会被删除掉。

2)管理表和外部表的使用场景

每天将收集到的网站日志定期流入HDFS文本文件。在外部表(原始日志表)的基础上做大量的统计分析,用到的中间表、结果表使用内部表存储,数据通过SELECT+INSERT进入内部表。

创建外部表

hive> create external table if not exists employee(

> name string,

> address array<string>,

> personalInfo array<string>,

> technol map<string,int>,

> jobs map<string,string>)

> row format delimited

> fields terminated by '|'

> collection items terminated by ','

> map keys terminated by ':'

> lines terminated by '\\n';向外部表填充数据

创建数据导入文件/usr/local/tmp/employee, 待导入数据内容如下:

Michael|Montreal,Toronto|Male,30|DB:80|Product:DeveloperLead

Will|Montreal|Male,35|Perl:85|Product:Lead,Test:Lead

Shelley|New York|Female,27|Python:80|Test:Lead,COE:Architect

Lucy|Vancouver|Female,57|Sales:89|Sales:Lead通过hive 自带数据导入指令,将数据student 导入default.employee表。

hive> show tables;

OK

employee

student

student2

student3

Time taken: 0.336 seconds, Fetched: 4 row(s)

hive>

> load data local inpath '/usr/local/tmp/employee' overwrite into table employee;

Loading data to table default.employee

OK

Time taken: 2.212 second查询外部表

hive> select * from employee;

OK

Michael ["Montreal","Toronto"] ["Male","30"] "DB":80 "Product":"DeveloperLead"

Will ["Montreal"] ["Male","35"] "Perl":85 "Product":"Lead","Test":"Lead"

Shelley ["New York"] ["Female","27"] "Python":80 "Test":"Lead","COE":"Architect"

Lucy ["Vancouver"] ["Female","57"] "Sales":89 "Sales":"Lead"

Time taken: 3.039 seconds, Fetched: 4 row(s)管理表与外部表的互相转换

(1)查询表的类型

hive (default)> desc formatted student2;

Table Type: MANAGED_TABLE

(2)修改内部表student2为外部表

alter table student2 set tblproperties('EXTERNAL'='TRUE');

(3)查询表的类型

hive (default)> desc formatted student2;

Table Type: EXTERNAL_TABLE

(4)修改外部表student2为内部表

alter table student2 set tblproperties('EXTERNAL'='FALSE');

(5)查询表的类型

hive (default)> desc formatted student2;

Table Type: MANAGED_TABLE

注意:('EXTERNAL'='TRUE')和('EXTERNAL'='FALSE')为固定写法,区分大小写!

修改表

重命名表

1)语法

ALTER TABLE table_name RENAME TO new_table_name

2)实操案例

hive (default)> alter table student2 rename to student3;

增加、修改和删除表分区

待补充

增加/修改/替换列信息

1)语法

(1)更新列

ALTER TABLE table_name CHANGE [COLUMN] col_old_name col_new_name column_type [COMMENT col_comment] [FIRST|AFTER column_name]

(2)增加和替换列

ALTER TABLE table_name ADD|REPLACE COLUMNS (col_name data_type [COMMENT col_comment], ...)

注:ADD是代表新增一字段,字段位置在所有列后面(partition列前),REPLACE则是表示替换表中所有字段。

2)实操案例

(1)查询表结构

hive> desc dept;

(2)添加列

hive (default)> alter table dept add columns(deptdesc string);

(3)查询表结构

hive> desc dept;

(4)更新列

hive (default)> alter table dept change column deptdesc desc string;

(5)查询表结构

hive> desc dept;

(6)替换列

hive (default)> alter table dept replace columns(deptno string, dname

string, loc string);

(7)查询表结构

hive> desc dept;

删除表

hive (default)> drop table dept;

Hive DML 数据操作

数据导入

向表中装载数据(Load)

1)语法

hive> load data [local] inpath '数据的path' [overwrite] into table student [partition (partcol1=val1,…)];

(1)load data:表示加载数据

(2)local:表示从本地加载数据到hive表;否则从HDFS加载数据到hive表

(3)inpath:表示加载数据的路径

(4)overwrite:表示覆盖表中已有数据,否则表示追加

(5)into table:表示加载到哪张表

(6)student:表示具体的表

(7)partition:表示上传到指定分区

2)实操案例

(0)创建一张表

hive (default)> create table student(id string, name string) row format delimited fields terminated by '\\t';

(1)加载本地文件到hive

hive (default)> load data local inpath '/opt/module/hive/datas/student.txt' into table default.student;

(2)加载HDFS文件到hive中

上传文件到HDFS

hive (default)> dfs -put /opt/module/hive/datas/student.txt /user/atguigu/hive;

加载HDFS上数据

hive (default)> load data inpath '/user/atguigu/hive/student.txt' into table default.student;

(3)加载数据覆盖表中已有的数据

上传文件到HDFS

hive (default)> dfs -put /opt/module/datas/student.txt /user/atguigu/hive;

加载数据覆盖表中已有的数据

hive (default)> load data inpath '/user/atguigu/hive/student.txt' overwrite into table default.student;

通过查询语句向表中插入数据(Insert)

1)创建一张表

hive (default)> create table student_par(id int, name string) row format delimited fields terminated by '\\t';

2)基本插入数据

hive (default)> insert into table student_par values(1,'wangwu'),(2,'zhaoliu');

3)基本模式插入(根据单张表查询结果)

hive (default)> insert overwrite table student_par

select id, name from student ;

insert into:以追加数据的方式插入到表或分区,原有数据不会删除

insert overwrite:会覆盖表中已存在的数据

注意:insert不支持插入部分字段

4)多表(多分区)插入模式(根据多张表查询结果)

hive (default)> from student

insert overwrite table student partition(month='201707')

select id, name where month='201709'

insert overwrite table student partition(month='201706')

select id, name where month='201709';

查询语句中创建表并加载数据(As Select)

hive(default) > create table if not exists student2 as select id, name from student;

创建表时通过Location指定加载数据路径

1)上传数据到hdfs上

hive (default)> dfs -mkdir /student;

hive (default)> dfs -put /opt/module/datas/student.txt /student;

2)创建表,并指定在hdfs上的位置

hive (default)> create external table if not exists student5(

id int, name string

)

row format delimited fields terminated by '\\t'

location '/student;

3)查询数据

hive (default)> select * from student5;

Import数据到指定Hive表中

注意:先用export导出后,再将数据导入。

hive (default)> import table student2 from

'/user/hive/warehouse/export/student';

数据导出

Insert导出

1)将查询的结果导出到本地