[人工智能-深度学习-17]:神经网络基础 - 优化算法的本质是盲人探路或迷雾探险

Posted 文火冰糖的硅基工坊

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了[人工智能-深度学习-17]:神经网络基础 - 优化算法的本质是盲人探路或迷雾探险相关的知识,希望对你有一定的参考价值。

作者主页(文火冰糖的硅基工坊):文火冰糖(王文兵)的博客_文火冰糖的硅基工坊_CSDN博客

本文网址:https://blog.csdn.net/HiWangWenBing/article/details/120591591

目录

第1章 loss函数几何图像

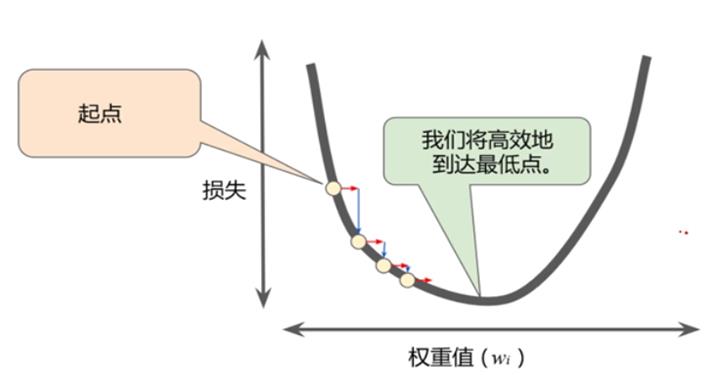

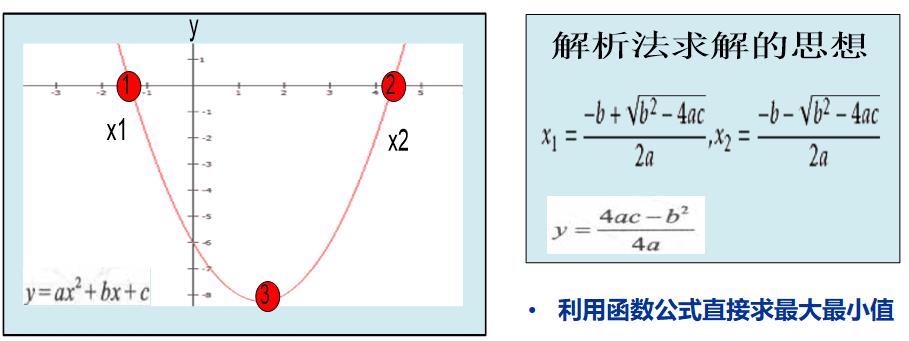

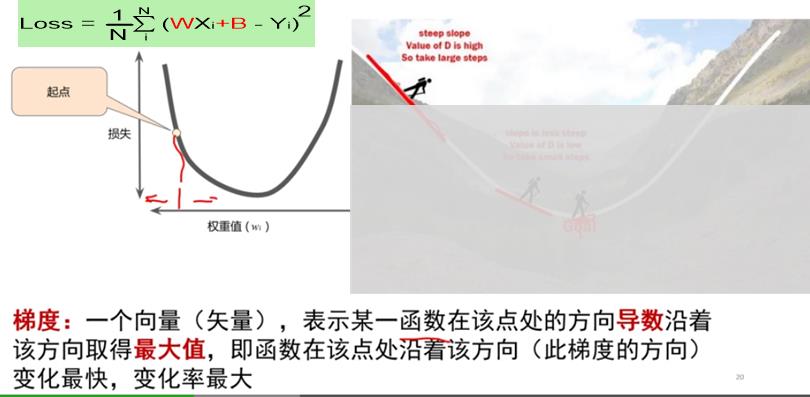

1.1 单个参数的一元loss函数

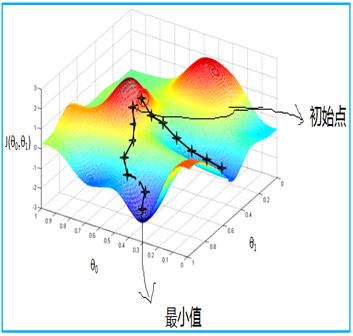

1.2 两个参数的二元loss函数

1.3 多个参数的多元loss函数

有人问,这不是一眼就看出这个函数的最低点了吗? 为什么需要优化算法找最低点呢?

第2章 优化算法的本质是盲人探路

上述图像,能够一看看出最低点的位置,这是因为,事先已经计算出所有点,并且我们能清楚得看到了所有点的几何图形,自然就可以直接判断最低点的位置。如果是盲人看不到几何图形怎么办呢?

此时她只好采用某种算法探测哪里是最低点。她唯一获取的输入就是每次探测后获取的反馈信息,并根据反馈信息判断当前的点是不是最低点。

第3章 优化算法的本质是迷雾探险

在充满迷雾的山谷中,找到最低点的方法,就是去探测,并根据实时采集到的数据,判断和推测最低点的方向,并最终确定最低点的位置?

第4章 优化算法的本质是寻找“最好”的过程

如果某一时刻,我们只能拥有一朵,在没有走过整个田野,你永远不知道手头上的那一朵是否是好的,最大的那一朵。

我们只能根据以往的信息和当前的信息的特征,当前的是否是最好的可能性。至于未来是否有更好的,只能留到未来。关键是未来是源源不断的,永无止息,“”最好的”难道就是“”最好的”吗?

第5章 优化算法的启示

(1)计算机能够预先计算出所有点,然后绘制出图像吗?

不可能,这是因为:神经网络有大量的W, B参数,每个参数的数值又是在【-无穷,+无穷】区间,因此,很难穷举所有的连续参数的数值以及他们的组合。

(2)有没有某种方法,可以大致算出起始点的位置?

在海量的随机参数中,初始化参数就很有讲究,这可以根据随机变量的分布特性来对参数进行初始化,确保初始化的参数尽可能(最大概率)接近最低点。

(3)有没有某种粗略而不是精确的方法?获取最低点大致的位置,然后在进行精确求解?

值得探究,可以用小分队或雷达探测的原理,先进行初步侦查,然后在进行精确求解。

作者主页(文火冰糖的硅基工坊):文火冰糖(王文兵)的博客_文火冰糖的硅基工坊_CSDN博客

本文网址:https://blog.csdn.net/HiWangWenBing/article/details/120591591

以上是关于[人工智能-深度学习-17]:神经网络基础 - 优化算法的本质是盲人探路或迷雾探险的主要内容,如果未能解决你的问题,请参考以下文章