日志管理进阶-成为elk与efk的“高富帅”

Posted Friends of the wind

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了日志管理进阶-成为elk与efk的“高富帅”相关的知识,希望对你有一定的参考价值。

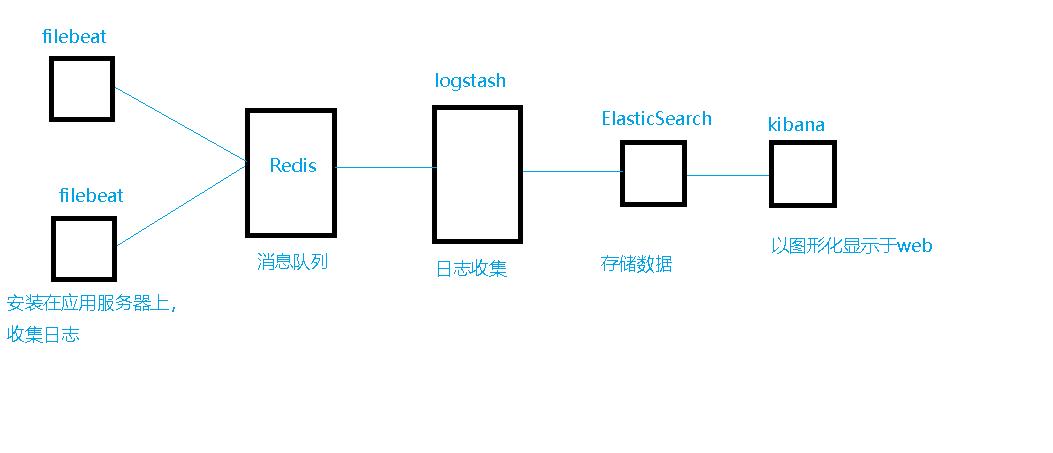

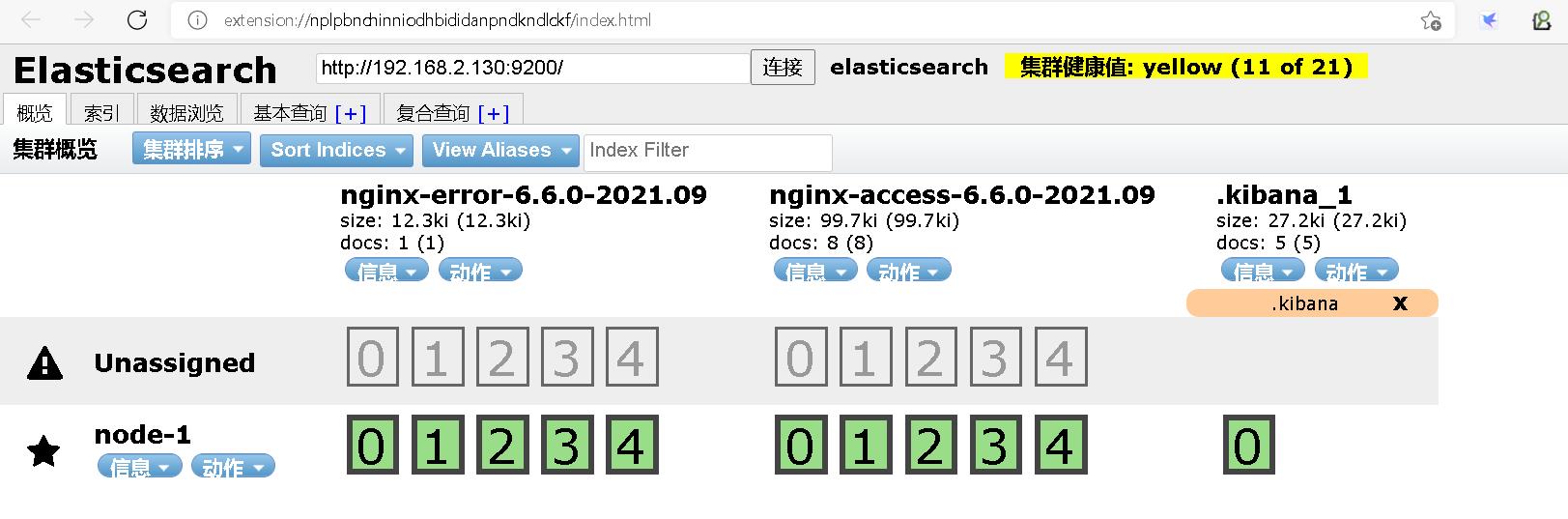

EFK日志收集

架构原理简图:

Elasticsearch: 数据库,存储数据 java

logstash: 日志收集,过滤数据 java

kibana: 分析,过滤,展示 java

filebeat: 收集日志,传输到ES或logstash,安装在应用服务器比如:nginx, go 语言开发

filebeat官方文档:https://www.elastic.co/guide/en/beats/filebeat/current/index.html

Redis:消息队列,大型公司,日志量大,要求响应快,先存在Redis再发到logstash

案例

提示:实验环境,为了节省虚拟机,只用两台,每台服务器安装多个应用,企业环境可分布式安装。

| 应用程序 | IP及端口 |

|---|---|

| elasticsearch | 192.168.2.130:9200 |

| kibana | 192.168.2.130:5601 |

| redis | 192.168.2.130 |

| filebeat、nginx | 192.168.2.136 |

步骤:

elasticsearch

1、 安装elasticsearch

前提:jdk-1.8.0

复制elasticsearch-6.6.0.rpm到虚拟机

rpm -ivh elasticsearch-6.6.0.rpm

2、 修改配置文件

3、创建数据目录,并修改权限

4、分配锁定内存

5、启动服务

systemctl daemon-reload

systemctl start elasticsearch

安装kibana

(1)上传安装包

rpm -ivh kibana-6.6.0-x86_64.rpm

(2)修改配置文件

vim /etc/kibana/kibana.yml

修改:

server.port: 5601

server.host: “192.168.2.130”

server.name: “db01” #自己所在主机的主机名

elasticsearch.hosts: [“http://192.168.2.130:9200”] #es服务器的ip,便于接收日志数据

保存退出

(3)启动kibana

systemctl start kibana

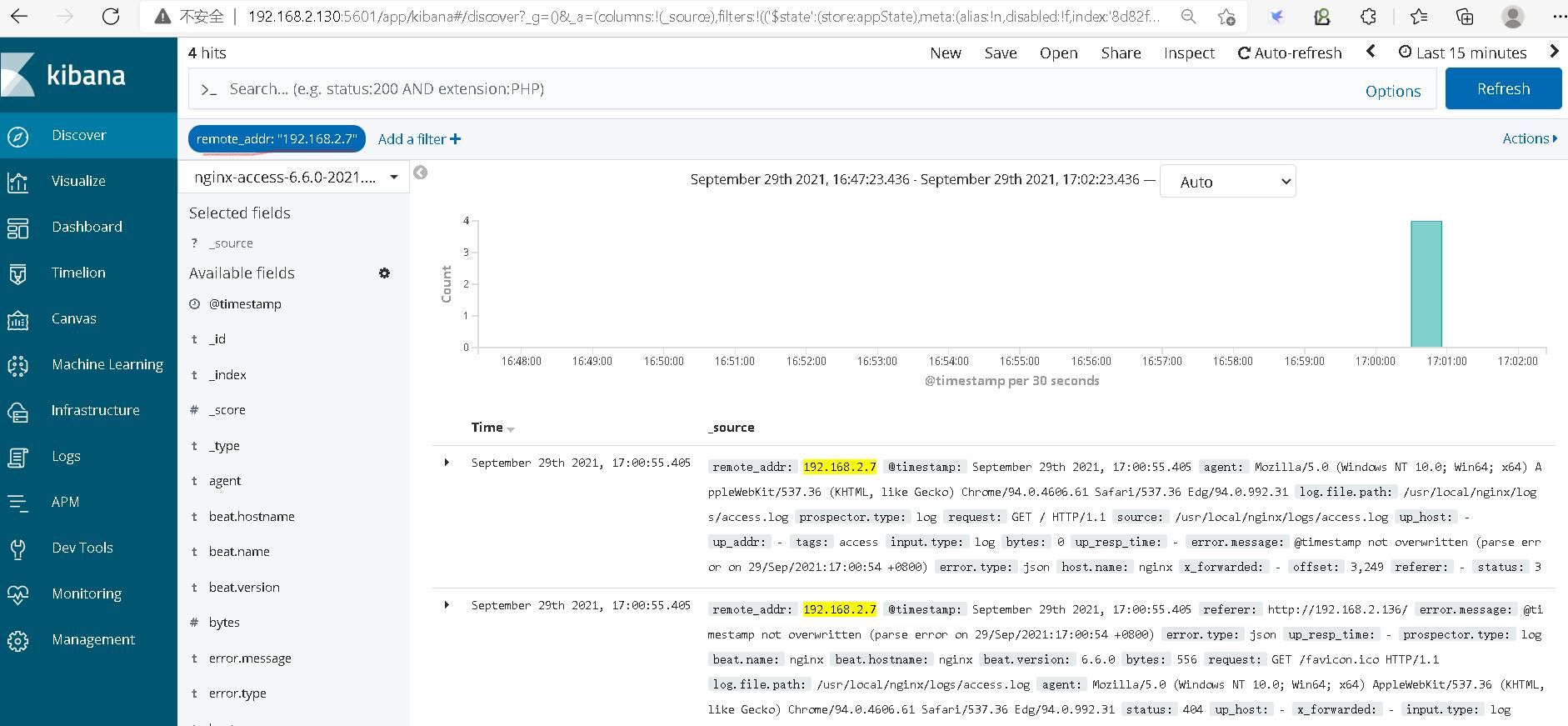

日志过滤显示:只显示Ip是2.7的访问日志

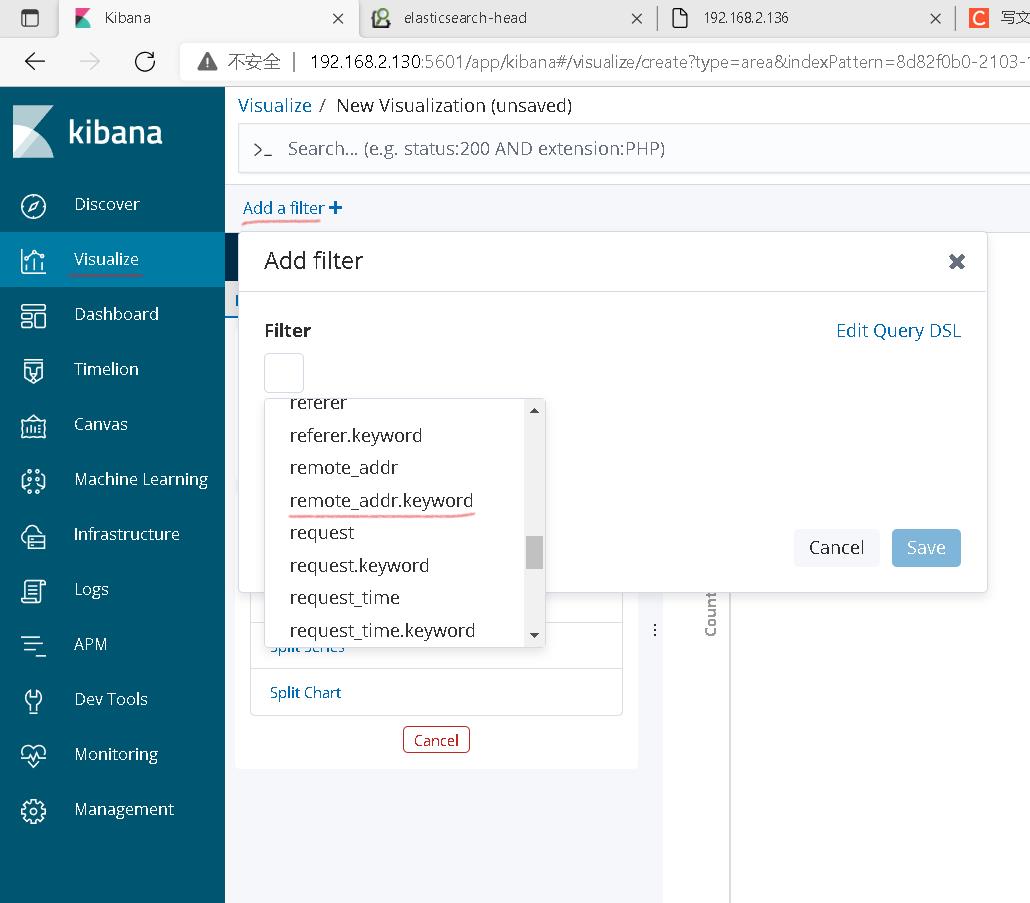

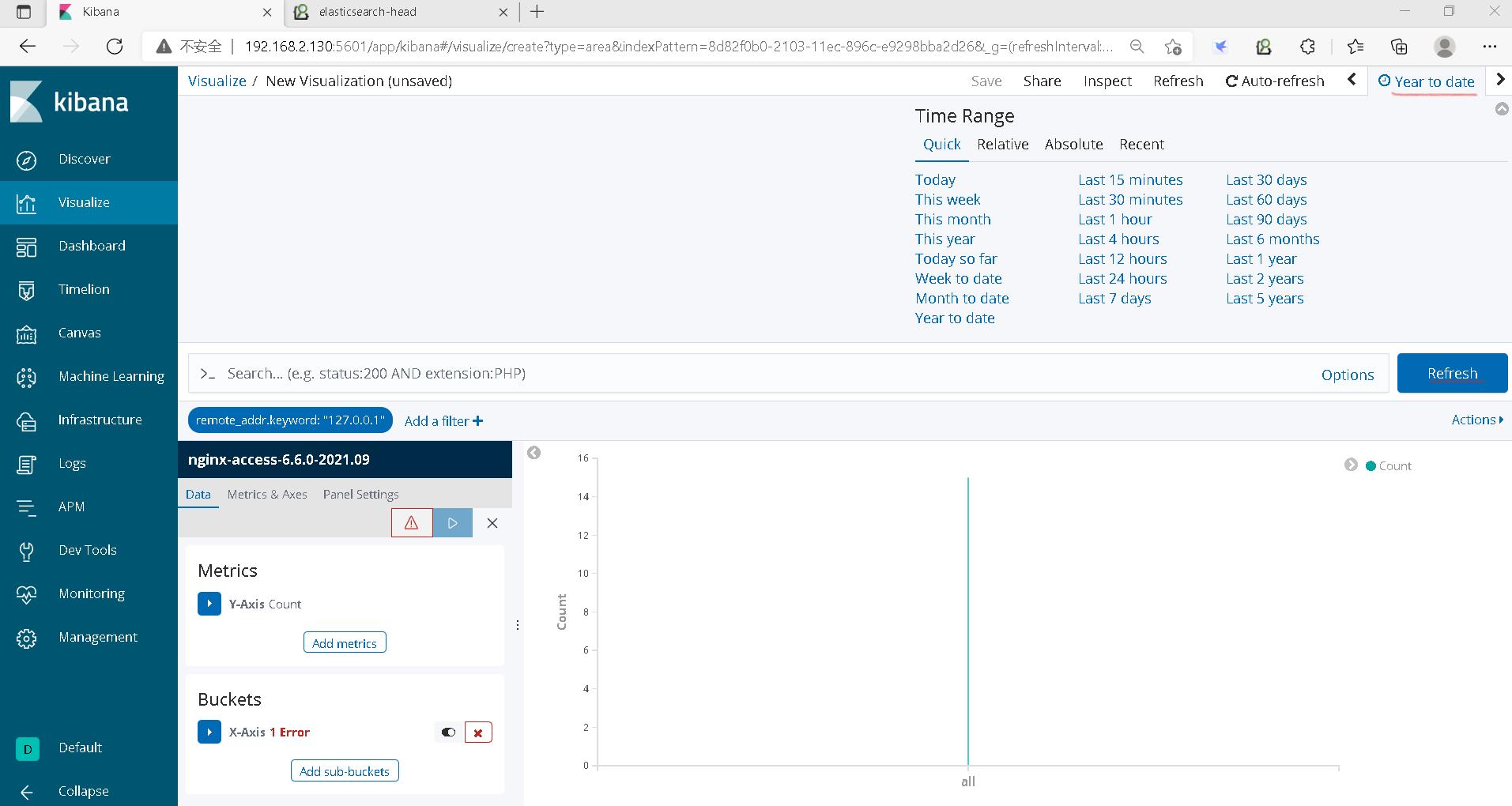

kibana图表:

登录–左侧面板选择visualize–点击“+”号–选择图表类型–选择索引–Buckets–x-Axis–Aggregation(选择Terms)–

Field(remote_addr.keyword)–size(5)–点击上方三角标志

kibana监控(x-pack):

登录–左侧面板选择–Monitoring–启用监控

filebeat

1.安装filebeat

rpm -ivh filebeat-6.6.0-x86_64.rpm

2.修改配置文件

vim /etc/filebeat/filebeat.yml

filebeat.inputs:

- type: log

enabled: true

paths:

- /usr/local/nginx/logs/access.log //访问日志目录,具体以实际路径为准

json.keys_under_root: true

json.overwrite_keys: true

tags: ["access"]

- type: log

enabled: true

paths:

- /usr/local/nginx/logs/error.log //错误日志目录,具体以实际路径为准

tags: ["error"]

output.elasticsearch:

hosts: ["192.168.2.130:9200"] //填写elasticsearch程序地址

indices:

- index: "nginx-access-%{[beat.version]}-%{+yyyy.MM}"

when.contains:

tags: "access"

- index: "nginx-error-%{[beat.version]}-%{+yyyy.MM}"

when.contains:

tags: "error"

setup.template.name: "nginx"

setup.template.patten: "nginx-*"

setup.template.enabled: false

setup.template.overwrite: true

3.启动filebeat

systemctl start filebeat

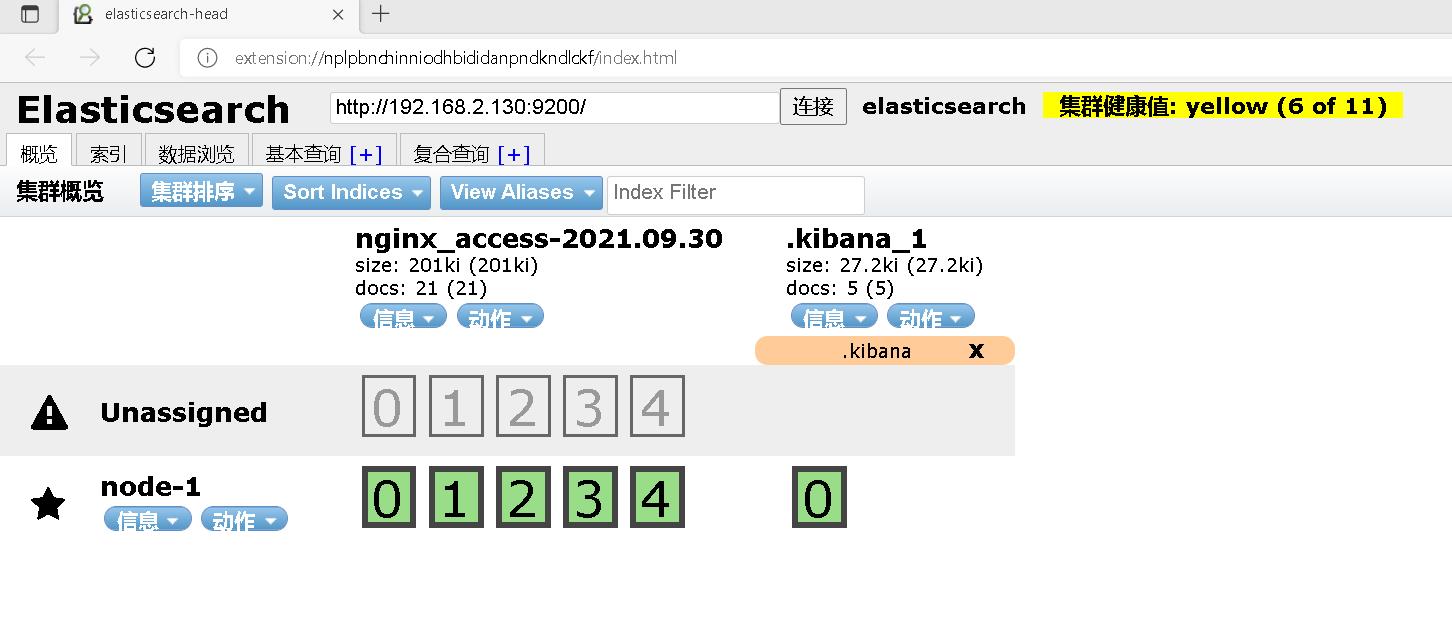

4.在es浏览器查看filebeat索引和数据

5.在kibana添加索引

management–create index

discover–右上角–选择today

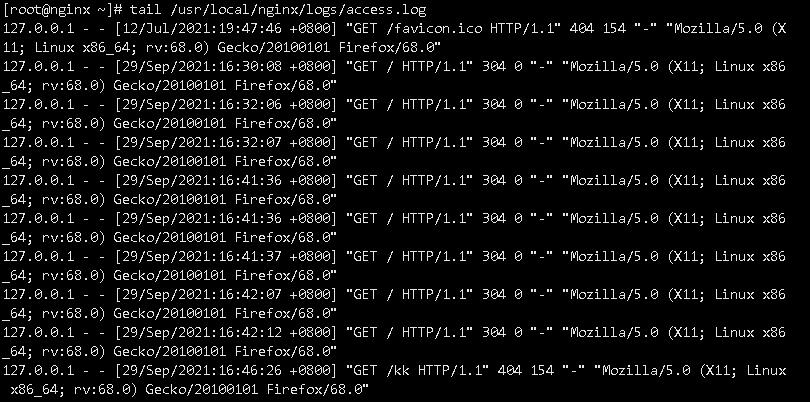

6.修改nginx的日志格式为json(默认日志格式,kibana不支持过滤)

vim /usr/local/nginx/conf/nginx.conf

添加在http {}内:

log_format log_json '{ "@timestamp": "$time_local", '

'"remote_addr": "$remote_addr", '

'"referer": "$http_referer", '

'"request": "$request", '

'"status": $status, '

'"bytes": $body_bytes_sent, '

'"agent": "$http_user_agent", '

'"x_forwarded": "$http_x_forwarded_for", '

'"up_addr": "$upstream_addr",'

'"up_host": "$upstream_http_host",'

'"up_resp_time": "$upstream_response_time",'

'"request_time": "$request_time"'

' }';

access_log /usr/local/nginx/logs/access.log log_json;

保存退出

systemctl restart nginx

清空日志:vim /usr/local/nginx/logs/access.log

ab测试访问,生成json格式日志

Redis(安装、配置参看上期教程)

修改filebeat配置文件,output给redis

(参考文档:https://www.elastic.co/guide/en/beats/filebeat/6.6/index.html)

(1)修改filebeat配置output指向redis,重启

vim /etc/filebeat/filebeat.yml

filebeat.inputs:

- type: log

enabled: true

paths:

- /usr/local/nginx/logs/access.log

json.keys_under_root: true

json.overwrite_keys: true

tags: ["access"]

- type: log

enabled: true

paths:

- /usr/local/nginx/logs/error.log

tags: ["error"]

setup.template.settings:

index.number_of_shards: 3

setup.kibana:

output.redis:

hosts: ["192.168.2.130"]

key: "filebeat"

db: 0

timeout: 5

保存退出

重启服务:systemctl restart filebeat

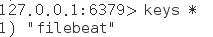

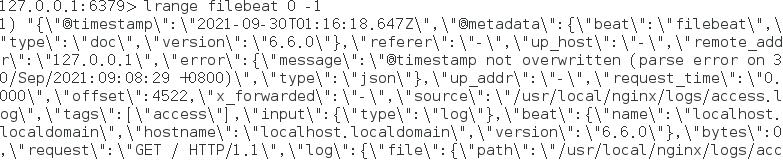

(2)测试访问网站,登录redis,查看键值

redis-cli #登录

keys * #列出所有键

type filebeat #filebeat为键值名

LLEN filebeat #查看list长度

LRANGE filebeat 0 -1 #查看list所有内容

3.安装logstash,收集redis的日志,提交给es

(1)安装logstash(安装包提前放在了/data/soft下)

cd /data/soft/

rpm -ivh logstash-6.6.0.rpm

(2)配置logstash

vim /etc/logstash/conf.d/redis.conf

添加:

input {

redis {

host => “192.168.2.130”

port => “6379”

db => “0”

key => “filebeat”

data_type => “list”

}

}

filter {

mutate {

convert => [“upstream_time”,“float”]

convert => [“request_time”,“float”]

}

}

output {

stdout {}

elasticsearch {

hosts => [“http://192.168.2.130:9200”]

index => “nginx_access-%{+YYYY.MM.dd}”

manage_template => false

}

}

保存退出

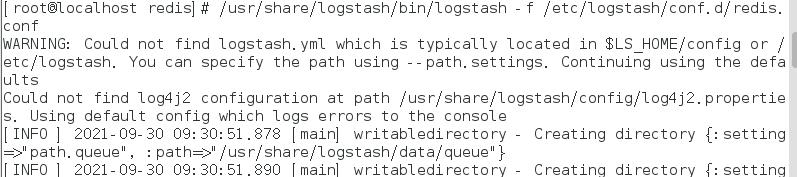

(3)启动logstash

/usr/share/logstash/bin/logstash -f /etc/logstash/conf.d/redis.conf

(4)修改logstash配置文件,实现access和error日志分离

vim /etc/logstash/conf.d/redis.conf

添加:

input {

redis {

host => “192.168.2.130”

port => “6379”

db => “0”

key => “filebeat”

data_type => “list”

}

}

filter {

mutate {

convert => [“upstream_time”,“float”]

convert => [“request_time”,“float”]

}

}

output {

stdout {}

if “access” in [tags] {

elasticsearch {

hosts => [“http://192.168.2.130:9200”]

index => “nginx_access-%{+YYYY.MM.dd}”

manage_template => false

}

}

if “error” in [tags] {

elasticsearch {

hosts => [“http://192.168.2.130:9200”]

index => “nginx_error-%{+YYYY.MM.dd}”

manage_template => false

}

}

}

保存退出

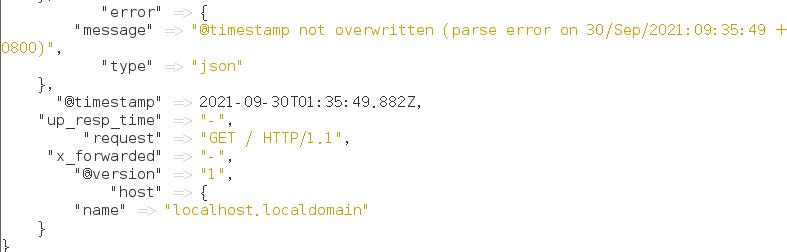

重启logstash:/usr/share/logstash/bin/logstash -f /etc/logstash/conf.d/redis.conf

验证:再访问几次,监控页面刷新可以看到数值变化

以上是关于日志管理进阶-成为elk与efk的“高富帅”的主要内容,如果未能解决你的问题,请参考以下文章