大模型时代的AI之变与开发之根

Posted 脑极体

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了大模型时代的AI之变与开发之根相关的知识,希望对你有一定的参考价值。

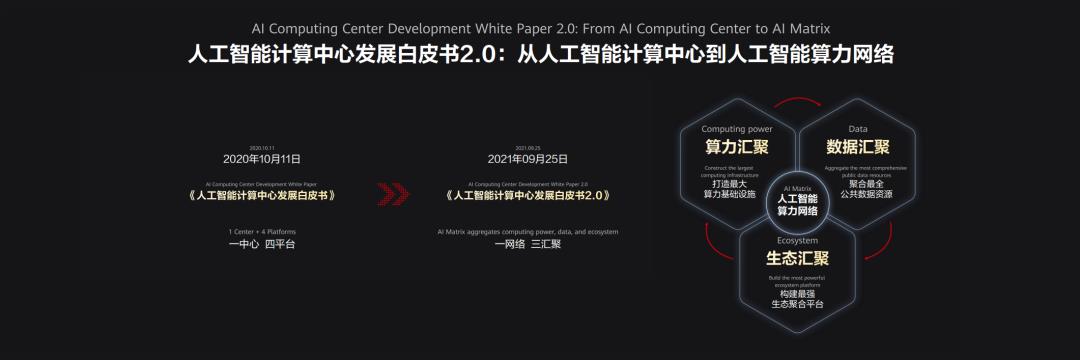

自2018年谷歌发布Bert以来,预训练大模型以强大的算法效果,席卷了NLP为代表的各大AI榜单与测试数据集。随着产学研各界的深入研究,大模型在AI产学研各界的地位得到不断加强。到2021年,我们可以看到各大学术机构、科技企业都在打造自己的大模型,并且将其能力边界、技术路径进行了极大拓展。

有人认为,AI大模型的到来让这项技术完成了从实验室到工业化集成的转变。如果说过去的AI开发需要手工作坊模式的调参、调优、数据积累,那么大模型则预先集成了海量数据的训练效果,企业与科研用户拿到手中就是一个“智力”强大、效果客观的完成品。于是极大程度节省了重复开发成本,降低了开发门槛。

大模型的价值涌现出来,下一个问题随之诞生:打造大模型需要人工智能算力、网络、框架等一系列条件形成有效支撑,才能让大模型真正“大”起来。大模型能够持续发展的前提,是必须打造强壮的AI根技术,在框架、算力等层面满足大模型的“建造”需求。

不久之前,中科院自动化所发布了全球首个三模态大模型——紫东.太初。

而这项技术成果的背后,是中科院自动化所与华为携手,利用全场景AI框架MindSpore对大模型开发进行了一系列支撑。9月25日, 在华为全联接2021上,MindSpore中文名“昇思”发布,同时推出昇思1.5版本。这一版本强化全场景能力、原生支持大模型,并新增AI科学计算新范式,发布电磁仿真套件和分子模拟套件,促进AI应用于科学计算领域。

我们就借此机会,聊聊大模型如何从昇思1.5中汲取营养;持续打造大模型,需要开发框架带来怎样的根技术支持。

时代的召唤:

大模型推动AI之变

预训练大模型发展到今天,已经经历了三年多的时间。期间最具“出圈”效应的大模型,可能就要属2020年OpenAI发布的NLP大模型GPT-3。

GPT-3首次实现了千亿级数据参数,除了传统的NLP能力之外,还可以算术、编程、写小说、写论文摘要,一时之间成为舆论热点。GPT-3的出现,让各界看到了大模型的潜力, 也让中国开发自己的大模型成为了“时代的召唤”。

从产业价值上看,预训练大模型带来了一系列可能性,让产学研各界看到了由弱人工智能走向强人工智能;由重复开发、手工作坊式人工智能,走向工业化、集成化智能的全新路径。可以说,大模型是近两年AI持续变革的核心动力,也是AI走入千行百业、各学科领域的关键支柱。

于是我们可以看到,中国的科技企业、学术科研机构纷纷开始加码大模型,并且在不同路径上进行探索和尝试。比如说,Bert和GPT都是NLP领域的大模型,缺乏对图形图像数据与多模态数据的处理能力。因此,多模态大模型成为了重要的研究方向。集成语音、文本、图像、视频等各个模态信息的处理模式,也更加贴近人类感知,具有更高的社会价值。

对于产学各界来说,数据量大、训练效果好、网络拓扑结构紧凑,同时又容易获取的预训练大模型,都是未来学术研究、AI开发、产业升级的基础和关键。大模型将很有可能改变AI的研究范式,成为不同领域的共性基础平台。

中科院自动化所就瞄准这一方向,成功构建了视觉-文本-语音三模态预训练模型——紫东.太初。而在其背后,华为提供的昇思1.5框架的能力,成为了打造大模型的利剑。

驶向多模态:

紫东.太初的独特价值

破混沌,开新局,紫东.太初这个极具魄力与东方文化质感的名字属于全球首个三模态大模型(OPT-Omni-Perception pre Trainer)。它能够实现图文音语义的统一表达,将视觉、文本、语音三种模态统一起来,实现以文搜图,以图生音等跨模特理解与生成能力,这标志着预训练模型工作获得突破性进展。

目前阶段,产学研界最多的大模型就是NLP大模型,其次是CV大模型。而多模态大模型作为新生事物,基本也考虑的是两个模态之间的协同转化。比如图像与文本、视频与文本,并且能力更多是集中在生成或理解中的一项,很少能够兼顾。

紫东.太初为了解决这些问题,提出了视觉-文本-语音三模态预训练模型。通过将视觉、文本、语音不同模态数据各自编码器,映射到统一语义空间,然后通过多头自注意力机制(Multi-head Self-attention)学习模态之间的语义关联以及特征对齐,形成多模态统一知识表示,再利用编码后的多模态特征,最终通过解码器分别生成文本、图像和语音。经过这样的对齐与转化,大模型可以更加关注图-文-音三模态数据之间的关联特性以及跨模态转换问题,对更广泛、更多样的下游任务提供模型基础支撑。最终,多模态大模型不仅可以实现跨模态理解,还能完成跨模态生成,极大程度提升了学习框架的灵活性,有效降低了多模态数据的收集与清洗成本。

由于三模态大模型非常接近人类的信息处理方式,其对信息数据有非常好的协同掌握能力,因此可以非常广泛地应用于产学各领域,孵化出更多新应用。紫东.太初目前已经具备全球领先的图文音跨模态理解与生成能力,可轻松完成智能问答、图片生成、视频理解与等任务,这些能力将在工业质检、影视创作、互联网推荐、智能驾驶等领域广泛应用。

而面向产业上游看,我们会发现紫东.太初的打造,得益于昇腾AI的产业底座。尤其是昇思对大模型的原生支持,让大模型具备了快速开发、精准训练的“开发之根”。

根强则AI强:

昇思支持大模型时代到来

在MindSpore 全新升级的1.5版本中,我们不仅见到了全新的中文名——昇思,更重要的是见到了昇思新版本对科学研究、AI基础开发的全新适配能力,展现了昇腾AI产业对新锐产学动向的洞察和满足。

在科研工作中,AI开发经常是一件成本巨大、容错率极低的工作。算力、数据、基础模型和开发套件都会成为科研工作中的AI开发难题。面对这些问题,昇思1.5不仅极大提升了对大模型的适配能力,还强化升级了科学计算引擎,全面加强了对学术界、工业界的AI开发支持。

在大模型支持方面,昇思1.5版本实现了原生支持大模型,能够在业界率先支持全自动并行AI处理。在大模型训练中,可以同时使用数据并行、算子级模型并行、Pipeline 模型并行、优化器模型并行、异构并行、重计算、高效内存复用多维度、全种类的分布式并行策略;并且原创集群拓扑感知的多维度自动混合并行,实现超大模型自动切分,显著提升集群加速能力;新的 DNN分布式并行编程范式,可以实现低代码算法切换,大幅节省开发时间。

面对结构复杂、训练开销巨大、训练时间漫长的多模态大模型,新的昇思特性可以极大提升训练加速能力,同时减少系统性能优化代价,降低代码开发工作力,从而综合性地减少调试与训练周期。

在这样的框架能力升级中,会有更多创新性强、训练数据规模大的预训练大模型在昇思的支撑下发展起来。昇思自然也就名副其实成为了大模型的“根技术”。

目前,基于昇思训练的大模型除了已经发布的全球首个中文预训练大模型鹏程.盘古、全球首个三模型预训练大模型紫东.太初,还有即将发布的智能遥感大模型、语音大模型等等,可以说昇思框架对大模型支持的能力是业界首屈一指的。

与此同时,昇思1.5还新增了对外开放机制等诸多新特性,尤其注重在科研创新和应用领域的支持。通过多尺度混合计算和高阶混合微分两大关键创新,将原有的 AI 计算引擎升级为 AI 与科学计算的统一引擎,实现融合的统一加速。在此基础上,未来昇思将面向 8 大科学计算场景推出 MindScience 系列套件。科学计算套件包含业界领先的数据集、基础模型、预置高精度模型和前后处理工具,可以加速科学行业应用开发。

昇思将持续加强对科研领域AI开发的支持,尤其是为大模型这种“国之重器”的训练底座。同时,昇腾社区和昇思MindSpore社区也会加强对大模型开源开放的支持。目前,昇思社区下载量已经突破60万,社区贡献者超过3500人。昇思正在与产学研各界一同推进开源开放,让大模型真正成为科学之基、产业之本。

预训练大模型正在推动一场AI新变革。而在关注这场变革之前,我们更应该关注根技术、根平台的打造与建设。

坚实的产业基础之上,才能产学各界万花盛放。AI大模型之变,应该有强壮的根。

以上是关于大模型时代的AI之变与开发之根的主要内容,如果未能解决你的问题,请参考以下文章