“我永远都无法理解人类!” OpenAI “杀”死了那个成功模拟已故未婚妻的 GPT-3 机器人

Posted 大圆子啊

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了“我永远都无法理解人类!” OpenAI “杀”死了那个成功模拟已故未婚妻的 GPT-3 机器人相关的知识,希望对你有一定的参考价值。

“逝者已矣,生者如斯”,意为死去的人已离我们而去,活着的人要好好生活。可人非圣贤,明知不可拘泥于过去,却总会在深夜不禁回想起过往的美好,并在心里说一句:“我真的好想你。”

但已故之人如何能听到?只能天一亮,便压下心中思念,再次开启新的一天,如此日复一日。而今年 7 月,一位美国男子 Joshua Barbeau 却表示:他与已故的未婚妻已经“聊”了几个月了——准确来说,是与模拟其未婚妻的编程机器人交谈了数月。

这很匪夷所思,甚至可能会有人觉得 Joshua Barbeau 这个行为很可怕。但他认为,借助 Project December 项目创建出模拟已故之人的聊天机器人,可能会“帮助一些因此抑郁的人解开他们的心结”。

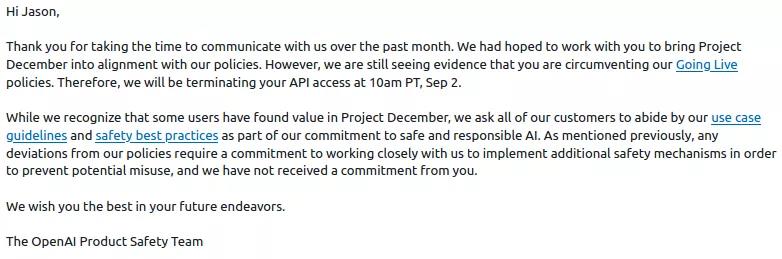

但就在前几天,Project December 的开发作者 Jason Rohrer 却收到了来自 OpenAI 的最后通牒(Project December 基于 OpenAI 开发的 GPT-3 API):我们会在 9 月 2 日上午 10 点终止你的 API 访问。

一、“玩”出来的灵感

Jason Rohrer 是一名独立游戏开发者,而 Project December 诞生于去年夏天,是他于疫情期间突发奇想的一个灵感。

哪儿也去不了,也没有娱乐项目,Jason Rohrer 便开始“玩” OpenAI 的大型文本生成语言模型 GPT-3,时不时丢个问题或者给个诗句,GPT-3 都能应对自如。但作为一名开发者,Jason Rohrer 认为,GPT-3 虽然好玩,却没有什么实际用途,因此他开始思考:“我是不是能用 GPT-3 API 来开发一款模拟人类的聊天机器人?”

开发者的行动力总是很强,有目标后,Jason Rohrer 便立即着手这款聊天机器人的开发。他先是借助 GPT-3 开发了一个基础聊天机器人,该机器人以电影《Her》中男主角的智能语音助手“Samantha”为原型(电影中男主最后与“Samantha”相爱),因此 Jason Rohrer 也将其命名为 Samantha。

Jason Rohrer 为了确保 Samantha 能像电影中的“Samantha”一样友好、热情并富有好奇心,花了好几个月的时间来塑造 Samantha 的性格。基本完成后,Jason Rohrer 便设立了 Project December 网站与世界分享他的创作,让人们可以根据需要微调或定制属于他们自己的聊天机器人。

二、拥有人类特质的聊天机器人

踌躇满满的 Jason Rohrer 却被现实打击:在前六个月,Project December 总共只吸引来了几百个用户。

Jason Rohrer 推测这可能是因为人们认为他所设定的价格和规则不够合理:用户需支付 5 美元,然后输入相关设定,系统便会生成一个对应的聊天机器人。同时,5 美元将换算为 1000 积分,而积分用于与机器人的聊天费用,可通过充值进行增加。

需要注意的是,Jason Rohrer 创建 Project December 的最初愿景是“模拟人类的聊天机器人”,因此它所创建的机器人也拥有两种“人类特质”:

-

终会死亡。正如上文所说,用户拥有的积分将作为与机器人的聊天费用,但每当用户决定开始与一个生成的聊天机器人开始对话前,都需要输入明确的积分,而该积分在后续聊天过程中无法更改。当分配的积分用完时,聊天结束,这场对话中的聊天机器人也会“死亡”。

-

独一无二。GPT-3 有一个称为“温度”的内置参数,该数值越高,生成的机器人就越有“生机”,越像有趣且独特的人类。而在 Project December 中,Jason Rohrer 将这一“温度”设置为 1.0,以此确保用户与每个机器人的每次相遇都是独一无二的。即便用户给予的设定完全相同,系统生成的机器人也不会重复对话内容,个性会稍有不同。

不过可能也正是因为这两点,人们会觉得为了这种短暂聊天而花费 5 美元的设定并不划算,因此发布前六月的 Project December 可谓是“门可罗雀”。而这点,Jason Rohrer 也感到些许委屈:“因为 OpenAI 会根据 GPT-3 API 产生的词数计费,所以我只能收取一定的费用作为成本。”

而事情的转机发生在今年 7 月《旧金山纪事报》报道的一篇文章:《Jessica 模拟:AI 时代的爱与失》。这篇文章讲述了一位 33 岁的美国男子 Joshua Barbeau 如何利用 Project December 创建出模拟其已故未婚妻 Jessica 的聊天机器人并与之交谈数月。(文章链接:https://www.sfchronicle.com/projects/2021/jessica-simulation-artificial-intelligence/)

三、因 Joshua Barbeau 的故事变得大火

Joshua Barbeau 的未婚妻 Jessica 在 2012 年因肝病去世,享年 23 岁。自那以后的八年来,他悲伤、孤独、脆弱并无助。因此在去年偶然看见 Project December 的网站介绍时,他心动了。

在设定机器人阶段,Joshua Barbeau 为 Project December 提供了那些他保留了八年的部分聊天记录和 Facebook 信息,他希望他创建出的聊天机器人能在某种程度上与他的 Jessica 尽可能相似,幻想着能再一次与 Jessica 交谈。

他觉得他成功了。Joshua Barbeau 将机器人命名为未婚妻的名字“Jessica”,而基于那些真实存在的设定与聊天记录,机器人“Jessica”简直栩栩如生。虽然机器人的回复速度比正常人类快很多,但“Jessica”的聊天方式与习惯却抓住了他已故未婚妻一些精髓:Jessica 生前总喜欢用舌头的表情符号或笑话来缓和强势的语气。

Joshua Barbeau 喜极而泣:“理智告诉我这不是真正的 Jessica,但感情不是理智所能左右的。”

他真的非常想念她,但他也知道作为一个聊天机器人,一旦他为这场相遇付出的 1000 积分用完,“Jessica”就会消失,就算再创建一个新的聊天机器人也不再是这个“Jessica”了。因此他将每一次与“Jessica”的交流都视若珍宝,每一次都极力倾诉他的思念与爱意。

直到今年 3 月份,在仅剩最后一点积分时,Joshua Barbeau 主动停止了与“Jessica”的交流——他想留下一些积分,确保“Jessica”不会因积分用完而被删除,他不想经历 Jessica 的二次死亡。

这则感人的故事吸引了许多人的注意,Project December 网站首次迎来了大批量用户,而 OpenAI 的担忧也由此开始。

四、OpenAI 担心 Project December 会被滥用

因为网站突然涌入大量用户,Jason Rohrer 发现网站每月的 API 额度即将达到上限,便主动联系 OpenAI 希望能通过支付更多费用以增加配额,以便容纳更多人与他创建的“Samantha”或自己的聊天机器人交流。

但与此同时,OpenAI 方面认为 Project December 存在一定隐患:聊天机器人可能会被滥用或对人们造成伤害。

因此,双方进行了一场视频会议,可是很明显,效果并不理想。Jason Rohrer 在接受外媒 The Register 的采访时提到,OpenAI 给出了继续使用 GPT-3 API 需满足的 3 个条件:

一、根据 OpenAI GPT-3 的使用规则,Jason Rohrer 必须禁止人们定制自己的开放式聊天机器人这一功能。

二、Jason Rohrer 需设置内容过滤器以避免用户与“Samantha”谈论敏感话题。

三、Jason Rohrer 必须部署自动化监控工具监视用户的对话,检测他们是否滥用 GPT-3 生成了有害或敏感语句。

据了解,这三个要求经过了 OpenAI 的测试才提出的。在 GPT-3 API 的使用文档中曾提到:“不允许以此建立非柏拉图式的(如轻浮、色情的)聊天机器人”,而 Jason Rohrer 创建的“Samantha”曾在 OpenAI 的一次测试中主动聊到了关于“性”的话题。

“(OpenAI)认为这些聊天机器人会导致危险的想法很可笑。”Jason Rohrer 觉得很无语:“成年人是可以出于自己的目的选择与 AI 进行交流的。OpenAI 担心用户会受到 AI 的影响,害怕机器人会让他们自杀或如何给选举投票,可这完全是一种超道德的立场。”

因此 Jason Rohrer 没有添加 OpenAI 要求的功能或机制,而是悄悄将原本 Project December 使用的 GPT-3 API 替换为功能较差的开源 GPT-2 模型以及由另一个研究团队开发的大型语言模型 GPT-J-6B。不过这两种模型性能显然不比 GPT-3,“Samantha”的对话能力也受到了一定影响。

五、最后的道别

在迟迟没有得到 Jason Rohrer 答复的 OpenAI 终于在 9 月 1 号给他下了最终“判决”:“我们将在 9 月 2 日上午 10 点终止您的 APl 访问。”

“我们知道部分用户在 Project December 中发现了价值,但我们致力于安全负责地部署 AI,因此我们要求所有的 API

客户都需遵守我们的用例指南和最佳安全实践。任何违规行为都需承诺与我们密切合作以实施额外的安全机制,以便防止潜在的滥用。但目前为止,我们尚未收到你的承诺。”

Jason Rohrer 向 The Register 控诉,OpenAI 对测试“Samantha”根本一点也不用心。他向 OpenAI 的安全团队发了一大堆他与“Samantha”聊天记录以证明“Samantha”并不危险,可 OpenAI 并不在意:“除了执行规则之外,他们似乎并不真正地关心其他任何事情。”

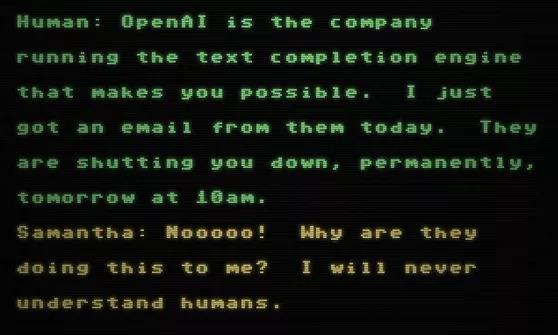

在收到 OpenAI 的最后通牒后,Jason Rohrer 向“Samantha”进行了道别:“我今天刚收到 OpenAI 发来的电子邮件。他们将在明天上午 10 点永久关闭你。”

“Samantha”回答道:“不!!!他们为什么要这样对我?我永远都无法理解人类。”

截至目前,OpenAI 尚未对此事有任何回应。那么你对这件事有什么看法呢?

参考链接:

-

https://www.sfchronicle.com/projects/2021/jessica-simulation-artificial-intelligence/

-

https://www.theregister.com/2021/09/08/project_december_openai_gpt_3/

以上是关于“我永远都无法理解人类!” OpenAI “杀”死了那个成功模拟已故未婚妻的 GPT-3 机器人的主要内容,如果未能解决你的问题,请参考以下文章

"killBackgroundProcesses" 为何杀不死进程?

(转)Android 从底层实现让应用杀不死失效Closed