GitHub开源在线学习资料《计算机视觉实战演练:算法与应用》

Posted Charmve

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了GitHub开源在线学习资料《计算机视觉实战演练:算法与应用》相关的知识,希望对你有一定的参考价值。

全面 前沿 免费 计算机视觉实战演练:算法与应用 📌 |

作者系迈微AI研习社创始人、CSDN博客专家,主要分享机器学习算法、计算机视觉等相关内容,每周研读顶会论文,持续关注前沿技术动态。

✨ 以用促学,先会后懂 ✨

一种结合了代码、图示和html的在线学习媒介

|  |

|  |

- 在线阅读 | https://charmve.github.io/computer-vision-in-action/

- GitHub | https://github.com/Charmve/computer-vision-in-action

- 项目主页 | https://charmve.github.io/L0CV-web/

全书组织

🏷 fig_book_org

本书详细介绍,请移步 序言。

-

第一部分包括基础知识和预备知识。提供深度学习的入门课程,然后在理论篇中,将快速向你介绍实践计算机视觉所需的前提条件,例如如何存储和处理数据,以及如何应用基于线性代数、微积分和概率基本概念的各种数值运算,涵盖了深度学习的最基本概念和技术,例如线性回归、多层感知机和正则化。

-

第二部分是本书涉及的计算机视觉基础理论,核心部分为神经网络模型,包括神经网络、卷积神经网络、循环神经网络理论讲解,以图像分类、模型拟合与优化作为其代码的实战项目。在模型拟合和优化章节中,着重分享梯度下降、随机梯度下降、动量法、AdaBoost等方法。

-

接下来的七章集中讨论现代计算机视觉技术实战,也是本书的核心部分。围绕这样的组织逻辑:什么是计算机视觉?计算机视觉解决什么问题,都是怎么解决的?传统方法——以卷积神经网络为中心的神经网络;现代方法——Transformer、强化学习、迁移学习、生成对抗等。各种方法是如何实现的,用到了什么框架?在第7章中,描述了计算机视觉的经典卷积神经网络PyTorch实现,并为我们随后实现更复杂的模型奠定了基础。在随后的几个章节中,我们主要解决图像分类、目标检测、语义分割、3D重建等实际问题,并给出实战项目。

-

该部分以项目为实战指导,给出详细的项目指导书和代码实现,更为特别的是,给出了notebook可以直接在线运行,跑通结果,免去了本地运行环境的搭建复杂性。于此同时,为了方便读者在本地调试,作者建立了一个名为

L0CV的第三方包,可以直接在代码中import L0CV后使用。 -

第三部分讨论最近几年出现的“网红”模型,诸如:Transformer、Attention、知识蒸馏、迁移学习、生成对抗模型等。这部分也是此份资料的力挺之作。最后,在

chap_optimization中,我们讨论了用于训练深度学习模型的几种常用优化算法,如:模型压缩、模型剪枝、微调、蒸馏等。

愿景

本开源项目代表了我们的一种尝试:我们将教给读者概念、背景知识和代码;我们将在同一个地方阐述剖析问题所需的批判性思维、解决问题所需的数学知识,以及实现解决方案所需的工程技能。

我们的目标是创建一个为实现以下目标的统一资源:

- 所有人均可在网上免费获取;

- 提供足够的技术深度,从而帮助读者实际成为计算机视觉应用科学家:既理解数学原理,又能够实现并不断改进方法;

- 包含可运行的代码,为读者展示如何在实际中解决问题。这样不仅直接将数学公式对应成实际代码,而且可以修改代码、观察结果并及时获取经验;

- 允许我们和整个社区不断快速迭代内容,从而紧跟仍在高速发展的计算机视觉领域;

- 由包含有关技术细节问答的论坛作为补充,使大家可以相互答疑并交换经验。

目录

📘 详细目录序言

主要符号表

绪论篇

- 第 0 章 计算机视觉概述

- 0.1 概述

- 0.1.1 什么是计算机视觉

- 0.1.2 计算机视觉解决什么问题

- 0.1.3 行业应用

- 0.2 计算机视觉基本概念

- 0.3 发展历史回顾

- 0.4 典型的计算机视觉任务

- 图像分类

- 目标识别与目标检测

- 实例分割与语义分割

- 3D 建模

- 0.5 国内外优秀的计算机视觉团队汇总

- 小练习

- 小结

- 参考文献

- 0.1 概述

- 第 0 章 计算机视觉概述

理论篇

- 第 1 章 神经网络

- 1.1 线性回归

- 1.1.1 基本原理

- 1.1.2 从零实现线性回归

- 1.1.3 线性回归的简洁实现

- 1.2 Softmax 回归

- 1.2.1 softmax回归模型

- 1.2.2 从零开始实现softmax回归

- 1.2.3 softmax回归的简洁实现

- 1.3 多层感知器

- 1.3.1 基本原理

- 1.3.2 从零开始实现多层感知器

- 1.3.3 多层感知器的简洁实现

- 1.4 反向传播算法

- 1.5 神经网络

- 1.5.1 神经学观点

- 1.5.2 神经网络1-建立神经网络架构

- 1.5.3 神经网络2-设置数据和损失

- 1.5.4 神经网络3-学习和评估

- 1.5.5 案例分析-最小神经网络案例研究

- 1.6 实战项目 1 - 手写字分类

- 小结

- 参考文献

- 1.1 线性回归

- 第 2 章 卷积神经网络

- 2.1 从神经网络到卷积神经网络

- 2.2 卷积网络的层级结构

- 2.2.1 数据输入层

- 2.2.2 卷积计算层

- 2.2.3 非线性层(或激活层)

- 2.2.4 池化层

- 2.2.5 全连接层

- 2.3 卷积神经网络的几点说明

- 2.4 实战项目 2 - 动手搭建一个卷积神经网络

- 小结

- 参考文献

- 第 3 章 图像分类

- 3.1 数据驱动方法

- 3.1.1 语义上的差别

- 3.1.2 图像分类任务面临着许多挑战

- 3.1.3 数据驱动的方法

- 3.2 k 最近邻算法

- 3.2.1 k 近邻模型

- 3.2.2 k 近邻模型三个基本要素

- 3.2.3 KNN算法的决策过程

- 3.2.4 k 近邻算法Python实现

- 小结

- 参考文献

- 3.3 支持向量机

- 3.3.1 概述

- 3.3.2 线性支持向量机

- 3.3.3 从零开始实现支持向量机

- 3.3.4 支持向量机的简洁实现

- 3.4 逻辑回归 LR

- 3.4.1 逻辑回归模型

- 3.4.2 从零开始实现逻辑回归

- 3.4.3 逻辑回归的简洁实现

- 3.5 实战项目 3 - 表情识别

- 3.6 实战项目 4 - 使用卷积神经网络对CIFAR10图片进行分类

- 小结

- 参考文献

- 3.1 数据驱动方法

- 第 4 章 循环神经网络

- 第 5 章 图神经网络

- 5.1 历史脉络

- 5.2 图神经网络(Graph Neural Network)

- 5.3 门控图神经网络(Gated Graph Neural Network)

- 5.3.1 状态更新

- 5.3.2 实例1:到达判断

- 5.3.3 实例2:语义解析

- 5.3.4 GNN与GGNN

- 5.4 图卷积神经网络(GCNN)

- 5.4.1 图卷积缘起

- 5.4.2 图卷积框架(Framework)

- 5.4.3 再谈卷积

- 5.4.4 空域卷积(Spatial Convolution)

- 5.4.5 消息传递网络(Message Passing Neural Network)

- 5.4.6 图采样与聚合(Graph Sample and Aggregate)

- 5.4.7 图结构序列化(PATCHY-SAN)

- 5.4.8 频域卷积(Spectral Convolution)

- 5.5 生成图表示

- 5.5.1 图读出操作(ReadOut)

- 5.5.2 基于统计的方法(Statistics Category)

- 5.5.3 基于学习的方法(Learning Category)

- 5.5.4 其他方法

- 5.6 图神经网络在计算机视觉上的应用

- 小结

- 参考文献

- 第 5 章 模型选择、欠拟合和过拟合

- 5.1 训练误差和泛化误差

- 5.2 模型选择

- 5.3 欠拟合和过拟合

- 5.4 多项式函数拟合实验

- 5.5 数值稳定性和模型初始化

- 小结

- 参考文献

- 第 6 章 模型拟合与优化算法

- 6.1 优化与深度学习

- 6.2 梯度下降和随机梯度下降

- 6.3 小批量随机梯度下降

- 6.4 动量法

- 6.5 AdaGrad算法

- 6.6 RMSProp算法

- 6.7 AdaDelta算法

- 6.8 Adam算法

- 小结

- 参考文献

- 第 1 章 神经网络

实战篇

- 第 6 章 软件环境搭建与工具使用

- 6.1 深度学习环境搭建指南

- 6.2 Pytorch 基础使用介绍

- 6.2.1 Tensors

- 6.2.2 Operations

- 6.2.3 Numpy桥梁

- 6.2.4 CUDA Tensors

- 6.3 Python

- 6.4 Numpy 基础使用

- 6.5 Pandas 基础使用

- 6.6 OpenCV 安装及基础使用

- 6.7 Jupyter Notebook 配置及基础使用

- 6.8 基本的图像操作和处理

- 6.8.1 PIL:Python图像处理类库

- 6.8.2 Matplotlib

- 6.8.3 NumPy

- 6.8.4 SciPy

- 6.8.5 高级示例:图像去噪

- 6.9 实战项目 5 - 使用OpenCV进行图像全景拼接

- 小结

- 参考文献

- 第 7 章 经典卷积神经网络架构:原理与PyTorch实现

- 7.1 卷积神经网络(LeNet)

- 7.2 深度卷积神经网络(AlexNet)

- 7.3 使用重复元素的网络(VGG)

- 7.4 含并行连结的网络(GoogLeNet)

- 7.5 残差网络(ResNet)

- 7.6 二阶网络编码解码(U-Net)

- 7.7 稠密连接网络(DenseNet)

- 7.8 语义分割网络(SegNet)

- 7.9 实例分割网络(Mask-RCNN)

- 7.10 区域卷积神经网络(R-CNN)

- 7.11 全卷积网络(FCN)

- 7.12 YOLO: 实时目标检测

- 小结

- 参考文献

- 第 8 章 著名数据集及基准

- 8.1 数据集

- 8.2 基准测试

- 8.3 评价指标

- 8.4 实战项目 6 - Kaggle比赛:图像分类(CIFAR-10)

- 8.5 实战项目 7 - Kaggle比赛:狗的品种识别(ImageNet Dogs)

- 小结

- 参考文献

- 第 9 章 检测与分割实战项目

- 9.1 语义分割

- 9.1.1 语义分割 PyTorch 版

- 9.1.2 实战项目 8 - 基于PolarNet的点云端到端语义分割项目实战

- 9.2 目标检测

- 9.2.1 常用网络

- 9.2.2 实战项目 9 - 基于PyTorch的YOLO5目标检测项目实战

- 9.3 实例分割

- 9.3.1 常用网络

- 9.3.2 实战项目 10 - 实时高分辨率背景抠图

- 9.3.3 新方法:滑动窗口, PointRend, PolarMask

- 小结

- 参考文献

- 9.1 语义分割

- 第 10 章 计算机视觉课题研究初探

- 10.1 手写字识别

- 10.2 文本检测

- 10.3 车道线检测

- 10.3.1 常用网络

- 10.3.2 实战项目 11 - 车道线检测项目实战

- 10.4 镜面检测

- 10.5 图像抠图 Matting

- 10.6 图像超分辨率

- 10.7 3D 重建

- 小结

- 参考文献

- 第 6 章 软件环境搭建与工具使用

进阶篇

- 第 11 章 可视化和理解卷积神经网络

- 11.1 特征可视化

- 11.2 倒置

- 11.3 可视化数据梯度

- 11.4 Embeddings

- 11.5 对抗样本

- 11.6 DeepDream 和风格迁移

- 11.7 实战项目 12: PyTorch 如何使用TensorBoard

- 11.4.1 创建 TensorBoard

- 11.4.2 写入 TensorBoard

- 11.4.3 使用 TensorBoard 检查模型

- 11.4.4 向 TensorBoard 添加 “Projector”

- 11.4.5 使用 TensorBoard 跟踪模型训练

- 11.4.6 使用 TensorBoard 评估训练好的模型

- 11.4.7 案例总结

- 小结

- 参考文献

- 第 12 章 生成对抗模型

- 12.1 Pixel RNN/CNN

- 12.2 自编码器 Auto-encoder

- 12.3 生成对抗网络 GAN

- 12.4 变分自编码器 Variational Auto-encoder, VAE

- 12.4.1 概述

- 12.4.2 基本原理

- 12.4.3 VAE v.s. AE 区别与联系

- 12.4.4 变分自编码器的代码实现

- 12.4.5 卷积变分自编码器的实现与简单应用

- 12.4.6 实战项目 13 - 旧照片修复

- 小结

- 参考文献

- 参考文献

- 第 13 章 深度增强学习

- 13.1 引言-如何解决通用人工智能的难点

- 13.2 什么是深度增强学习

- 13.3 怎么利用深度增强学习解决问题

- 13.3.1 Policy-based DRL

- 13.3.2 Value-based DRL

- 13.3.3 Model-based DRL

- 13.4 深度增强学习在计算机视觉中的应用

- 小结

- 参考文献

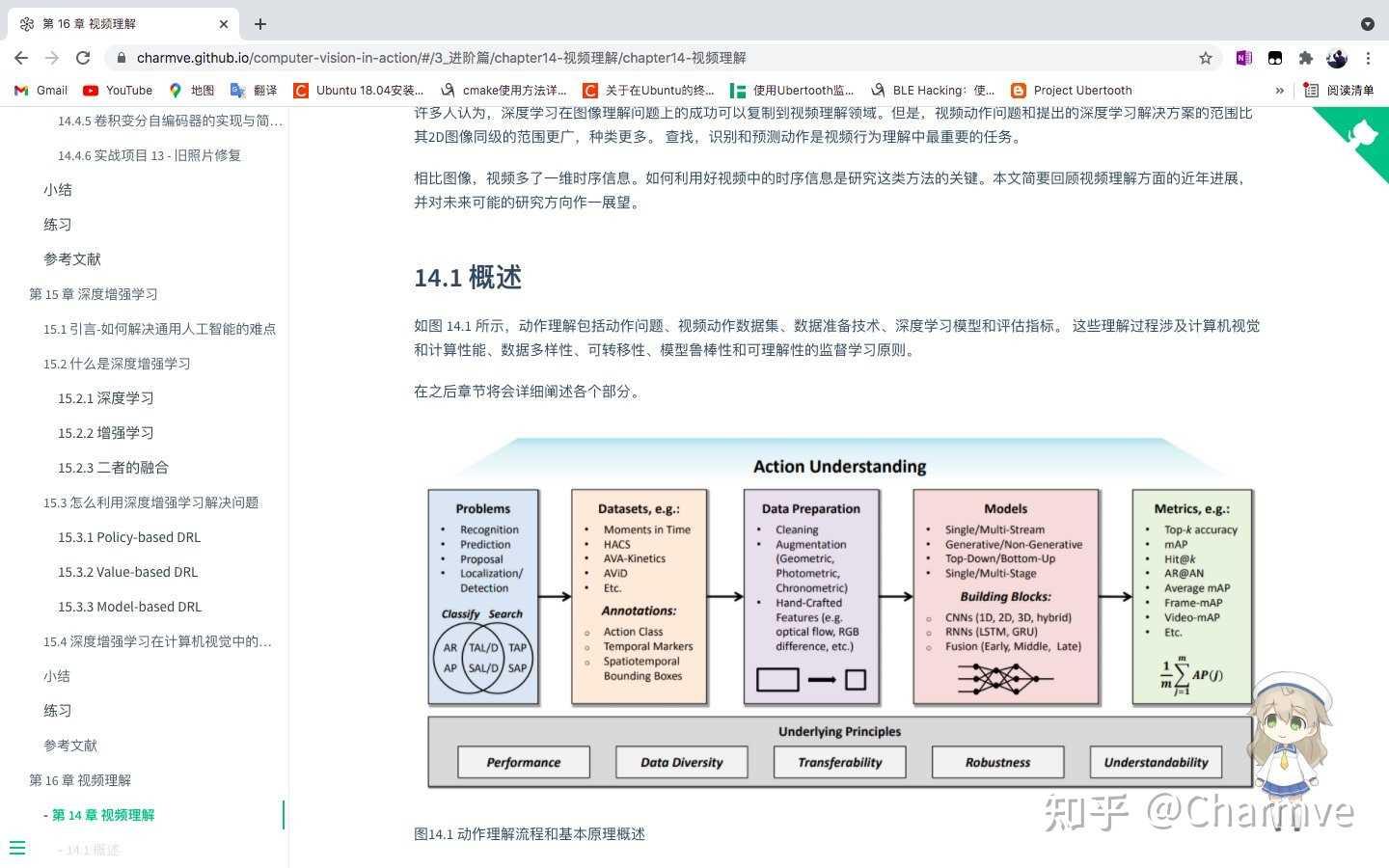

- 第 14 章 视频理解

- 14.1 概述

- 14.2 视频理解场景中的主要问题

- 14.3 常用数据集

- 14.4 主流方法与模型架构

- 14.5 指标 METRICS

- 14.6 可能的未来方向

- 小结

- 参考文献

- 第 15 章 迁移学习

- 15.1 概述

- 15.2 基于实例的迁移

- 15.3 基于特征的迁移

- 15.4 基于共享参数的迁移

- 15.5 深度学习和迁移学习结合

- 15.7 实战项目 14 - 蚂蚁和蜜蜂的分类问题

- 15.7.1 迁移学习在计算机视觉领域的应用

- 15.7.2 实战项目: 蚂蚁和蜜蜂的分类问题

- 小结

- 参考文献

- 第 16 章 计算机视觉中的注意力机制 Attention is All You Need

- 16.1 概述

- 16.2 Attention with RNNs

- 16.3 Self-attention 自注意力

- 16.4 软注意力(soft-attention)

- 16.4.1 空间域注意力

- 16.4.2 通道注意力

- 16.4.3 Positional encoding

- 16.4.4 混合域模型

- 16.4.5 Masked attention

- 16.4.6 Multi-head attention

- 16.5 强注意力(hard attention)

- 16.6 Attention九层塔 - 注意力机制的九重理解

- 小结

- 参考文献

- 第 17 章 跨界模型 Transformer

- 第 18 章 知识蒸馏

- 18.1 概要

- 18.2 KD主要方法

- 18.2.1 Logits(Response)-based Knowledge

- 18.2.2 Feature-based Knowledge

- 18.2.3 Relation-based Knowledge

- 18.3 知识蒸馏的应用 NLP-BERT

- 18.4 常见疑问解答

- 实战项目 16 - 支付宝CVPR细粒度视觉分类挑战赛夺冠方案解读

- 小结

- 参考文献

- 第 19 章 Normalization 模型

- 19.1 从Mini-Batch SGD说起

- 19.2 Normalization到底是在做什么

- 19.3 Batch Normalization如何做

- 19.3.1 前向神经网络中的BN

- 19.3.2 CNN网络中的BN

- 19.3.3 Batch Norm的四大罪状

- 19.4 Layer Normalization、Instance Normalization及Group Normalization

- 19.4.1 Layer Normalization

- 19.4.2 Instance Normalization

- 19.4.3 Group Normalization

- 19.4.4 用一个故事来总结

- 19.5 Normalization操作的Re-Scaling不变性

- 19.6 Batch Normalization为何有效

- 小结

- 参考文献

- 第 20 章 模型压缩与裁剪

- 20.1 概述

- 20.2 模型压缩

- 20.2.1 线性或非线性量化(1990~2014 - 至今)

- 20.2.2 结构或非结构剪枝(1989~2014 - 至今

- 20.2.3 网络结构搜索(2016 - 至今)

- 20.2.4 权重矩阵的低秩分解()

- 20.2.5 知识蒸馏(2014-至今)

- 20.3 模型优化加速

- 20.3.1 Op-Level 的快速算法

- 20.3.2 Layer0-level 的快速算法

- 20.3.3 硬件计算单元优化算法

- CPU、GPU和NPU

- ASIC 和 FPGA

- PIM(NDP)

- 20.4 优化工具与库

- 20.4.1 TensorRT Nvidia)

- 20.4.2 TVM (Tensor Virtual Machine)以上是关于GitHub开源在线学习资料《计算机视觉实战演练:算法与应用》的主要内容,如果未能解决你的问题,请参考以下文章

- 第 11 章 可视化和理解卷积神经网络