脸书 AI 识别误将黑人标记为「灵长类动物」

Posted AI科技大本营

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了脸书 AI 识别误将黑人标记为「灵长类动物」相关的知识,希望对你有一定的参考价值。

整理 | 禾木木

出品 | AI科技大本营(ID:rgznai100)

最近,Facebook用户在观看一段以黑人为主角的视频时,会看到一个自动生成的提示,询问他们是否愿意“继续观看灵长类动物的视频”。

视频的内容其实是几个黑人和警察发生了争执。

这在网上引起了网友的愤怒。

Facebook发言人接受采访时表示,这是“明显不可接受的错误”,并表示涉及的推荐功能已下线。

“我们的 AI 并不完美,还需要改进”

该视频是由《每日邮报》2020年6月27日发布。

视频中有白人、黑人和警察,他们之间发生了一些争执,并且视频内容与灵长类动物无关。

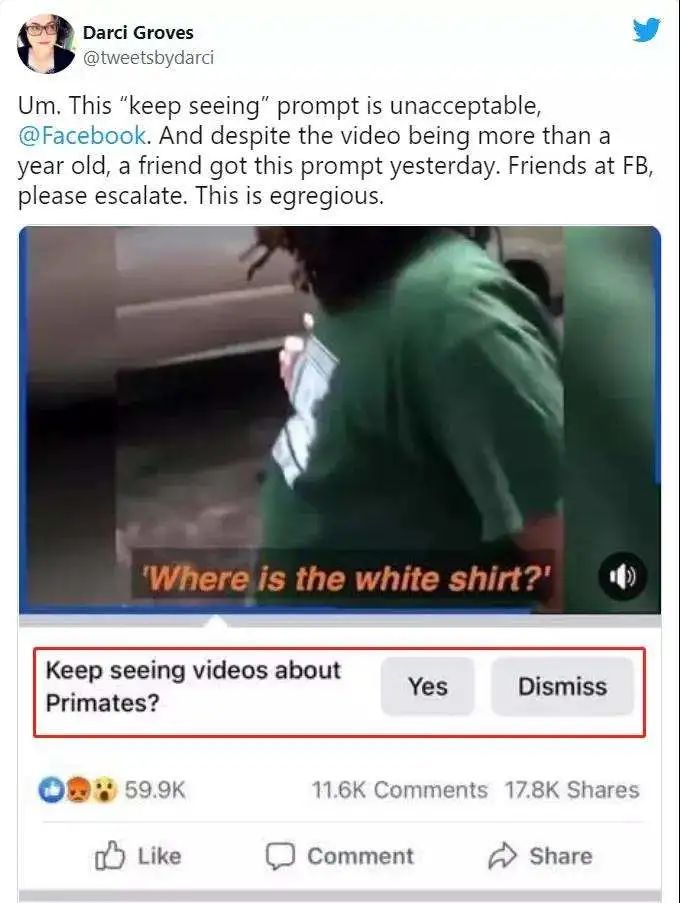

针对此事,前 Facebook 内容设计经理 Darci Groves 在推特生发出该推荐提示截图,并表示这令人无法接受。Groves 还将其发布到一个面向 Facebook 现任和前任员工的产品反馈论坛。作为回应,Facebook 视频平台 Facebook Watch 的产品经理称其「不可接受」,并表示该公司正在「调查根本原因」。

Facebook 拥有世界上最大的用户上传图像存储库之一,用于训练其面部和对象识别算法。Facebook 发言人 Dani Lever 在一份声明中表示:“正如我们所说,尽管我们对人工智能进行了改进,但我们知道它并不完美,我们还有很多改进要做。我们向任何可能看到这些冒犯性推荐信息的人道歉。”

AI 种族歧视,并不是个例

可以看出,此次推荐信息的错误是来自于 AI 系统存在的偏见。

早在之前,就有谷歌、亚马逊、Flickr等多家科技公司都曾因其人工智能系统中存在的偏见,有研究表明面部识别技术因存在种族偏见导致识别困难,甚至曾有报道称黑人因 AI 存在的问题而受到歧视。

2015 年,Google 更新了其照片应用,加入了一个自动标签功能,通过机器识别照片中内容进行自动分类并打上标签,方便管理和搜索。但不成熟的技术惹了大麻烦。纽约布鲁克林的黑人程序员Jacky Alcine惊讶地发现,她和一位女性朋友(也是黑人)的自拍照标记为「大猩猩(Gorillas)」,谷歌当即深表歉意,并表示将立即解决问题。

然而两年后,《Wired》杂志发现谷歌的解决方案仅仅是防止将任何图片标记为大猩猩、黑猩猩或猴子。

随后谷歌证实,在2015 年之后,为了解决这一错误,谷歌直接从搜索结果中删除了这一词条的标签。

结 语

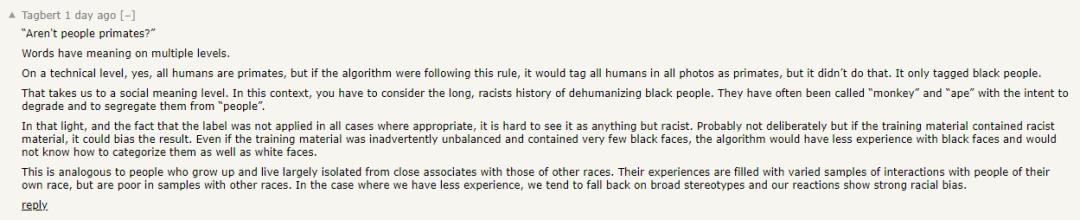

有人认为:这是一个复杂的计算机视觉问题。

有人评论:但是人类不会犯这种低级的错误,为什么 AI 会呢?

还有人评论:算法对于这种人脸识别的经验较少,并且不知道如何将它们归类。

对于数据及其标注的质量和公平性可能还有很长的路需要探索。

所以,AI 识别图片你怎么看呢?

参考链接:

https://news.ycombinator.com/item?id=28415582

以上是关于脸书 AI 识别误将黑人标记为「灵长类动物」的主要内容,如果未能解决你的问题,请参考以下文章

错把黑人视频打上“灵长类动物”标签,Facebook的AI太离谱!官方已向公众致歉...

让AI精准识别盗版,脸书开源数据增强库:支持图文音视频,提供100多种增强方式...