官宣:Hugging Face x ILLA Cloud 深度合作

Posted Datawhale

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了官宣:Hugging Face x ILLA Cloud 深度合作相关的知识,希望对你有一定的参考价值。

Datawhale发布

官宣:Hugging Face x ILLA Cloud

ILLA Cloud 正式宣布与 Hugging Face 达成深度合作,将在我们的产品中集成使用 Hugging Face 的 AI 模型库和其他相关功能。

随着 OpenAI 和 ChatGPT 的爆火,大家逐渐把目光聚焦到了 AIGC 的赛道。越来越多的人也意识到 AIGC 可以给生产力工具带来大幅度的优化和提升,帮助大家节省更多的时间和精力去应对更具有挑战的工作。集成使用 Hungging Face 上的 AI 大模型,可以帮助用户更高效地完成任务,提高工作效率。

▍Hugging Face

Hugging Face 是机器学习界的 Github, 目前已有数十万个预训练模型, 10,000 个数据集。您可以自由访问由其他业界大牛共享的模型、数据集等资源,也可以在 Hugging Face 中托管和部署您的模型。

Hugging Face 是机器学习界的 Github, 目前已有数十万个预训练模型, 10,000 个数据集。您可以自由访问由其他业界大牛共享的模型、数据集等资源,也可以在 Hugging Face 中托管和部署您的模型。

ILLA Cloud 首先在 Resource 资源面板中集成了 Hugging Face, 随后还将在产品中推出更多基于 AIGC 的功能,让用户可以通过即插即用的方式方便地使用各种 AIGC 功能。通过将 Hugging Face 集成到其产品中, ILLA Cloud 希望能够为其用户提供更加人性化和智能化的体验,提高用户的生产效率和工作质量,通过使用快捷使用GUI(图形界面)来快速调试 AL 和 ML 模型,希望这样能帮助更多人参与到 AIGC 领域的开发中来。下面我带领大家来看看在 ILLA Cloud 中调用 Hugging Face 的 AI 模型的的过程。

▍在ILLA Cloud 中使用Hugging Face能做些什么?

在 Hugging Face 中,有超过 13 万个机器学习模型可以通过公开的 API 访问,你可以免费使用、测试这些 API。此外,如果你需要用于生产场景,可以使用 Hugging Face 提供的解决方案 Endpoints,部署并使用 Inference Endpoints 访问。

开源地址:https://github.com/illacloud/illa-builder

ILLA Cloud 提供了数十种常用的前端组件,支持根据实际需求快速搭建不同的前端界面。同时,ILLA Cloud 提供了连接到 Hugging Face 的连接方式,可以快速连接到 Hugging Face API,发起请求并拿到返回数据。将 API 和前端组件连接,即可实现用户通过前端填入内容并提交给 API,API 返回生成内容并展示到前端的需求。

▍如何在 ILLA Cloud 中使用 Hugging Face

1. 步骤1 在 ILLA Cloud 中,使用组件构建 UI

我们先来基于我们期望的使用场景搭建前端界面。

例如,如果你的产品是输入文字、输出生成图,那你可以使用输入组件和图片组件;如果你的产品是输入文字、输出生成也是文字,那你可以使用输入组件或文本组件。

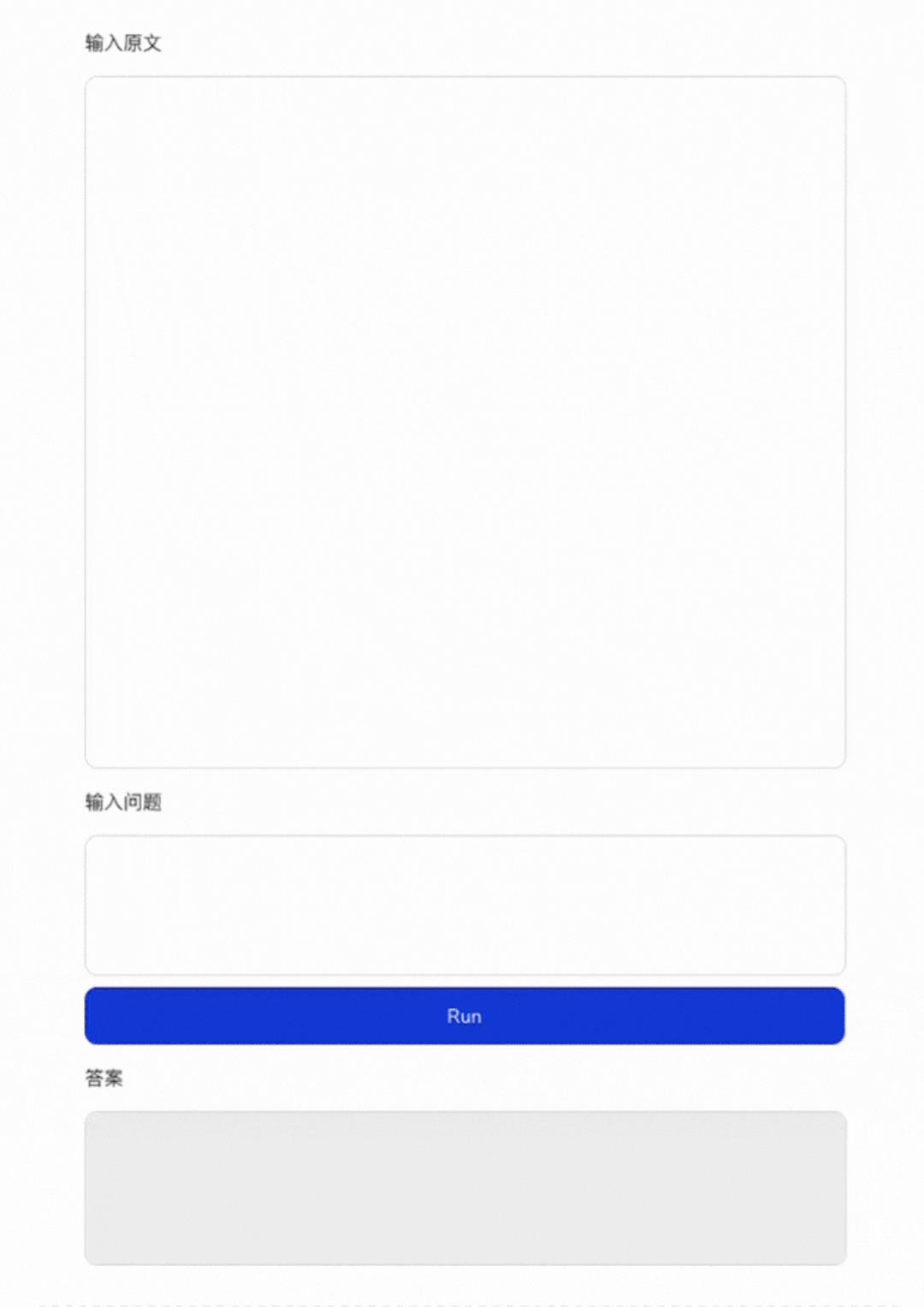

下图是一个基于文本内容做问答的应用界面:

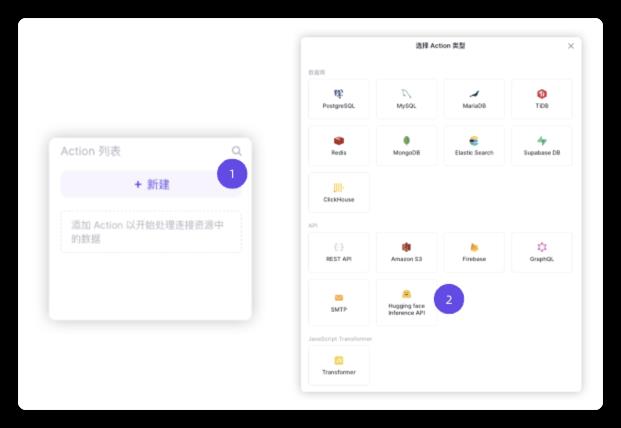

2. 步骤2 创建一个 Hugging Face 资源,并配置 Action

点击 Action 列表的「+ 新建」并选择 Hugging Face Inference API:

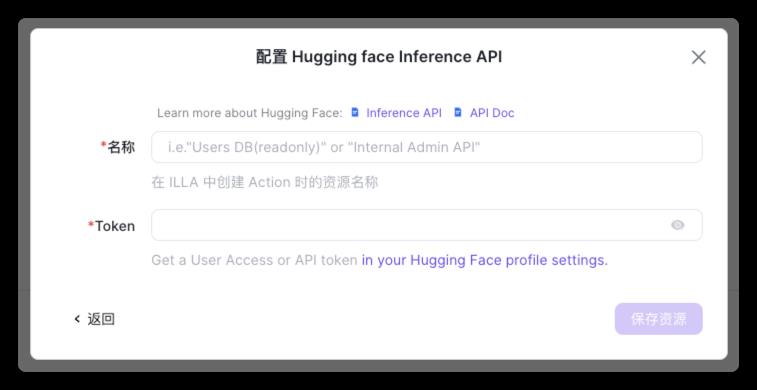

通过完成下述表单,配置 Hugging Face 资源:

名称: 由你自定义的该资源在 ILLA Cloud 中显示的名称;

Token: 注册并登录 Hugging Face,点击右上角头像,通过 Profile Settings 下的 Access Tokens 页面获取

https://hf.co/settings/tokens

接下来我们配置 Action。首先是确认 Hugging Face 中模型的连接信息,你需要前往 Hugging Face Hub 页面,按需选择模型:

https://hf.co/models

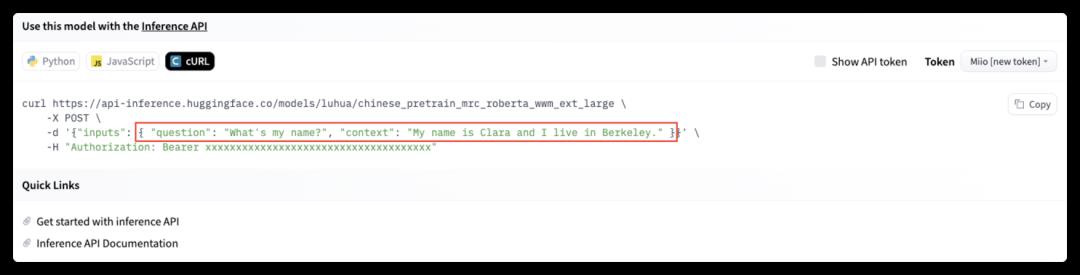

本文我们以 luhua/chinese_pretrain_mrc_roberta_wwm_ext_large 模型为例,进入模型的详情页,点击右上方 Deploy,并选择 Inference API:

https://hf.co/luhua/chinese_pretrain_mrc_roberta_wwm_ext_large

这里在 inputs 参数后面的内容,就是你需要在 ILLA Cloud 中配置的参数内容:

接下来回到 ILLA Cloud 的 Action 配置,需要填入 Model ID 和 Parameter。对于上图的 Model 输入是多个键值对的场景,我们提供了键值对输入和 JSON 输入两种方式,如下图:

此外,ILLA Cloud 还支持输入文本和二进制文件,能够满足 Hugging Face 中现存模型的需求。

3. 步骤3 连接 Action 和组件

将用户前端输入传给 API 的需求: 使用 获取组件里输入的数据,如 input2 组件用于输入 question、input1 组件用于输入 context,只需要在 Action 中这两个参数值的位置,填入相关信息即可。下面是使用 JSON 的示例代码:

"question": input2.value,"context": input1.value接下来,我们要在前端组件中展示 Action 的输出数据。

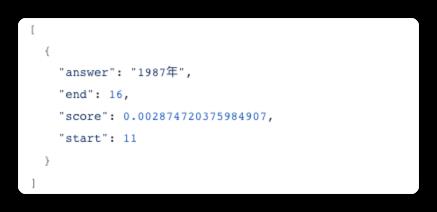

我们需要确认不同模型的输出放在哪个字段,仍以 luhua/chinese_pretrain_mrc_roberta_wwm_ext_large 模型为例,运行结果如下:

因此这里我们可以用 textQuestion.data[0].answer 来获取答案 (其中,textQuestion 是 Action 的名称),将 textQuestion.data[0].answer 填入用于展示结果的组件的属性配置即可:

▍大功告成!

以上就是使用 ILLA Cloud 集成 Hugging Face 上的模型快速构建一个智能问答机器人的应用界面。在公司内部使用的场景下,还可以通过类似的模型解决很多具体场景的问题,比如内部资料通过模型训练之后的问答客服,随着不同的内容输入,也可以应用在更多场景。另外,Hungging Face 上还有很多有趣的模型,通过 ILLA Cloud 的调用可以快速地实现一些有趣的功能,比如在极短的时间构建类似 Lite 版本的 ChatGPT 或者图像生成内容的应用等。

即刻体验 ILLA Cloud:

https://github.com/illacloud/illa-builder

更多关于 Hugging Face 平台的信息,欢迎关注 Hugging Face 官方微信公众号了解:

以上是关于官宣:Hugging Face x ILLA Cloud 深度合作的主要内容,如果未能解决你的问题,请参考以下文章