使用Python,OpenCV进行银行支票数字和符号的OCR

Posted 程序媛一枚~

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了使用Python,OpenCV进行银行支票数字和符号的OCR相关的知识,希望对你有一定的参考价值。

使用Python,OpenCV进行银行支票数字和符号的OCR(第一部分)

上一篇介绍了:使用Pyhton,OpenCV进行卡类型及16位卡号数字的OCR,这一篇将介绍如何使用Python,OpenCV从支票图像中提取OCR银行账户和路由号码(数字和符号)。

OCR银行支票比OCR信用卡更难——这主要是因为银行支票符号由多个部分组成。因此不能假设参考字体图像中的每个轮廓都映射到单个字符。

相反需要额外的逻辑来检查每个轮廓的尺寸,并确定检测到的是数字还是符号。

在找到符号的情况下,需要抓取下两个轮廓来构建边界框(因为银行支票控件字符由三个不同的部分组成)。

1. 效果图

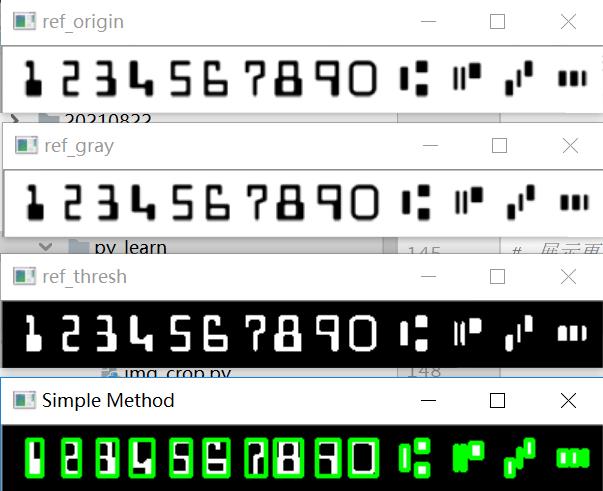

MICR E-13B字符集简单提取过程如下:原始图 VS 灰度图 VS 阈值化图 VS 简单提取效果图

可以看到符号区域虽然每个符号由3个轮廓组成,但也被展示为3个轮廓。下一步高级复杂提取则将符号区域的3个轮廓提取为一个。

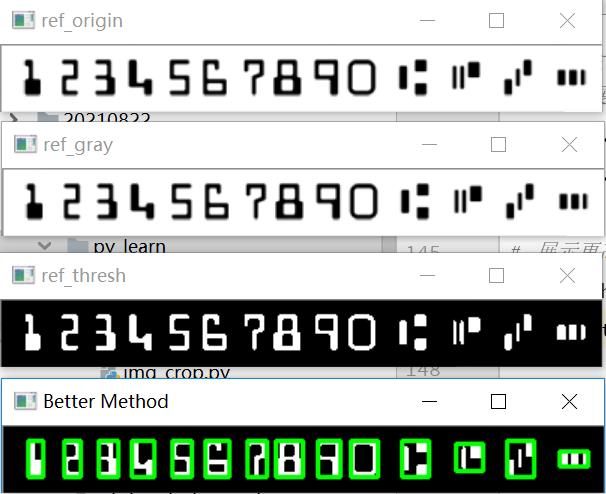

MICR E-13B字符集高级复杂提取效果如下:

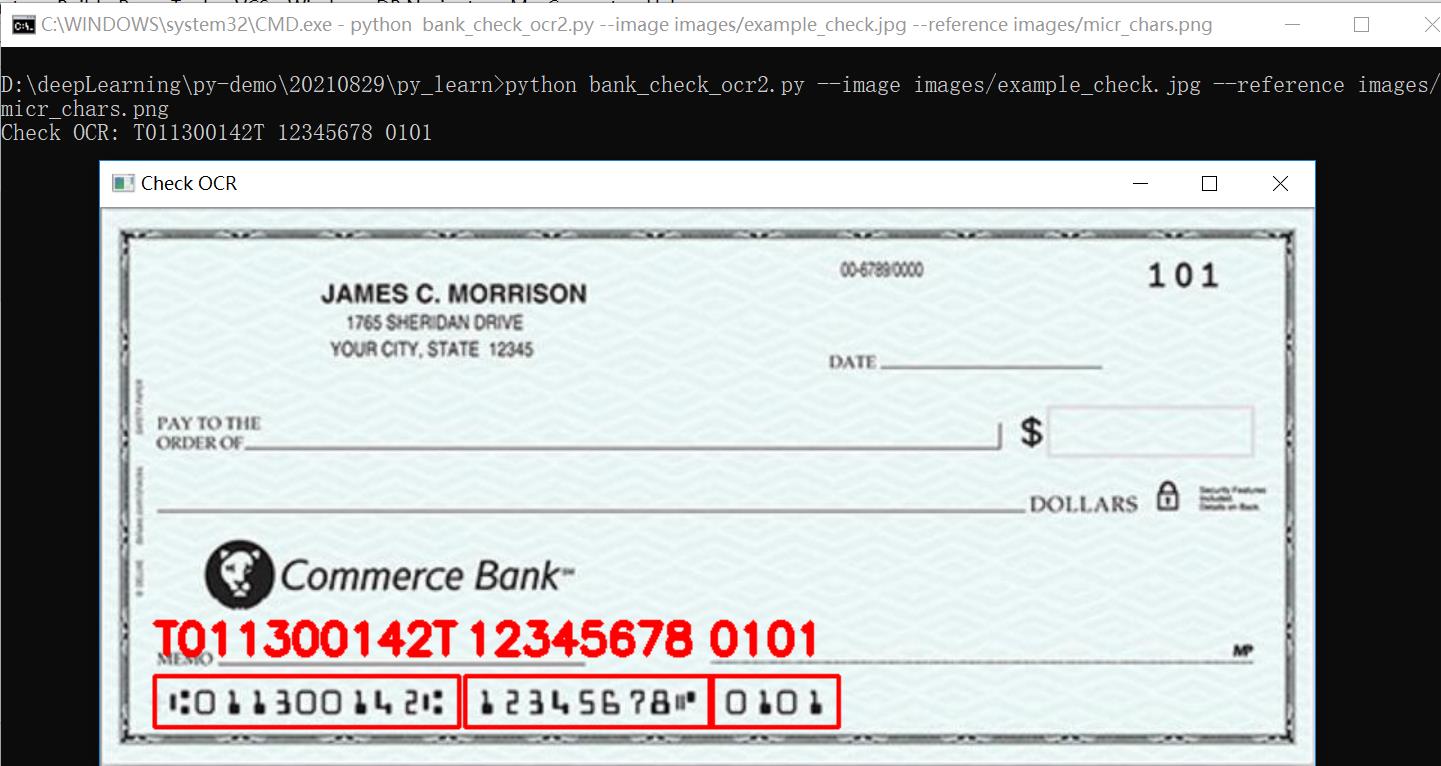

银行支票提取数字和符号OCR效果图如下:

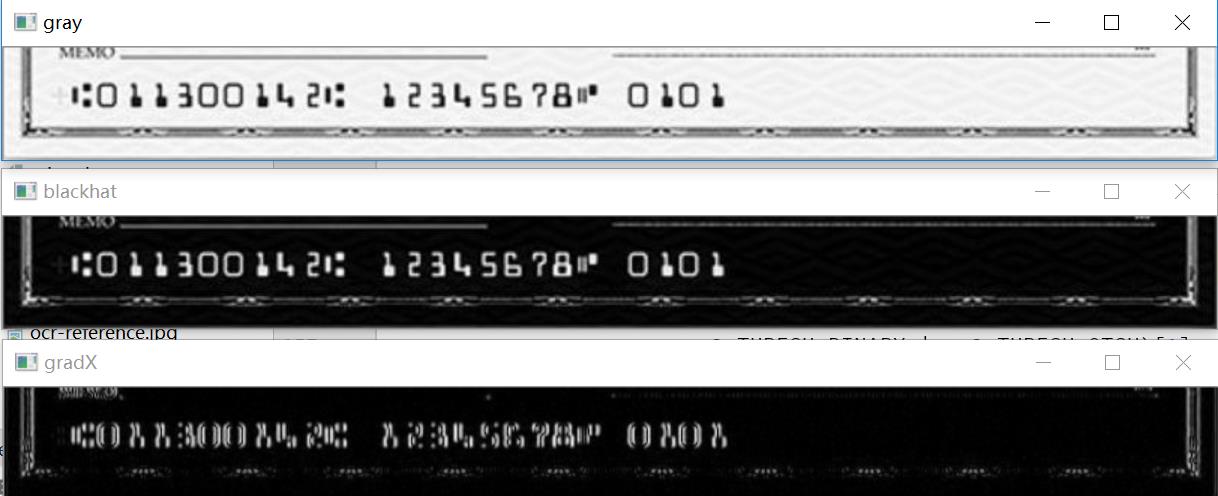

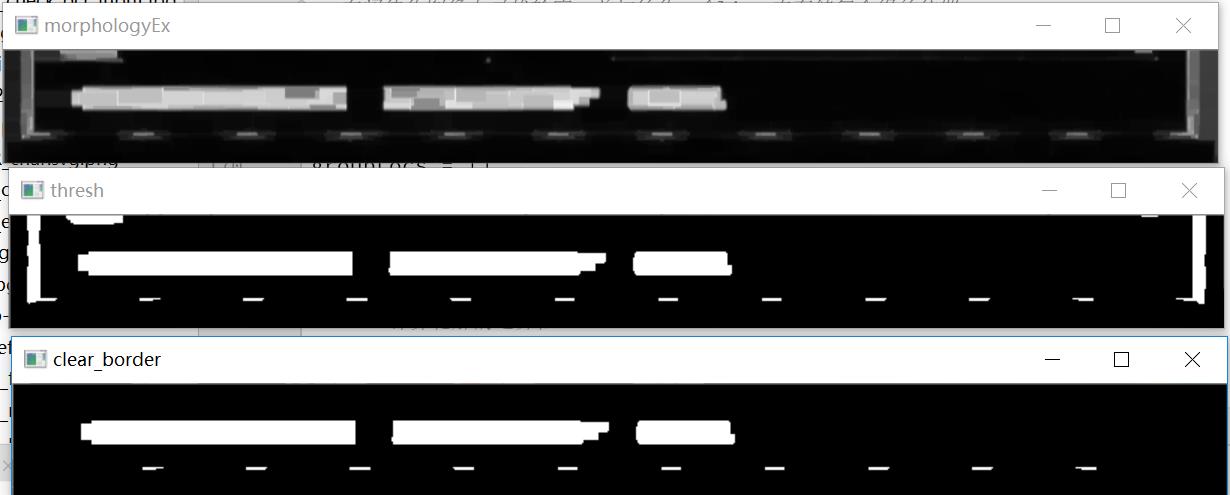

银行支票提取数字和符号OCR过程图如下:

原始图 VS 灰度图 VS 黑帽图 VS Scharr梯度图 VS

矩形内核形态学闭合图 VS Octus阈值化二值化图 VS 清除边界图

- 灰度图:忽略色彩的影响

- 黑帽图:在浅色背景下查找暗区域(明亮的背景下查找暗的区域——帐号部分)

- Scharr梯度图:了解颜色分布闭合部分缝隙

- 矩形内核形态学闭合图:闭合数字字符轮廓之间的小的缝隙

- Octus阈值化二值化图:将图像分为白色前景和黑色背景,便于轮廓提取

- 清除边界图:清除掉靠近边界的任何像素,很有效

- 轮廓过滤:根据轮廓的面积和宽高比过滤掉无效的轮廓

2. 原理

2.1 MICR E-13B字体

MICR(Magnetic Ink Character Recognition 磁性墨水字符识别)是一种用于处理文档的金融行业技术。您经常会在对账单和支票的底部发现这种E-13B格式的磁性墨水。

银行支票上的数字是MICR E-13B字体,如下图包括类似font-a字体,0~9的10个数字,及后边的4个符号区,共14个字符。

- 数字:数字0-9

- ⑆ :中转银行分行分隔符

- ⑇ :金额,交易金额分隔符

- ⑈ :客户帐号分隔符

- ⑉ :破折号:数字分隔符

2.2 从MICR E-13B参考图像中提取数字和符号

将使用OpenCV轮廓和一点Python迭代器切片“魔法”来实现提取。

数字区相对容易一些,一个数字一个轮廓。然而每个符号包含3个轮廓。

3. 源码

3.1 MICR E-13B符号和数字提取

# 银行支票(从MICR字体中提取数字和符号提取)

# MICR(Magnetic Ink Character Recognition 磁性墨水字符识别)是一种用于处理文档的金融行业技术。

# 经常会在对账单和支票的底部发现这种E-13B格式的磁性墨水。

# USAGE

# python bank_check_ocr.py --image images/example_check.jpg --reference images/micr_chars.png

# 导入必要的包

from skimage.segmentation import clear_border # pip install -U scikit-image

from imutils import contours # pip install --upgrade imutils

import numpy as np # pip install numpy

import argparse

import imutils

import cv2

# 从MICR中提取数字和符号

# image: MICR E-13B字体图像(在代码下载中提供)。

# charCnts:包含参考图像中字符轮廓的列表

# minW:表示最小字符宽度的可选参数。这有助于当遇到2或3个小轮廓时,它们一起构成一个MICR字符。默认值为5像素的宽度。

# minH:最小字符高度。此参数是可选的,默认值为15像素。rational的用法与minW相同

def extract_digits_and_symbols(image, charCnts, minW=5, minH=15):

# 获取字符轮廓列表的内置Python迭代器

# 并分别初始化存放ROI和位置的列表

charIter = charCnts.__iter__()

rois = []

locs = []

# Python迭代器没有Java等语言中的“hasNext”方法——相反,当iterable对象中没有更多项时,Python将抛出异常。

# 因此在函数中使用try-catch块来解释此异常。

# 保持遍历字符轮廓,知道到达list末尾

while True:

try:

# 从list获取下一个字符轮廓,计算边界框,初始化ROI

c = next(charIter)

(cX, cY, cW, cH) = cv2.boundingRect(c)

roi = None

# 检查是否边界框宽度、高度足够大,代表着其是否是数字,还是需要合并3个轮廓为1个的符号区

if cW >= minW and cH >= minH:

# 提取ROI

roi = image[cY:cY + cH, cX:cX + cW]

rois.append(roi)

locs.append((cX, cY, cX + cW, cY + cH))

# 反之,认为其是符号区的特殊符号之一(需要3个合并一个的部分)

# MICR符号区包含3部分,需要合并

else:

# 从迭代器提取接下来的俩部分,然后计算边界框

parts = [c, next(charIter), next(charIter)]

(sXA, sYA, sXB, sYB) = (np.inf, np.inf, -np.inf,

-np.inf)

# 遍历每一部分

for p in parts:

# 计算每一部分的边界框,并更新纪薄变量

(pX, pY, pW, pH) = cv2.boundingRect(p)

sXA = min(sXA, pX)

sYA = min(sYA, pY)

sXB = max(sXB, pX + pW)

sYB = max(sYB, pY + pH)

# 提取ROI

roi = image[sYA:sYB, sXA:sXB]

rois.append(roi)

locs.append((sXA, sYA, sXB, sYB))

# 优雅的退出循环

except StopIteration:

break

# 返回区域rois和位置locs的元祖

return (rois, locs)

# 构建命令行参数及解析

# --image:输入图像路径

# --reference: MICR E-13B字体参考图像

ap = argparse.ArgumentParser()

ap.add_argument("-i", "--image", required=True,

help="path to input image")

ap.add_argument("-r", "--reference", required=True,

help="path to reference MICR E-13B font")

args = vars(ap.parse_args())

# 为每个字符和符号创建参考字符名称list,和它们在图片中出现的顺序一样

# T = Transit 划界银行分行路由中转

# U = On-us 界定客户账号

# A = Amount 界定交易金额

# D = Dash 分隔数字的各个部分,如路由或帐户

# 由于OpenCV不支持unicode绘图字符,需要定义“T”表示传输,“U”表示客户帐号,“A”表示数量,“D”表示破折号。

charNames = ["1", "2", "3", "4", "5", "6", "7", "8", "9", "0",

"T", "U", "A", "D"]

# 从磁盘加载MICR字体图像,并进行预处理(转换灰度图、保持宽高比缩放为宽度400、Octus二值化逆阈值化)以保证该图像以白色前景和黑色背景呈现,便于轮廓提取

ref = cv2.imread(args["reference"])

ref = cv2.cvtColor(ref, cv2.COLOR_BGR2GRAY)

ref = imutils.resize(ref, width=400)

ref = cv2.threshold(ref, 0, 255, cv2.THRESH_BINARY_INV |

cv2.THRESH_OTSU)[1]

# 从MICR图像查找字符的轮廓线,并从左到右排序轮廓

refCnts = cv2.findContours(ref.copy(), cv2.RETR_EXTERNAL,

cv2.CHAIN_APPROX_SIMPLE)

# 注意:OpenCV 2.4、3和4返回的轮廓不同,因此下一行代码来兼容不同版本及返回值

refCnts = imutils.grab_contours(refCnts)

refCnts = contours.sort_contours(refCnts, method="left-to-right")[0]

# 复制一个原始图像

clone = np.dstack([ref.copy()] * 3)

# 遍历排序过的轮廓

for c in refCnts:

# 计算边界框,并绘制边界框绿色在图像上

(x, y, w, h) = cv2.boundingRect(c)

cv2.rectangle(clone, (x, y), (x + w, y + h), (0, 255, 0), 2)

# 展示应用简单轮廓方法的结果

cv2.imshow("Simple Method", clone)

cv2.waitKey(0)

# 使用更高级的方法:从轮廓列表中提取数字和符号,然后初始化一个字典来匹配字符名称和ROI

(refROIs, refLocs) = extract_digits_and_symbols(ref, refCnts,

minW=10, minH=20)

chars = {}

# 重新初始化克隆图像以便于绘制轮廓

clone = np.dstack([ref.copy()] * 3)

# 遍历参考list的名称、区域及位置

for (name, roi, loc) in zip(charNames, refROIs, refLocs):

# 在输出图像上绘制字符边界框

(xA, yA, xB, yB) = loc

cv2.rectangle(clone, (xA, yA), (xB, yB), (0, 255, 0), 2)

# 缩放ROI区域为固定大小36*36,然后更新匹配字符名称和ROI图像的字典

roi = cv2.resize(roi, (36, 36))

chars[name] = roi

# 展示字符ROI到屏幕

cv2.imshow("Char", roi)

cv2.waitKey(0)

# 展示更高级方法提取的效果图

cv2.imshow("Better Method", clone)

cv2.waitKey(0)

3.2 银行支票数字和符号OCR

# 银行支票(从MICR字体中提取数字和符号提取)

# MICR(Magnetic Ink Character Recognition 磁性墨水字符识别)是一种用于处理文档的金融行业技术。

# 经常会在对账单和支票的底部发现这种E-13B格式的磁性墨水。

# USAGE

# python bank_check_ocr2.py --image images/example_check.jpg --reference images/micr_chars.png

import argparse

import cv2

import imutils

import numpy as np # pip install numpy

# 导入必要的包

from imutils import contours # pip install --upgrade imutils

from skimage.segmentation import clear_border # pip install -U scikit-image

# 从MICR中提取数字和符号(根据轮廓查找和定位数字和符号)

# image: MICR E-13B字体图像(在代码下载中提供)。

# charCnts:包含参考图像中字符轮廓的列表

# minW:表示最小字符宽度的可选参数。这有助于当遇到2或3个小轮廓时,它们一起构成一个MICR字符。默认值为5像素的宽度。

# minH:最小字符高度。此参数是可选的,默认值为15像素。rational的用法与minW相同

def extract_digits_and_symbols(image, charCnts, minW=5, minH=15):

# 获取字符轮廓列表的内置Python迭代器

# 并分别初始化存放ROI和位置的列表

charIter = charCnts.__iter__()

rois = []

locs = []

# Python迭代器没有Java等语言中的“hasNext”方法——相反,当iterable对象中没有更多项时,Python将抛出异常。

# 因此在函数中使用try-catch块来解释此异常。

# 保持遍历字符轮廓,知道到达list末尾

while True:

try:

# 从list获取下一个字符轮廓,计算边界框,初始化ROI

c = next(charIter)

(cX, cY, cW, cH) = cv2.boundingRect(c)

roi = None

# 检查是否边界框宽度、高度足够大,代表着其是否是数字,还是需要合并3个轮廓为1个的符号区

if cW >= minW and cH >= minH:

# 提取ROI

roi = image[cY:cY + cH, cX:cX + cW]

rois.append(roi)

locs.append((cX, cY, cX + cW, cY + cH))

# 反之,认为其是符号区的特殊符号之一(需要3个合并一个的部分)

# MICR符号区包含3部分,需要合并

else:

# 从迭代器提取接下来的俩部分,然后计算边界框

parts = [c, next(charIter), next(charIter)]

(sXA, sYA, sXB, sYB) = (np.inf, np.inf, -np.inf,

-np.inf)

# 遍历每一部分

for p in parts:

# 计算每一部分的边界框,并更新纪薄变量

(pX, pY, pW, pH) = cv2.boundingRect(p)

sXA = min(sXA, pX)

sYA = min(sYA, pY)

sXB = max(sXB, pX + pW)

sYB = max(sYB, pY + pH)

# 提取ROI

roi = image[sYA:sYB, sXA:sXB]

rois.append(roi)

locs.append((sXA, sYA, sXB, sYB))

# 捕获停止迭代异常,以优雅的退出循环

except StopIteration:

break

# 返回区域rois和位置locs的元祖

return (rois, locs)

# 构建命令行参数及解析

# --image:输入图像路径

# --reference: MICR E-13B字体参考图像

ap = argparse.ArgumentParser()

ap.add_argument("-i", "--image", required=True,

help="path to input image")

ap.add_argument("-r", "--reference", required=True,

help="path to reference MICR E-13B font")

args = vars(ap.parse_args())

# 为每个字符和符号创建参考字符名称list,和它们在图片中出现的顺序一样

# T = Transit 划界银行分行路由中转

# U = On-us 界定客户账号

# A = Amount 界定交易金额

# D = Dash 分隔数字的各个部分,如路由或帐户

# 由于OpenCV不支持unicode绘图字符,需要定义“T”表示传输,“U”表示客户帐号,“A”表示数量,“D”表示破折号。

charNames = ["1", "2", "3", "4", "5", "6", "7", "8", "9", "0",

"T", "U", "A", "D"]

# 从磁盘加载MICR字体图像,并进行预处理(转换灰度图、保持宽高比缩放为宽度400、Octus二值化逆阈值化)以保证该图像以白色前景和黑色背景呈现,便于轮廓提取

ref = cv2.imread(args["reference"])

ref = imutils.resize(ref, width=400)

cv2.imshow("ref_origin", ref)

ref = cv2.cvtColor(ref, cv2.COLOR_BGR2GRAY)

cv2.imshow("ref_gray", ref)

ref = cv2.threshold(ref, 0, 255, cv2.THRESH_BINARY_INV |

cv2.THRESH_OTSU)[1]

cv2.imshow("ref_thresh", ref)

# 从MICR图像查找字符的轮廓线,并从左到右排序轮廓

refCnts = cv2.findContours(ref.copy(), cv2.RETR_EXTERNAL,

cv2.CHAIN_APPROX_SIMPLE)

# 注意:OpenCV 2.4、3和4返回的轮廓不同,因此下一行代码来兼容不同版本及返回值

refCnts = imutils.grab_contours(refCnts)

refCnts = contours.sort_contours(refCnts, method="left-to-right")[0]

# 使用更高级的方法:从轮廓列表中提取数字和符号,然后初始化一个字典来匹配字符名称和ROI

refROIs = extract_digits_and_symbols(ref, refCnts,

minW=10, minH=20)[0]

chars = {}

# 遍历参考list的名称、区域及位置

for (name, roi) in zip(charNames, refROIs):

# 缩放ROI区域为固定大小36*36,然后更新匹配字符名称和ROI图像的字典

roi = cv2.resize(roi, (36, 36))

chars[name] = roi

# 将实例化一个矩形内核,加载并提取包含帐号的check映像的底部20%:

# 初始化一个list来存储检查的OCR

# an empty list to store the output of the check OCR

rectKernel = cv2.getStructuringElement(cv2.MORPH_RECT, (17, 7))

output = []

# 加载输入图像,获取其维度,应用数组切片获取图像底部的20%(包含帐号信息的部分)

# 注意:如果支票被旋转过,看起来是颠倒的或垂直的,那么需要先添加逻辑来旋转它,在支票上应用自上而下的透视变换

image = cv2.imread(args["image"])

origin = image.copy()

# image = imutils.resize(image, width=700)

cv2.imshow("origin", image)

(h, w,) = image.shape[:2]

delta = int(h - (h * 0.2))

bottom = image[delta:h, 0:w]

# 转换底部图像为灰度图像,并应用黑帽形态学操作以在浅色背景下查找暗区域(明亮的背景下查找暗的区域——帐号部分)

gray = cv2.cvtColor(bottom, cv2.COLOR_BGR2GRAY)

cv2.imshow("gray", gray)

blackhat = cv2.morphologyEx(gray, cv2.MORPH_BLACKHAT, rectKernel)

cv2.imshow("blackhat", blackhat)

# 计算黑帽图像在x方向上的Scharr梯度,缩放范围为[0,255]

gradX = cv2.Sobel(blackhat, ddepth=cv2.CV_32F, dx=1, dy=0,

ksize=-1)

gradX = np.absolute(gradX)

(minVal, maxVal) = (np.min(gradX), np.max(gradX))

gradX = (255 * ((gradX - minVal) / (maxVal - minVal)))

gradX = gradX.astype("uint8")

cv2.imshow("gradX", gradX)

# 进一步缩小字符之间的间距并对图像进行二值化:

# 应用矩形内核形态学闭合操作以帮助闭合字符之间的缝隙,然后应用Octus阈值化方法二值化图像

gradX = cv2.morphologyEx(gradX, cv2.MORPH_CLOSE, rectKernel)

cv2.imshow("morphologyEx", gradX)

thresh = cv2.threshold(gradX, 0, 255,

cv2.THRESH_BINARY | cv2.THRESH_OTSU)[1]

cv2.imshow("thresh", thresh)

# 在预处理检查图像时,形态学+阈值操作无疑会留下“假阳性”检测区域————可以应用一些额外的处理来帮助删除这些操作:

# 移除图像边界像素来简单地清除边界;结果很微妙,但非常有用:

thresh = clear_border(thresh)

cv2.imshow("clear_border", thresh)

# 在支票上清楚地找到了三组数字。但是如何实际提取每个单独的组?

# 在阈值化图像上寻找轮廓,并初始化一个list来存储每个组的位置

groupCnts = cv2.findContours(thresh.copy(), cv2.RETR_EXTERNAL,

cv2.CHAIN_APPROX_SIMPLE)

groupCnts = imutils.grab_contours(groupCnts)

groupLocs = []

# 遍历每组的轮廓

for (i, c) in enumerate(groupCnts):

# 计算轮廓的边界框

(x, y, w, h) = cv2.boundingRect(c)

# 仅当ROI轮廓足够大的时候,认为其是合法的组轮廓

if w > 50 and h > 15:

groupLocs.append((x, y, w, h))

cv2.rectangle(thresh, (x, y), (x + w, y + h), (255, 255, 0<以上是关于使用Python,OpenCV进行银行支票数字和符号的OCR的主要内容,如果未能解决你的问题,请参考以下文章