中国首次!2021年图计算挑战赛揭榜,华中科技大团队夺冠

Posted 人工智能博士

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了中国首次!2021年图计算挑战赛揭榜,华中科技大团队夺冠相关的知识,希望对你有一定的参考价值。

点上方人工智能算法与Python大数据获取更多干货

在右上方 ··· 设为星标 ★,第一时间获取资源

仅做学术分享,如有侵权,联系删除

转载于 :新智元

喜讯喜讯!

8月13日,2021年图计算挑战赛GraphChallenge比赛结果揭晓:

华中科技大学图计算团队获得全球冠军!

这是国内团队在该赛事中首次夺冠!

作为图计算领域最具影响力的国际赛事之一,华中科技大团队此次夺冠,标志着我国在图计算领域的研发水平位于国际前列。

赛事地址:https://graphchallenge.mit.edu/challenges

此次比赛吸引了赛灵思、英伟达、劳伦斯利弗莫尔国家实验室、弗吉尼亚理工大学、伊利诺伊大学厄巴纳-香槟分校等国际知名科技研院所参赛。

最终,华中科技大学团队、美国乔治华盛顿大学与马里兰大学的联合队伍两支参赛团队获得冠军。

此外,华中科技大学的另一支队伍也获得了本次GraphChallenge 2021的创新奖。

Graph Challenge 2021

图(Graph)是一种用来建模事物之间关系的一种数据结构。

图可以应用于生产生活中的各个领域,从社交媒体、网页排序到自然语言处理、以及人工智能,都可以用图来表示。

但由于图结构的不规则性,这些应用很难得到快速处理。

图计算也因此成为了大数据和人工智能时代的核心挑战。

GraphChallenge结合了GraphAnalysis、Graph500、FireHose、MiniTri和GraphBLAS等开创性工作中的优点,并由此创造出了一套新的挑战。

从2017年开始,该赛事至今已成功举办五届,成为图计算领域最具影响力的国际赛事之一。

比赛由IEEE、麻省理工大学、亚马逊公司联合主办

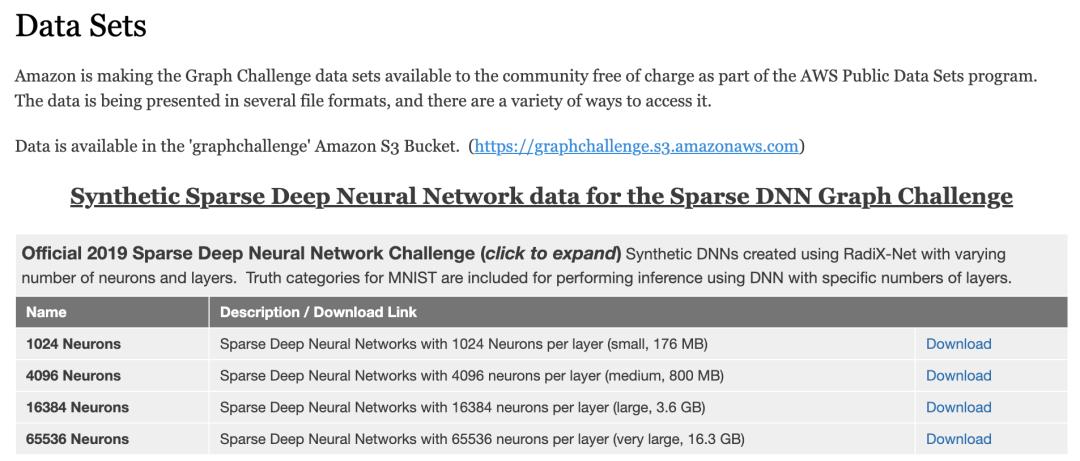

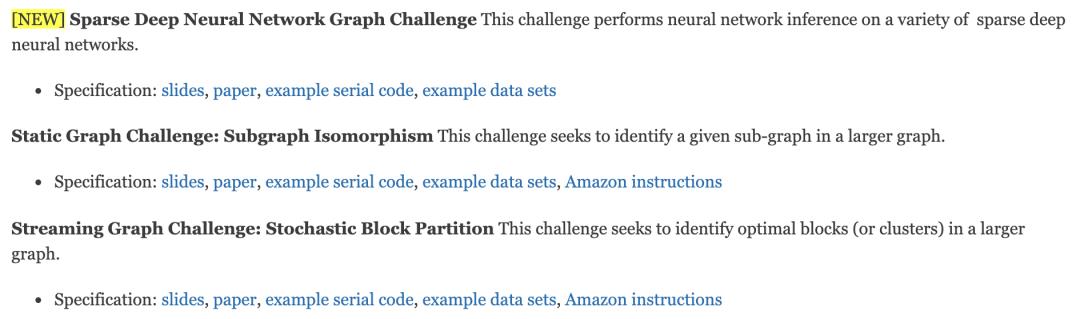

在GraphChallenge 2021中,参赛选手需要在给定的图应用上比拼处理速度。

比赛分为三个赛道:静态图匹配、动态图划分和稀疏神经网络推理,也分别代表了图计算的不同典型应用场景。

往届冠军基本被美国知名科技研单位包揽,如英伟达和劳伦斯利弗莫尔国家实验室。

而卡内基梅隆大学、UIUC则分别获得过2019年和2020年的大赛冠军。

除了冠军外,还会进行创新奖、荣誉奖等多个奖项的评选。

GraphChallenge 2021评选出的其它奖项

夺冠论文

深度神经网络(DNN)模型规模的不断扩大,可扩展性也逐渐受到影响。

稀疏深度神经网络(SpDNN)虽然有望解决这个问题,但由于负载不平衡和不规则的内存访问,稀疏的数据难以在GPU上有效执行。

因此,作者提出了疏散感知的SpMM算法,可以系统地探索SpDNN在GPU上执行的性能最优方案,并进一步生成优化的SpMM内核实现。

项目地址:https://github.com/CGCL-codes/Graphchallenge21

与2020年HPEC稀疏DNN挑战赛冠军相比,论文的方法在单个NVIDIA V100 GPU上实现了每秒55.6 TeraEdges的推理吞吐量,将速度提高了13.74倍和22.29倍。

此外,比起2020年冠军使用768个GPU的方法,论文提出的方法在很多情况下仅用4个GPU就能实现更佳的性能。

方法实现

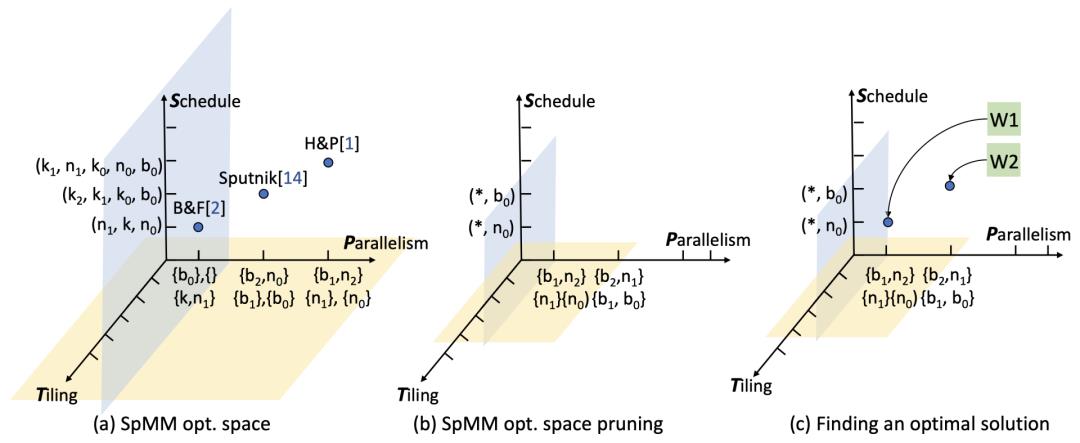

SpMM的基本实现可由三个循环构成:

其中,b-loop遍历矩阵中的不同batch,k-loop遍历输入神经元,而n-loop遍历输出神经元。

论文方法的工作流程,其中*代表通配符

(a) 用于SpDNN推理的改进的SpMM优化空间;

(b) 修剪后的SpMM优化空间;

(c) 为给定的权重矩阵(如W1和W2)搜索性能最优的解决方案。

性能分析

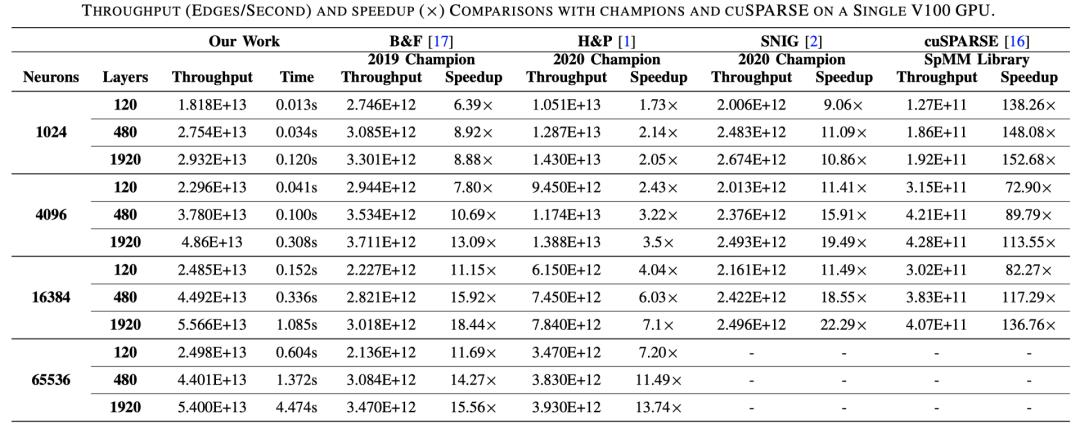

论文提出的方法实现了每秒11.8~55.6的推理吞吐量,且性能随着网络层的增加而增加。

单个V100 GPU与往年冠军的对比

与2020年冠军的最强性能方法H&F相比,论文提出的方法至少能将性能提升1.73倍,最多可以提升13.74倍。

与2019年的冠军B&F相比,论文的方法实现了6.39倍~15.56倍的性能提升。

此外,作者也与广泛使用的SpMM库cuSPARSE进行了比较,性能的提升达到72.90倍~152.68倍。

4个GPU与往年冠军的对比

在多个GPU的比较上,论文的方法只需采用4个GPU,就能比最多使用16个V100 GPU的B&F性能提升4.56倍~10.18倍。

与同样可以采用4个GPU的SNIG相比,实现了18.73倍~32.73倍的性能提升。

论文的方法同样优于H&P在不同GPU数量上的实现,甚至在很多情况下比采用768个GPU的H&P性能更强,尤其是对于大型网络来说。

半年备赛,夺得全球冠军

华中科技大学参赛团队主要成员为硕士生辛杰(左上)和叶先祺(中下),由郑龙副教授指导,其他成员包括博士生王庆刚、黄禹、姚鹏程,老师余林琛、廖小飞、金海。

本次大赛夺冠团队从去年年底开始备赛,参赛赛道为稀疏神经网络推理,为加速人工智能应用提供新方案。

这个赛道的任务是将神经网络的权重数据抽象为图数据,执行推理任务,是人工智能领域的典型应用场景。

参赛过程中,团队获得了服务计算技术与系统教育部重点实验室和「面向图计算的通用计算机技术与系统」国家重点研发计划项目组的大力支持。

实验室为团队提供了V100 GPU多卡服务器作为计算平台,确保团队有一个稳定的开发环境。

团队参赛队员每周都会和图计算项目组的博士生王庆刚、黄禹、姚鹏程等进行应用分析和方案论证。

多次讨论后,他们最终get到了这个赛道应用的特点:

不存在一种特定的实现方法可以在任何一个数据集上都取得较好的性能提升。

根据这个特点,参赛团队确定了通过用参数化的方式,构造算子的实现空间,然后进行参数搜索,取得对应数据集的最优实现方法。

在代码实现过程中,团队复用了图计算项目中图处理模块的思想,加快开发效率,快速完成了实验。

参考资料:

https://graphchallenge.mit.edu/champions

https://mp.weixin.qq.com/s/MeKOcCG-238R7m9f6pqApw

---------♥---------

声明:本内容来源网络,版权属于原作者

图片来源网络,不代表本公众号立场。如有侵权,联系删除

AI博士私人微信,还有少量空位

点个在看支持一下吧

以上是关于中国首次!2021年图计算挑战赛揭榜,华中科技大团队夺冠的主要内容,如果未能解决你的问题,请参考以下文章