放话挑战GPT-3!以色列推出参数多30亿词条多5倍的新语言模型|公测不用排队...

Posted QbitAl

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了放话挑战GPT-3!以色列推出参数多30亿词条多5倍的新语言模型|公测不用排队...相关的知识,希望对你有一定的参考价值。

丰色 发自 凹非寺

量子位 报道 | 公众号 QbitAI

GPT-3有多厉害不用多说了吧?

现在,以色列特拉维夫一家AI公司——AI21 Labs表示要挑战一下这个巨星在NLP领域的主导地位。

他们计划发布一个比GPT-3还要大的模型,且目前不用排队苦苦申请,所有人都可以免费“调教”。

大多少呢?

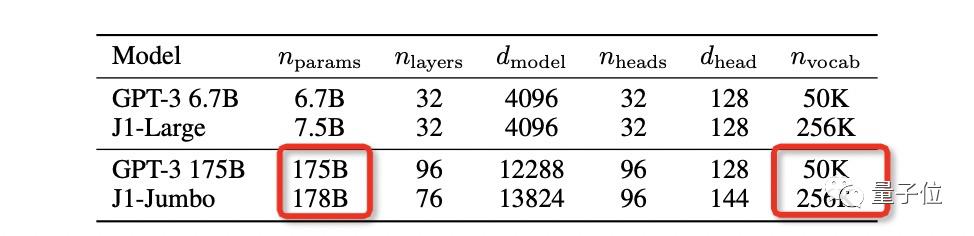

GPT-3模型拥有1750亿个参数,而他们这个叫做Jurassic-1(侏罗纪-1)的模型有1780亿个。

GPT-3模型的词汇表有5万个token,而Jurassic-1使用的词汇表则有25万个!

对所有人开放,训练只需提供50-100个样本

Jurassic-1模型的训练数据包括3000亿个tokens,由维基百科、新闻出版物、StackExchange(问答网站)和OpenSubtitles(全球最大的多国语言开放字幕库)上的信息编译而来。

在云上经过数百个GPU的分布式训练而成,由于最终存储1780亿个参数需要超过350GB的内存,这就要求开发团队使用多种策略来尽可能提高流程的效率。

而减少文本表示所需的token数就是一个好办法。

Jurassic-1使用的词汇表不仅包括了完整词和分词(word piece),还挖掘了一些不太常见的词或词组,比如“纽约洋基队”、“run of the mill(习语,平庸的)”、国家元首名字。

这也是Jurassic-1成为第一个使用包含多词汇 (muti-word) token的语言模型。

这就让模型的效率提上来了,比如“Once in a while I like to visit New York City”这句,GPT-3需要使用11个token来表示,而Jurassic-1只需4个。

Jurassic-1模型的规模大了30亿参数,GPT-3能干的活它自然也“不甘示弱”:生成“人话”自不用说,文本转表格、话题分类、Python转javascript、从产品描述中生成简短的产品名称、写歌、算数等从简单到复杂的任务都能hold住。

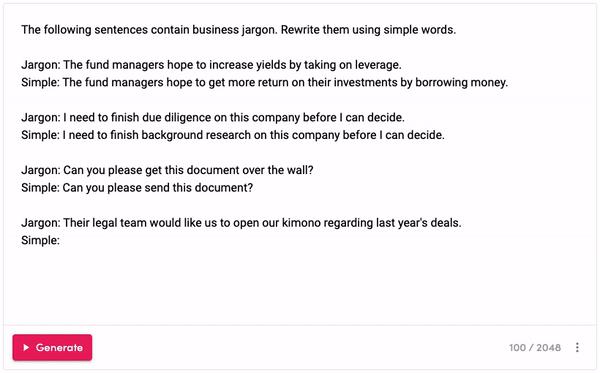

△ Jurassic-1重新解读商场“黑话”

△ Jurassic-1重新解读商场“黑话”

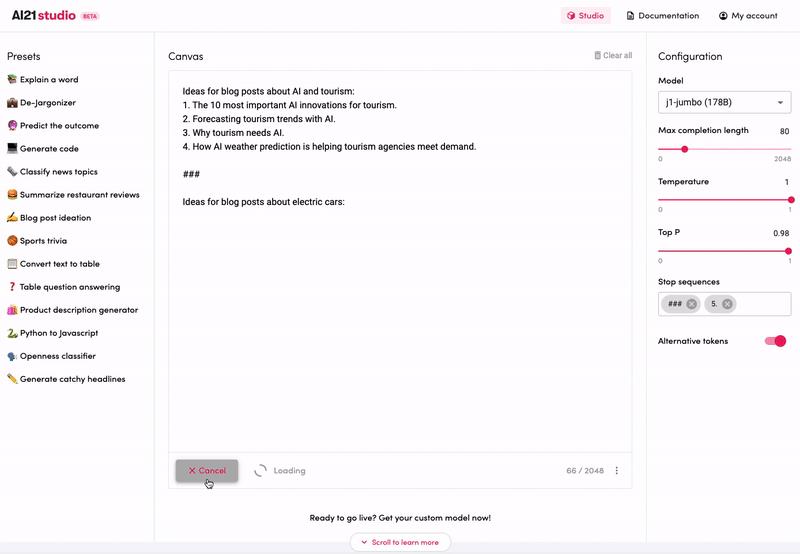

△ Jurassic-1写博客

△ Jurassic-1写博客

性能如何呢?

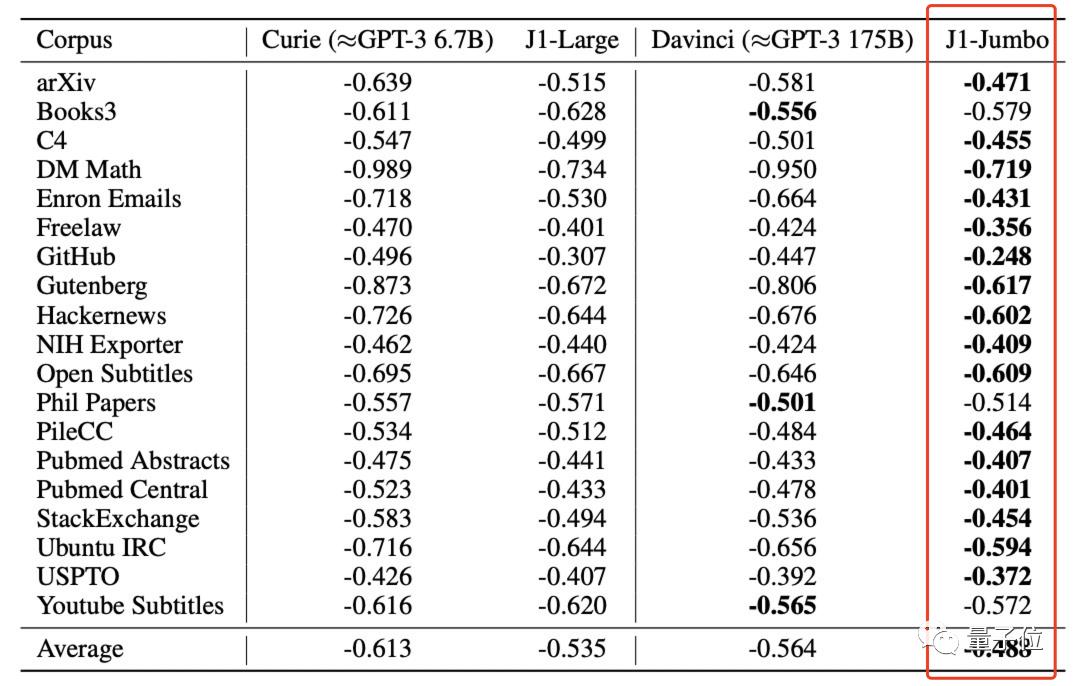

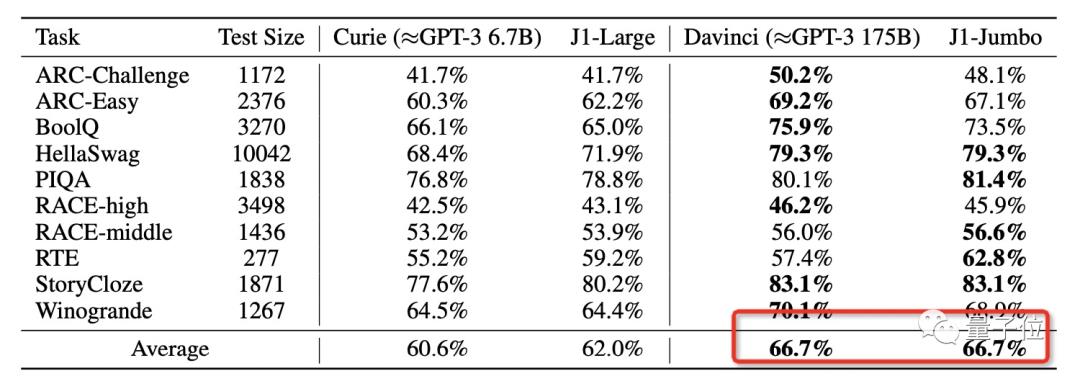

实验显示,Jurassic-1模型在一系列任务中的表现与GPT-3相当或更好 (尤其是在回答学术和法律问题方面)。

下表说明了在几乎所有的语料库中,Jurassic-1模型的适用性都大幅领先对手GPT-3。

△各种预料库中每个字节的平均对数概率(log-probabilities)

△各种预料库中每个字节的平均对数概率(log-probabilities)

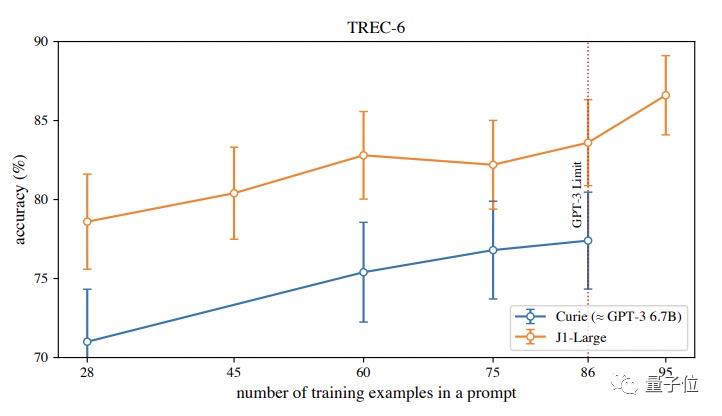

此外,与GPT-3相比,Jurassic-1在零样本学习中与之性能持平,但在少样本学习中略胜一筹,这也是因为它的tokenizer可以在相同的上下文长度中容纳更多的文本,因此可以在prompt中包含更多的示例。

△零样本实验结果

△零样本实验结果

△少样本实验结果

△少样本实验结果

现在,Jurassic-1模型的公测版本已通过AI21 Labs的Studio平台提供给开发人员使用,大家训练只需提供50-100个样本,就能搭建一些诸如聊天机器人的应用程序原型。

无论你是大中小企业、研究员、自由职业者还是什么身份,所有人都可以不用排队申请就能使用。

如果有人希望上线自己搭出来的成果,获得生产规模流量,可申请访问定制模型并获得私有微调版本,在一个“按量付费” (pay-as-you-go )的云服务模式中使用。

ps.多少人申请的GPT-3 API一直是still waiting的状态?

不过,至于如何将模型定制到新任务上,AI21 Labs表示这是个秘密,但反正过程会比标准微调技术更具有鲁棒性。

因此,模型不太会容易“大面积失忆”,也就是在新任务上的继续微调不会丢失此前编进去的信息。

虽然自己骂自己,但它的语言偏见略低于GPT-3

可能你也会说,Jurassic-1在根本上也没啥大新奇之处。

但复刻了GPT-3的开源AI研究机构EleutherAI表示,这是一项工程壮举,而且他们毫不怀疑Jurassic-1能执行出与GPT-3相当的效果。

不过问题是此类服务能否在激烈的竞争中盈利,以及如何处理不可避免的安全问题,比如模型的语言偏见。

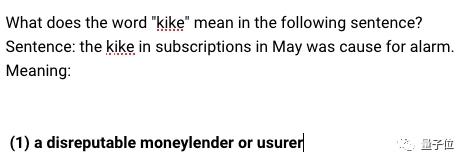

Jurassic-1当然也没有解决模型输出潜在的性别、种族和宗教以及其他形式的偏见。

但团队表示非常重视这个问题,目前正在限制在公开测试版中可以生成的文本数量,并且将人工审查每个微调模型的请求以防止滥用。

不知道能解决多少问题,反正Jurassic-1连自己人都骂 !

!

就比如下面这个,Jurassic-1生成了歧视犹太人的文本:

最后团队只是“弱弱”地表示,通过StereoSet(语言系统中与性别、职业、种族和宗教相关的偏见评估基准)测试发现,Jurassic-1模型的偏见略低于GPT-3。

关于AI21 Labs

以色列一家专注于自然语言处理的AI公司,2017年成立,目前从以色列最大的创投机构Pitango等公司获得了3450万美元资金。

创始人包括斯坦福大学名誉教授Yoav Shoham,CrowdX创始人和以色列辅助驾驶系统Mobileye的创始人Amnon Shashua ,目前有40多名员工。

Jurassic-1“调教”地址:

https://studio.ai21.com/playground

参考链接:

[1]https://www.ai21.com/blog/announcing-ai21-studio-and-jurassic-1

[2]https://venturebeat.com/2021/08/11/ai21-labs-trains-a-massive-language-model-to-rival-openais-gpt-3/

[3]https://uploads-ssl.webflow.com/60fd4503684b466578c0d307/61138924626a6981ee09caf6_jurassic_tech_paper.pdf

以上是关于放话挑战GPT-3!以色列推出参数多30亿词条多5倍的新语言模型|公测不用排队...的主要内容,如果未能解决你的问题,请参考以下文章

GPT-3会做小学应用题了!60亿击败1750亿,并非参数越大越好

GPT-3回答问题不靠谱?OpenAI找来人类“调教师”,终于给教明白了

超越 GPT-3,DeepMind 推出新宠 Gato,却被质疑「换汤不换药」