跟我读论文丨ACL2021 NER 模块化交互网络用于命名实体识别

Posted 华为云

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了跟我读论文丨ACL2021 NER 模块化交互网络用于命名实体识别相关的知识,希望对你有一定的参考价值。

摘要:本文是对ACL2021 NER 模块化交互网络用于命名实体识别这一论文工作进行初步解读。

本文分享自华为云社区《ACL2021 NER | 模块化交互网络用于命名实体识别》,作者: JuTzungKuei 。

论文: Li Fei, Wang Zheng, Hui Siu Cheung, Liao Lejian, Song Dandan, Xu Jing, He Guoxiu, Jia Meihuizi. Modularized Interaction Network for Named Entity Recognition [A]. Proceedings of the 59th Annual Meeting of the Association for Computational Linguistics and the 11th International Joint Conference on Natural Language Processing (Volume 1: Long Papers) [C]. Online: Association for Computational Linguistics, 2021, 200–209.

链接:https://aclanthology.org/2021.acl-long.17.pdf

代码:无

0、摘要

- 现有NER模型缺点

- 基于序列标注的NER模型:长实体识别不佳,只关注词级信息

- 基于分段的NER模型:处理分段,而非单个词,不能捕获分段中的词级依赖关系

- 边界检测和类型预测可以相互配合,两个子任务可共享信息,相互加强

- 提出模块化交互网络模型MIN(Modularized Interaction Network)

- 同时利用段级信息和词级依赖关系

- 结合一种交互机制,支持边界检测和类型预测之间的信息共享

- 三份基准数据集上达到SOTA

1、介绍

- NER:查找和分类命名实体,person (PER), location

(LOC) or organization (ORG),下游任务:关系抽取、实体链接、问题生成、共引解析 - 两类方法

- 序列标注 sequence labeling:可捕获词级依赖关系

- 分段 segment(a span of words):可处理长实体

- NER:检测实体边界和命名实体的类型,

- 分成两个子任务:边界检测、类型预测

- 两个任务之间是相关的,可以共享信息

- 举栗:xx来自纽约大学

- 如果知道大学是实体边界,更可能会预测类型是ORG

- 如果知道实体有个ORG类型,更可能会预测到“大学”边界

- 上述两个常用方法没有在子任务之间共享信息

- 序列标注:只把边界和类型当做标签

- 分段:先检测片段,再划分类型

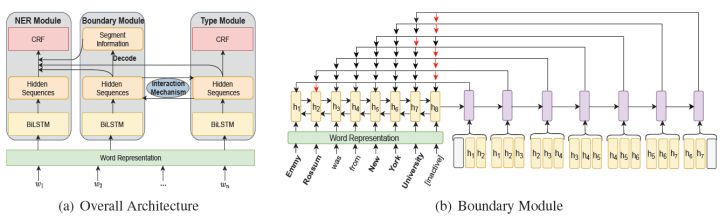

- 本文提出MIN模型:NER模块、边界模块、类型模块、交互机制

- 指针网络作为边界模块的解码器,捕捉每个词的段级信息

- 段级信息和词级信息结合输入到序列标注模型

- 将NER划分成两个任务:边界检测、类型预测,并使用不同的编码器

- 提出一个相互加强的交互机制,所有信息融合到NER模块

- 三个模块共享单词表示,采用多任务训练

- 主要贡献:

- 新模型:MIN,同时利用段级信息和词级依赖

- 边界检测和类型预测分成两个子任务,结合交互机制,使两个子任务信息共享

- 三份基准数据集达到SOTA

2、方法

- NER模块:RNN-BiLSTM-CRF,引用Neural architectures for named entity recognition

- 词表示:word(BERT) + char(BiLSTM)

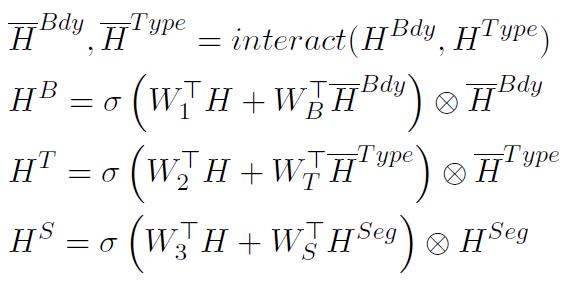

- BiLSTM编码:双向LSTM,交互机制代替直接级联,门控函数动态控制

最终NER输出:H^{NER}=W^T[H;H^B;H^T;H^S] + bHNER=WT[H;HB;HT;HS]+b

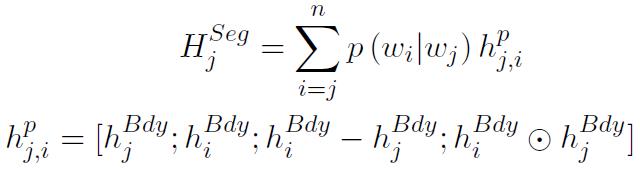

H^{Bdy}HBdy表示边界模块输出,H^{Type}HType表示类型模块输出,H^{Seg}HSeg表示分段信息

-

- CRF解码:转移概率 + 发射概率

- 边界模块:双向LSTM编码H^{Bdy}HBdy,单向LSTM解码

- 解码:

s_j=h_{j-1}^{Bdy}+h_{j}^{Bdy}+h_{j+1}^{Bdy}sj=hj−1Bdy+hjBdy+hj+1Bdy

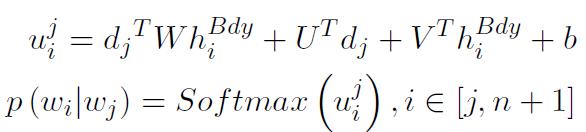

d_j=LSTM(s_j, d_{j-1})dj=LSTM(sj,dj−1) - Biaffine Attention机制:

- 解码:

- 类型模块:BiLSTM + CRF

- 交互机制:

- self attention 得到标签增强的边界H^{B-E}HB−E,类型H^{T-E}HT−E

- Biaffine Attention 计算得分 \\alpha^{B-E}αB−E

- 交互后的边界:r_i^{B-E}=\\sum_{j=1}^{n}\\alpha_{i,j}^{B-E}h_j^{T-E}riB−E=∑j=1nαi,jB−EhjT−E

- 更新后的边界:\\overline{h}_i^{Bdy}=[h_i^{B-E},r_i^{B-E}]hiBdy=[hiB−E,riB−E]

- 更新后的类型:\\overline{h}_i^{Type}=[h_i^{T-E},r_i^{T-E}]hiType=[hiT−E,riT−E]

- 联合训练:多任务

- 每个任务的损失函数

-

- 最终损失函数:\\mathcal{L}=\\mathcal{L}^{NER}+\\mathcal{L}^{Type}+\\mathcal{L}^{Bdy}L=LNER+LType+LBdy

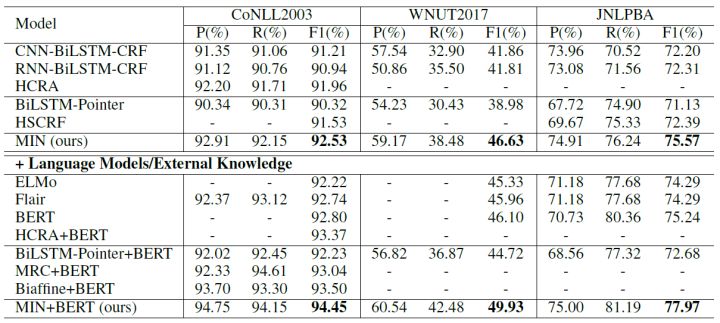

3、结果

- Baseline (sequence labeling-based)

- CNN-BiLSTM-CRF

- RNN-BiLSTM-CRF

- ELMo-BiLSTM-CRF

- Flair (char-BiLSTM-CRF)

- BERT-BiLSTM-CRF

- HCRA (CNN-BiLSTM-CRF)

- Baseline (segment-based)

- BiLSTM-Pointer

- HSCRF

- MRC+BERT

- Biaffine+BERT

号外号外:想了解更多的AI技术干货,欢迎上华为云的AI专区,目前有AI编程Python等六大实战营供大家免费学习。

以上是关于跟我读论文丨ACL2021 NER 模块化交互网络用于命名实体识别的主要内容,如果未能解决你的问题,请参考以下文章

跟我读论文丨Multi-Model Text Recognition Network

论文解读:ACL2021 NER | 基于模板的BART命名实体识别