K8S------Kubernetes单Master集群二进制搭建

Posted 下雨天的放羊娃

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了K8S------Kubernetes单Master集群二进制搭建相关的知识,希望对你有一定的参考价值。

目录

前言

常见的K8S按照部署方式

●Minikube

Minikube是一个工具,可以在本地快速运行一个单节点微型K8S,仅用于学习、预览K8S的一些特性使用。

部署地址: https://kubernetes. io/docs/setup/minikube

●Kubeadmin

Kubeadmin也是一一个:工具,提供kubeadm init和 kubeadm join,用于快速部署K8S集群,相对简单。

https://kubernetes. io/decs/referencel/setup-toels/kubeadm/kubeadm/

●二进制安装部署

生产首选,从官方下载发行版的二进制包,手动部署每个组件和自签TLS证书,组成K8S集群,新手推荐。

https: //github. com/kubernetes/kubernetes/releases

Kubernetes单Master节点集群二进制部署

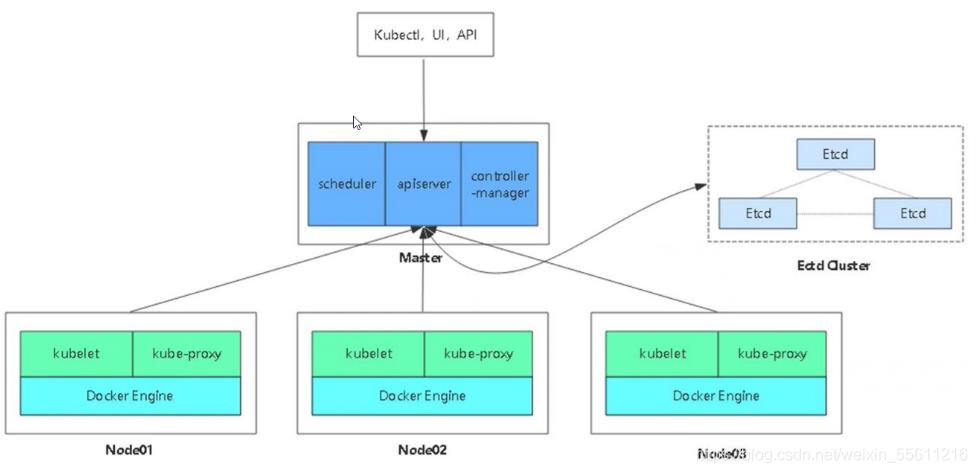

一.Kubernetes单Master集群架构

二.环境准备

| 节点 | 系统 | IP地址 | 服务 |

|---|---|---|---|

| K8S集群Master01 | CentOS 7 | 192.168.121.88 | kube-apiserver kube-controller-manager kube-scheduler etcd |

| K8S集群Node01 | CentOS 7 | 192.168.121.55 | kubelet kube-proxy docker flannel |

| K8S集群Node01 | CentOS 7 | 192.168.121.66 | kubelet kube-proxy docker flannel |

| Etcd集群节点01 | CentOS 7 | 192.168.121.55 | etcd |

| Etcd集群节点02 | CentOS 7 | 192.168.121.66 | etcd |

| Etcd集群节点03 | CentOS 7 | 192.168.121.88 | etcd |

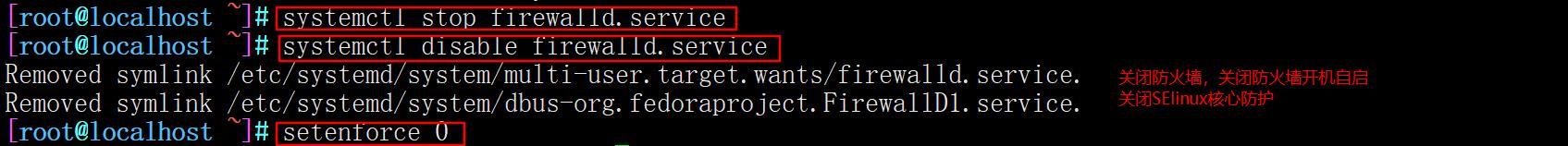

#所有节点操作

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

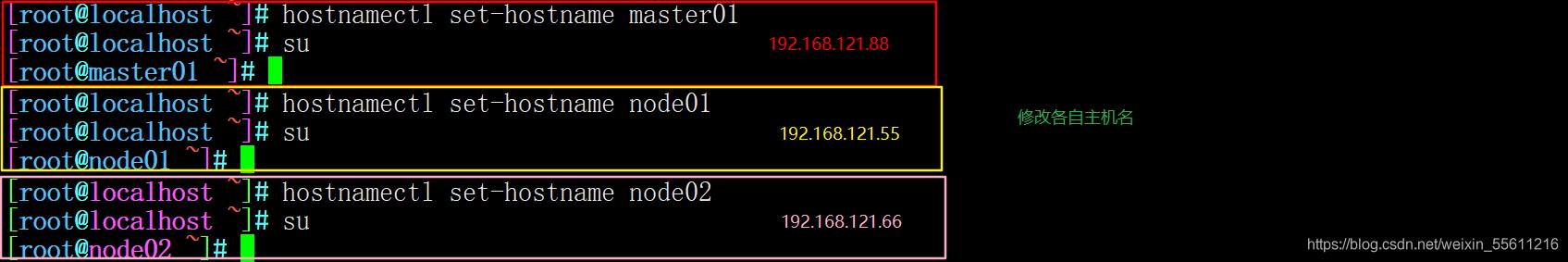

#Master节点操作 (192.168.121.88)

hostnamectl set-hostname master01

#Master节点操作(192.168.121.55)

hostnamectl set-hostname node01

#Master节点操作 (192.168.121.66)

hostnamectl set-hostname node02

三.Etcd集群部署

-----------------------部署etcd集群

etcd是Core0S团队于2013年6月发起的开源项目,它的目标是构建一个高可用的分布式键值(key-value) 数据库。etcd内部采用raft协议作为一致性算法,etcd是go语言编写的。

etcd作为服务发现系统,有以下的特点:

简单:安装配置简单,而且提供了HTTP API进行交互,使用也很简单

安全:支持SSL证书验证

快速:单实例支持每秒2k+读操作

可靠:采用raft算法,实现分布式系统数据的可用性和–致性

etcd目前默认使用2379端口提供HTTP API服务,2380端口和peer通信(这两个端口已经被IANA(互联网数字分配机构)官方预留给etcd)。

即etcd默认使用2379端口对外为客户端提供通讯,使用端口2380来进行服务器间内部通讯。

etcd在生产环境中一般推荐集群方式部署。由于etcd的leader选举机制,要求至少为3台或以上的奇数台。

1.准备签发证书环境

CFSSL是CloudFlare公司开源的一款PKI/TLS工具。CFSSL 包含一个命令行工具和一一个用于签名、验证和捆绑TLS证书的HTTP API服务。使用Go语言编写。

CFSSL使用配置文件生成证书,因此自签之前,需要生成它识别的json 格式的配置文件,CFSSL 提供了方便的命令行生成配置文件。

CFSSL用来为etcd提供TLS证书,它支持签三种类型的证书:

1、client 证书,服务端连接客户端时携带的证书,用于客户端验证服务端身份,如kube-apiserver 访问etcd;

2、server证书,客户端连接服务端时携带的证书,用于服务端验证客户端身份,如etcd对外提供服务;

3、peer证书,相互之间连接时使用的证书,如etcd节点之间进行验证和通信。

这里全部都使用同一套证书认证。

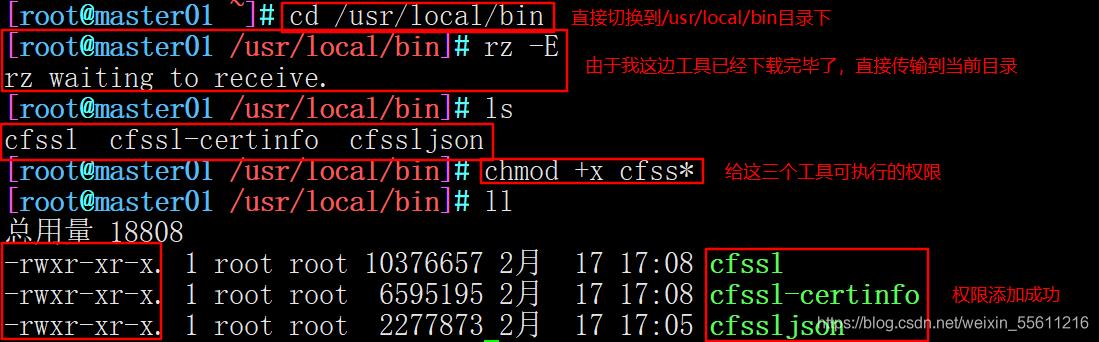

在master01 节点上操作

//下载证书制作工具

wget https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -O /usr/local/bin/cfssl

wget https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -O /usr/1ocal/bin/cfssljson

wget https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -O /usr/local/bin/cfssl-certinfo

或

curl -L https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -O /usr/ local/bin/cfssl

curl -L https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -O /usr/local/bin/cfssljson

curl -L https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -O /usr/local/bin/cfssl-certinfo

chmod +x /usr/local/bin/cfssl*

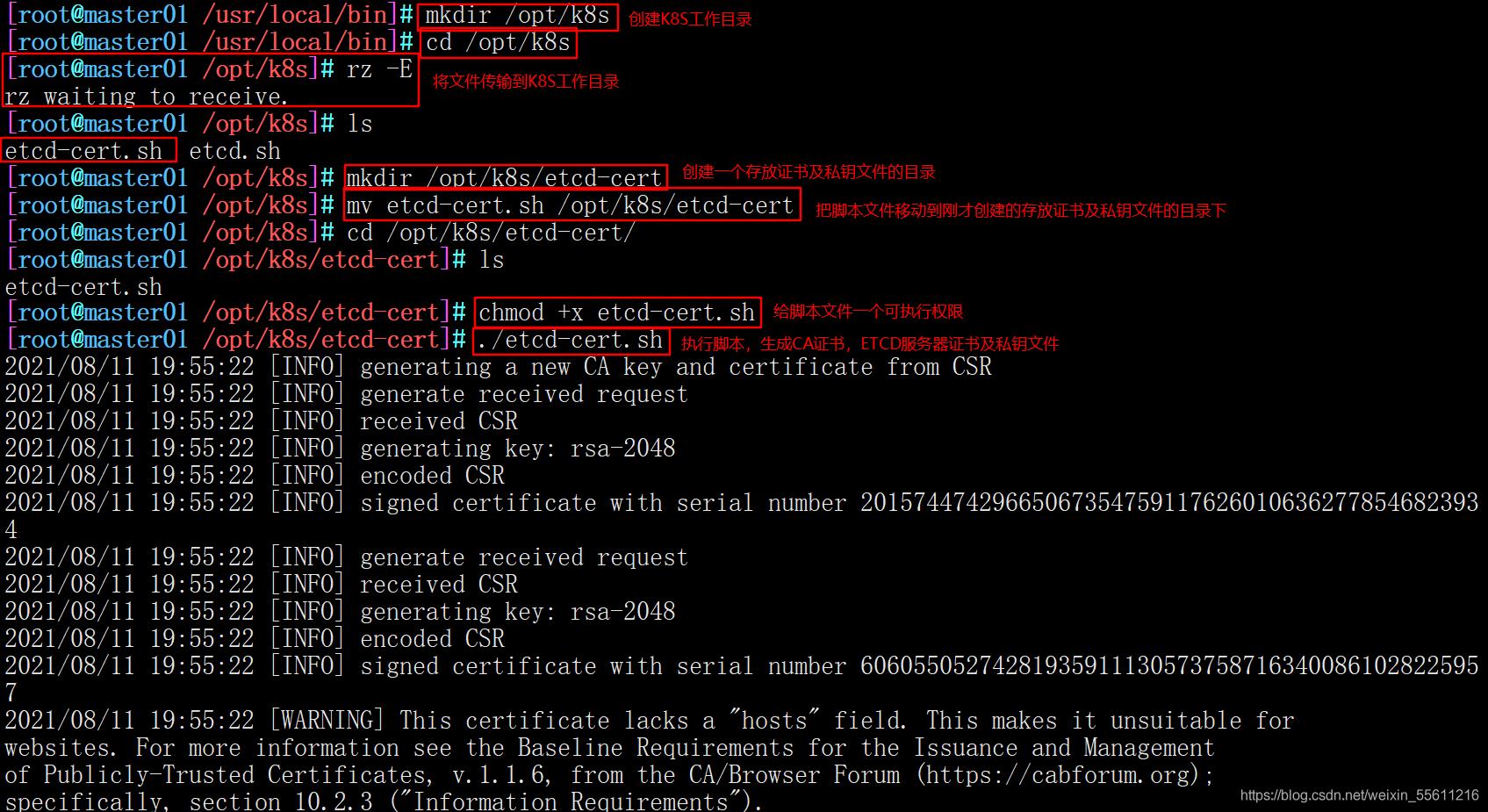

2.生成CA证书、etcd服务器证书以及私钥

在master01 节点上操作

mkdir /opt/k8s

cd /opt/k8s/

//上传etcd-cert.sh 和etcd.sh 到/opt/k8s/目录中

chmod +x etcd-cert.sh

//创建用于生成CA证书、etcd服务器证书以及私钥的目录

mkdir /opt/k8s/etcd-cert

mv etcd-cert.sh etcd-cert/

cd /opt/k8s/etcd-cert/

./etcd-cert.sh

#生成CA证书、etcd服务器证书以及私钥

生成CA证书、etcd服务器证书以及私钥的脚本详细内容查看:etcd-cert.sh(生成 etcd 服务器证书和私钥的集群节点IP地址)

3.安装Etcd

在master01 节点上操作

//上传etcd-v3.3. 10-linux-amd64.tar.gz到/opt/k8s/目录中,解压etcd 压缩包

cd /opt/k8s/

tar zxvf etcd-v3.3.10-linux-amd64.tar.gz

ls etcd-v3.3.10-linux-amd64

Documentation etcd etcdctl README-etcdctl.md README.md READMEv2-etcdctl.md

etcd就是etcd服务的启动命令,后面可跟各种启动参数

etcdctl主要为etcd服务提供了命令行操作

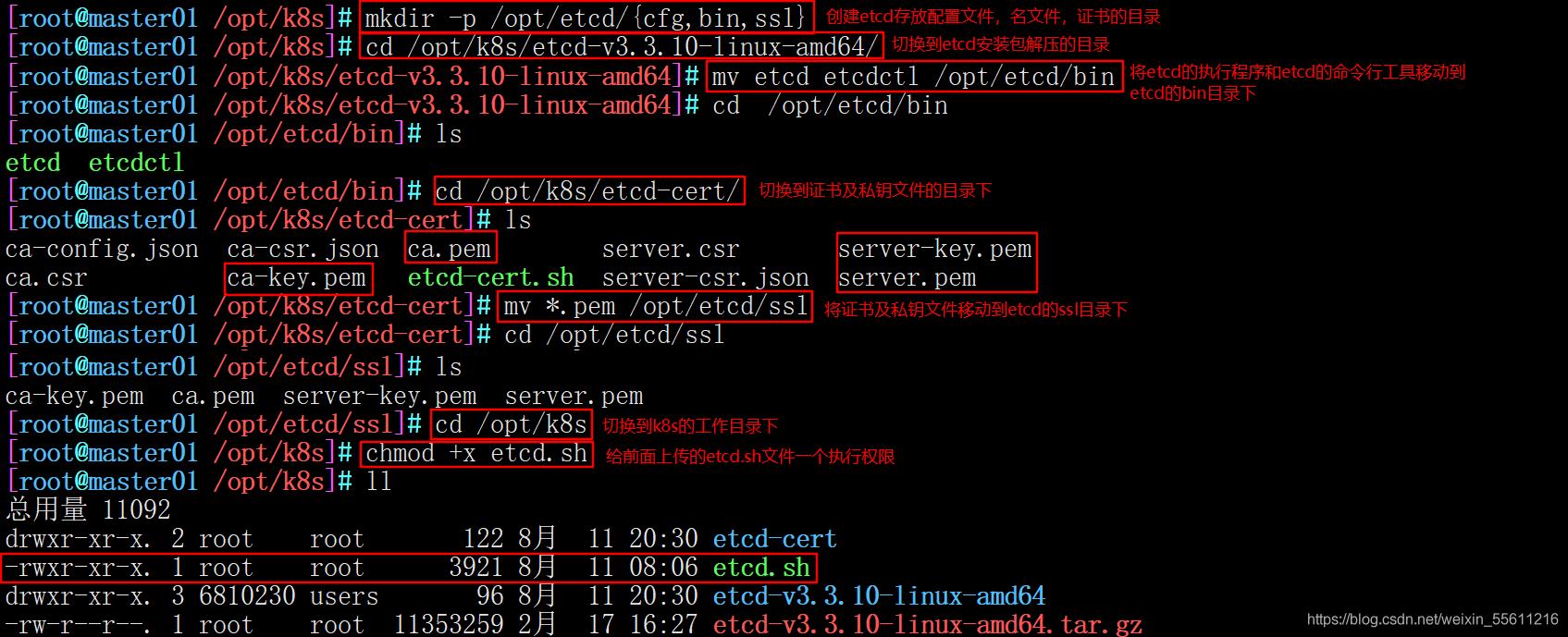

4.在Master01节点启动Etcd集群节点01

在master01 节点上操作

//创建用于存放etcd配置文件,命令文件,证书的目录

mkdir -p /opt/etcd/{cfg,bin,ssl}

mv /opt/k8s/etcd-v3.3.10-linux-amd64/etcd /opt/k8s/etcd-v3.3.10-1inux-amd64/etcdctl /opt/etcd/bin/

cp /opt/k8s/etcd-cert/*.pem /opt/etcd/ssl/

cd /opt/k8s/

chmod +x etcd.sh

启动etcd服务的脚本详细内容查看:etcd.sh

./etcd.sh etcd01 192.168.121.88 etcd02=https://192.168.121.55:2380,etcd03=https://192.168.121.66:2380

//进入卡住状态等待其他节点加入,这里需要三台etcd服务同时启动,如果只启动其中一台后,服务会卡在那里,直到集群中所有etcd节点都已启动,可忽略这个情况

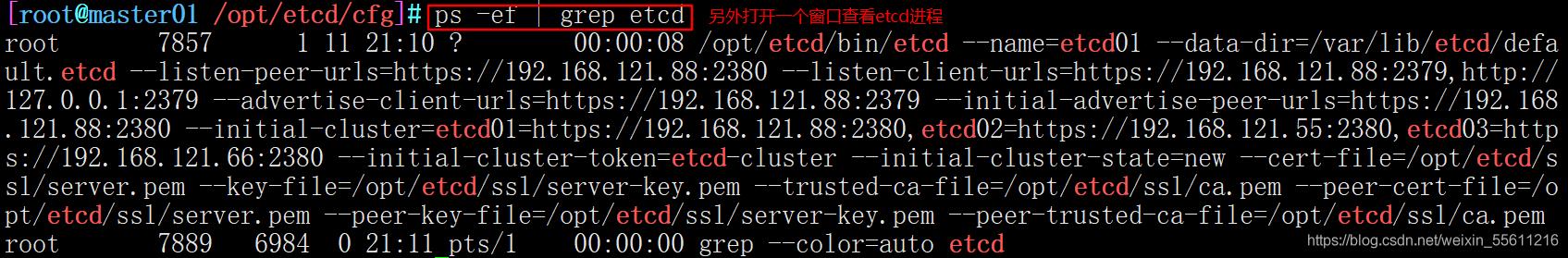

//另外打开一一个窗口查看etcd进程是否正常

ps -ef | grep etcd

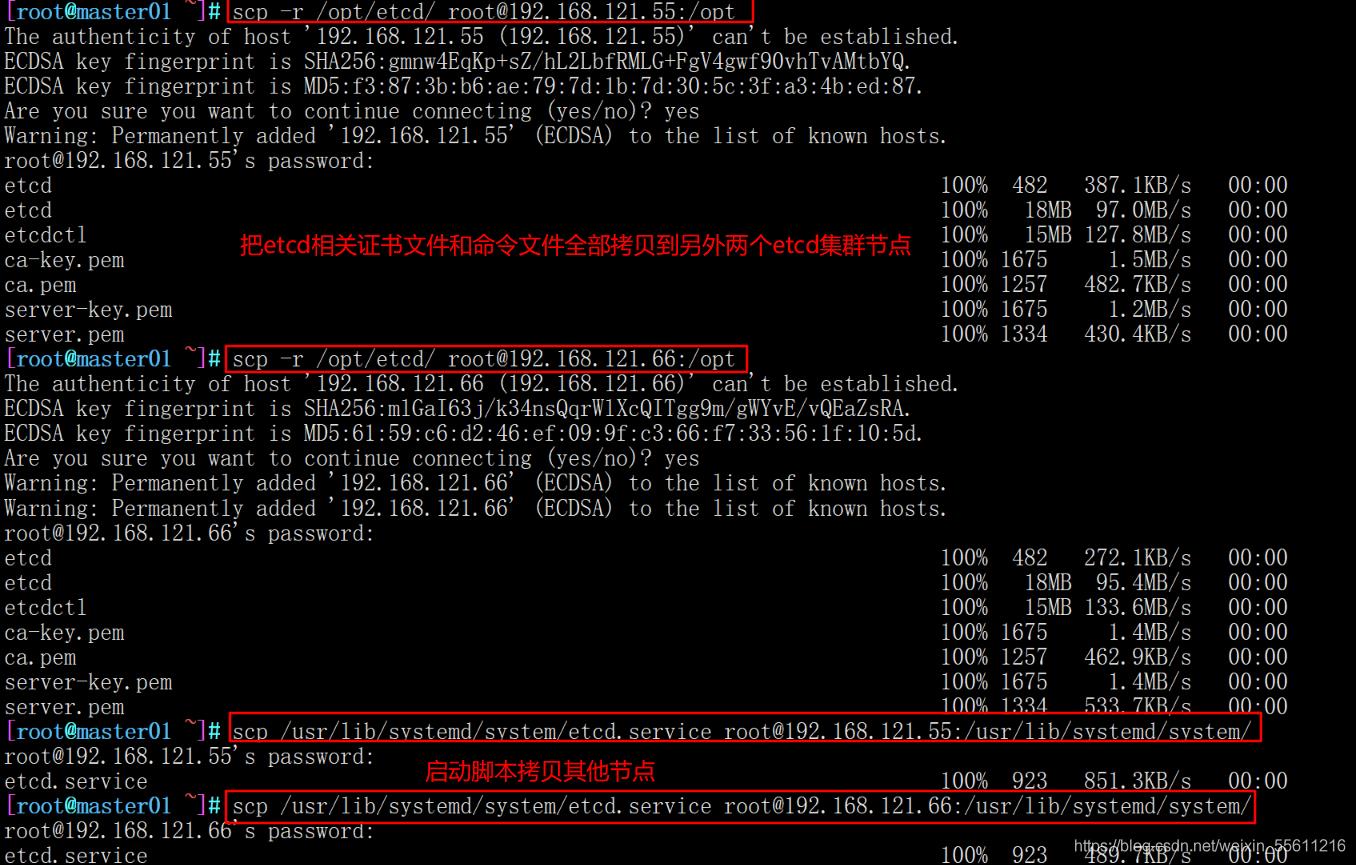

5.将证书,命令文件,服务启动脚本拷贝到另外两个etcd集群节点

在master01 节点上操作

//把etcd相关证书文件和命令文件全部拷贝到另外两个etcd集群节点

scp -r /opt/etcd/ root@192.168.121.55:/opt/

scp -r /opt/etcd/ root@192.168.121.66:/opt/

//启动脚本拷贝其他节点

scp /usr/lib/systemd/system/etcd.service root@192.168.121.55:/usr/lib/systemd/system/

scp /usr/lib/systemd/system/etcd.service root@192.168.121.66:/usr/lib/systemd/system/

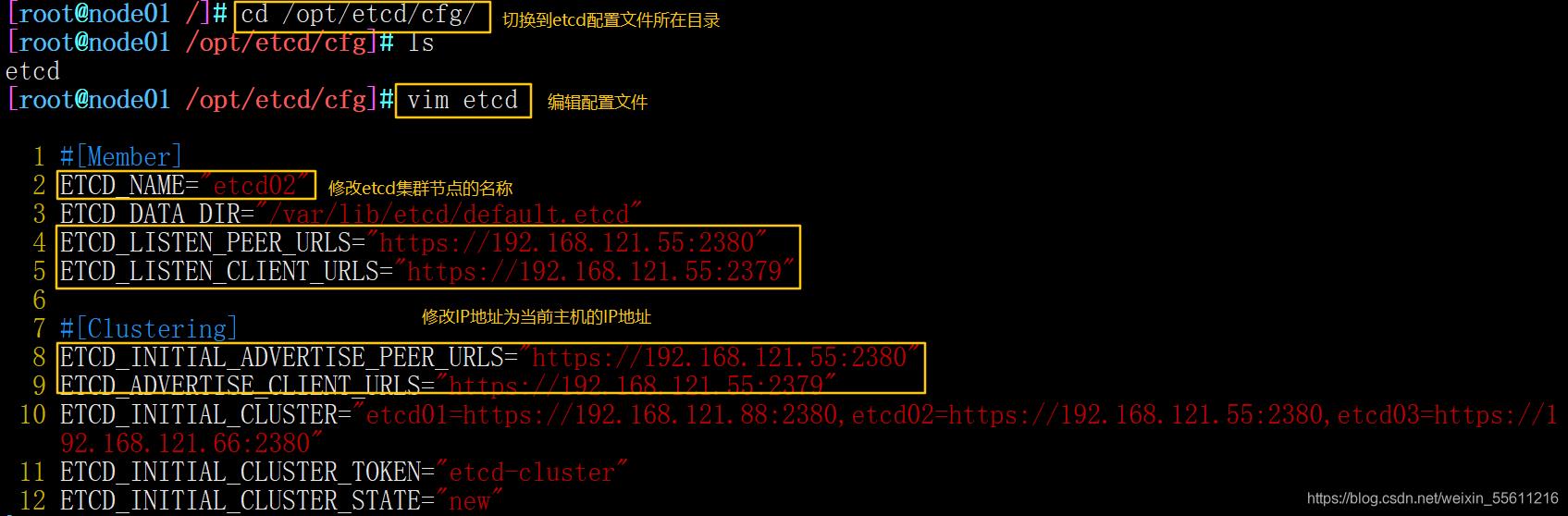

6.在其他节点修改etcd配置文件

在node01 节点上操作

vim /opt/etcd/cfg/etcd

#[Member]

ETCD_NAME="etcd02"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.121.55:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.121.55:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.121.55:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.121.55:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://192.168.195.149:2380,etcd02=https://192.168.195.150:2380,etcd03=https://192.168.195.151:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

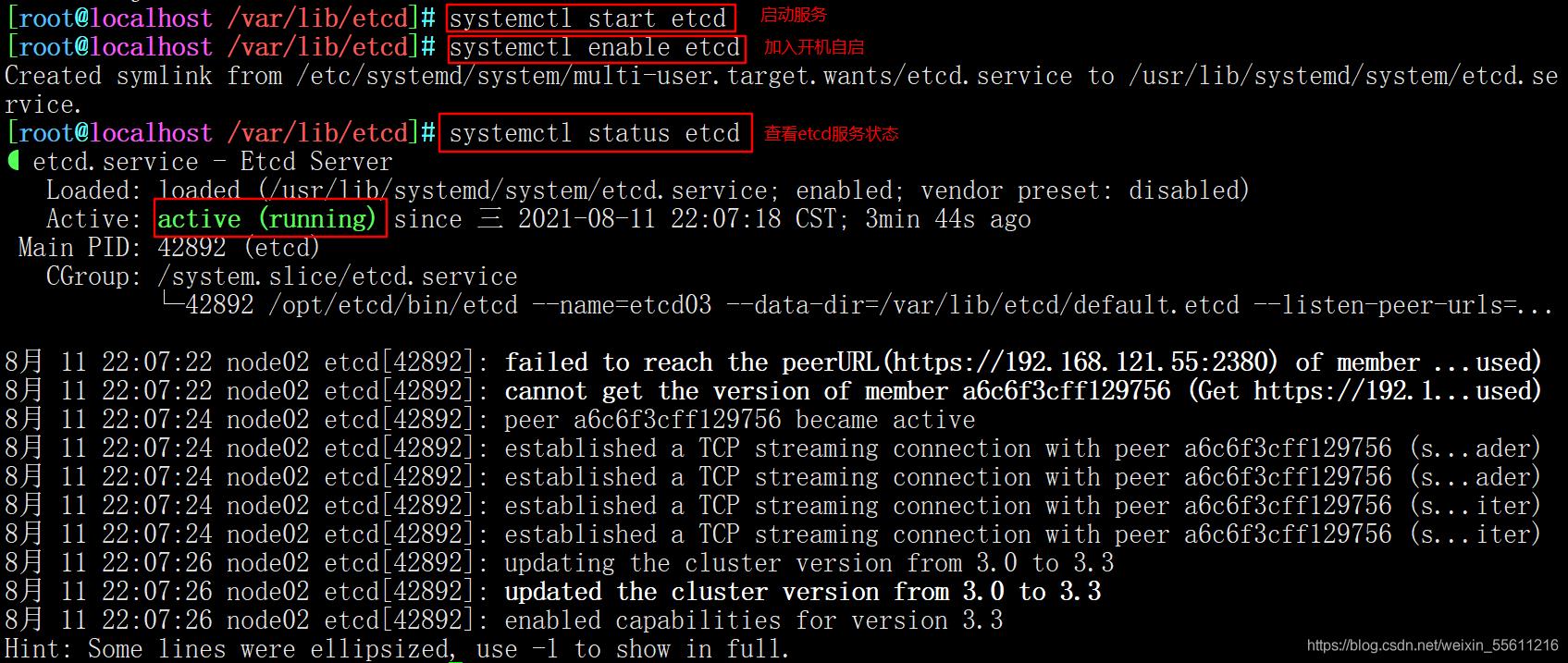

//启动

systemctl start etcd

systemctl status etcd

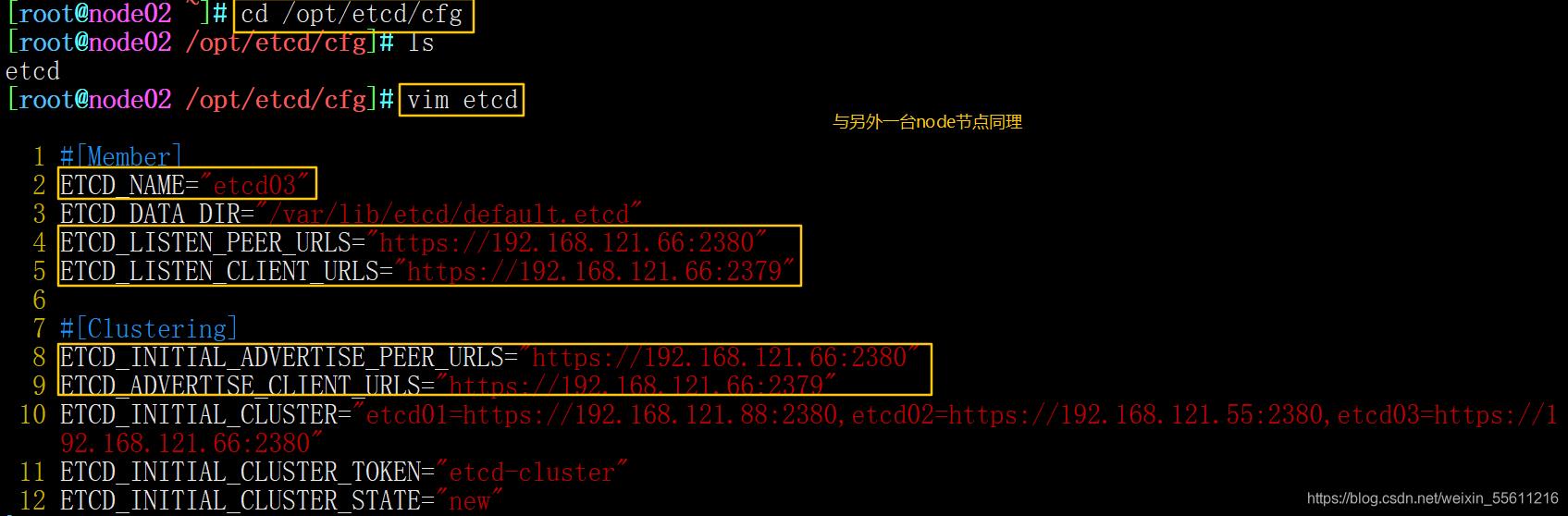

在node02 节点上操作

vim /opt/etcd/cfg/etcd

#[Member]

ETCD_NAME="etcd03"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.121.66:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.121.66:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.121.66:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.121.66:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://192.168.195.149:2380,etcd02=https://192.168.195.150:2380,etcd03=https://192.168.195.151:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

//启动

systemctl start etcd

systemctl status etcd

7.检查群集状态

在master01 节点上操作

ln -s /opt/etcd/bin/etcd* /usr/local/bin

//检查etcd群集状态

cd /opt/etcd/ssl

/opt/etcd/bin/etcdctl \\

-ca-file=ca.pem \\

-cert-file=server.pem \\

-key-file=server-key.pem \\

-endpoints="https://192.168.121.88:2379,https://192.168.121.55:2379,https://192.168.121.66:2379" \\

cluster-health

-cert-file: 识别HTTPS端使用SSL证书文件

-key-file: 使用此SSL密钥文件标识HTTPS客户端

-ca-file:使用此CA证书验证启用https的服务器的证书

–endpoints: 集群中以逗号分隔的机器地址列表

cluster–health: 检查etcd集群的运行状况

二.部署docker引擎

在node01节点和node02节点上操作

//所有node节点部署docker引擎

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce

systemctl start docker.service

systemctl enable docker.service

三.Flannel网络配置

K8S中Pod网络通信

●Pod内容器与容器之间的通信

在同一个Pod 内的容器(Pod 内的容器是不会跨宿主机的)共享同一个网络命令空间,相当于它们在同一台机器上一样,可以用

localhost 地址访问彼此的端口。

●同一个Node内Pod之间的通信

每个Pod都有一个真实的全局IP地址,同一个Node 内的不同Pod之,间可以直接采用对方Pod的IP地址进行通信,Pod1 与Pod2都是通过Veth连接到同一个docker0 网桥,网段相同,所以它们之间可以直接通信。

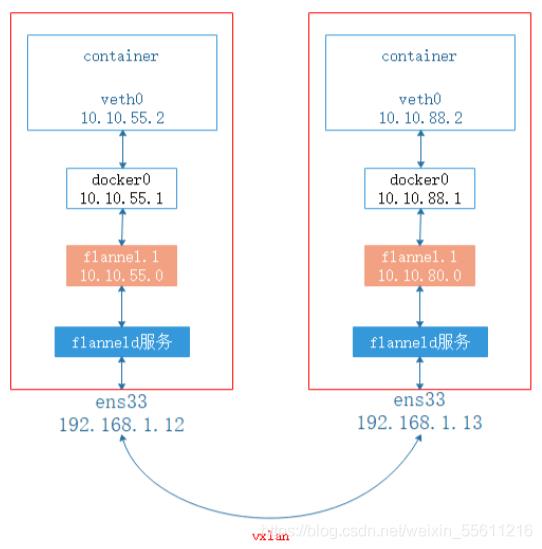

●不同Node上Pod之间的通信

Pod地址与docker0 在同一网段,docker0 网段与宿主机网卡是两个不同的网段,且不同Node之间的通信只能通过宿主机的物理网卡进行。

要想实现不同Node上Pod之间的通信,就必须想办法通过主机的物理网卡IP地址进行寻址和通信。因此要满足两个条件: Pod的

IP不能冲突;将Pod的IP和所在的Node 的IP关联起来,通过这个关联让不同Node上Pod之间直接通过内网IP地址通信。

Overlay Network:

叠加网络,在二层或者三层基础网络.上叠加的一种虚拟网络技术模式,该网络中的主机通过虚拟链路隧道连接起来( 类似于VPN)。

VXLAN:

将源数据包封装到UDP中,并使用基础网络的IP/MAC作为外层报文头进行封装,然后在以太网上传输,到达目的地后由隧道端点解封装并将数据发送给目标地址。

Flannel:

Flannel的功能是让集群中的不同节点主机创建的Docker 容器都具有全集群唯一的虚拟IP地址。

Flannel是Overlay网络的一种,也是将TCP源数据包封装在另一种网络包里面进行路由转发和通信,目前己经支持UDP、VXLAN、

AWSVPC等数据转发方式。

Flannel 工作原理

node1上的pod1 要和node2上的pod1进行通信,数据从node1上的Pod1源容器中发出后,经由所在主机的docker0 虚拟网卡转发到flannel0虚拟网卡,再由flanneld把pod ip封装到udp中(里面有源pod IP和目的pod IP),根据在etcd保存的路由表 通过物理网卡发送给目的node2的flanneld,来进行解封装暴露出udp里的pod IP,最后根据目的pod IP经flannel0虚拟网卡和docker0虚拟网卡转发到目的pod中,完成通信。

ETCD之Flannel提供说明

存储管理Flannel可分配的IP地址段资源

监控ETCD 中每个Pod的实际地址,并在内存中建立维护Pod 节点路由表

1.添加flannel 网络配置信息

在master01 节点上操作

//添加flannel 网络配置信息,写入分配的子网段到etcd中,供flannel 使用

cd /opt/etcd/ssl

/opt/etcd/bin/etcdctl \\

--ca-file=ca.pem \\

--cert-file=server.pem \\

--key-file=server-key.pem \\

--endpoints="https://192.168.121.88:2379,https://192.168.121.55:2379,https://192.168.121.66:2379" \\

set /coreos.com/network/config '{"Network": "172.17.0.0/16","Backend": {"Type": "vxlan"}}'

//查看写入的信息

/opt/etcd/bin/etcdctl \\

--ca-file=ca.pem \\

--cert-file=server.pem \\

--key-file=server-key.pem \\

--endpoints="https://192.168.121.88:2379,https://192.168.121.55:2379,https://192.168.121.66:2379" \\

get /coreos.com/network/config

set <key> <value>

set /coreos com/network/config添加一条网络配置记录,这个配置将用于flannel分配给每个docker的虚拟IP地址段

get <key>

get /coreos.com/network/config获取网络配置记录,后面不用再跟参数了

Network:用于指定Flannel地址池

Backend:用于指定数据包以什么方式转发,默认为udp模式,Backend为vxlan 比起预设的udp性能相对好一些

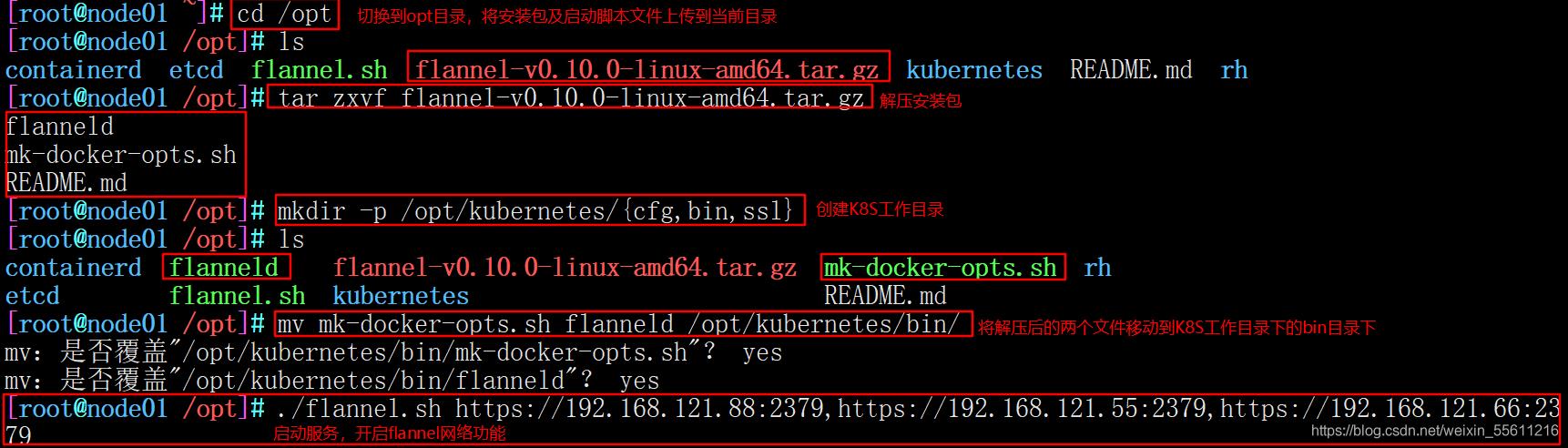

2.安装并启动Flannel服务

在所有node 节点上操作

//上传flannel.sh和flannel-v0.10.0-1inux-amd64.tar.gz到/opt 目录中,解压flannel 压缩包

cd /opt

tar zxvf flannel-v0.10.0-linux-amd64.tar.gz

flanneld #flanneld为主要的执行文件

mk-docker-opts.sh #mk-docker-opts.sh脚本用于生成Docker启动参数

README.md

//创建kubernetes工作目录

mkdir -p /opt/kubernetes/{cfg,bin,ssl}

mv mk-docker-opts.sh flanneld /opt/kubernetes/bin/

//启动flanneld服务,开启flannel网络功能

cd /opt

chmod +x flannel.sh

./flannel.sh https://192.168.121.88:2379,https://192.168.121.55:2379,https://192.168.121.66:2379

启动Flannel服务的脚本详细内容查看:flannel.sh

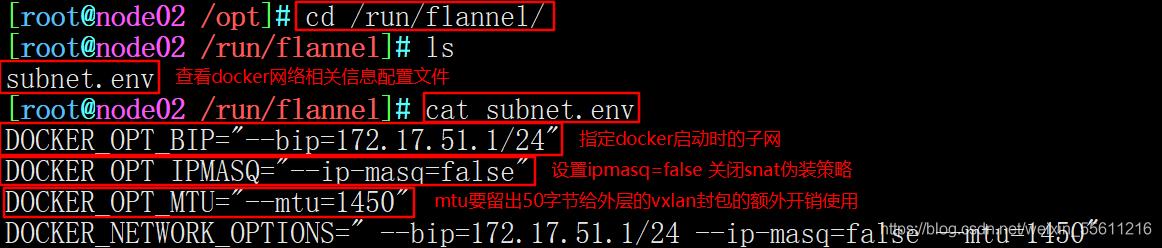

//flannel启动后会生成一个docker网络相关信息配置文件/run/flannel/subnet.env,包含了docker要使用flannel通讯的相关参数

cat / run/flannel/subnet.env

DOCKER_OPT_BIP="--bip=172.17.26.1/24"

DOCKER_OPT_IPMASQ="--ip-masq= false"

DOCKER_OPT_MTU="--mtu=1450"

DOCKER NETWORK OPTIONS="--bip=172.17.26. 1/24 --ip-masq-false--mtu=1450"

--bip: 指定docker启动时的子网

--ip-masq: 设置ipmasq=false 关闭snat伪装策略

--mtu=1450:mtu要留出50字节给外层的vxlan封包的额外开销使用

3.配置Docker连接Flannel

在所有node 节点上操作

vim /usr/lib/systemd/system/docker.service

[Service]

....

#for containers run by docker

EnvironmentFile=/run/flannel/subnet.env #添加此行

ExecStart=/usr/bin/dockerd $DOCKER_NETWORK_OPTIONS -H fd:// --containerd=/run/containerd/containerd.sock

....

//重启docker服务

systemctl daemon-reload

systemctl restart docker

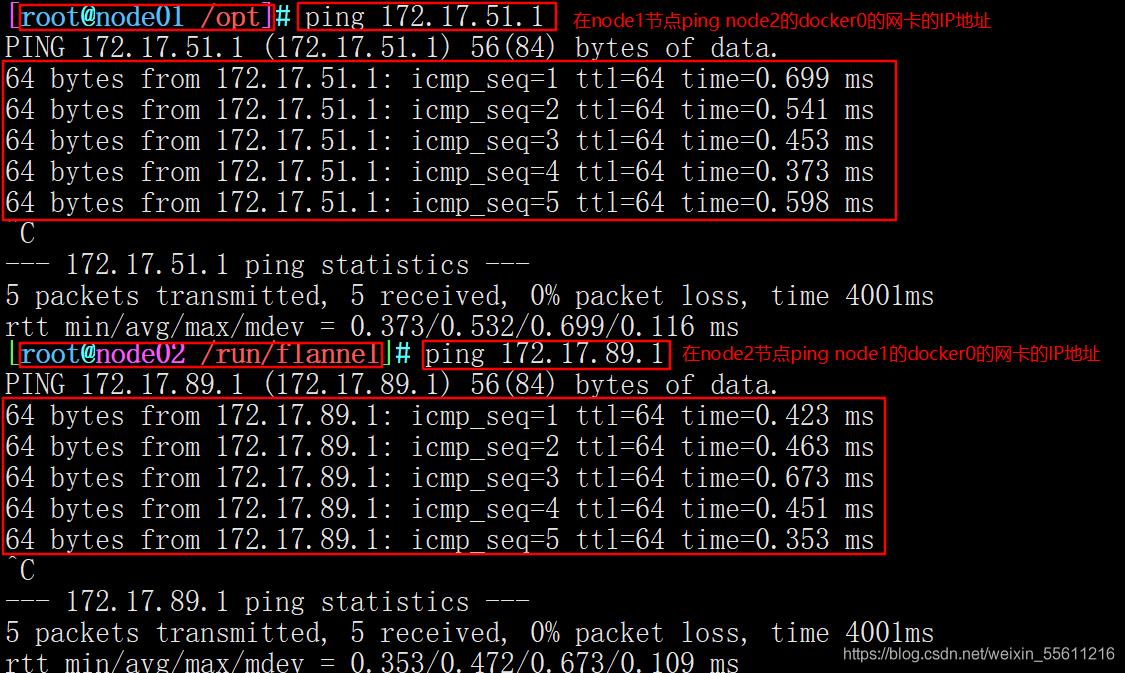

//查看flannel网络

ifconfig

//测试ping通对方docker0网卡证明flannel起到路由作用

node1:ping 172.17.89.1

node2:ping 172.17.51.1

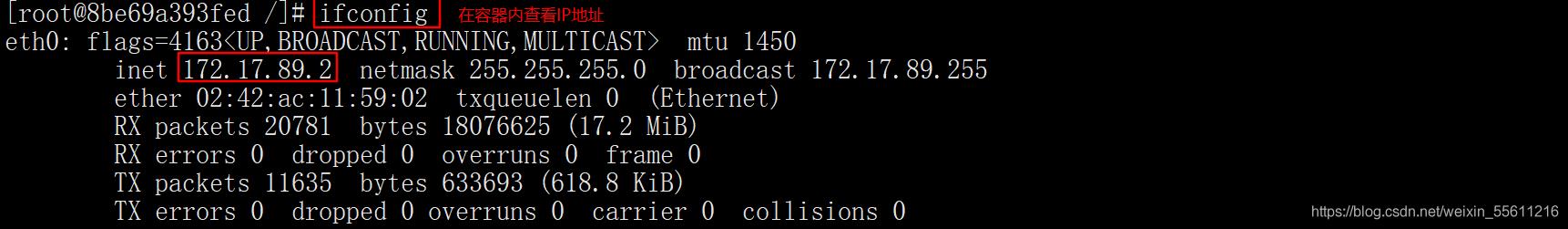

4.在两个Node节点内创建Docker容器,进行测试

在所有node 节点上操作

docker run -it centos:7 /bin/bash

yum install net-tools -y

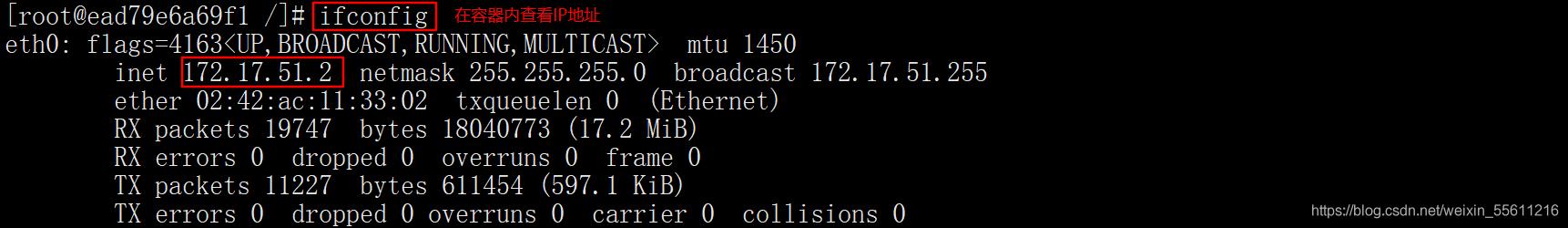

ifconfig

分别在两个容器内查看IP地址

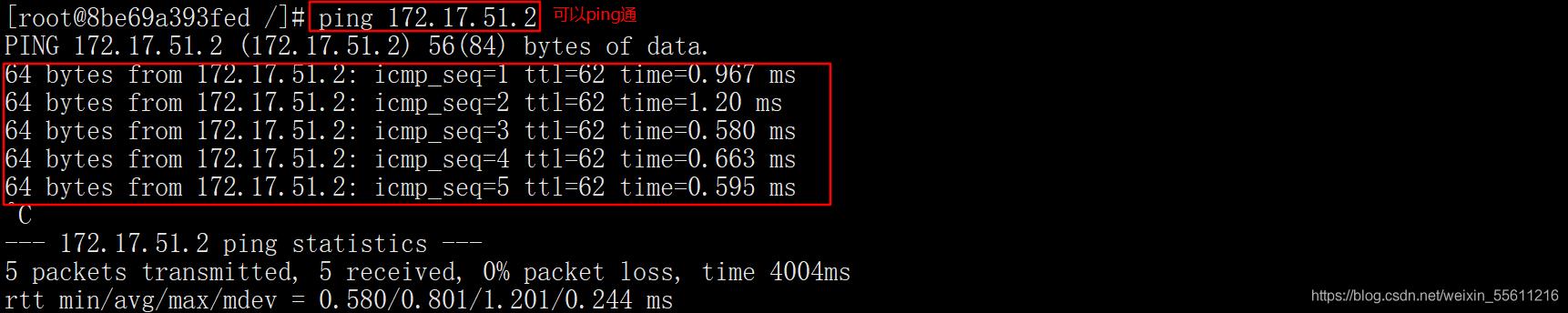

在node01节点:ping 172.17.51.2

在node02节点:ping 172.17.89.2

四.部署master组件

在Master01节点上操作

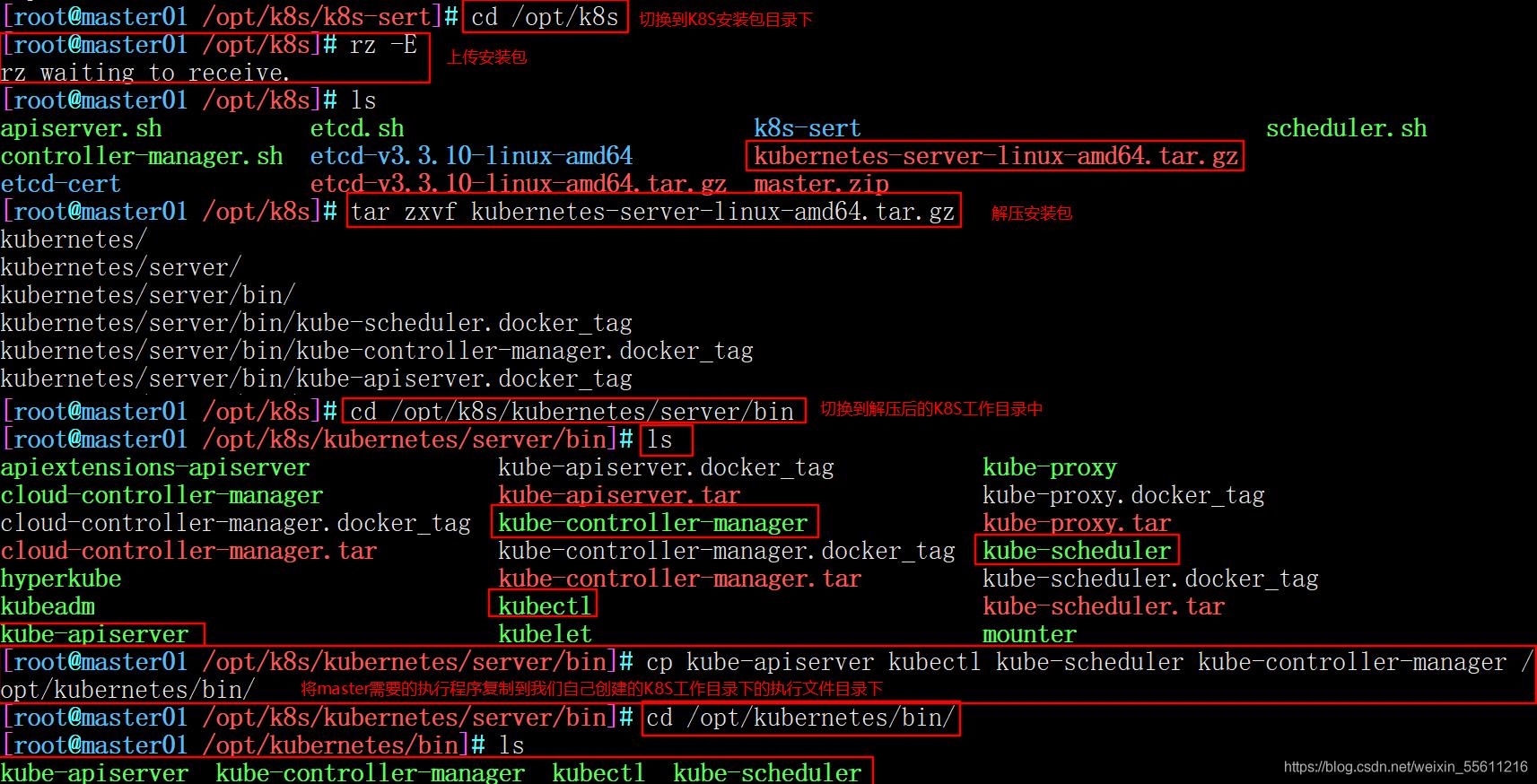

1.上传安装包及证书生成脚本

//上传master.zip 和k8s-cert.sh 到/opt/k8s目录中,解压master.zip压缩包

cd /opt/k8s/

unzip master.zip

apiserver.sh

scheduler.sh

controller-manager.sh

chmod +x *.sh

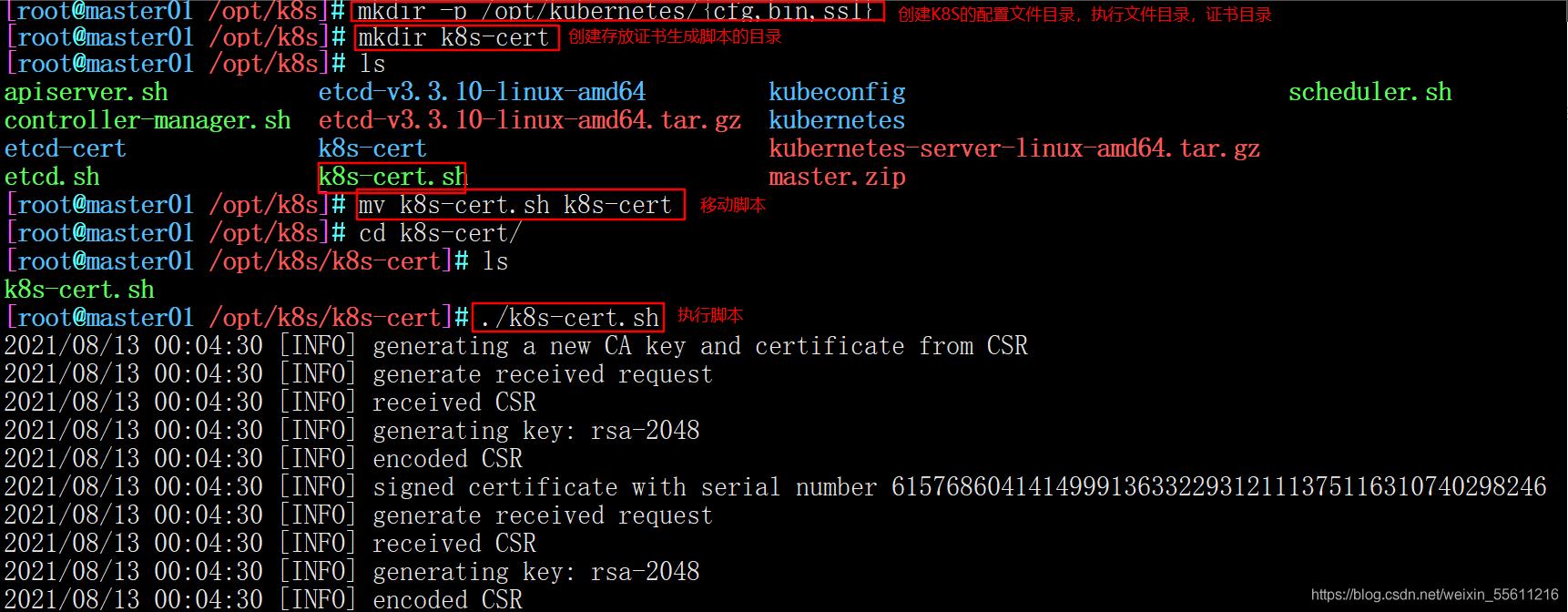

2.创建Kubernetes工作目录,生成证书

//创建kubernetes工作目录

mkdir -p /opt/kubernetes/{cfg,bin,ssl}

//创建用于生成CA证书、相关组件的证书和私钥的目录

mkdir /opt/k8s/k8s-cert

mv /opt/k8s/k8s-cert.sh /opt/k8s/k8s-cert

cd /opt/k8s/k8s-cert/

./k8s-cert.sh #生成CA证书、相关组件的证书和私钥

启动Flannel服务的脚本详细内容查看:k8s-cert.sh(需修改生成 apiserver 的证书和私钥字段的IP地址,以及后面的注释信息进行删除)

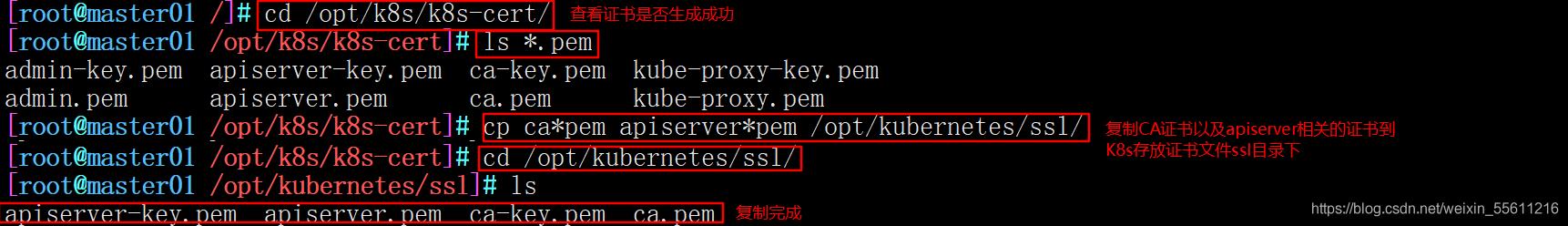

ls *pem

admin-key.pem apiserver-key.pem

ca-key.pem kube-proxy-key.pem

admin.pem

apiserver.pem

ca.pem

kube-proxy.pem

//controller-manager和kube-scheduler设置为只调用当前机器的apiserver, 使用127.0.0.1:8080 通信,因此不需要签发证书

//复制CA证书、apiserver相关证书和私钥到kubernetes 工作目录的ssl子 目录中

cp ca*pem apiserver*pem /opt/kubernetes/ssl/

3.解压安装包并创建Token认证文件

//上传kubernetes-server-linux-amd64.tar.gz到/opt/k8s/目录中,解压kubernetes压缩包

cd /opt/k8s/

tar zxvf kubernetes-server-linux-anid64.tar.gz

//复制master组件的关键命令文件到kubernetes 工作目录的bin子目录中

cd /opt/k8s/kubernetes/server/bin

cp kube-apiserver kubectl kube-controller-manager kube-scheduler /opt/kubernetes/bin/

ln -s /opt/kubernetes/bin/* /usr/local/bin/

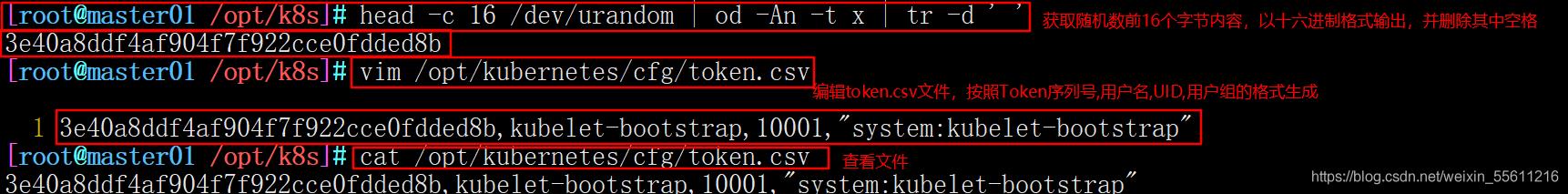

//创建bootstrap token认证文件,apiserver启动时会调用,然后就相当于在集群内创建了一个这个用户,接下来就可以用RBAC

给他授权

cd /opt/k8s/

#获取随机数前16个字节内容,以十六进制格式输出,并删除其中空格

head -c 16 /dev/urandom | od -An -t x | tr -d ' '

3e40a8ddf4af904f7f922cce0fdded8b #复制生成的随机数

#编辑token.csv文件,按照Token序列号,用户名,UID,用户组的格式生成

vim /opt/kubernetes/cfg/token.csv

3e40a8ddf4af904f7f922cce0fdded8b,kubelet-bootstrap,10001,"system:kubelet-bootstrap"

cat /opt/kubernetes/cfg/token.csv

4.开启Apiserver服务

//二进制文件、token、证书都准备好后,开启apiserver服务

cd /opt/k8s/

./apiserver.sh 192.168.121.88 https://192.168.121.88:2379,https://192.168.121.55:2379,https://192.168.121.66:2379

//检查进程是否启动成功

ps aux | grep kube-apiserver

// k8s通过kube-apiserver这个进程提供服务,该进程运行在单个master节点上。默认有两个端口6443和8080

//安全端口6443用于接收HTTPS请求,用于基于Token文件或客户端证书等认证

netstat -natp |grep 6443

//本地端口8080用于接收HTTP请求,非认证或授权的HTTP请求通过该端口访问APIServer

netstat -natp | grep 8080

//查看版本信息(必须保证apiserver启动正常,不然无法查询到server的版本信息)

kubectl version

启动apiserver服务的脚本详细内容查看:apiserver.sh