[TensorFlow系列-12]:TensorFlow基础 - 张量线性运算(点乘叉乘)

Posted 文火冰糖的硅基工坊

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了[TensorFlow系列-12]:TensorFlow基础 - 张量线性运算(点乘叉乘)相关的知识,希望对你有一定的参考价值。

作者主页(文火冰糖的硅基工坊):https://blog.csdn.net/HiWangWenBing

本文网址:https://blog.csdn.net/HiWangWenBing/article/details/119644102

目录

第5章 矩阵的内积运算(对应):inner() -- 不支持

第6章 矩阵的外积/叉乘运算: tf.matmul(x, y)

第1章 Tensor运算概述

https://tensorflow.google.cn/api_docs/python/tf

1.1 概述

TensorFlow提供了大量的张量运算,基本上可以对标Numpy多维数组的运算,以支持对张量的各种复杂的运算。

这些操作运算中大多是对数组中每个元素执行相同的函数运算,并获得每个元素函数运算的结果序列,这些序列生成一个新的同维度的数组。

1.2 运算分类

(1)算术运算:加、减、系数乘、系数除

(2)函数运算:sin,cos

(3)取整运算:上取整、下取整

(4)统计运算:最大值、最小值、均值

(5)比较运算:大于,等于,小于、排序

(6)线性代数运算:矩阵、点乘、叉乘

1.3 “in place“运算 :不支持

1.4 Tensor的广播机制: 不同维度的张量运算

1.5 环境准备

#环境准备

import numpy as np

import tensorflow as tf

print("hello world")

print("tensorflow version:", tf.__version__)1.6 张量的线性代数运算

(1)点乘:multiply(a,b)=》张量

(2)内积: inner(a,b) =》标量 # tensorflow不支持

(3)叉乘:matmul(a,b) =》 张量

备注:在矩阵的各种运算中,Tensorflow比Pytorch的函数库要少很多。

第2章 向量的点乘:tf.multiply(x, y)

向量的点乘定义:按位相乘,不相加

# 代码示例

#向量的点乘(点积)运算: 对应元素相乘

print("向量:")

a = tf.constant([1,2,3])

b = tf.constant([1,2,1])

print(a)

print(b)

print("\\n点乘")

c= tf.multiply(a,b) #对应元素相乘

print(c) 向量:

tf.Tensor([1 2 3], shape=(3,), dtype=int32)

tf.Tensor([1 2 1], shape=(3,), dtype=int32)

点乘

tf.Tensor([1 4 3], shape=(3,), dtype=int32)第3章 向量的内积(是基础):不支持

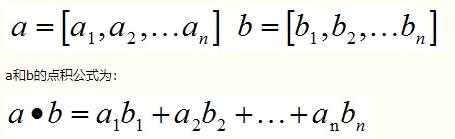

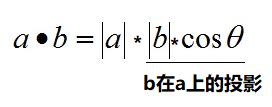

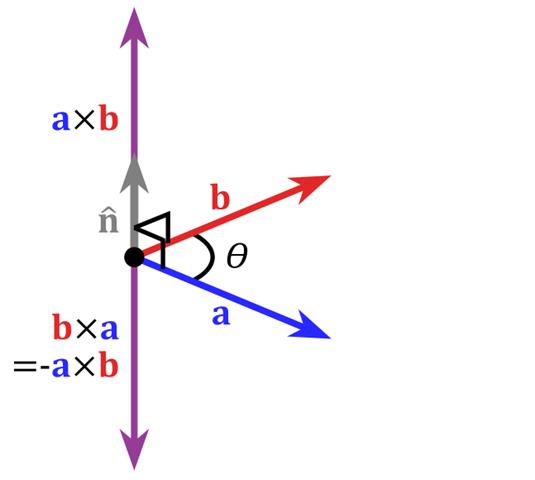

3.1 定义

概括地说,向量的内积(点乘/数量积)。

对两个向量执行点乘运算,就是对这两个向量对应位一一相乘之后求和的操作,如下所示,对于向量a和向量b:

注意:

- 这里要求一维向量a和向量b的行列数相同。

- 点乘的结果是一个标量(数量而不是向量)

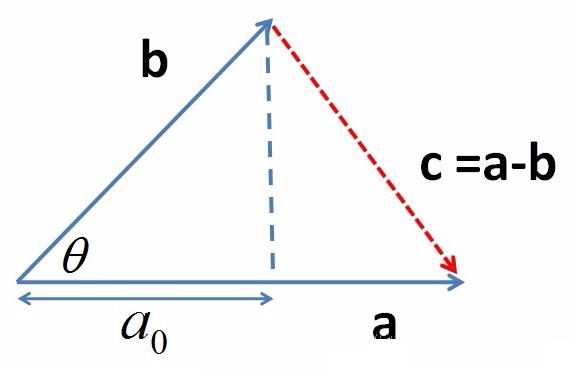

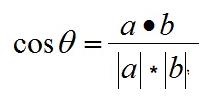

3.2 向量内积的几何意义

(1)可用于计算计算两个向量之间的夹角.

θ=arccos(a∙b/|a||b|)

(2)b向量在a向量方向上的投影与a相乘

|a| = 所有元素的平方和开根号,实际上就是向量a的长度。

|b| = 所有元素的平方和开根号,实际上就是向量b的长度。

a.b = a1*b1 + a2*b2 ..... an*bn

(3)是否正交指示:

如果点乘的结果为0,则表示a在b上的投影为0,表示a和b是正交的。

如果正交,表示这两个向量不相干。

3.3 代码示例 -- 不支持

第4章 向量的叉乘 -- 不支持

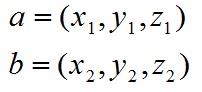

4.1 定义

两个向量的外积,又叫叉乘、叉积向量积,其运算结果是一个向量而不是一个标量。

并且两个向量的外积与这两个向量组成的坐标平面垂直。

定义:向量a与b的外积a×b是一个向量,其长度等于|a×b| = |a||b|sin∠(a,b),其方向正交于a与b。并且,(a,b,a×b)构成右手系。

特别地,0×a = a×0 = 0.此外,对任意向量a,自身相乘a×a=0。

对于向量a和向量b:

a和b的外积公式为(得到的是原先维度的向量):

4.2 几何意义

在三维几何中,向量a和向量b的外积结果是一个向量,有个更通俗易懂的叫法是法向量,该向量垂直于a和b向量构成的平面。

在3D图像学中,外积的概念非常有用,可以通过两个向量的外积,生成第三个垂直于a,b的法向量,从而构建X、Y、Z坐标系。如下图所示:

4.3 代码示例: Tensorflow不支持

第5章 矩阵的内积运算(对应):inner() -- 不支持

5.1 矩阵内积的定义

两个相同维度的矩阵a和b,a和b矩阵的内积时相同位置的向量的内积。

(1)向量向量内积

(2)向量矩阵的内积:

5.2 代码示例 - 不支持

第6章 矩阵的外积/叉乘运算: tf.matmul(x, y)

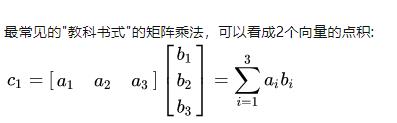

6.1 矩阵外积(矩阵乘积)的定义 (矩阵相乘)

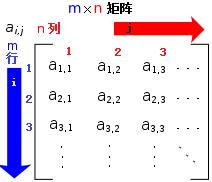

矩阵相乘最重要的方法是一般矩阵乘积。它只有在第一个矩阵的列数(column)和第二个矩阵的行数(row)相同时才有意义。

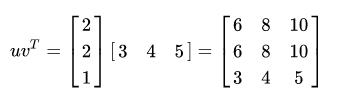

(1)向量的乘积

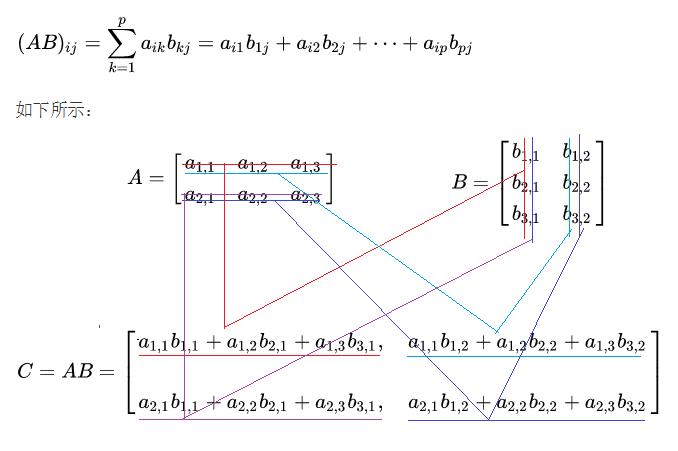

(2)矩阵的乘积

6.2代码示例

# 代码示例:

# 矩阵的外积、叉乘:交叉相乘

print("矩阵:1*3")

a = tf.constant([[1,2,3]]) # 相当于1* N

print(a)

print("矩阵:3*1")

b = tf.constant([[0],[1],[0]]) # 相当于N * 1

print(b)

print("叉乘: 1*1")

c = tf.matmul(a,b) # 等价于 1*0+2*1+3*0

print(c)

print("\\n矩阵:2*3")

a = tf.constant([[1,2,3], [4,5,6]])

print(a)

print("\\n矩阵:3*2")

b = tf.constant([[0,1], [1,1], [1,1]])

print(b)

print("叉乘: 2*2")

c = tf.matmul(a,b) # X * N VS N * Y => X * Y

print(c)

输出:

矩阵:1*3

tf.Tensor([[1 2 3]], shape=(1, 3), dtype=int32)

矩阵:3*1

tf.Tensor(

[[0]

[1]

[0]], shape=(3, 1), dtype=int32)

叉乘: 1*1

tf.Tensor([[2]], shape=(1, 1), dtype=int32)

矩阵:2*3

tf.Tensor(

[[1 2 3]

[4 5 6]], shape=(2, 3), dtype=int32)

矩阵:3*2

tf.Tensor(

[[0 1]

[1 1]

[1 1]], shape=(3, 2), dtype=int32)

叉乘: 2*2

tf.Tensor(

[[ 5 6]

[11 15]], shape=(2, 2), dtype=int32)

作者主页(文火冰糖的硅基工坊):https://blog.csdn.net/HiWangWenBing

本文网址:https://blog.csdn.net/HiWangWenBing/article/details/119644102

以上是关于[TensorFlow系列-12]:TensorFlow基础 - 张量线性运算(点乘叉乘)的主要内容,如果未能解决你的问题,请参考以下文章

Tensorboard 在 Windows 操作系统上显示空白网页

使用亚马逊的云服务器EC2做深度学习配置TensorFlow

使用 GPU 连接到本地运行时 google colab 需要 tensorflow-gpu?