苹果新功能惹众怒,4000多家组织和个人签署公开信 敦促苹果放弃“儿童安全”功能

Posted AI科技大本营

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了苹果新功能惹众怒,4000多家组织和个人签署公开信 敦促苹果放弃“儿童安全”功能相关的知识,希望对你有一定的参考价值。

【CSDN 编者按】大部分人选择iPhone的一大理由就是信息安全,这家公司对于个人隐私的保护一直为人称赞。最近苹果公司宣布,为了让儿童能够更加安全地上网,他们决定在ios 15、iPadOS 15、macOS Monterey系统中加入一个可以扫描用户照片的功能,这样还会保护隐私吗?

整理 | 禾木木,梦依丹

出品 | AI科技大本营(ID:rgznai100)

近日,苹果宣布即将推出一个新功能。为了让儿童能够更加安全地上网,他们决定在iOS 15、iPadOS 15、macOS Monterey系统中加入一个可以扫描用户照片的功能。

据英国《金融时报》报道,计划扫描存储在iPhone和iCloud上的照片,以找出虐待儿童和色情的图片。新系统能够帮助执法部门进行刑事调查,但可能会导致法律和政府对用户数据的需求增加。

该系统名为neuralMatch,一旦发现非法图像,将主动提醒给审查人员。如果材料能够得到验证,他们将与执法部门联系。

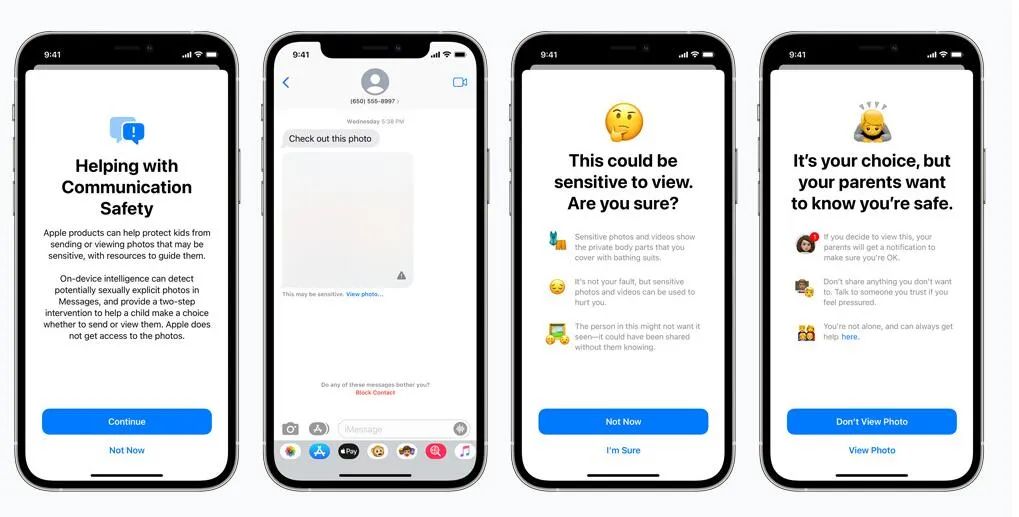

与此同时,未成年人账户的 iMessage 也会受到重点监测。如果他们的 iMessage 中有色情照片,iPhone 也会发出警告并通知其父母。

远程扫描用户的所有相册,那还有隐私可言吗?

苹果新功能的应用

扫描上传 iCloud 照片的计划在某些方面与微软的PhotoDNA相似,不过苹果的扫描主要是在设备端进行的,处理过的图像会被转换为机器学习所需的参数,在云端与数据集进行匹配,设备端不会知道是否找到了匹配项。

这意味着,当功能推出时,NCMEC CSAM数据库一个版本将会下载到每部iPhone上。

苹果的第二个功能是基于iMessage发送或接收的扫描照片的敏感内容通知。为了实施这些通知,苹果将推出一个设备端机器学习分类器,用于检测【色情图片】。

对于年龄在13到17岁之间的用户,将弹出类似的警告通知,但没有家长通知。如果13岁以下的儿童收 iMessage认为「色情」的图片,在被允许查看照片之前会弹出一个通知,告诉儿童他们的父母将收到通知。

无论是发送还是接收内容,未成年用户都可以选择在未通知家长的情况下拒绝。

通过加密技术打消人们顾虑?

为了消除用户对此系统的顾虑,苹果在公告中说,他们不是为了扫描用户的图片,而是用一种NeuralHash的加密技术,是无法直接看到用户相册的。

NeuralHash是一个可以将图像映射到数字的感知哈希函数,这组哈希值数据库经过加密后存储在苹果设备上,防止用户获取哈希值绕过系统检测。此项技术能够确保相同视觉上相似的图像产生相同的哈希值。例如,稍微裁剪或调整大小的图像是具有相同的哈希值。

符合的图片会上传到苹果,如果照片的低于一定加密值是无法被还原的。苹果认为,这些保护措施可以防止儿童色情审查机制被滥用。

想通过技术来保护儿童的苹果,却遭到了网友的热议。

4000多个组织和个人发出公开信,敦促苹果不要实施“儿童安全”功能

此举遭到了4,000多个组织以及安全和隐私专家、密码学家、研究人员、教授、法律专家和苹果消费者的公开反对。他们在周六签署了一封公开信,谴责苹果系统地破坏用户隐私和端到端加密机制。

公开信链接:https://appleprivacyletter.com/

部分公开信内容:

2021年8月5日,苹果宣布了旨在“扩大对儿童保护”的新技术措施。这些新措施几乎适用于其所有设备。虽然虐待儿童是一个严重的问题,而且打击这个问题的努力几乎完全是出于善意,但苹果的提议实际上相当于引入了一个“后门”,这可能会破坏对所有苹果产品用户的基本隐私保护。

苹果提出的方法是通过持续监控用户iPhone、iPad 或 Mac上保存或共享的照片来实现的。系统检测iCloud存储中是否存在大量非法照片,并向相关机构发出警报。如果使用iMessage发送或接收机器学习算法认为包含裸照的照片,另一个应用程序将通知孩子的父母。由于这两项检测是在用户设备上执行的,因此他们有可能绕过任何保护用户隐私的端到端加密。

苹果公司宣布这一消息后,世界各地的专家立即就苹果公司发出了警告,并称iPhone将变成一台监控设备,通过不断扫描用户的所有照片和消息,来向执法部门报告任何令人反感的内容。我们的个人设备成为侵入性监视的全新工具,几乎没有监督以防止最终滥用和不合理地扩大监视范围。

该电子前沿基金会说是“苹果正在为更广泛的滥用打开大门”。民主与技术中心(CDT)表示,这是“苹果公司的变化在事实上是给儿童和所有用户带来新的风险,这严重背离了苹果从长期持有的隐私和安全协议”。

在公开信最后,专家们也对苹果公司提出了如下要求:

-

苹果立即停止尝试部署所提议的内容监控技术;

-

苹果发表声明重申他们对端到端加密和用户隐私的承诺。

苹果目前的做法可能会破坏技术专家、学者和政策倡导者数十年来的工作,这些人始终希望,在大多数消费电子设备和使用案例中,让强有力的隐私保护措施成为常态。我们要求苹果重新考虑实施其新措施,以免毁掉上述努力成果。

参与签名的组织和部分个人名单

网友热议

著名隐私活动家和告密者斯诺登写道:“不管用意有多好,苹果都在通过这种方式向全世界输出大规模监控。如果他们今天可以扫描儿童色情内容,那么明天就可以扫描任何东西。他们毫无征兆地将价值1万亿美元的设备变成了监控设施。”

霍普金斯大学教授、密码学家Matthew Green对这种系统表示担忧。Matthew Green 说:「这种工具能够可以帮助查找手机中的儿童色情内容,但想象一下,如果掌握权力的公司或机构获得了这种系统,会发生什么?」

网友诺天王摇滚魂:大家心里都明白,所谓打击儿童色情犯罪只是借口;

网友Rokiyep: Apple官网,隐私是每个人的基本权利,同时也是Apple的一项核心价值观。你的设备在生活的方方面面都发挥着重要作用。其中的哪些东西可以分享,以及与谁分享,都应该由你来决定。我们设计Apple产品的理念就是保护你的隐私,并让你全权管控自己的信息。这并非易事,但我们坚信这才是真正的创新。

相册往往是存有一个人隐私最多的地方,大家都不希望自己的隐私被查看。有网友也会担心,如果有数据泄露……就可怕了。

对于此事,你怎么看呢?

参考链接:

-

https://www.apple.com/child-safety/

-

https://appleprivacyletter.com/

-

https://www.theverge.com/2021/8/5/22611305/apple-scan-photos-iphones-icloud-child-abuse-imagery-neuralmatch

-

https://www.eff.org/deeplinks/2021/08/apples-plan-think-different-about-encryption-opens-backdoor-your-private-life

-

https://www.apple.com/child-safety/pdf/CSAM_Detection_Technical_Summary.pdf

以上是关于苹果新功能惹众怒,4000多家组织和个人签署公开信 敦促苹果放弃“儿童安全”功能的主要内容,如果未能解决你的问题,请参考以下文章