求高人指点matlab语音端点检测程序

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了求高人指点matlab语音端点检测程序相关的知识,希望对你有一定的参考价值。

function [x1,x2] = vad(x)

%幅度归一化到[-1,1]

x = double(x);

x = x / max(abs(x));

%常数设置

FrameLen = 240;%指定帧长

FrameInc = 80;%指定帧移

amp1 = 10;

amp2 = 2;

zcr1 = 10;

zcr2 = 5;

maxsilence = 8; % 6*10ms = 30ms

minlen = 15; % 15*10ms = 150ms

status = 0;

count = 0;

silence = 0;

%计算过零率

tmp1 = enframe(x(1:end-1), FrameLen, FrameInc);%分帧处理,tmp1和tmp2为分帧后形成的二维数组

tmp2 = enframe(x(2:end) , FrameLen, FrameInc);

signs = (tmp1.*tmp2)<0;

diffs = (tmp1 -tmp2)>0.02;

zcr = sum(signs.*diffs, 2);

%计算短时能量

amp = sum(abs(enframe(filter([1 -0.9375], 1, x), FrameLen, FrameInc)), 2);

%调整能量门限

amp1 = min(amp1, max(amp)/4);

amp2 = min(amp2, max(amp)/8);

%开始端点检测

x1 = [];

x2 = [];

for n=1:length(zcr)

goto = 0;

switch status

case 0,1 % 0 = 静音, 1 = 可能开始

if amp(n) > amp1 % 确信进入语音段

x1(end+1) = max(n-count-1,1);

status = 2;

silence = 0;

count = count + 1;

elseif amp(n) > amp2 | ... % 可能处于语音段

zcr(n) > zcr2

status = 1;

count = count + 1;

else % 静音状态

status = 0;

count = 0;

if length(x1)~=length(x2)

x2(end+1)=x1(end)+count-silence/2-1;

end

end

case 2, % 2 = 语音段

if amp(n) > amp2 | ... % 保持在语音段

zcr(n) > zcr2

count = count + 1;

else % 语音将结束

silence = silence+1;

if silence < maxsilence % 静音还不够长,尚未结束

count = count + 1;

elseif count < minlen % 语音长度太短,认为是噪声

status = 0;

silence = 0;

count = 0;

else % 语音结束

status = 3;

end

end

case 3,

status=0;

x2(end+1)=x1(end)+count-silence/2-1;

end

end

% count = count-silence/2;

% v_count(i)=v_count(i)+v_count(i-1);

% v_silence(i)=v_count(i)+v_silence(i);

if length(x2)<length(x1)

x2(end+1)=length(zcr);

end

subplot(311)

plot(x)

axis([1 length(x) -1 1])

ylabel('Speech');

for i=1:length(x2);

line([x1(i)*FrameInc x1(i)*FrameInc], [-1 1], 'Color', 'red');

line([x2(i)*FrameInc x2(i)*FrameInc], [-1 1], 'Color', 'green');

end

% line([x1*FrameInc x1*FrameInc], [-1 1], 'Color', 'red');

% line([x2*FrameInc x2*FrameInc], [-1 1], 'Color', 'red');

subplot(312)

plot(amp);

axis([1 length(amp) 0 max(amp)])

ylabel('Energy');

for i=1:length(x2);

line([x1(i) x1(i)], [min(amp),max(amp)], 'Color', 'red');

line([x2(i) x2(i)], [min(amp),max(amp)], 'Color', 'green');

end

subplot(313)

plot(zcr);

axis([1 length(zcr) 0 max(zcr)])

ylabel('ZCR');

for i=1:length(x2);

line([x1(i) x1(i)], [min(zcr),max(zcr)], 'Color', 'red');

line([x2(i) x2(i)], [min(zcr),max(zcr)], 'Color', 'green');

end

具体怎么在matlab上运行

%% 该代码为基于带动量项的BP神经网络语音识别

%% 清空环境变量

clc

clear

%% 训练数据预测数据提取及归一化

%下载四类语音信号

load data1 c1

load data2 c2

load data3 c3

load data4 c4

%四个特征信号矩阵合成一个矩阵

data(1:500,:)=c1(1:500,:);

data(501:1000,:)=c2(1:500,:);

data(1001:1500,:)=c3(1:500,:);

data(1501:2000,:)=c4(1:500,:);

%从1到2000间随机排序

k=rand(1,2000);

[m,n]=sort(k);

%输入输出数据

input=data(:,2:25);

output1 =data(:,1);

%把输出从1维变成4维

for i=1:2000

switch output1(i)

case 1

output(i,:)=[1 0 0 0];

case 2

output(i,:)=[0 1 0 0];

case 3

output(i,:)=[0 0 1 0];

case 4

output(i,:)=[0 0 0 1];

end

end

%随机提取1500个样本为训练样本,500个样本为预测样本

input_train=input(n(1:1500),:)';

output_train=output(n(1:1500),:)';

input_test=input(n(1501:2000),:)';

output_test=output(n(1501:2000),:)';

%输入数据归一化

[inputn,inputps]=mapminmax(input_train);

%% 网络结构初始化

innum=24;

midnum=25;

outnum=4;

%权值初始化

w1=rands(midnum,innum);

b1=rands(midnum,1);

w2=rands(midnum,outnum);

b2=rands(outnum,1);

w2_1=w2;w2_2=w2_1;

w1_1=w1;w1_2=w1_1;

b1_1=b1;b1_2=b1_1;

b2_1=b2;b2_2=b2_1;

%学习率

xite=0.1

alfa=0.01;

%% 网络训练

for ii=1:10

E(ii)=0;

for i=1:1:1500

%% 网络预测输出

x=inputn(:,i);

% 隐含层输出

for j=1:1:midnum

I(j)=inputn(:,i)'*w1(j,:)'+b1(j);

Iout(j)=1/(1+exp(-I(j)));

end

% 输出层输出

yn=w2'*Iout'+b2;

%% 权值阀值修正

%计算误差

e=output_train(:,i)-yn;

E(ii)=E(ii)+sum(abs(e));

%计算权值变化率

dw2=e*Iout;

db2=e';

for j=1:1:midnum

S=1/(1+exp(-I(j)));

FI(j)=S*(1-S);

end

for k=1:1:innum

for j=1:1:midnum

dw1(k,j)=FI(j)*x(k)*(e(1)*w2(j,1)+e(2)*w2(j,2)+e(3)*w2(j,3)+e(4)*w2(j,4));

db1(j)=FI(j)*(e(1)*w2(j,1)+e(2)*w2(j,2)+e(3)*w2(j,3)+e(4)*w2(j,4));

end

end

w1=w1_1+xite*dw1'+alfa*(w1_1-w1_2);

b1=b1_1+xite*db1'+alfa*(b1_1-b1_2);

w2=w2_1+xite*dw2'+alfa*(w2_1-w2_2);

b2=b2_1+xite*db2'+alfa*(b2_1-b2_2);

w1_2=w1_1;w1_1=w1;

w2_2=w2_1;w2_1=w2;

b1_2=b1_1;b1_1=b1;

b2_2=b2_1;b2_1=b2;

end

end

%% 语音特征信号分类

inputn_test=mapminmax('apply',input_test,inputps);

for ii=1:1

for i=1:500%1500

%隐含层输出

for j=1:1:midnum

I(j)=inputn_test(:,i)'*w1(j,:)'+b1(j);

Iout(j)=1/(1+exp(-I(j)));

end

fore(:,i)=w2'*Iout'+b2;

end

end

%% 结果分析

%根据网络输出找出数据属于哪类

for i=1:500

output_fore(i)=find(fore(:,i)==max(fore(:,i)));

end

%BP网络预测误差

error=output_fore-output1(n(1501:2000))';

%画出预测语音种类和实际语音种类的分类图

figure(1)

plot(output_fore,'r')

hold on

plot(output1(n(1501:2000))','b')

legend('预测语音类别','实际语音类别')

%画出误差图

figure(2)

plot(error)

title('BP网络分类误差','fontsize',12)

xlabel('语音信号','fontsize',12)

ylabel('分类误差','fontsize',12)

%print -dtiff -r600 1-4

k=zeros(1,4);

%找出判断错误的分类属于哪一类

for i=1:500

if error(i)~=0

[b,c]=max(output_test(:,i));

switch c

case 1

k(1)=k(1)+1;

case 2

k(2)=k(2)+1;

case 3

k(3)=k(3)+1;

case 4

k(4)=k(4)+1;

end

end

end

%找出每类的个体和

kk=zeros(1,4);

for i=1:500

[b,c]=max(output_test(:,i));

switch c

case 1

kk(1)=kk(1)+1;

case 2

kk(2)=kk(2)+1;

case 3

kk(3)=kk(3)+1;

case 4

kk(4)=kk(4)+1;

end

end

%正确率

rightridio=(kk-k)./kk追问

我的是语音端点检测,从论坛上找的都是这个程序,想知道具体怎么在matlab上运行

参考技术A 将上面的代码保存为vad.m文件,然后再命令窗口中调用。如:[x,fs]=wavread('E:\a007.wav');

[x1,x2] = vad(x);

语音识别基于matlab语音分帧+端点检测+pitch提取+DTW算法歌曲识别含Matlab源码 1057期

一、简介

Dynamic Time Warping(DTW)诞生有一定的历史了(日本学者Itakura提出),它出现的目的也比较单纯,是一种衡量两个长度不同的时间序列的相似度的方法。应用也比较广,主要是在模板匹配中,比如说用在孤立词语音识别(识别两段语音是否表示同一个单词),手势识别,数据挖掘和信息检索等中。

1 概述

在大部分的学科中,时间序列是数据的一种常见表示形式。对于时间序列处理来说,一个普遍的任务就是比较两个序列的相似性。

在时间序列中,需要比较相似性的两段时间序列的长度可能并不相等,在语音识别领域表现为不同人的语速不同。因为语音信号具有相当大的随机性,即使同一个人在不同时刻发同一个音,也不可能具有完全的时间长度。而且同一个单词内的不同音素的发音速度也不同,比如有的人会把“A”这个音拖得很长,或者把“i”发的很短。在这些复杂情况下,使用传统的欧几里得距离无法有效地求的两个时间序列之间的距离(或者相似性)。

2 DTW方法原理

在时间序列中,需要比较相似性的两段时间序列的长度可能并不相等,在语音识别领域表现为不同人的语速不同。而且同一个单词内的不同音素的发音速度也不同,比如有的人会把“A”这个音拖得很长,或者把“i”发的很短。另外,不同时间序列可能仅仅存在时间轴上的位移,亦即在还原位移的情况下,两个时间序列是一致的。在这些复杂情况下,使用传统的欧几里得距离无法有效地求的两个时间序列之间的距离(或者相似性)。

DTW通过把时间序列进行延伸和缩短,来计算两个时间序列性之间的相似性:

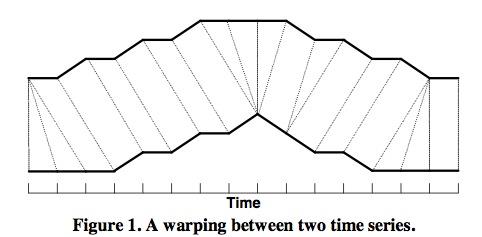

如上图所示,上下两条实线代表两个时间序列,时间序列之间的虚线代表两个时间序列之间的相似的点。DTW使用所有这些相似点之间的距离的和,称之为归整路径距离(Warp Path Distance)来衡量两个时间序列之间的相似性。

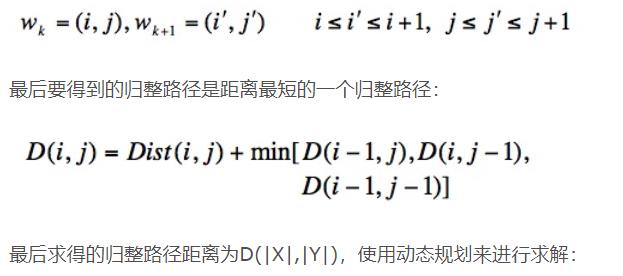

2 DTW计算方法:

令要计算相似度的两个时间序列为X和Y,长度分别为|X|和|Y|。

归整路径(Warp Path)

归整路径的形式为W=w1,w2,…,wK,其中Max(|X|,|Y|)<=K<=|X|+|Y|。

wk的形式为(i,j),其中i表示的是X中的i坐标,j表示的是Y中的j坐标。

归整路径W必须从w1=(1,1)开始,到wK=(|X|,|Y|)结尾,以保证X和Y中的每个坐标都在W中出现。

另外,W中w(i,j)的i和j必须是单调增加的,以保证图1中的虚线不会相交,所谓单调增加是指:

上图为代价矩阵(Cost Matrix) D,D(i,j)表示长度为i和j的两个时间序列之间的归整路径距离。

二、源代码

clc;

clear;

close all;

waveFile = sprintf('同桌的你.wav');% 同桌的你 女儿情 回梦游仙 滴答 彩虹

% 读取波形---端点检测---切音框

waveFile='同桌的你.wav';

pivFile = sprintf('同桌的你.piv');

pivFile=['mfcc' pivFile];

[y,fs]=audioread(waveFile); %读取原文件

figure

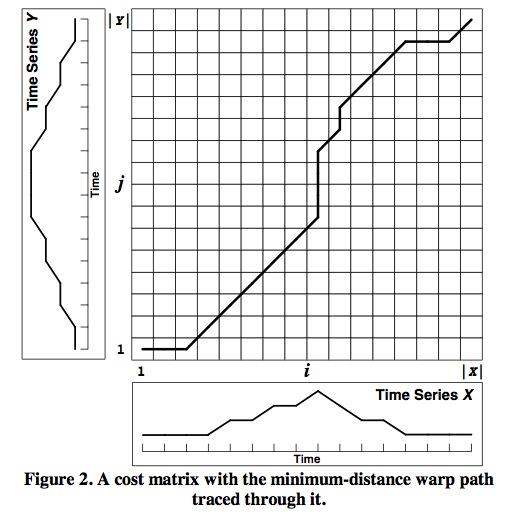

subplot(221)

plot(y);

title('原图形');

frame = PointDetect(waveFile); %端点检测

subplot(222)

plot(frame);

title('端点检测');

subplot(223)

pitch=wave2pitch(frame,fs); %计算音高

plot(pitch);

title('音高');

function [pitch, pdf, frameEstimated, excitation]=frame2pitch(frame, opt, showPlot)

% frame2acf: PDF (periodicity detection function) of a given frame (primarily for pitch tracking)

%

% Usage:

% out=frame2pdf(frame, opt, showPlot);

% frame: Given frame

% opt: Options for PDF computation

% opt.pdf: PDF function to be used

% 'acf' for ACF

% 'amdf' for AMDF

% 'nsdf' for NSDF

% 'acfOverAmdf' for ACF divided by AMDF

% 'hps' for harmonics product sum

% 'ceps' for cepstrum

% opt.maxShift: no. of shift operations, which is equal to the length of the output vector

% opt.method: 1 for using the whole frame for shifting

% 2 for using the whole frame for shifting, but normalize the sum by it's overlap area

% 3 for using frame(1:frameSize-maxShift) for shifting

% opt.siftOrder: order of SIFT (0 for not using SIFT)

% showPlot: 0 for no plot, 1 for plotting the frame and ACF output

% out: the returned PDF vector

%

% Example:

% waveFile='soo.wav';

% au=myAudioRead(waveFile);

% frameSize=256;

% frameMat=enframe(au.signal, frameSize);

% frame=frameMat(:, 292);

% opt=ptOptSet(au.fs, au.nbits, 1);

% opt.alpha=0;

% pitch=frame2pitch(frame, opt, 1);

%

% See also frame2acf, frame2amdf, frame2nsdf.

% Roger Jang 20020404, 20041013, 20060313

if nargin<1, selfdemo; return; end

if nargin<2||isempty(opt), opt=ptOptSet(8000, 16, 1); end

if nargin<3, showPlot=0; end

%% ====== Preprocessing

%save frame frame

frame=frameZeroMean(frame, opt.zeroMeanPolyOrder);

%frame=frameZeroMean(frame, 0);

frameEstimated=[];

excitation=[];

if opt.siftOrder>0

[frameEstimated, excitation, coef]=sift(frame, opt.siftOrder); % Simple inverse filtering tracking

frame=excitation;

end

frameSize=length(frame);

maxShift=min(frameSize, opt.maxShift);

switch lower(opt.pdf)

case 'acf'

% pdf=frame2acf(frame, maxShift, opt.method);

pdf=frame2acfMex(frame, maxShift, opt.method);

% if opt.method==1

% pdfWeight=1+linspace(0, opt.alpha, length(pdf))';

% pdf=pdf.*pdfWeight; % To avoid double pitch error (esp for violin). 20110416

% end

% if opt.method==2

% pdfWeight=1-linspace(0, opt.alpha, length(pdf))'; % alpha is less than 1.

% pdf=pdf.*pdfWeight; % To avoid double pitch error (esp for violin). 20110416

% end

pdfLen=length(pdf);

pdfWeight=opt.alpha+pdfLen*(1-opt.alpha)./(pdfLen-(0:pdfLen-1)');

pdf=pdf.*pdfWeight; % alpha=0==>normalized ACF, alpha=1==>tapering ACF

case 'amdf'

% amdf=frame2amdf(frame, maxShift, opt.method);

amdf=frame2amdfMex(frame, maxShift, opt.method);

pdf=max(amdf)*(1-linspace(0,1,length(amdf))')-amdf;

case 'nsdf'

% pdf=frame2nsdf(frame, maxShift, opt.method);

pdf=frame2nsdfMex(frame, maxShift, opt.method);

case 'acfoveramdf'

opt.pdf='acf';

[acfPitch, acf] =feval(mfilename, frame, opt);

opt.pdf='amdf';

[amdfPitch, amdf]=feval(mfilename, frame, opt);

pdf=0*acf;

pdf(2:end)=acf(2:end)./amdf(2:end);

case 'hps'

[pdf, freq]=frame2hps(frame, opt.fs, opt.zeroPaddedFactor);

case 'ceps'

pdf=frame2ceps(frame, opt.fs, opt.zeroPaddedFactor);

otherwise

error('Unknown PDF=%s!', opt.pdf);

end

switch lower(opt.pdf)

case {'acf', 'amdf', 'nsdf', 'amdf4pt', 'acfoveramdf', 'ceps'}

n1=floor(opt.fs/opt.freqRange(2)); % pdf(1:n1) will not be used

n2= ceil(opt.fs/opt.freqRange(1)); % pdf(n2:end) will not be used

if n2>length(pdf), n2=length(pdf); end

% Update n1 such that pdf(n1)<=pdf(n1+1)

while n1<n2 & pdf(n1)>pdf(n1+1), n1=n1+1; end

% Update n2 such that pdf(n2)<=pdf(n2-1)

while n2>n1 & pdf(n2)>pdf(n2-1), n2=n2-1; end

pdf2=pdf;

pdf2(1:n1)=-inf;

pdf2(n2:end)=-inf;

[maxValue, maxIndex]=max(pdf2);

if isinf(maxValue) || maxIndex==n1+1 || maxIndex==n2-1

pitch=0; maxIndex=nan; maxValue=nan;

elseif opt.useParabolicFit

deviation=optimViaParabolicFit(pdf(maxIndex-1:maxIndex+1));

maxIndex=maxIndex+deviation;

pitch=freq2pitch(opt.fs/(maxIndex-1));

else

pitch=freq2pitch(opt.fs/(maxIndex-1));

end

case {'hps'}

pdf2=pdf;

pdf2(freq<opt.freqRange(1)|freq>opt.freqRange(2))=-inf;

[maxValue, maxIndex]=max(pdf2);

% if opt.useParabolicFit

% deviation=optimViaParabolicFit(pdf(maxIndex-1:maxIndex+1));

% maxIndex=maxIndex+deviation;

% end

pitch=freq2pitch(freq(maxIndex));

otherwise

error('Unknown PDF=%s!', opt.pdf);

end

if showPlot

subplot(2,1,1);

plot(frame, '.-');

set(gca, 'xlim', [-inf inf]);

title('Input frame');

subplot(2,1,2);

plot(1:length(pdf), pdf, '.-', 1:length(pdf2), pdf2, '.r');

line(maxIndex, maxValue, 'marker', '^', 'color', 'k');

set(gca, 'xlim', [-inf inf]);

title(sprintf('%s vector (opt.method = %d)', opt.pdf, opt.method));

end

% ====== Self demo

function selfdemo

mObj=mFileParse(which(mfilename));

strEval(mObj.example);

三、运行结果

四、备注

版本:2014a

以上是关于求高人指点matlab语音端点检测程序的主要内容,如果未能解决你的问题,请参考以下文章