Android音视频视频混音

Posted 顾修忠

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Android音视频视频混音相关的知识,希望对你有一定的参考价值。

人间观察

其实人这一辈子 真的遇不到几个真心对你好爱你的人 如果有幸能牵手 那就别并肩 好好的 别老是冷冰冰 说反话

简介

短视频的编辑功能有很多,比如:添加背景音乐,剪切,拼接视频/音频,特效,贴纸等等。

本文介绍为MP4视频增加背景音乐(或者控制视频原始的音量大小),其中涉及到音视频的解码,视频和音频的指定时长的提取,音频视频的分离,混合视频音频生成mp4,音频混音,音量调节以及一些音频处理细节和注意的地方等技术。采用的是android的硬编解码MediaCodec+ MediaExtractor+ MediaMuxer。

效果图

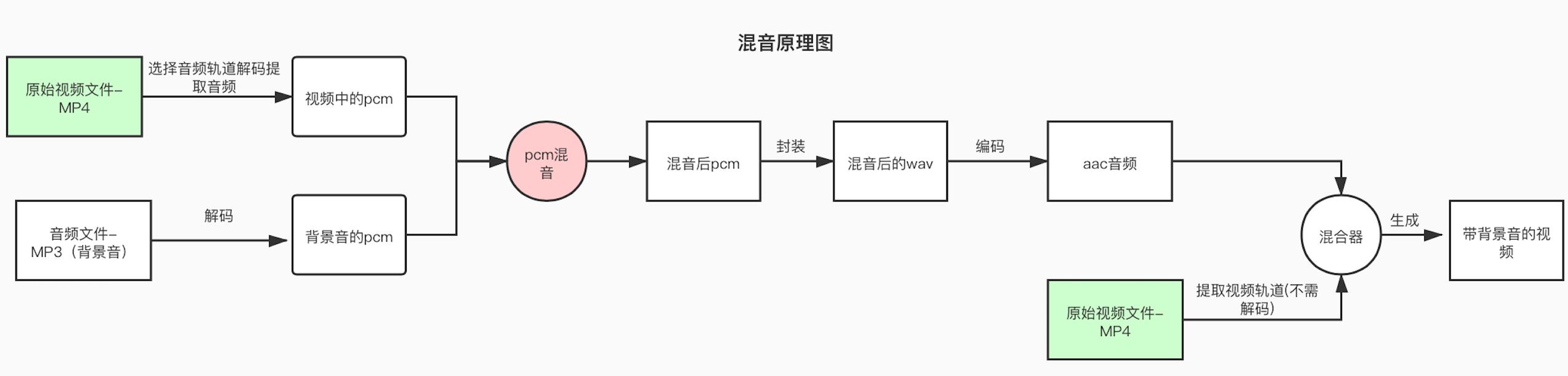

处理方案/原理

如图所示如果我们想要把原始的mp4视频增加背景音。我们需要如下几个步骤。

- 选择音频轨道进行解码提取音频,借助于

MediaExtractor和MediaCodec,然后将解码后的pcm保存到临时文件video.pcm - 解码背景音的mp3文件,借助于

MediaCodec,然后将解码后的pcm保存到临时文件bgm.pcm - 核心的一步pcm数据的处理,比如混音等,后文详细介绍。然后混音后的pcm保存到临时文件mix.pcm

- 混音后的pcm转wav,主要是加入音频的信息(采样频率,采样位数,声道数)在文件头中加入

42byte的wav的头信息。 - 将wav编码为aac音频并写入文件中。借助于

MediaCodec和MediaMuxer混合生成器 - 将原始视频的中的视频写入到文件,借助于

MediaMuxer和MediaExtractor

第1,2步的解码这里不多介绍了可以参考之前的文章。第4步pcm转为wav也可以参考之前文章。第5,6步主要是MediaMuxer后文介绍下。主要是第2步重点介绍下。

混音

混音本质就是对数据的处理。

PCM数据描述

我们先回顾下pcm的描述,也可以看下之前的音频基础那篇文章的介绍。我们这里说下采样位数。

采样位数:表示每个采样点用多少比特表示。常用的量化位数有8位、16位和32位。比如采样位数为8bit时,每个采样点可以表示256个不同的采样值,当采样位数为16bit时,每个采样点可以表示65536个不同的采样值。采样位数的大小影响声音的质量,采样位数越多,量化后的波形越接近原始波形,声音的质量越高,需要的存储空间就越大,反之同理。一般情况下,采样位数是16bit,就像mp3的cd音质,你听起来也没那么失真。

采样点数据有符号和无符号之分,比如:8bit的样本数据,有符号的是[-128 , 127],无符号的是[0,255 ]。16bit的样本数据,有符号的是 [-32768 , 32767],无符号的是[0, 65535]. 大多数pcm样本数据使用整形表示,对于一些高精度的场景使用float 浮点型表示。对于我们平时看到的听到的音视频都是整形。

PCM的数据存储方式

如果是单声道音频,采样数据按照时间的先后顺序依次存储,如果是双声道音频,则按照LRLRLRLR方式存储,每个采样点的存储方式还与大小端有关。大端如下:

另外MediaCodec解码出来的pcm是按照LRLRLRLR方式存储,但是FFmpeg解码出来的pcm存储格式很丰富(等后续学习FFmpeg时了解)。

此外即使同样是signed 16 bits 有符号,也存在packed和planar的区别。对于双声道音频来说,packed表示两个声道的数据交错存储,也就是LRLRLRLR的方式存储;planar表示两个声道的数据分开存储,也就是LLLLRRRR的方式存储。

可以看到通过MediaCodec解码出来的pcm是按照packed的方式存储的,而FFmpeg可以是任何一种。所以为了统一化处理,需要进行重采样,比如你可以采用:每个采样点按照2个字节的有符号的short类型,并且按照planar的方式存储。

重采样:

对pcm数据进行重新采样,可以改变它的声道数,采样率和采样格式。比如:原先的pcm音频数据是2个声道,44100采样率,32 bit单精度型,可以重采样为:2个声道,44100采样率,有符号short类型

本文的demo的视频和音频文件是按照采样率是44100hz, 双声道 ,16位。使用的是MediaCodec解码的音频,所以为packed类型。

混音数据处理过程:

- 所以基于以上的pcm数据的存储格式的原理,就可以进行处理了。

用2个buffer缓存区来保存从文件读到的之前解码后的视频的pcm数据记为buffer1,另外一个为背景音乐的记为buffer2.混合后的记为buffer3.

也就是buffer1和buffer2 分别把连续的2个byte转为short,前一个字节放在低八位后面的字节放在高八位。也就是:

short temp1 = (short) ((buffer1[i] & 0xff) | (buffer1[i + 1] & 0xff) << 8);

short temp2 = (short) ((buffer2[i] & 0xff) | (buffer2[i + 1] & 0xff) << 8);

- 然后把2个short的值相加就得到了混音的值,在相加的过程中我们可以给temp1或者temp2分别乘以一个系数就可以达到控制各自音量(原始视频和背景音乐的音量)的目的。想一想是吧!这样我们就可以调节各自音量了。系数我们也要非常注意!,注意数据的精度丢失。所以为:

// videoVolume和 bgAudioVolume取值0-100

val volume1: Float = videoVolume * 1.0f / 100

val volume2: Float = bgAudioVolume * 1.0f / 100

temp = (int) (temp1 * volume1 + temp2 * volume2);

temp就是混音后的值。但是还有一点是2个short类型的数字相加得到的结果有可能超过short的范围[-32768 , 32767] ,所以需要控制一下最大最小值:

if (temp > 32767)

temp = 32767;

else if (temp < -32768)

temp = -32768;

- 最后还原数据,我们得到了混音后的数据为int型的,我们还得把它铺开转为byte类型

buffer3[i] = (byte) (temp & 0x00ff); // 低8位

buffer3[i + 1] = (byte) ((temp & 0xFF00) >> 8 ); // 高8位

最后混音的关键代码(kotlin版)如下:

private fun mixPcm(

pcm1: String,

pcm2: String,

mixPcm: String,

videoVolume: Int,

bgAudioVolume: Int

)

val volume1: Float = videoVolume * 1.0f / 100

val volume2: Float = bgAudioVolume * 1.0f / 100

val buffSize = 2048

val buffer1 = ByteArray(buffSize)

val buffer2 = ByteArray(buffSize)

val buffer3 = ByteArray(buffSize)

val fis1 = FileInputStream(pcm1)

val fis2 = FileInputStream(pcm2)

val fosMix = FileOutputStream(mixPcm)

var isEnd1 = false

var isEnd2 = false

var temp1: Short

var temp2: Short

var temp: Int

var ret1 = -1

var ret2 = -1

while (!isEnd1 || !isEnd2)

if (!isEnd1)

ret1 = fis1.read(buffer1)

isEnd1 = ret1 == -1

if (!isEnd2)

ret2 = fis2.read(buffer2)

isEnd2 = ret2 == -1

for (i in buffer2.indices step 2)

// java 版本清楚些

# // temp1 = (short) ((buffer1[i] & 0xff) | (buffer1[i + 1] & 0xff) << 8);

// temp2 = (short) ((buffer2[i] & 0xff) | (buffer2[i + 1] & 0xff) << 8);

// temp1 = PcmToWavUtil.to(buffer1[i], buffer1[i + 1])

// temp2 = PcmToWavUtil.to(buffer2[i], buffer2[i + 1])

temp1 =

((buffer1[i].toInt() and 0xff) or ((buffer1[i + 1].toInt() and 0xff) shl 8)).toShort()

temp2 =

((buffer2[i].toInt() and 0xff) or ((buffer2[i + 1].toInt() and 0xff) shl 8)).toShort()

// 两个short变量相加 会大于short

temp = (temp1 * volume1 + temp2 * volume2).toInt()

// short类型的取值范围[-32768 ~ 32767]

if (temp > 32767)

temp = 32767

else if (temp < -32768)

temp = -32768

// java 版本清楚些

// buffer3[i] = (byte) (temp & 0x00ff);

// buffer3[i + 1] = (byte) ((temp & 0xFF00) >> 8 );

// 低八位 高八位 低八位 高八位 。。。

buffer3[i] = (temp and 0x00ff).toByte()

buffer3[i + 1] = (temp and 0xff00).shr(8).toByte()

fosMix.write(buffer3)

fis1.close()

fis2.close()

fosMix.flush()

fosMix.close()

Log.d(TAG, "mixPcm:$mixPcm")

注意事项:

kotlin中,位运算只能是Int 和 Long类型,所以大部分我们都需要通过toInt()或者toLong()方法转为Int或Long类型。比如

(buffer1[i].toInt() and 0xff)

语法糖有时候真的很坑,还不好理解。

关于性能

个人感觉MediaCodec 单纯解码音频的解码速度比较慢,视频还不错。FFmpeg对于从视频中提取PCM较快(网上所说),等后续用FFmpeg的时候看下。

混合器MediaMuxer

在Android中我们可以使用MediaMuxer来封装编码后的视频流和音频流到mp4容器中。它仅支持一个视频轨道(track)和一个音频轨道(track)。

如果你有多个音频轨道,那么需要把多个音频轨道合为一个音频轨道一起再使用MediaMuxer。也就是为什么要混音了。

- 创建。指定输出视频的格式和文件目录。

val mediaMuxer = MediaMuxer(output, MediaMuxer.OutputFormat.MUXER_OUTPUT_MPEG_4)

- 添加轨道信息。

创建MediaMuxer对象之后,一个比较重要的操作就是addTrack(MediaFormat format),添加媒体通道,该函数需要传入MediaFormat对象,通常从MediaExtractor或者MediaCodec中获取,比如

val videoFormat = mediaExtractor.getTrackFormat(videoIndex)

val muxerVideoTrackIndex = mediaMuxer.addTrack(videoFormat)

val audioFormat = mediaExtractor.getTrackFormat(audioIndex)

val muxerAudioIndex = mediaMuxer.addTrack(audioFormat)

- 启动。 添加完所有track后调用start方法

mediaMuxer.start()

- 写入音视频数据

public void writeSampleData(int trackIndex, @NonNull ByteBuffer byteBuf,

@NonNull BufferInfo bufferInfo) ;

trackIndex 视频轨道还是音频轨道

byteBuf 为数据

bufferInfo 为数据的信息。

// bufferInfo属性

info.size 数据的大小

info.flags 是否为关键帧

info.presentationTimeUs PTS 时间戳,注意单位是 us

- 停止写入stop和释放release

mediaMuxer.stop()

mediaMuxer.release()

源码

https://github.com/ta893115871/VideoBGAdd

文章中的源码采用kotlin,主要是自己学习下,因为工作中用不到。

用到的mp4,mp3为网络上下载,只为学习使用,如有侵权将删除。

结尾

本文介绍了视频编辑功能的混音功能。涉及的知识点也不少,比如:pcm的数据格式,音频的mp3硬解为pcm,音频的硬编码为aac,在视频如何提取指定时长的视频和音频,如何把音频和视频混合为mp4,以及对数据的位运算等等。

其实主要是原理以及如何灵活的运用。

以上是关于Android音视频视频混音的主要内容,如果未能解决你的问题,请参考以下文章