Spark入门实战系列--2.Spark编译与部署(中)--Hadoop编译安装

Posted ErBing

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Spark入门实战系列--2.Spark编译与部署(中)--Hadoop编译安装相关的知识,希望对你有一定的参考价值。

【注】该系列文章以及使用到安装包/测试数据 可以在《倾情大奉送--Spark入门实战系列》获取

1、编译Hadooop

1.1 搭建环境

1.1.1 安装并设置maven

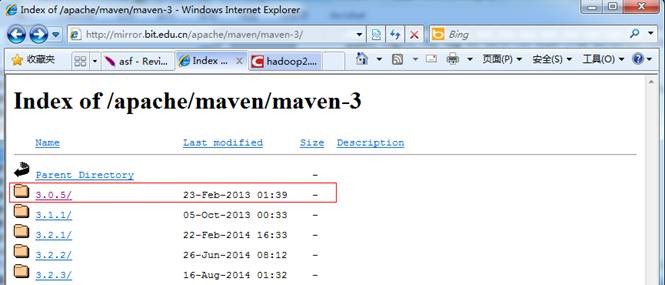

1. 下载maven安装包,建议安装3.0以上版本,本次安装选择的是maven3.0.5的二进制包,下载地址如下

http://mirror.bit.edu.cn/apache/maven/maven-3/

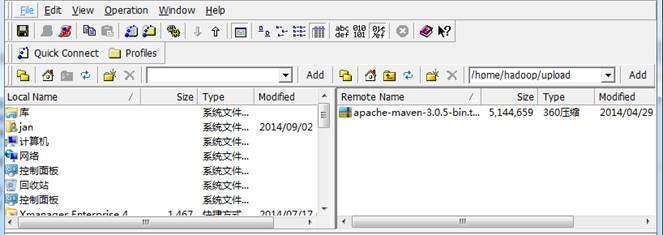

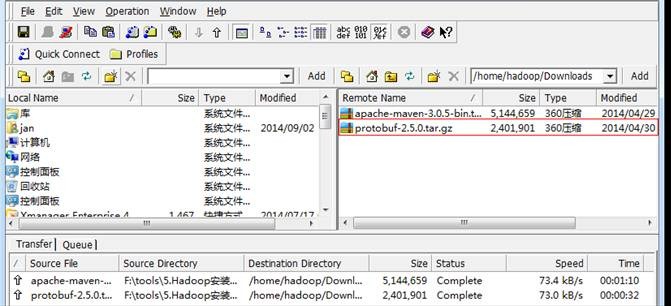

2. 使用ssh工具把maven包上传到/home/hadoop/upload目录

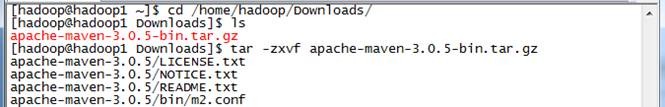

3. 解压缩apache-maven-3.0.5-bin.tar.gz包

$tar -zxvf apache-maven-3.0.5-bin.tar.gz

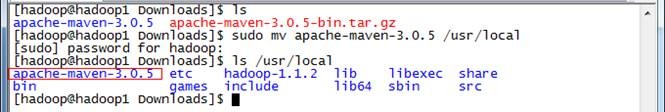

4. 把apache-maven-3.0.5目录移到/usr/local目录下

$sudo mv apache-maven-3.0.5 /usr/local

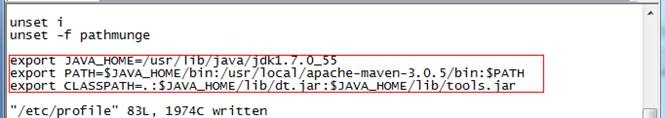

5. 在/etc/profile配置文件中加入如下设置

export PATH=$JAVA_HOME/bin:/usr/local/apache-maven-3.0.5/bin:$PATH

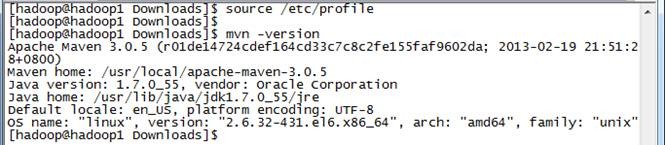

6. 编辑/etc/profile文件并验证配置是否成功:

$source /etc/profile

$mvn -version

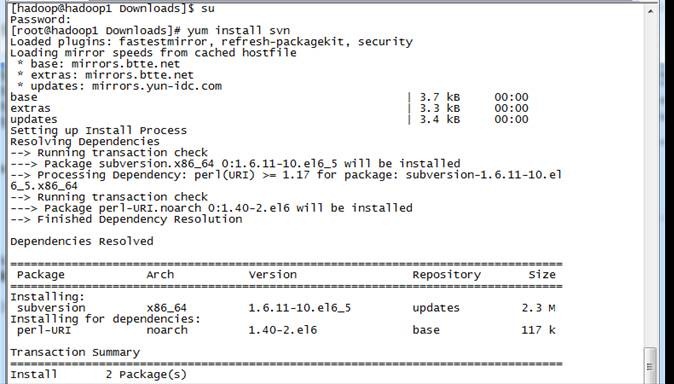

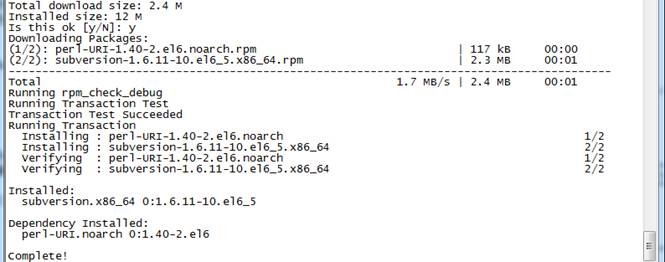

1.1.2 以root用户使用yum安装svn

#yum install svn

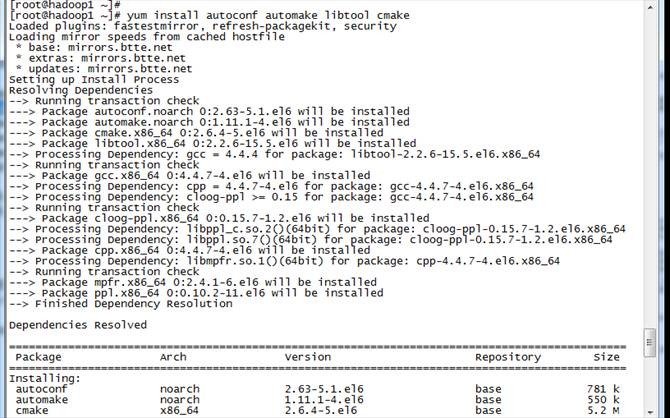

1.1.3 以root用户使用yum安装autoconf automake libtool cmake

#yum install autoconf automake libtool cmake

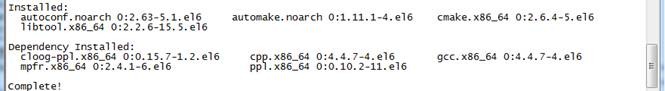

1.1.4 以root用户使用yum安装ncurses-devel

#yum install ncurses-devel

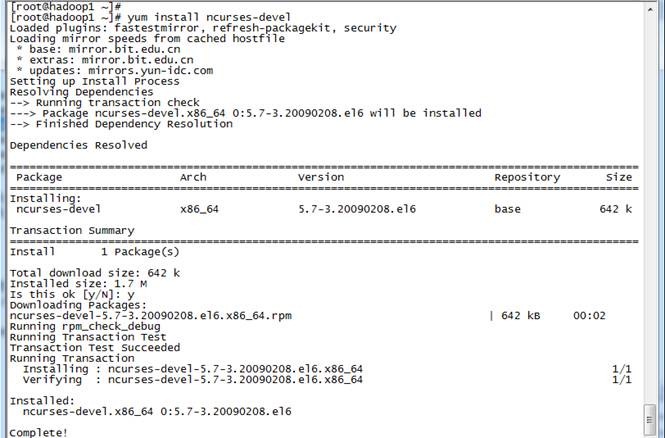

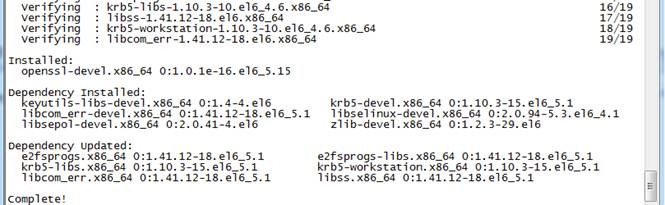

1.1.5 以root用户使用yum安装openssl-devel

#yum install openssl-devel

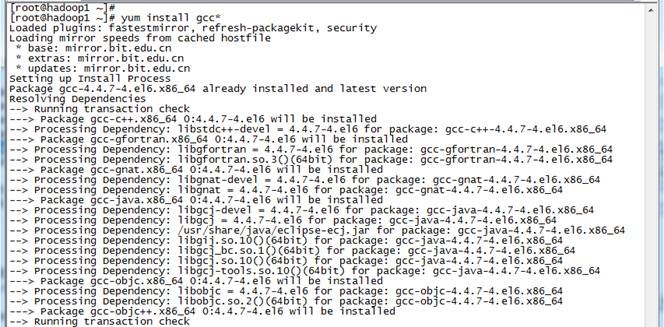

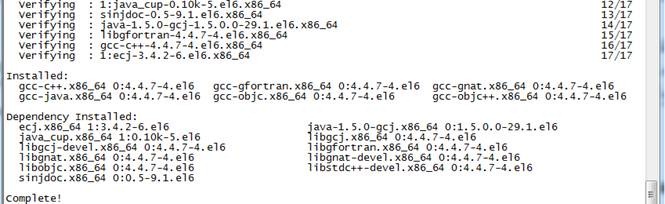

1.1.6 以root用户使用yum安装gcc*

#yum install gcc*

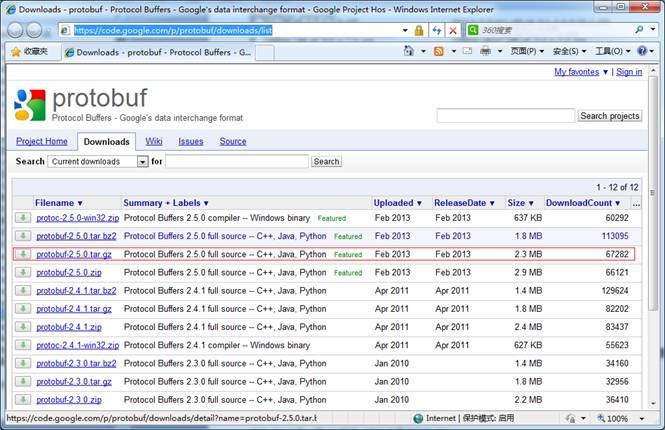

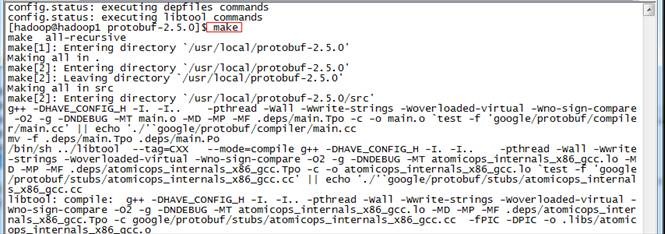

1.1.7 安装并设置protobuf

注:该程序包需要在gcc安装完毕后才能安装,否则提示无法找到gcc编译器。

1. 下载protobuf安装包

下载链接为: https://code.google.com/p/protobuf/downloads/list

2. 使用ssh工具把protobuf-2.5.0.tar.gz包上传到/home/hadoop/Downloads目录

3. 解压安装包

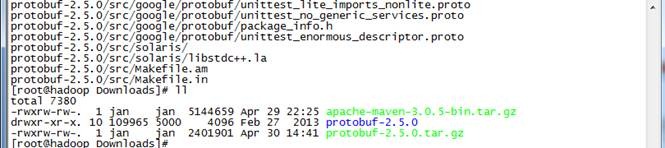

$tar -zxvf protobuf-2.5.0.tar.gz

4. 把protobuf-2.5.0目录转移到/usr/local目录下

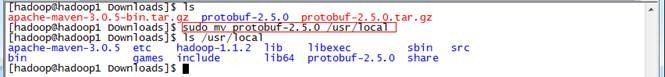

$sudo mv protobuf-2.5.0 /usr/local

5. 进行目录运行命令

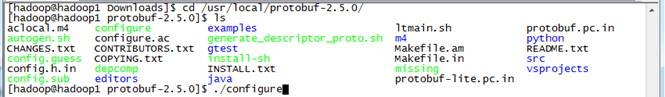

进入目录以root用户运行如下命令:

#./configure

#make

#make check

#make install

6. 验证是否安装成功

运行成功之后,通过如下方式来验证是否安装成功

#protoc

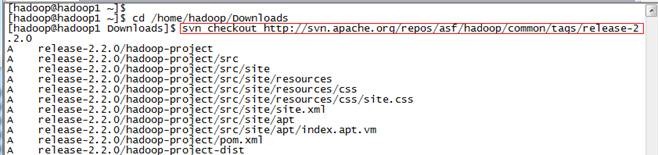

1.2 编译Hadoop

1.2.1 下载Hadoop源代码 Release2.2.0

通过SVN获取Hadoop2.2.0源代码,在/home/hadoop/Downloads目录下命令:

$svn checkout http://svn.apache.org/repos/asf/hadoop/common/tags/release-2.2.0

获取时间较长,大小约75.3M

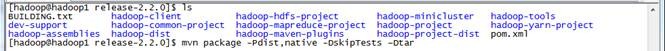

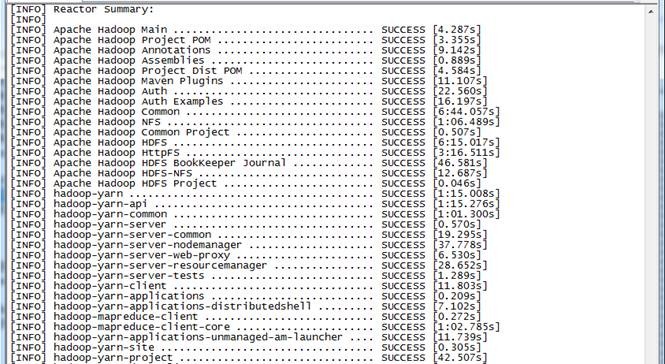

1.2.2 编译Hadoop源代码

:) 由于hadoop2.2.0在svn中pom.xml有点问题,会造成编译中出错,可先参考3.2修复该问题。在Hadoop源代码的根目录执行如下命令:

$mvn package -Pdist,native -DskipTests –Dtar

(注意:这行命令需要手工输入,如果复制执行会报异常!)

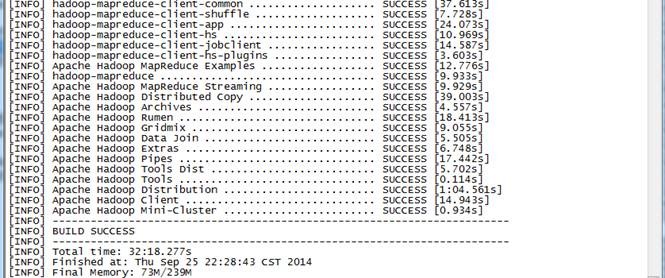

耗费的时间较长,总共花费了32分钟,在编译过程需要联网,从网络中下载所需要的资料。

1.2.3 验证编译是否成功

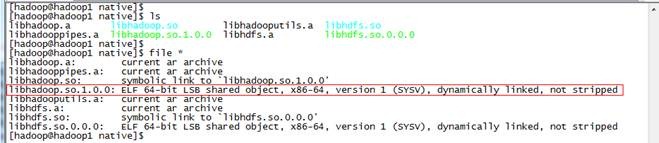

到 hadoop-dist/target/hadoop-2.2.0/lib/native 目录中查看libhadoop.so.1.0.0属性:

$file ./libhadoop.so.1.0.0

该文件为ELF 64-bit LSB则表示文件成功编译为64位

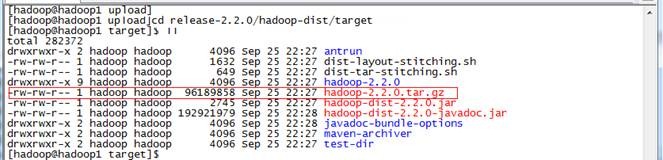

在hadoop-dist/target目录中已经打包好了hadoop-2.2.0.tar.gz,该文件作为Hadoop2.X 64位安装包。

2、安装Hadoop

2.1 配置准备

2.1.1 上传并解压Hadoop安装包

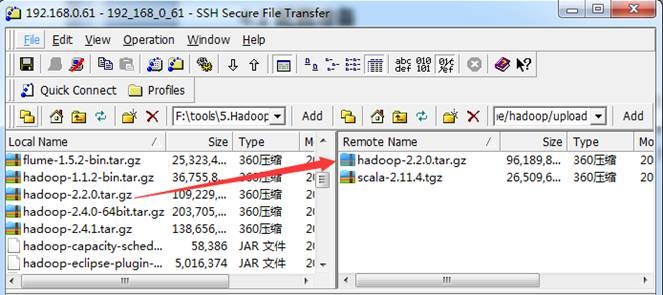

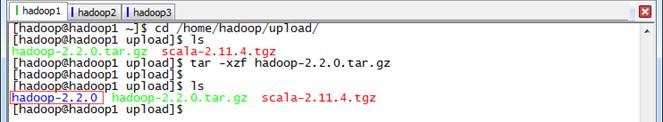

1.在Apache网站上提供Hadoop2.X安装包只支持32位操作系统安装,在64位服务器安装会出现4.1的错误异常。我们使用上一步骤编译好的hadoop-2.2.0.tar.gz文件作为安装包(也可以从网上下载native文件夹或者打包好的64位hadoop安装包),使用"Spark编译与部署(上)"中1. 3.1介绍的工具上传到/home/hadoop/upload 目录下

2. 在主节点上解压缩

$cd /home/hadoop/upload/

$tar -xzf hadoop-2.2.0.tar.gz

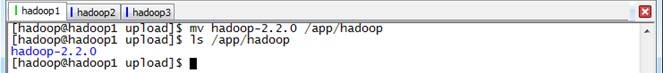

3. 把hadoop-2.2.0目录移到/app/hadoop目录下

$ mv hadoop-2.2.0 /app/hadoop

$ls /app/hadoop

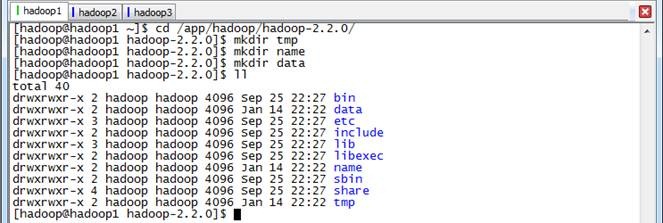

2.1.2 在Hadoop目录下创建子目录

hadoop用户在/app/hadoop/hadoop-2.2.0目录下创建tmp、name和data目录

$cd /app/hadoop/hadoop-2.2.0/

$mkdir tmp

$mkdir name

$mkdir data

$ll

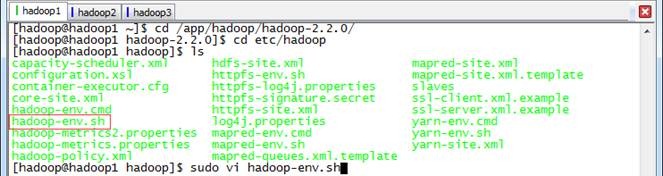

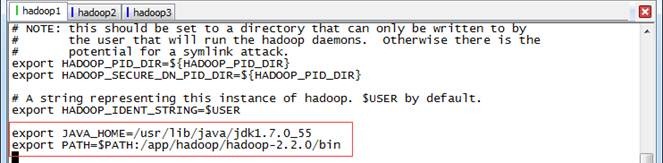

2.1.3 配置hadoop-env.sh

1. 打开配置文件hadoop-env.sh

$cd /app/hadoop/hadoop-2.2.0/etc/hadoop

$sudo vi hadoop-env.sh

2. 加入配置内容,设置JAVA_HOME和PATH路径

export JAVA_HOME=/usr/lib/java/jdk1.7.0_55

export PATH=$PATH:/app/hadoop/hadoop-2.2.0/bin

3. 编译配置文件hadoop-env.sh,并确 以上是关于Spark入门实战系列--2.Spark编译与部署(中)--Hadoop编译安装的主要内容,如果未能解决你的问题,请参考以下文章